Introducción

Estamos listos para hablar de varias nociones geométricas como ángulo, norma, distancia y de la desigualdad de Minkowski. Antes de hacer eso, hagamos un breve repaso de qué hemos hecho en estas últimas entradas.

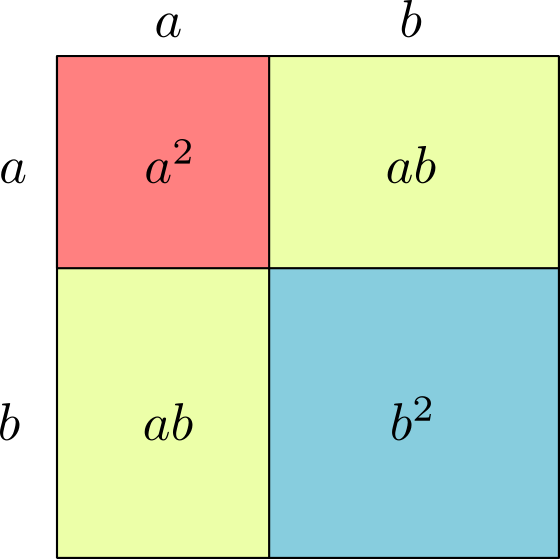

Primero, hablamos de formas bilineales y de su formas cuadráticas asociadas. Segundo, vimos cómo a través de la identidad de polarización podemos asignar una única forma bilineal simétrica a una forma cuadrática. Finalmente, en la última entrada nos enfocamos en las formas bilineales simétricas que cumplían cierta condición de positividad.

En esa misma entrada definimos producto interior, que simplemente es una forma bilineal simétrica y positiva definida. También definimos la norma de un vector en un espacio con producto interior $\langle \cdot, \cdot \rangle$, que era $$\Vert x \Vert = \sqrt{\langle x, x \rangle}.$$

Finalmente, en la entrada anterior probamos la siguiente versión general de la desigualdad de Cauchy-Schwarz:

Teorema (desigualdad de Cauchy-Schwarz). Sea $b:V\times V\to \mathbb{R}$ una forma bilineal simétrica y $q$ su forma cuadrática asociada.

- Si $b$ es positiva, entonces para todo $x$ y $y$ en $V$ tenemos que $$b(x,y)^2\leq q(x)q(y).$$ Si $x$ y $y$ son linealmente dependientes, se da la igualdad.

- Además, si $b$ es positiva definida y $x$ y $y$ son linealmente independientes, entonces la desigualdad es estricta.

Ángulos

Fijemos $V$ un espacio vectorial sobre los reales con producto interior. En la entrada anterior vimos que la desigualdad de Cauchy-Schwarz implica que para cualesquiera vectores $x$ y $y$ en $V$ tenemos que $$|\langle x, y \rangle| \leq \Vert x \Vert \cdot \Vert y \Vert.$$

Si $x$ y $y$ son vectores distintos de cero, podemos reescribir la desigualdad anterior como $$-1\leq \frac{\langle x, y \rangle}{\Vert x \Vert \cdot \Vert y \Vert}\leq 1.$$ Esto justifica la siguiente definición.

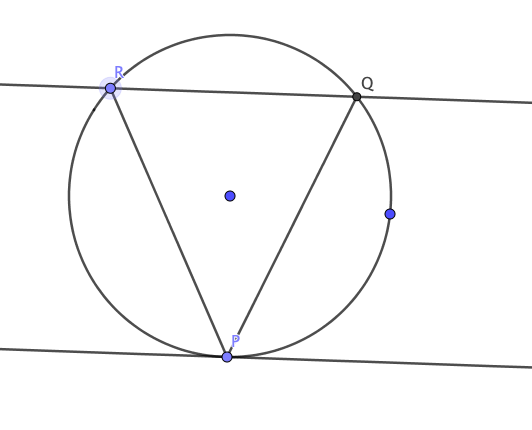

Definición. Sean $x$ y $y$ vectores no nulos. Definimos al ángulo entre $x$ y $y$ como el único ángulo $\theta$ en el intervalo $[0,\pi]$ tal que $$\cos \theta = \frac{\langle x, y \rangle}{\Vert x \Vert \cdot \Vert y \Vert}.$$

Observa que $\theta=\frac{\pi}{2}$ si y sólo si $\frac{\langle x, y \rangle}{\Vert x \Vert \cdot \Vert y \Vert}=0$. Esto ocurre si y sólo si $\langle x, y \rangle=0$. Este caso es particularmente importante, y por ello recibe una definición especial.

Definición. Decimos que $x$ y $y$ son ortogonales si $\langle x, y \rangle=0$.

Para empezar, veamos un ejemplo sencillo de ortogonalidad.

Ejemplo 1. Tomemos $\mathbb{R}^5$ con el producto interior canónico, es decir, el producto punto. Los vectores $u=(1,0,-4,0,5)$ y $v=(0,3,0,-2,0)$ tienen producto punto $$\langle u, v \rangle=1\cdot 0 + 0\cdot 3 + (-4)\cdot 0 + 0 \cdot (-2) + 5 \cdot 0=0,$$ así que son ortogonales.

$\triangle$

Ahora, veamos un ejemplo un poco más elaborado, del cálculo de un ángulo en un espacio vectorial de funciones.

Ejemplo 2. Anteriormente vimos que $\mathcal{C}[0,1]$ tiene un producto interior $$\langle f, g \rangle=\int_0^1 f(x)g(x)\, dx.$$ Calculemos el ángulo entre $f(x)=x^2$ y $g(x)=x^3$ con este producto interior. Primero, calculamos $\Vert f \Vert$ y $\Vert g \Vert$ como sigue

\begin{align*}

\Vert f \Vert^2 &= \int_0^1 x^4 \,dx = \frac{1}{5}\\

\Vert g \Vert^2 &= \int_0^1 x^6 \,dx = \frac{1}{7},

\end{align*}

de donde $\Vert f \Vert = \frac{1}{\sqrt{5}}$ y $\Vert g \Vert = \frac{1}{\sqrt{7}}$.

Luego, calculamos

\begin{align*}

\langle f,g \rangle &=\int_0^1 f(x)g(x) \, dx\\

&=\int_0^1 x^5 \, dx\\

&=\frac{1}{6}.

\end{align*}

Como esperaríamos por la desigualdad de Cauchy-Schwarz, tenemos la siguiente desigualdad:

\begin{align*}

\langle f,g \rangle &= \frac{1}{6}\leq \frac{1}{\sqrt{35}}=\Vert f \Vert \Vert g \Vert.

\end{align*}

El ángulo entre $f$ y $g$ es entonces

\begin{align*}

\theta &= \arccos\left(\frac{\langle f, g \rangle}{\Vert f \Vert \cdot \Vert g \Vert}\right)\\

&=\arccos\left(\frac{1/6}{1/\sqrt{35}}\right)\\

&=\arccos\left(\frac{\sqrt{35}}{6}\right).

\end{align*}

$\triangle$

Desigualdad de Minkowski

Hay una forma un poco distinta de escribir la desigualdad de Cauchy-Schwarz. La enunciamos a continuación.

Teorema (desigualdad de Minkowski). Sean $x$ y $y$ vectores de un espacio vectorial $V$ con una forma cuadrática positiva $q$. Entonces $$\sqrt{q(x)}+\sqrt{q(y)}\geq \sqrt{q(x+y)}.$$

Demostración. Sea $b$ la forma polar de $q$. Recordemos que $$q(x+y)=q(x)+2b(x,y)+q(y).$$

Como $q$ es forma cuadrática positiva, la desigualdad que queremos mostrar es equivalente a la siguiente desigualdad obtenida de elevar ambos lados al cuadrado:

\begin{align*}

q(x)+2\sqrt{q(x)q(y)}+q(y)&\geq q(x+y)\\

&=q(x)+2b(x,y)+q(y).

\end{align*}

Cancelando $q(x)+q(y)$ de ambos lados y dividiendo entre $2$, obtenemos la desigualdad equivalente

\begin{align*}

\sqrt{q(x)q(y)}\geq b(x,y).

\end{align*}

Si $b(x,y)<0$, esta desigualdad es claramente cierta. Si $b(x,y)\geq 0$, esta desigualdad es equivalente a la obtenida de elevarla al cuadrado, es decir, $$q(x)q(y)\geq b(x,y)^2,$$ que es precisamente la desigualdad de Cauchy-Schwarz.

$\square$

De producto interior a norma

Estamos listos para mostrar algunas propiedades importantes de la noción de norma que definimos para espacios vectoriales reales con producto interior.

Proposición. Sea $V$ un espacio vectorial sobre $\mathbb{R}$ con producto interior con norma asociada $\Vert \cdot \Vert$. Se cumple que

- $\Vert v \Vert \geq 0$ para todo $v$ en $V$, con igualdad si y sólo si $v=0$.

- $\Vert cv \Vert =|c|\Vert v \Vert$ para todo $v$ en $V$ y real $c$.

- (Desigualdad del triángulo) $\Vert v \Vert + \Vert w \Vert \geq \Vert v+w \Vert$ para todo par de vectores $v$ y $w$ en $V$.

Demostración. Sea $b$ el producto interior de $V$. El punto 1 se sigue de que $b$ es positiva definida. El punto 2 se sigue de que $b$ es bilineal, pues $b(cv,cv)=c^2b(v,v)$, de modo que $$\Vert cv \Vert = \sqrt{c^2} \Vert v \Vert =|c| \Vert v \Vert.$$ El punto 3 es la desigualdad de Minkowski.

$\square$

En general, si tenemos un espacio vectorial $V$ sobre los reales y una función $\Vert \cdot \Vert:V \to \mathbb{R}$ que satisface los puntos 1 a 3 de la proposición anterior, decimos que $\Vert \cdot \Vert$ es una norma para $V$. Hay algunas normas que no se pueden obtener a través de un producto interior.

Ejemplo. Consideremos $V=M_n(\mathbb{R})$. El producto de Frobenius de las matrices $A$ y $B$ está dado por $$\langle A,B\rangle = \text{tr}(^tA B).$$ Se puede mostrar que el producto de Frobenius es un producto interior. La norma de Frobenius es la norma inducida por este producto, es decir, $$\Vert A \Vert = \sqrt{\text{tr}(^tAA)}.$$

Por la desigualdad de Minkowski, tenemos que para cualesquiera dos matrices $A$ y $B$ tenemos que $$\sqrt{\text{tr}(^t(A+B)(A+B))}\leq \sqrt{\text{tr}(^tAA)} + \sqrt{\text{tr}(^tBB)}.$$

En particular, si tomamos a la identidad $I$, tenemos que su norma de Frobenius es $\sqrt{n}$. Esto muestra la siguiente desigualdad, válida para cualquier matriz $A$ en $M_n(\mathbb{R})$:

$$\sqrt{\text{tr}((^tA+I)(A+I))}\leq \sqrt{\text{tr}(^tAA)}+ \sqrt{n}.$$

$\triangle$

De norma a distancia

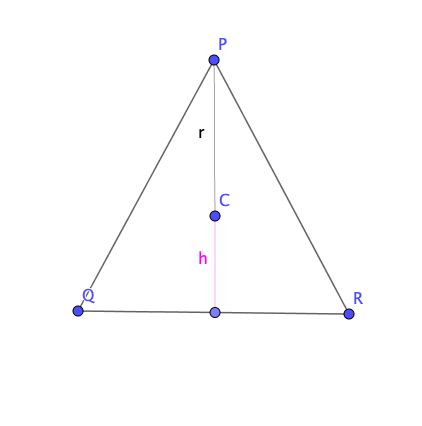

Podemos pensar a la norma de un vector $v$ como qué tan lejos está del vector $0$. También nos gustaría poder hablar de qué tan lejos están cualesquiera dos vectores de un espacio vectorial con producto interior. Por esta razón, introducimos la siguiente definición.

Definición. Sea $V$ un espacio vectorial sobre $\mathbb{R}$ con producto interior de norma $\Vert \cdot \Vert$. La distancia asociada a este producto interior es la función $d:V\times V\to \mathbb{R}$ tal que $d(x,y)=\Vert x-y\Vert.$ A $d(x,y)$ le llamamos la distancia entre $x$ y $y$.

El siguiente resultado se sigue de las propiedades de la norma de un producto interior. Su demostración queda como tarea moral.

Proposición. Si $V$ es un espacio vectorial sobre $\mathbb{R}$ con producto interior de distancia $d$, entonces:

- $d(x,y)\geq 0$ para todos $x$ y $y$ en $V$ y es igual a $0$ si y sólo si $x=y$.

- $d(x,y)=d(y,x)$ para todos $x$ y $y$ en $V$.

- $d(x,z)+d(z,y)\geq d(x,y)$ para todos $x$, $y$ y $z$ en $V$.

En general, si tenemos cualquier conjunto $X$ (no hace falta que sea un espacio vectorial), a una función $d$ que satisface los puntos 1 a 3 de la proposición anterior se le conoce como una métrica para $X$. Cualquier norma en un espacio vectorial $V$ (no sólo las de producto interior) induce una métrica en $V$. Sin embargo, hay métricas de espacios vectoriales que no vienen de una norma.

Más adelante…

Retomando conceptos ya definidos como la norma de un vector, en esta entrada vimos cómo encontrar el ángulo entre dos vectores no-nulos y se llegó a una forma natural de introducir la ortogonalidad entre dos vectores. Así mismo, se demostraron algunas propiedades de la norma asociada a un producto interior, siendo la última una forma distinta de expresar la desigualdad de Cauchy-Schwarz, usando la desigualdad de Minkowski. Finalmente, se definió el concepto de distancia entre dos vectores.

En entradas posteriores, usaremos estos conceptos para estudiar bases ortogonales, que tienen usos en conceptos matemáticos más avanzados como el análisis de Fourier o la teoría de polinomios ortogonales.

Tarea moral

A continuación hay algunos ejercicios para que practiques los conceptos vistos en esta entrada. Te será de mucha utilidad intentarlos para entender más la teoría vista.

- Toma $\mathbb{R}^4$ con el producto interior canónico (producto punto). Determina la norma de $(3,4,0,1)$. Encuentra el ángulo entre los vectores $(1,0,2,5)$ y $(4,5,0,-3)$.

- Muestra que el producto de Frobenius es un producto interior en $M_n(\mathbb{R})$.

- Demuestra la proposición de propiedades de la distancia

Considera $V=\mathbb{R}_3[x]$ el espacio vectorial de polinomios con coeficientes reales y grado a lo más $3$. Definimos $$\langle p,q \rangle = \sum_{j=1}^5 p(j)q(j).$$

- Muestra que $\langle \cdot, \cdot \rangle$ así definido es un producto interior.

- Encuentra el ángulo entre los polinomios $1+x^2$ y $2x-3x^3$.

- Para cada entero positivo $n$, determina la norma del polinomio $1+nx^3$.

- Determina la distancia entre los polinomios $1$ y $1+x+x^2+x^3$.

Entradas relacionadas

- Ir a Álgebra Lineal I

- Entrada anterior del curso: Problemas de formas cuadráticas y producto interior

- Siguiente entrada del curso: Problemas de desigualdades vectoriales

Agradecimientos

Trabajo realizado con el apoyo del Programa UNAM-DGAPA-PAPIME PE104721 «Hacia una modalidad a distancia de la Licenciatura en Matemáticas de la FC-UNAM»