Comentario de Leo: Esta es una escrita en conjunto con por Alexandher Vergara, estudiante en ESFM. En ella hablamos del teorema de navidad de Fermat, una idea de la prueba y de las consecuencias. Si quieres contribuir con algún tema de matemáticas, puedes contactarme por correo electrónico, o dejando un comentario aquí en el blog.

Introducción

En entradas anteriores hemos visto temas de teoría de números, como divisibilidad y teoría de congruencias. También hablamos acerca de números primos y del teorema fundamental de la aritmética. A continuación probaremos una parte del famoso «teorema de navidad de Fermat», el cual dice cuáles primos impares son la suma de dos cuadrados.

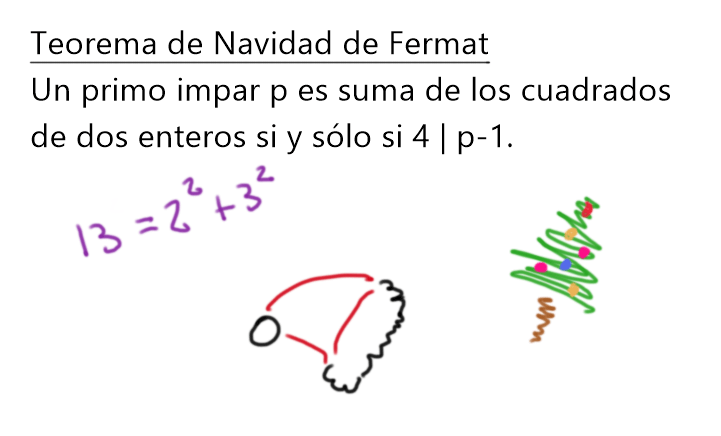

Teorema (teorema de Navidad de Fermat). Un número primo $p>2$ es la suma del cuadrado de dos enteros si y sólo si $p\equiv 1 \pmod 4$.

El teorema recibe este nombre pues Fermat escribió una carta con muchos detalles acerca del resultado para Mersenne, cuya fecha fue el 25 de diciembre de 1640.

Este resultado nos lleva un paso más adelante en teoría de números. Por un lado, tiene «el mismo sabor» que el teorema de los cuatro cuadrados de Lagrange.

Teorema (teorema de los cuatro cuadrados de Lagrange). Todo entero no negativo puede ser escrito como suma de los cuadrados de cuatro números enteros.

Por otro lado, el teorema de Navidad de Fermat también nos ayuda a demostrar un caso particular del teorema de Dirichlet para primos sobre progresiones aritméticas.

Teorema 1. Hay infinitos números primos de la forma $4k+1$ e infinitos números de la forma $4k+3$.

El teorema de Dirichlet es una generalización de este resultado.

Teorema (teorema de Dirichlet). Si $a$ y $b$ son primos relativos, entonces existe una infinidad de primos $p$ tales que $p\equiv a \pmod b$.

Las demostraciones de los teoremas de Lagrange y de Dirichlet requieren de varios argumentos para los cuales aún no hemos desarrollado teoría suficiente. La idea de esta entrada de blog es demostrar el teorema de Navidad de Fermat y usarlo para demostrar el Teorema 1.

El teorema de Navidad de Fermat

En la demostración del teorema de navidad de Fermat usaremos el siguiente resultado.

Teorema 2. Si $p$ es un número primo y la ecuación $a^2+1 \equiv 0 \pmod p$ tiene solución para algún $a$, entonces $p$ se puede representar como una suma de dos cuadrados.

Por el momento, no nos enfocaremos en demostrar este resultado auxiliar. Existen muchas pruebas en la literatura, por ejemplo, una por J.H. Grace usando latices de enteros (The four square theorem).

Demostración del teorema de Navidad de Fermat. Supongamos primero que $p=x^2+y^2$ para enteros no negativos $x,y$. El hecho de que $p \equiv 1 \pmod 4$ se desprende de dos propiedades del anillo $\mathbb{Z}_4$. Notemos primero que cualquier entero impar es congruente con $1 \pmod 4$ o con $3\pmod 4$. Además, cualquier cuadrado es congruente con $0 \pmod 4$ o $1\pmod 4$, pues si $x$ es congruente con $0,1,2,3 \pmod 4$ entonces $x^2$ es congruente con $0,1,0,1 \pmod 4$, respectivamente. Como $p=x^2+y^2$, sabemos entonces que $$p\equiv x^2+y^2=0,1 \text{ \’o } 2 \pmod 4.$$ Pero $p$ es un primo mayor que $2$, entonces $p$ es impar. Así, $p\equiv 1 \pmod 4$.

Observación. En esta parte de la prueba en realidad es un poco más general, pues muestra que si $n$ es un entero impar que se puede representar como suma de dos cuadrados, entonces $n\equiv 1 \pmod 4$.

Supongamos ahora que $p\equiv 1 \pmod 4$. Lo primero que haremos es mostrar que $a^2+1\equiv 0 \pmod p$ tiene solución para alguna $a$, y después usaremos el Teorema 2 para obtener que $p$ es suma de dos cuadrados.

Primero, examinaremos los factores en $$(p-1)!=1\cdot 2 \cdot \ldots \cdot \frac{p-1}{2} \cdot \frac{p+1}{2}\cdot \ldots \cdot (p-2) \cdot (p-1).$$ A los últimos $(p-1)/2$ factores los pensamos como sigue: $p-1\equiv -1 \pmod p$, $p-2\equiv -2\pmod p$, …, $\frac{p+1}{2}\equiv -\frac{p-1}{2} \pmod p$. El factorial se convierte entonces en

\begin{align*}

(p-1)!&\equiv 1\cdot \ldots \cdot \left(\frac{p-1}{2}\right) \cdot \left(-\frac{p-1}{2}\right) \cdot \ldots \cdot (-1)\\

&\equiv (-1)^{(p-1)/2} \left(1\cdot \ldots \cdot \frac{p-1}{2}\right)^2 \pmod p.

\end{align*}

Definiendo $a= 1\cdot \ldots \cdot \frac{p-1}{2}$, lo anterior se puede escribir como $$(p-1)!\equiv (-1)^{(p-1)/2} a^2 \pmod p.$$

Por el teorema de Wilson, $(p-1)!\equiv -1 \pmod p$. Como $p\equiv 1 \pmod 4$, tenemos $p=4k+1$ para algún entero $k$. Entonces, $(p-1)/2=2k$, que es par, de modo que $(-1)^{(p-1)/2}=1$. De esta forma, tenemos que $$-1\equiv a^2 \pmod p.$$ Sumando $1$ de ambos lados, tenemos que $a^2+1\equiv 0 \pmod p$. Aplicando el Teorema 2, concluimos que $p$ es suma de dos cuadrados.

$\square$

Infinidad de primos de las formas $4k+1$ y $4k+3$

Todos los primos mayores que $2$ son impares, así que son o bien de la forma $4k+1$, o bien de la forma $4k+3$. Sabemos además que hay una infinidad de números primos. ¿Será cierto que hay una infinidad de ellos de la forma $4k+1$ y una infinidad de ellos de la forma $4k+3$?

Por el principio de las casillas, tiene que suceder por lo menos alguna de estas dos opciones. Si hubiera una cantidad finita de la forma $4k+1$ y de la forma $4k+3$, entonces por el párrafo anterior habría sólo una cantidad finita de primos, lo cual es una contradicción.

Lo que dice el Teorema 1 es más fuerte. Lo volvemos a poner aquí por conveniencia para el lector.

Teorema 1. Hay infinitos números primos de la forma $4k+1$ e infinitos números de la forma $4k+3$.

Es decir, el Teorema 1 afirma que para cada uno de los tipos hay una infinidad de primos. Veamos que en efecto esto sucede.

La primera parte del Teorema 1 no necesita que usemos el teorema de Navidad de Fermat.

Proposición 1. Hay una infinidad de primos de la forma $4k+3$.

Demostración. Supongamos que existiera únicamente una cantidad finita $n$ de primos de la forma $4k+3$ y supongamos que ellos son $p_1<\ldots<p_n$, en donde $p_1=3$. Consideremos el número $N=4p_2p_3\ldots p_n +3$ (ojo: no estamos incluyendo al $3$ en la multiplicación). Este número no puede ser primo pues es mayor que $p_n$ y $N\equiv 3\pmod 4$. De esta forma, debe tener al menos un divisor primo.

Tenemos que $N$ es impar, así que $2$ no divide a $N$. Si todos los divisores primos de $N$ fueran $1\pmod 4$, entonces $N$ sería $1\pmod 4$, pero esto no es cierto. De este modo, algún divisor primo $p$ de $N$ debe satisfacer $p\equiv 3 \pmod 4$. Notemos que $p$ no puede ser $3$, pues si $3\mid N$, tendríamos $3\mid 4p_1 \ldots p_n$, pero esto es imposible pues el número de la derecha no tiene ningún factor $3$. Con esto concluimos que $p=p_i$ para algún entero $i=2,\ldots,n$. Sin embargo, si $p_i\mid N$, entonces $p_i\mid N-(p_2\ldots p_n)=3$. Esto también es imposible pues $p_i\neq 3$. Así, es inevitable llegar a una contradicción, por lo que hay una infinidad de primos de la forma $4k+3$.

$\square$

La demostración anterior no funciona directamente para los primos de la forma $4k+1$, pues si hubiera una cantidad finita $n$ de ellos $p_1<\ldots < p_n$ y consideramos al número $4p_1\ldots p_n+1$, este número es congruente con $1\pmod 4$, pero nada garantiza que sus factores primos deban ser de la forma $1\pmod 4$ pues, por ejemplo, $3\equiv 3\pmod 4$, $7\equiv 3\pmod 4$, pero $3\cdot 7 \equiv 21 \equiv 1\pmod 4$. Tenemos que hacer algo distinto.

Proposición 2. Hay una infinidad de primos de la forma $4k+1$.

Demostración. Supongamos que existe una cantidad finita $n$ de primos de la forma $4k+1$ y que son $p_1<\ldots<p_n$. Consideremos al número $N=4(p_1p_2\ldots p_n)^2 +1$. Este número es de la forma $4k+1$. Por esta razón, es imposible que $N$ sea primo, pues es mayor que todo $p_i$.

Sea $p$ un divisor primo de $N$. Como $N$ es impar, $p\neq 2$. Como $p$ divide a $N$, tenemos que $(2p_1\ldots p_n)^2+1\equiv 0 \pmod p$, de modo que $x^2+1\equiv 0 \pmod p$ tiene solución y por el Teorema 2, $p$ se puede escribir como suma de dos cuadrados. Por el teorema de Navidad de Fermat, $p\equiv 1\pmod 4$. De esta forma, $p=p_i$ para alguna $i$. Pero entonces, $p$ divide a $N$ y a $4(p_1\ldots p_n)^2$, de modo que divide a su resta, que es $1$. Esto es imposible. Esta contradicción muestra que hay una cantidad infinita de primos de la forma $4k+1$.

$\square$

El Teorema 1 se sigue de las proposiciones 1 y 2.

¿Dónde seguir?

Aquí en el blog hay otras entradas en donde hablamos acerca de teoría de números. Puedes revisar las siguientes:

- Divisibilidad y máximo común divisor

- Aritmética modular

- Bases numéricas y dígitos

- Teoremas de Wilson y Fermat

- Primos y factorización única

- Teorema chino del residuo

- Ecuaciones diofantinas