En las matemáticas el arte de proponer una pregunta

debe tener un valor más alto que resolverlo.

– Georg Cantor

Introducción

En la entrada anterior resolvimos 3 de las ecuaciones diferenciales especiales que deseamos resolver, en esta entrada concluiremos con el resto de ecuaciones.

Recordemos que las ecuaciones diferenciales especiales que deseamos resolver son:

$$\dfrac{d^{2}y}{dx^{2}} -2x \dfrac{dy}{dx} + \lambda y = 0$$

$$x \dfrac{d^{2}y}{dx^{2}} + (1 -x) \dfrac{dy}{dx} + \lambda y = 0$$

$$(1 -x^{2}) \dfrac{d^{2}y}{dx^{2}} -2x \dfrac{dy}{dx} + \lambda(\lambda + 1) y = 0$$

$$x^{2} \dfrac{d^{2}y}{dx^{2}} + x \dfrac{dy}{dx} + (x^{2} -\lambda^{2}) y = 0$$

$$(1 -x^{2}) \dfrac{d^{2}y}{dx^{2}} -x \dfrac{dy}{dx} + \lambda^{2} y = 0$$

- Ecuación Hipergeométrica de Gauss.

$$x(1 -x) \dfrac{d^{2}y}{dx^{2}} + [\gamma -(\alpha + \beta + 1)x] \dfrac{dy}{dx} -\alpha \beta y = 0$$

$$\dfrac{d^{2}y}{dx^{2}} -xy = 0$$

Resolvamos ahora la ecuación de Bessel.

Ecuación de Bessel

La ecuación de Bessel es

$$x^{2} \dfrac{d^{2}y}{dx^{2}} + x \dfrac{dy}{dx} + (x^{2} -\lambda^{2}) y = 0 \label{1} \tag{1}$$

Con $\lambda \in \mathbb{R}$. La ecuación de Bessel es una ecuación diferencial de segundo orden, pero suele denominarse de orden $\lambda$.

Friedrich Wilhelm Bessel (1784-1846) fue un matemático y astrónomo alemán conocido por generalizar las llamadas funciones de Bessel, éstas funciones son soluciones canónicas de la ecuación de Bessel. Las funciones de Bessel fueron definidas primero por el matemático Daniel Bernoulli. Como astrónomo Bessel fue el primero en determinar el paralaje de una estrella, publicando en 1838 los datos que había calculado de 61 Cygni.

Resolvamos la ecuación. Dividamos todo por $x^{2}$ para obtener la forma estándar.

$$\dfrac{d^{2}y}{dx^{2}} + \dfrac{1}{x} \dfrac{dy}{dx} + \dfrac{(x^{2} -\lambda^{2})}{x^{2}} y = 0 \label{2} \tag{2}$$

Identificamos que

$$P(x) = \dfrac{1}{x} \hspace{1cm} y \hspace{1cm} Q(x) = \dfrac{(x^{2} -\lambda^{2})}{x^{2}}$$

Es claro que ambas funciones no están definidas en $x = 0$, de manera que este punto es un punto singular. Definiendo las funciones $p(x)$ y $q(x)$ se obtiene que

$$p(x) = 1 \hspace{1cm} y \hspace{1cm} q(x) = x^{2} -\lambda^{2}$$

Los límites son

$$\lim_{x \to 0}p(x) = 1 \hspace{1cm} y \hspace{1cm} \lim_{x \to 0}q(x) = -\lambda^{2}$$

Los límites existen, esto nos indica que el punto $x_{0} = 0$ es un punto singular regular. La solución para este caso es de la forma

$$y(x) = \sum_{n = 0}^{\infty}c_{n}x^{n + r} \label{3} \tag{3}$$

Las derivadas son

$$\dfrac{dy}{dx} = \sum_{n = 0}^{\infty}(n + r)c_{n}x^{n + r -1} \hspace{1cm} y \hspace{1cm} \dfrac{d^{2}y}{dx^{2}} = \sum_{n = 0}^{\infty}(n + r)(n + r -1)c_{n}x^{n + r -2} \label{4} \tag{4}$$

Sustituyamos en la ecuación de Bessel.

$$x^{2} \left[ \sum_{n = 0}^{\infty}(n + r)(n + r -1)c_{n}x^{n + r -2} \right] + x \left[ \sum_{n = 0}^{\infty}(n + r)c_{n}x^{n + r -1} \right] + (x^{2} -\lambda^{2}) \left[ \sum_{n = 0}^{\infty}c_{n}x^{n + r} \right] = 0$$

Expandiendo y simplificando, se tiene

$$\sum_{n = 0}^{\infty}(n + r)(n + r -1)c_{n}x^{n + r} + \sum_{n = 0}^{\infty}(n + r)c_{n}x^{n + r} + \sum_{n = 0}^{\infty}c_{n}x^{n + r + 2} -\lambda^{2}\sum_{n = 0}^{\infty}c_{n}x^{n + r} = 0$$

En la tercer serie hacemos la sustitución $n = k -2$ y en el resto hacemos $k = n$.

$$\sum_{k = 0}^{\infty}(k + r)(k + r -1)c_{k}x^{k + r} + \sum_{k = 0}^{\infty}(k + r)c_{k}x^{k + r} + \sum_{k = 2}^{\infty}c_{k -2}x^{k + r} -\lambda^{2}\sum_{k = 0}^{\infty}c_{k}x^{k + r} = 0$$

Necesitamos extraer los términos para $k = 0$ y $k = 1$ y así hacer que todas las series comiencen en $k = 2$.

Para $k = 0$ obtenemos la ecuación indicial.

\begin{align*}

r(r -1)c_{0}x^{r} + rc_{0}x^{r} -\lambda^{2}c_{0}x^{r} &= 0 \\

c_{0}x^{r}[r(r -1) + r -\lambda^{2}] &= 0 \\

r(r -1) + r -\lambda^{2} &= 0

\end{align*}

La ecuación indicial es

$$r^{2} -\lambda^{2} = 0 \label{5} \tag{5}$$

Las raíces son $r_{1} = \lambda$ y $r_{2} = -\lambda$.

Para $k = 1$, se obtiene

\begin{align*}

(r + 1)rc_{1}x^{r + 1} + (r + 1)c_{1}x^{r + 1} -\lambda^{2}c_{1}x^{r + 1} &= 0 \\

c_{1}x^{r + 1}[(r + 1)r + (r + 1) -\lambda^{2}] &= 0 \\

\end{align*}

Como lo que esta entre corchetes no se anula para las raíces de la ecuación indicial, entonces debe ser que $c_{1} = 0$.

Ahora tenemos la ecuación

$$\sum_{k = 2}^{\infty}(k + r)(k + r -1)c_{k}x^{k + r} + \sum_{k = 2}^{\infty}(k + r)c_{k}x^{k + r} + \sum_{k = 2}^{\infty}c_{k -2}x^{k + r} -\lambda^{2}\sum_{k = 2}^{\infty}c_{k}x^{k + r} = 0 \label{6} \tag{6}$$

Reescribiendo todo en una serie, se tiene

$$\sum_{k = 2}^{\infty} [(k + r)(k + r -1)c_{k} + (k + r)c_{k} + c_{k -2} -\lambda^{2}c_{k}] x^{k + r} = 0$$

De donde,

$$c_{k}[(k + r)(k + r -1) + (k + r) -\lambda^{2}] + c_{k -2} = 0 \label{7} \tag{7}$$

Despejando a $c_{k}$ obtenemos la relación de recurrencia.

$$c_{k} = \dfrac{c_{k -2}}{\lambda^{2} -(r + k)^{2}}, \hspace{1cm} k = 2, 3, 4, \cdots \label{8} \tag{8}$$

Para el caso en el que $r = \lambda$, la relación de recurrencia es

$$c_{k} = -\dfrac{c_{k -2}}{k(k + 2\lambda)}, \hspace{1cm} k = 2, 3, 4, \cdots \label{9} \tag{9}$$

Determinemos los coeficientes para este caso.

$k = 2$.

$$c_{2} = -\dfrac{c_{0}}{2(2 + 2\lambda)} = -\dfrac{1}{4(1 + \lambda)}c_{0}$$

$k = 3$.

$$c_{3} = \dfrac{c_{1}}{3(3 + 2\lambda)}$$

Pero $c_{1} = 0$, entonces $c_{3} = 0$. En general, $c_{1} = c_{3} = c_{5} = \cdots = 0$.

Para $k = 4$, se tiene

$$c_{4} = -\dfrac{c_{2}}{4(4 + 2\lambda)} = \dfrac{1}{(4)(8)(1 + \lambda)(2 + \lambda)}c_{0}$$

$k = 6$.

$$c_{6} = -\dfrac{c_{4}}{6(6 + 2\lambda)} = -\dfrac{1}{(4)(8)(12)(1 + \lambda)(2 + \lambda)(3 + \lambda)}c_{0}$$

En general,

$$c_{2k} = \dfrac{(-1)^{k}}{2^{2k}k!(1 + \lambda)(2 + \lambda)(3 + \lambda) \cdots (k + \lambda)}c_{0} \label{10} \tag{10}$$

Entonces la primer solución de la ecuación de Bessel es

$$\hat{y}(x) = c_{0}y_{1}(x) \label{11} \tag{11}$$

Con

\begin{align*}

y_{1}(x) &= 1 -\dfrac{1}{4(1 + \lambda)}x^{2} + \dfrac{1}{(4)(8)(1 + \lambda)(2 + \lambda)}x^{4} -\dfrac{1}{(4)(8)(12)(1 + \lambda)(2 + \lambda)(3 + \lambda)}x^{6} + \cdots \\

&\cdots + (-1)^{k} \dfrac{1}{2^{2k}k!(1 + \lambda)(2 + \lambda)(3 + \lambda) \cdots (k + \lambda)}x^{2k + \lambda} + \cdots \label{12} \tag{12}

\end{align*}

No obtendremos la segunda solución para $r = -\lambda$, pero si que aún podemos decir más de la primer solución y con ello conocer la forma de la segunda solución.

Definamos la función Gamma y apoyémonos de ella.

Definición: La función Gamma se define como

$$\Gamma(x) = \int_{0}^{\infty}t^{x -1}e^{-t} dt \label{13} \tag{13}$$

La convergencia de la integral requiere que $x -1 > -1$, o bien, $x > 0$.

La función Gamma posee la propiedad conveniente de que

$$\Gamma (1 + x) = x \Gamma(x) \label{14} \tag{14}$$

Debido a esta propiedad es que al valor arbitrario $c_{0}$ de la solución de la ecuación de Bessel se le suele atribuir el valor

$$c_{0} = \dfrac{1}{2^{\lambda} \Gamma(1 + \lambda)} \label{15} \tag{15}$$

Como

\begin{align*}

\Gamma (1 + \lambda + 1) &= (1 + \lambda)\Gamma(1 + \lambda) \\

\Gamma (1 + \lambda + 2) &= (2 + \lambda)\Gamma(2 + \lambda) = (2 + \lambda)(1 + \lambda)\Gamma(1 + \lambda) \\

&\vdots \\

\Gamma(1 + \lambda + k) &= (1 + \lambda)(2 + \lambda) \cdots (k + \lambda)\Gamma (1 + \lambda)

\end{align*}

Entonces el coeficiente $c_{2k}$ dado en (\ref{10}) se puede escribir como

\begin{align*}

c_{2k} &= \left( \dfrac{1}{2^{\lambda} \Gamma(1 + \lambda)} \right) \left( \dfrac{(-1)^{k}}{2^{2k}k!(1 + \lambda)(2 + \lambda)(3 + \lambda) \cdots (k + \lambda)} \right) \\

&= \dfrac{(-1)^{k}}{2^{2k + \lambda}k!(1 + \lambda)(2 + \lambda) \cdots (k + \lambda)\Gamma(1 + \lambda)} \\

&= \dfrac{(-1)^{k}}{2^{2k + \lambda}k!\Gamma(1 + \lambda + k)}

\end{align*}

Para $k = 0, 1, 2, 3, \cdots$. Usando esta forma de los coeficientes, la solución de la ecuación de Bessel para $r = \lambda$ se puede escribir de la siguiente manera, usualmente denotada por $J_{\lambda}(x)$.

$$J_{\lambda}(x) = \sum_{n = 0}^{\infty}\dfrac{(-1)^{n}}{n!\Gamma(1 + \lambda + n)} \left( \dfrac{x}{2} \right)^{2n + \lambda} \label{16} \tag{16}$$

Si $\lambda \geq 0$, la serie converge al menos en el intervalo $[0, \infty)$.

De tarea moral demuestra que para $r = -\lambda$ la segunda solución de la ecuación de Bessel es

$$J_{-\lambda}(x) = \sum_{n = 0}^{\infty}\dfrac{(-1)^{n}}{n!\Gamma(1 -\lambda + n)} \left( \dfrac{x}{2} \right)^{2n -\lambda} \label{17} \tag{17}$$

Por lo tanto, la solución general de la ecuación de Bessel es

$$y(x) = C_{1} J_{\lambda}(x) + C_{2} J_{-\lambda}(x) \label{18} \tag{18}$$

Las funciones $J_{\lambda}(x)$ y $J_{-\lambda}(x)$ se llaman funciones de Bessel de primera clase de orden $\lambda$ y $-\lambda$, respectivamente.

Dependiendo del valor de $\lambda$ la solución puede contener potencias negativas de $x$ y, por tanto, converger en $(0, \infty)$.

Debemos tener cuidado con la solución general (\ref{18}).

- Si $\lambda = 0$ es claro que las soluciones (\ref{16}) y (\ref{17}) son las mismas.

- Si $\lambda > 0$ y $r_{1} -r_{2} = \lambda -(-\lambda) = 2\lambda$ no es un entero positivo, entonces (\ref{16}) y (\ref{17}) son linealmente independientes y (\ref{18}) es la solución general, pero

- Si $r_{1} -r_{2} = 2\lambda$ es un entero positivo podría existir una segunda solución en serie y entonces las soluciones (\ref{16}) y (\ref{17}) no son linealmente independientes, lo que significa que (\ref{18}) no es la solución general.

Observamos que $2\lambda$ es entero positivo si $\lambda$ es un entero positivo, pero también lo es si $\lambda$ es la mitad de un número impar positivo, sin embargo en este último caso se puede demostrar que (\ref{16}) y (\ref{17}) si son linealmente independientes. Por lo tanto, la solución general de la ecuación de Bessel es (\ref{18}) siempre que $\lambda \neq$ entero.

Ecuación de Chebyshev

La ecuación de Chebyshev es

$$(1 -x^{2}) \dfrac{d^{2}y}{dx^{2}} -x \dfrac{dy}{dx} + \lambda^{2} y = 0 \label{19} \tag{19}$$

Con $\lambda$ una constante real (o compleja) y $|x| < 1$.

Esta ecuación lleva el nombre del matemático ruso Pafnuty Chebyshev (1821-1894) conocido por su trabajo en el área de la probabilidad y estadística.

La ecuación de Chebyshev en su forma estándar es

$$\dfrac{d^{2}y}{dx^{2}} -\dfrac{x}{1 -x^{2}} \dfrac{dy}{dx} + \dfrac{\lambda^{2}}{1 -x^{2}} y = 0 \label{20} \tag{20}$$

Identificamos que

$$P(x) = -\dfrac{x}{1 -x^{2}} \hspace{1cm} y \hspace{1cm} Q(x) = \dfrac{\lambda^{2}}{1 -x^{2}}$$

Ambas funciones no están definidas en $x = 1$ ni $x = -1$, pero si en el punto $x_{0} = 0$, entonces dicho punto es un punto ordinario y por tanto la solución es de la forma

$$y(x) = \sum_{n = 0}^{\infty}c_{n}x^{n} \label{21} \tag{21}$$

La primera y segunda derivada son

$$\dfrac{dy}{dx} = \sum_{n = 1}^{\infty}nc_{n}x^{n -1} \hspace{1cm} y \hspace{1cm} \dfrac{d^{2}y}{dx^{2}} = \sum_{n = 2}^{\infty}n(n -1)c_{n}x^{n -2} \label{22} \tag{22}$$

Sustituimos en la ecuación de Chebyshev.

$$(1 -x^{2}) \left[ \sum_{n = 2}^{\infty}n(n-1)c_{n}x^{n-2} \right] -x \left[ \sum_{n = 1}^{\infty}nc_{n}x^{n -1} \right] + \lambda^{2} \left[ \sum_{n = 0}^{\infty}c_{n}x^{n} \right] = 0$$

Expandiendo y simplificando se tiene

$$\sum_{n = 2}^{\infty}n(n -1)c_{n}x^{n -2} -\sum_{n = 2}^{\infty}n(n -1)c_{n}x^{n} -\sum_{n = 1}^{\infty}nc_{n}x^{n} + \lambda^{2} \sum_{n = 0}^{\infty}c_{n}x^{n} = 0$$

En la primer serie hacemos $k = n -2$ y en el resto $k = n$.

$$\sum_{k = 0}^{\infty}(k + 2)(k + 1)c_{k + 2}x^{k} -\sum_{k = 2}^{\infty}k(k -1)c_{k}x^{k} -\sum_{k = 1}^{\infty}kc_{k}x^{k}+\lambda^{2} \sum_{k = 0}^{\infty}c_{k}x^{k} = 0$$

Extraemos los primeros dos términos, por un lado para $k = 0$ se tiene

$$2c_{2} + \lambda^{2}c_{0} = 0$$

de donde,

$$c_{2} = -\dfrac{\lambda^{2}}{2}c_{0}$$

Por otro lado, para $k = 1$ se tiene

\begin{align*}

6c_{3}x -c_{1}x + \lambda^{2}c_{1}x &= 0 \\

[6c_{3} -c_{1} + \lambda^{2}c_{1}]x &= 0 \\

6c_{3} -c_{1} + \lambda^{2}c_{1} &= 0

\end{align*}

de donde,

$$c_{3} = \dfrac{1 -\lambda^{2}}{6}c_{1}$$

Ahora tenemos la ecuación

$$\sum_{k = 2}^{\infty}(k + 2)(k + 1)c_{k + 2}x^{k} -\sum_{k = 2}^{\infty}k(k -1)c_{k}x^{k} -\sum_{k = 2}^{\infty}kc_{k}x^{k} + \lambda^{2} \sum_{k = 2}^{\infty}c_{k}x^{k} = 0 \label{23} \tag{23}$$

Si juntamos todo en una serie, se obtiene

$$\sum_{k = 2}^{\infty} \left[ (k + 2)(k + 1)c_{k + 2} -k(k -1)c_{k} -kc_{k} + \lambda^{2}c_{k} \right]x^{k} = 0$$

De donde,

$$(k + 2)(k + 1)c_{k + 2} -[k(k -1) + k -\lambda^{2}]c_{k} = 0 \label{24} \tag{24}$$

Si despejamos a $c_{k + 2}$ obtenemos la relación de recurrencia.

$$c_{k + 2} = \dfrac{k^{2} -\lambda^{2}}{(k + 1)(k + 2)}c_{k}, \hspace{1cm} k = 0, 1, 2, 3, \cdots \label{25} \tag{25}$$

Ya vimos que para $k = 0$ se tiene

$$c_{2} = -\dfrac{\lambda^{2}}{2!}c_{0}$$

Y para $k = 1$ se obtuvo

$$c_{3} = \dfrac{1 -\lambda^{2}}{3!}c_{1}$$

Para $k = 2$, se tiene

$$c_{4} = \dfrac{2^{2} -\lambda^{2}}{(4)(3)}c_{2} = \dfrac{2^{2} -\lambda^{2}}{(4)(3)} \left( -\dfrac{\lambda^{2}}{2}c_{0} \right) = \dfrac{(2^{2} -\lambda^{2})(-\lambda^{2})}{4!}c_{0}$$

$k = 3$.

$$c_{5} = \dfrac{3^{2} -\lambda^{2}}{(5)(4)}c_{3} = \dfrac{3^{2} -\lambda^{2}}{(5)(4)} \left( \dfrac{1 -\lambda^{2}}{3!}c_{1} \right) = \dfrac{(3^{2} -\lambda^{2})(1 -\lambda^{2})}{5!}c_{1}$$

$k = 4$.

$$c_{6} = \dfrac{4^{2} -\lambda^{2}}{(6)(5)}c_{4} = \dfrac{4^{2} -\lambda^{2}}{(6)(5)} \left( \dfrac{(2^{2} -\lambda^{2})(-\lambda^{2})}{4!}c_{0} \right) = \dfrac{(4^{2} -\lambda^{2})(2^{2} -\lambda^{2})(-\lambda^{2})}{6!}c_{0}$$

Etcétera, con estos resultado podemos observar el patrón

$$c_{2k} = \dfrac{[(2k -2)^{2} -\lambda^{2}][(2k -4)^{2} -\lambda^{2}] \cdots (2^{2} -\lambda^{2})(-\lambda^{2})}{(2k)!}c_{0} \label{26} \tag{26}$$

y

$$c_{2k + 1} = \dfrac{[(2k -1)^{2} -\lambda^{2}][(2k -3)^{2}-\lambda^{2}] \cdots (3^{2} -\lambda^{2})(1 -\lambda^{2})}{(2k + 1)!}c_{1} \label{27} \tag{27}$$

Si tomamos como factores comunes a $C_{1} = c_{0}$ y $C_{2} = c_{1}$, entonces la solución general de la ecuación de Chebyshev es

$$y_{1} = C_{1}y_{1}(x) + C_{2}y_{2}(x) \label{928} \tag{28}$$

Con

\begin{align*}

y_{1}(x) &= 1 -\dfrac{\lambda^{2}}{2!}x^{2} + \dfrac{(2^{2} -\lambda^{2})(-\lambda^{2})}{4!}x^{4} + \dfrac{(4^{2} -\lambda^{2})(2^{2} -\lambda^{2})(-\lambda^{2})}{6!}x^{6} + \cdots\\

&\cdots + \dfrac{[(2k -2)^{2} -\lambda^{2}][(2k -4)^{2} -\lambda^{2}] \cdots (2^{2} -\lambda^{2})(-\lambda^{2})}{(2k)!} + \cdots \label{29} \tag{29}

\end{align*}

y

\begin{align*}

y_{2}(x) &= x + \dfrac{1 -\lambda^{2}}{3!}x^{3} + \dfrac{(3^{2} -\lambda^{2})(1 -\lambda^{2})}{5!}x^{5} + \cdots \\

&\cdots + \dfrac{[(2k -1)^{2} -\lambda^{2}][(2k -3)^{2}-\lambda^{2}] \cdots (3^{2} -\lambda^{2})(1 -\lambda^{2})}{(2k + 1)!} + \cdots \label{30} \tag{30}

\end{align*}

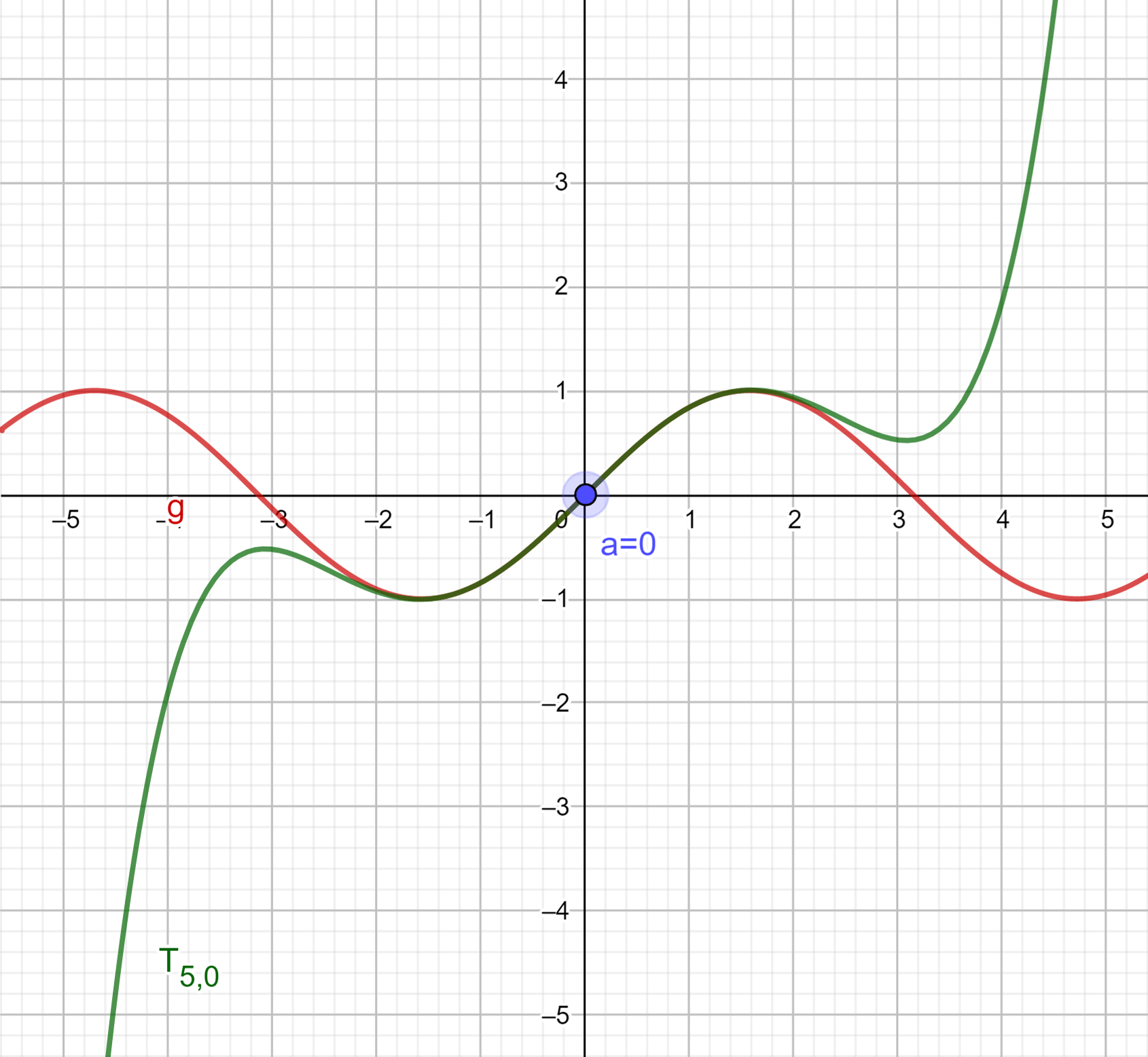

Para $\lambda = 0, 1, 2, 3, \cdots$ y con el valor adecuado de $C_{1}$ y de $C_{2}$ se obtienen los conocidos polinomios de Chebyshev.

\begin{align*}

T_{0}(x) &= 1 \\

T_{1}(x) &= x \\

T_{2}(x) &= 2x^{2} -1 \\

T_{3}(x) &= 4x^{3} -3x \\

T_{4}(x) &= 8x^{4} -8x^{2} + 1 \\

T_{5}(x) &= 16x^{5} -20x^{3} + 5x \\

\vdots

\end{align*}

En general, el $n$-ésimo polinomio de Chebyshev será solución particular de la ecuación de Chebyshev cuando $\lambda = n$.

Ecuación Hipergeométrica de Gauss

La ecuación Hipergeométrica es

$$x(1 -x) \dfrac{d^{2}y}{dx^{2}} + [\gamma -(\alpha + \beta + 1)x] \dfrac{dy}{dx} -\alpha \beta y = 0 \label{31} \tag{31}$$

Con $\alpha$, $\beta$ y $\gamma$ constantes.

La ecuación hipergeométrica en su forma estándar es

$$\dfrac{d^{2}y}{dx^{2}} + \dfrac{\gamma -(\alpha + \beta +1)x}{x(1 -x)} \dfrac{dy}{dx} -\dfrac{\alpha \beta}{x(1 -x)}y = 0 \label{32} \tag{32}$$

Identificamos que

$$P(x) = \dfrac{\gamma -(\alpha + \beta +1)x}{x(1 -x)} \hspace{1cm} y \hspace{1cm} Q(x) = -\dfrac{\alpha \beta}{x(1 -x)}$$

Ambas funciones no están definidas es $x = 1$ ni $x = 0$ eso significa que ambos puntos son singulares, sin embargo nosotros estamos interesados en resolver la ecuación con respecto al punto $x_{0} = 0$, definamos las funciones $p(x)$ y $q(x)$ con respecto a dicho punto.

$$p(x) = \dfrac{\gamma -(\alpha +\beta +1)x}{1 -x} \hspace{1cm} y \hspace{1cm} q(x) = -\dfrac{\alpha \beta x}{1 -x}$$

Ambas funciones son analíticas en $x = 0$ y los límites existen.

$$\lim_{x \to 0}p(x) = \gamma \hspace{1cm} y \hspace{1cm} \lim_{x \to 0}q(x) = 0$$

Por lo tanto, $x_{0} = 0$ es un punto singular regular y la solución para este caso es de la forma

$$y(x) = \sum_{n = 0}^{\infty}c_{n}x^{n + r}$$

Las derivadas son

$$\dfrac{dy}{dx} = \sum_{n = 0}^{\infty}(n + r)c_{n}x^{n + r -1} \hspace{1cm} y \hspace{1cm} \dfrac{d^{2}y}{dx^{2}} = \sum_{n = 0}^{\infty}(n + r)(n + r -1)c_{n}x^{n + r -2}$$

Sustituimos en la ecuación hipergeométrica.

$$x(1 -x) \left[ \sum_{n = 0}^{\infty}(n + r)(n + r -1)c_{n}x^{n + r -2} \right] + [\gamma -(\alpha + \beta + 1)x] \left[ \sum_{n = 0}^{\infty}(n + r)c_{n}x^{n + r -1} \right] -\alpha \beta \left[ \sum_{n = 0}^{\infty}c_{n}x^{n + r} \right] = 0$$

Expandiendo la expresión se tiene

\begin{align*}

&x \sum_{n = 0}^{\infty}(n + r)(n + r -1)c_{n}x^{n + r -2} -x^{2} \sum_{n = 0}^{\infty}(n + r)(n + r -1)c_{n}x^{n + r -2} + \gamma \sum_{n = 0}^{\infty}(n + r)c_{n}x^{n + r -1} \\

&-(\alpha + \beta + 1)x \sum_{n = 0}^{\infty}(n + r)c_{n}x^{n + r -1} -\alpha \beta \sum_{n = 0}^{\infty}c_{n}x^{n + r} = 0

\end{align*}

Simplificamos

\begin{align*}

&\sum_{n = 0}^{\infty}(n + r)(n + r -1)c_{n}x^{n + r -1} -\sum_{n = 0}^{\infty}(n + r)(n + r -1)c_{n}x^{n + r} + \gamma \sum_{n = 0}^{\infty}(n + r)c_{n}x^{n + r -1} \\

&-(\alpha + \beta + 1) \sum_{n = 0}^{\infty}(n + r)c_{n}x^{n + r} -\alpha \beta \sum_{n = 0}^{\infty}c_{n}x^{n + r} = 0

\end{align*}

En la primera y tercera serie hacemos $k = n$ y en el resto hacemos $n = k -1$.

\begin{align*}

&\sum_{k = 0}^{\infty}(k + r)(k + r -1)c_{k}x^{k + r -1} -\sum_{k = 1}^{\infty}(k + r -1)(k + r -2)c_{k -1}x^{k + r -1} + \gamma \sum_{k = 0}^{\infty}(k + r)c_{k}x^{k + r -1} \\

&-(\alpha + \beta + 1) \sum_{k = 1}^{\infty}(k + r -1)c_{k -1}x^{k + r -1} -\alpha \beta \sum_{k = 1}^{\infty}c_{k -1}x^{k + r -1} = 0

\end{align*}

Para $k = 0$ obtenemos la ecuación indicial.

\begin{align*}

r(r -1)c_{0}x^{r -1} + \gamma r c_{0}x^{r-1} &= 0 \\

[r(r -1) + \gamma r]c_{0}x^{r -1} &= 0 \\

r(r -1) + \gamma r &= 0

\end{align*}

La ecuación indicial es

$$r(r + \gamma -1) = 0 \label{33} \tag{33}$$

Las raíces son $r_{1} = 0$ y $r_{2} = 1 -\gamma$. Ahora tenemos la ecuación

\begin{align*}

&\sum_{k = 1}^{\infty}(k + r)(k + r -1)c_{k}x^{k + r -1} -\sum_{k = 1}^{\infty}(k + r -1)(k + r -2)c_{k -1}x^{k + r -1} + \gamma \sum_{k = 1}^{\infty}(k + r)c_{k}x^{k + r -1} \\

&-(\alpha + \beta + 1) \sum_{k = 1}^{\infty}(k + r -1)c_{k -1}x^{k + r -1} -\alpha \beta \sum_{k = 1}^{\infty}c_{k -1}x^{k + r -1} = 0

\end{align*}

Juntemos todo en una sola serie.

$$\sum_{k = 1}^{\infty}[(k + r)(k + r -1)c_{k} -(k + r -1)(k + r -2)c_{k -1} + \gamma (k + r)c_{k} -(\alpha + \beta + 1)(k + r -1)c_{k -1} -\alpha \beta c_{k -1}]x^{k + r -1} = 0$$

De donde,

$$(k + r)(k + r -1)c_{k} -(k + r -1)(k + r -2)c_{k -1} + \gamma (k + r)c_{k} -(\alpha + \beta + 1)(k + r -1)c_{k -1} -\alpha \beta c_{k -1} = 0$$

Despejando a $c_{k}$ se obtiene la relación de recurrencia.

$$c_{k} = \dfrac{(k + r -1)(k + r -2) + (\alpha + \beta + 1)(k + r -1) + \alpha \beta}{(k + r)(k + r -1) + \gamma(k + r)}c_{k -1} \label{34} \tag{34}$$

De tarea moral demuestra que la relación de recurrencia se puede reescribir como

$$c_{k} = \dfrac{(k + r + \alpha -1)(k + r -1 + \beta)}{(k + r)(k + r + \gamma -1)}c_{k -1}, \hspace{1cm} k = 1, 2, 3, \cdots \label{35} \tag{35}$$

Para $k = 1$, tenemos

$$c_{1} = \dfrac{(r + \alpha)(r + \beta)}{(1 + r)(r + \gamma)}c_{0}$$

$k = 2$.

\begin{align*}

c_{2} &= \dfrac{(r + \alpha + 1)(r + \beta + 1)}{(2 + r)(r + \gamma + 1)}c_{1} \\

&= \dfrac{(r + \alpha + 1)(r + \beta + 1)}{(2 + r)(r + \gamma +1)} \left ( \dfrac{(r + \alpha)(r + \beta)}{(1 + r)(r + \gamma)}c_{0} \right)

\end{align*}

$k = 3$.

\begin{align*}

c_{3} &= \dfrac{(r + \alpha + 2)(r + \beta + 2)}{(3 + r)(r + \gamma + 2)}c_{2} \\

&= \left( \dfrac{(r + \alpha + 2)(r + \beta + 2)}{(3 + r)(r + \gamma + 2)} \right) \dfrac{(r + \alpha + 1)(r + \beta + 1)}{(2 + r)(r + \gamma + 1)} \left( \dfrac{(r + \alpha)(r + \beta)}{(1 + r)(r + \gamma)}c_{0} \right)

\end{align*}

Etcétera. Una forma de escribir las expresiones anteriores es usando el símbolo de Pochhammer que se define de la siguiente manera.

Definición: El símbolo de Pochhammer se define como

$$(\alpha)_{n} = \alpha(\alpha + 1)(\alpha + 2) \cdots (\alpha + n -1); \hspace{1cm} (\alpha)_{0} = 1 \label{36} \tag{36}$$ Con $n$ un entero positivo.

Una relación interesante entre el símbolo de Pochhammer y la función Gamma es

$$(x)_n = \dfrac{\Gamma(x + n)}{\Gamma(x)} \label{37} \tag{37}$$

Siempre que $x$ y $x + n$ no son enteros positivos.

Usando el símbolo de Pochhammer podemos escribir a los coeficientes como

$$c_{1} = \dfrac{(r + \alpha)(r + \beta)}{(1 + r)(r + \gamma)}c_{0}$$

$$c_{2} = \dfrac{(r + \alpha)_{2}(r + \beta )_{2}}{(1 + r)_{2}(r + \gamma)_{2}}c_{0}$$

$$c_{3} = \dfrac{(r + \alpha )_{3}(r + \beta)_{3}}{(1 + r)_{3}(r + \gamma)_{3}}c_{0}$$

Y en general,

$$c_{k} = \dfrac{(r + \alpha)_{k}(r + \beta)_{k}}{(1 + r)_{k}(r + \gamma)_{k}}c_{0} \label{38} \tag{38}$$

Por lo tanto, la solución de la ecuación hipergeométrica es

$$y(x) = c_{0}\hat{y}(x) \label{39} \tag{39}$$

Donde

\begin{align*}

\hat{y}(x) &= 1 + \dfrac{(r + \alpha)(r + \beta)}{(1 + r)(r + \gamma)}x + \dfrac{(r + \alpha)_{2}(r + \beta )_{2}}{(1 + r)_{2}(r + \gamma)_{2}}x^{2} + \dfrac{(r + \alpha )_{3}(r + \beta)_{3}}{(1 + r)_{3}(r + \gamma)_{3}}x^{3} + \cdots \\

&\cdots + \dfrac{(r + \alpha)_{k}(r + \beta)_{k}}{(1 + r)_{k}(r + \gamma)_{k}}x^{k} + \cdots \label{40} \tag{40}

\end{align*}

Hemos resuelto la ecuación hipergeométrica de manera general, pero recordemos que las raíces indiciales son $r_{1} = 0$ y $r_{2} = 1 -\gamma$, lo que significa que existen dos soluciones linealmente independientes $y_{1}(x)$ y $y_{2}(x)$, tal que la solución general es

$$y(x) = C_{1}y_{1}(x) + C_{2}y_{2}(x) \label{41} \tag{41}$$

Para el caso en el que $r = 0$ basta sustituir en (\ref{40}), a esta solución se le conoce como función hipergeométrica, se denota por $_{2}F_{1}(\alpha, \beta; \gamma; x)$ y está dada por

$$_{2}F_{1}(\alpha, \beta; \gamma; x) = \sum_{n = 0}^{\infty}\dfrac{(\alpha)_{n}(\beta)_{n}}{n!(\gamma)_{n}}x^{n} \label{42} \tag{42}$$

Donde se ha hecho uso del símbolo de Pochhammer y se requiere que $\gamma \neq 0, -1, -2, \cdots$. La serie (\ref{42}) converge en el intervalo $|x| < 1$.

De tarea moral demuestra que para el caso en el que $r = 1 -\gamma$, $\gamma \neq 2, 3, 4, \cdots$ y $|x| < 1$, la solución denotada por $_{2}F_{1}(1 -\gamma + \alpha, 1 -\gamma + \beta; 2 -\gamma; x)$, es

$$_{2}F_{1}(1 -\gamma + \alpha, 1 -\gamma + \beta; 2 -\gamma; x) = \sum_{n = 0}^{\infty}\dfrac{(1 -\gamma + \alpha)_{n}(1 -\gamma + \beta)_{n}}{n!(2 -\gamma)_{n}}x^{n} \label{43} \tag{43}$$

Considerando estos resultados, la solución general de la ecuación hipergeométrica para $|x| < 1$, es

$$y(x) = C_{1}[{_{2}F_{1}}(\alpha, \beta; \gamma; x)] + C_{2} x^{1 -\gamma} {_{2}F_{1}}(1 -\gamma + \alpha, 1 -\gamma + \beta; 2 -\gamma; x) \label{44} \tag{44}$$

Ecuación de Airy

Recordemos que cuando estudiamos el método de resolución con respecto a puntos ordinarios resolvimos como ejemplo la ecuación diferencial

$$\dfrac{d^{2}y}{dx^{2}} + xy = 0 \label{45} \tag{45}$$

Mencionamos que dicha ecuación era una forma de lo que se conoce como ecuación de Airy. Por su puesto, la ecuación

$$\dfrac{d^{2}y}{dx^{2}} -xy = 0 \label{46} \tag{46}$$

es otra forma de lo que se conoce como ecuación de Airy y dado que ya resolvimos la forma (\ref{45}) de tarea moral resuelve la forma (\ref{46}). ¿Qué diferencias notas?.

Estas ecuaciones llevan el nombre de Airy en honor al astrónomo británico George Biddell Airy (1801 – 1892).

La solución general de la ecuación de Airy (\ref{46}), es

$$y(x) = C_{1} \sum_{n = 0}^{\infty}\dfrac{1 \cdot 4 \cdots (3n -2)}{(3n)!}x^{3n} + C_{2} \sum_{n = 0}^{\infty}\dfrac{2 \cdot 5 \cdots (3n -1)}{(3n + 1)!}x^{3n + 1} \label{47} \tag{47}$$

Hemos concluido, es importante recordar que cada una de estas ecuaciones y sus soluciones tienen propiedades matemáticas muy importantes que no se revisaron debido a que quedan fuera de lo que nos corresponde en este curso, sin embargo en semestres posteriores seguramente aparecerán de nuevo y lo visto en estas dos últimas entradas será de valiosa utilidad.

Tarea moral

Los siguientes ejercicios no forman parte de la evaluación del curso, pero servirán para entender mucho mejor los conceptos vistos en esta entrada, así como temas posteriores.

- Demostrar que la segunda solución de la ecuación de Bessel para $r = -\lambda$ es

$$J_{-\lambda}(x) = \sum_{n = 0}^{\infty}\dfrac{(-1)^{n}}{n!\Gamma(1 -\lambda + n)} \left( \dfrac{x}{2} \right)^{2n -\lambda}$$ Es decir, encontrar la relación de recurrencia para $r = -\lambda$, determinar la forma de los coeficientes de la solución y determina el valor correcto que debe tener $c_{0}$ usando la función Gamma para finalmente dar con la solución que se desea.

- Investigar qué son las funciones de Bessel de segunda clase y mencionar la relación que tienen con las funciones de Bessel de primera clase.

- Los primeros 6 polinomios de Chebyshev son solución de la ecuación de Chebyshev para $\lambda = 0, 1, 2, 3, 4, 5$ respectivamente. Determinar el valor correspondiente de $C_{1}$ y $C_{2}$, tal que se obtengan los primeros 6 polinomios de Chebyshev.

- Demostrar que si $|x| < 1$, $\lambda \neq 2, 3, 4, \cdots$ y $r = 1 -\lambda$, la segunda solución de la ecuación hipergeométrica es

\begin{align*}

y_{2}(x) &= x^{r}\sum_{n = 0}^{\infty}\hat{c}_{n}x^{n} \\

&= x^{1 -\lambda}{_{2}F_{1}}(1 -\gamma + \alpha, 1 -\gamma + \beta; 2 -\gamma; x) \\

&= x^{1 -\lambda} \sum_{n = 0}^{\infty}\dfrac{(1 -\gamma + \alpha)_{n}(1 -\gamma + \beta)_{n}}{n!(2 -\gamma)_{n}}x^{n}

\end{align*}

Se puede hacer uso del resultado general (\ref{40}).

- Demostrar que la ecuación de Legendre es un caso especial de la ecuación hipergeométrica.

- Resolver la ecuación de Airy con respecto al punto ordinario $x_{0} = 0$.

$$\dfrac{d^{2}y}{dx^{2}} -xy = 0$$

Más adelante…

¡Hemos concluido con la unidad 2 del curso!.

En la siguiente unidad estudiaremos los sistemas de ecuaciones diferenciales lineales de primer orden.

Entradas relacionadas

Agradecimientos

Trabajo realizado con el apoyo del Programa UNAM-DGAPA-PAPIME PE104522 «Hacia una modalidad a distancia de la Licenciatura en Matemáticas de la FC-UNAM – Etapa 2»