Introducción

Los vectores y las matrices son algunos de los objetos matemáticos que nos encontraremos con mayor frecuencia durante nuestra formación matemática. Esto se debe a que nos permiten abordar con sencillez varios problemas de distintas áreas de las matemáticas, como lo son la geometría analítica y la teoría de gráficas. Además, nos ayudan a modelar con gran precisión fenómenos de otras disciplinas, como de la mecánica clásica, gráficos por computadora, circuitos eléctricos, robótica, entre otras.

A pesar de que el estudio a profundidad de los vectores y matrices lo realizaremos en los cursos de Álgebra Lineal I y Álgebra Lineal II, esto no es un impedimento para que nos familiaricemos con varios de los conceptos, técnicas y algoritmos que nos permitirán sacar provecho a esta maravillosa área de las matemáticas.

¿Qué son los vectores?

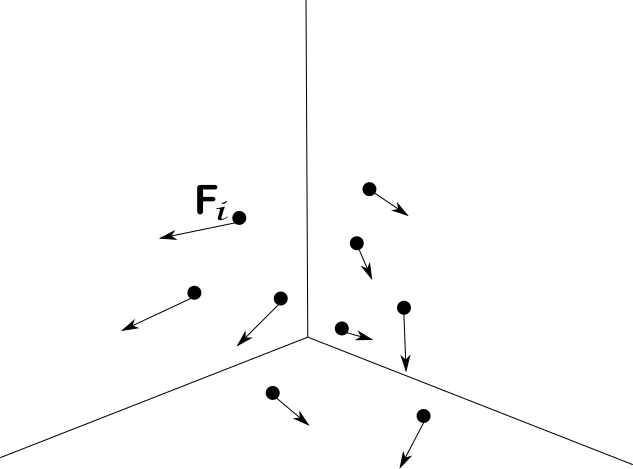

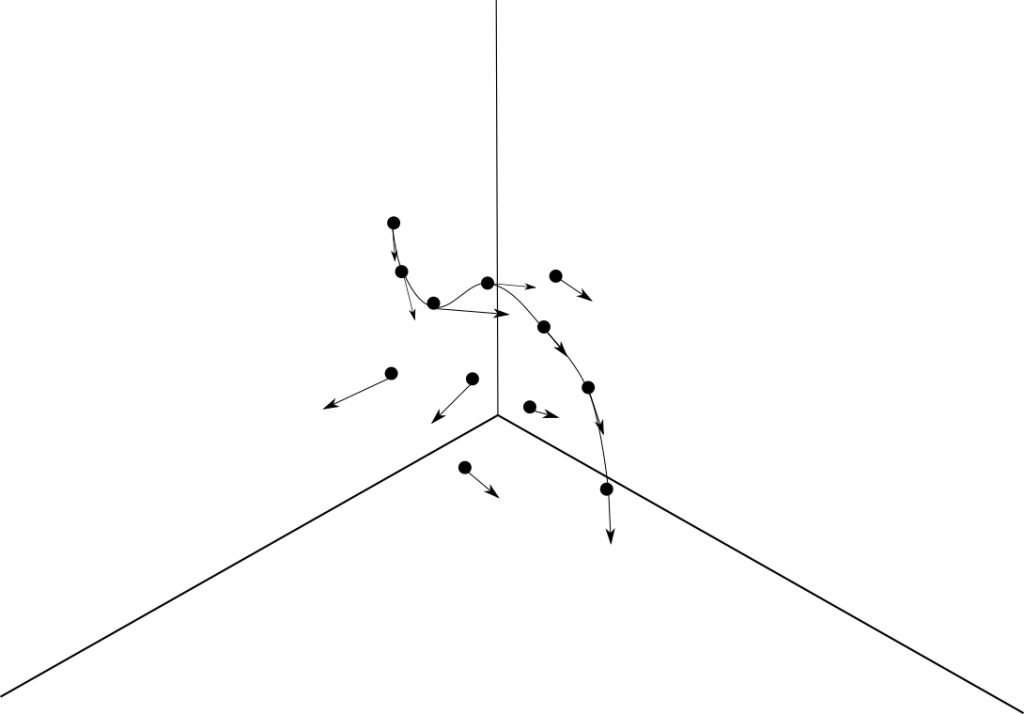

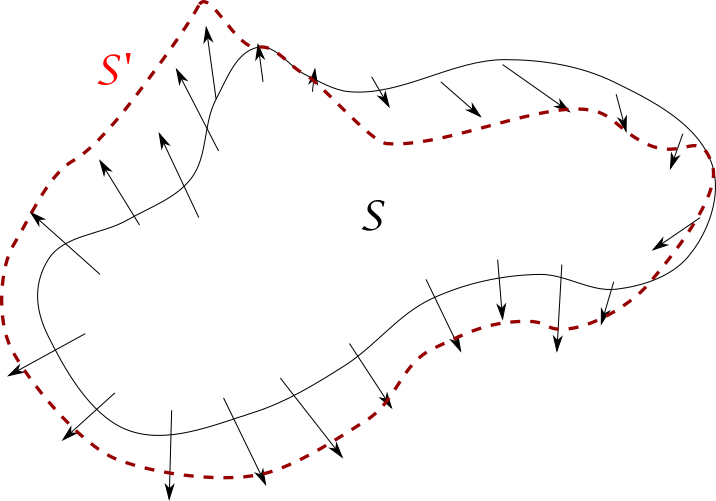

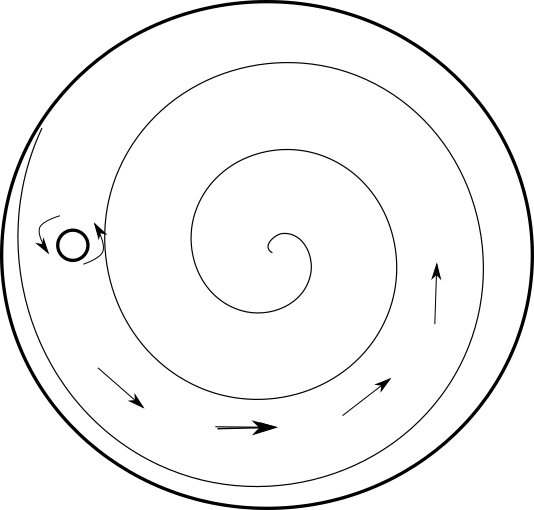

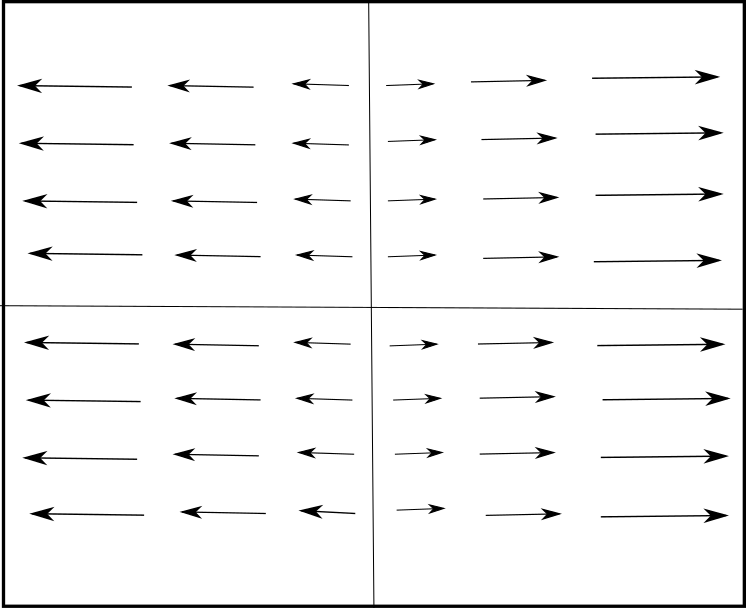

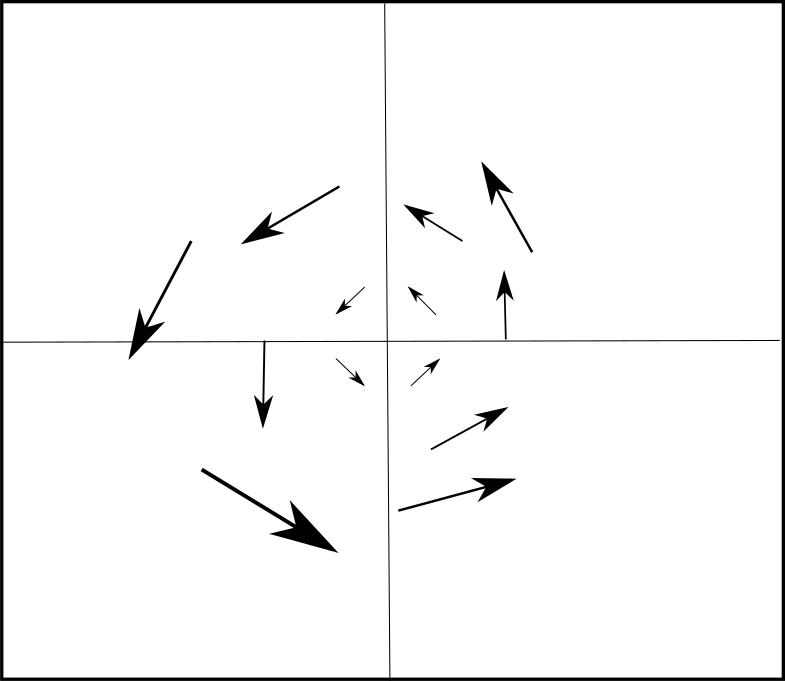

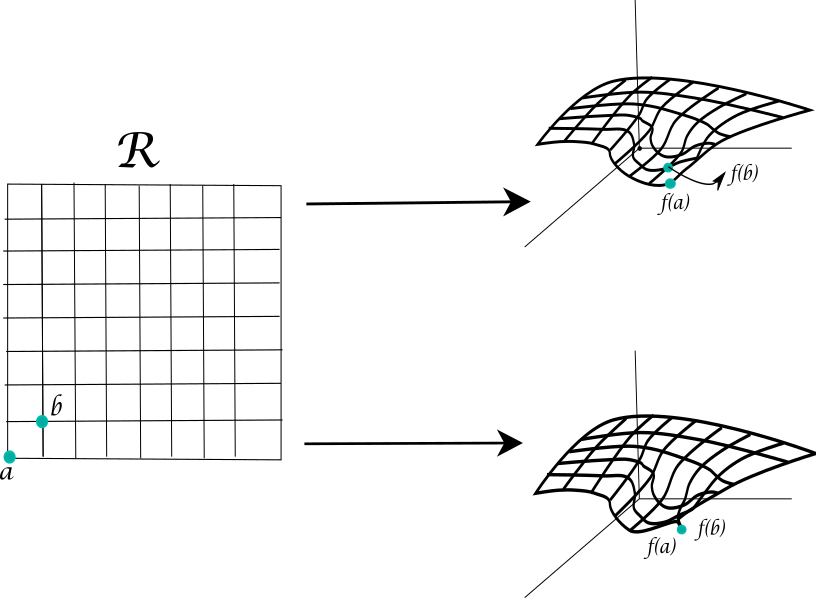

Dependiendo del área que estudiemos, nos podríamos encontrar con distintas definiciones de vectores. Por ejemplo, en la mecánica clásica se visualiza a los vectores como flechas en el plano o en el espacio, ancladas en un «origen» o en cualquier otro punto del plano. En ciencias de la computación, entenderemos que un vector consiste en un arreglo en el que todas sus entradas son datos del mismo tipo. Como veremos más adelante, las distintas formas de visualizar los vectores son equivalentes.

En este curso trabajaremos con un tipo específico de vectores: los vectores cuyas entradas son números reales. ¿Números reales? Sí. Aquí el temario de la asignatura de un brinco un poco grande. Hasta ahora, hemos intentado construir las matemáticas desde sus fundamentos: lógica, conjuntos, funciones, números naturales, etc. Sin embargo, ahora trabajaremos con el conjunto $\mathbb{R}$ de números reales.

Ya platicamos de que el conjunto de naturales $\mathbb{N}$ se puede pensar desde un sistema axiomático y que de hecho podemos «construir» a los naturales a partir de nociones de teoría de conjuntos. En el curso de Álgebra Superior 2 se platica de cómo construir al conjunto $\mathbb{Z}$ de enteros a partir de $\mathbb{N}$, al conjunto $\mathbb{Q}$ de racionales a partir de $\mathbb{Z}$ y finalmente de cómo construir a $\mathbb{R}$ desde $\mathbb{Q}$. Pero por ahora supondremos la existencia de $\mathbb{R}$ y que cumple todos los axiomas que se tratan por ejemplo en un curso de Cálculo Diferencial e Integral I.

Vectores con entradas reales

Un vector con entradas reales lo podemos entender como una lista ordenada de uno o más números (también conocida como tupla) en la que todos sus valores son números reales. Aquí «lista ordenada» lo pensamos no en el sentido de que sus entradas «van creciendo o decreciendo en orden», sino en el sentido «ordenado» como de parejas ordenadas de la segunda unidad de estas notas. Es decir, no nos importan no sólo los números usados, sino también en qué lugar quedaron.

Un ejemplo que seguramente ya has visto en tus clases de geometría analítica son los vectores en el plano o en el espacio. Recordemos que el vector $(5, \pi)$ determina una única posición en el plano, mientras que $\left(8, \sqrt{2}, \tfrac{4}{3}\right)$ determina una única posición en el espacio. Como ambas tuplas están formadas únicamente por números reales, podemos decir que son vectores con entradas reales. A cada uno de los números que aparecen en la lista le llamaremos entrada, y nos podemos referir a la posición de la entrada para decir cuál es su valor; por ejemplo, la primera entrada de $(5, \pi)$ es $5$, mientras que la tercera entrada de $\left(8, \sqrt{2}, \tfrac{4}{3}\right)$ es $\tfrac{4}{3}$.

Como recordarás, decimos que estos vectores se encuentran en $\mathbb{R}^2$ y $\mathbb{R}^3$, respectivamente. Analizando los ejemplos, te darás cuenta de que el número que acompaña a $\mathbb{R}$ se refiere a la cantidad de números reales que están enlistados en cada vector. Entonces, probablemente te preguntarás qué pasa con listas de más números. Aunque quizá sean más difíciles de visualizar (¡aunque no imposibles!), también existen vectores con cuatro, cinco o incluso más entradas. Esto nos lleva a la siguiente definición.

Definición. Para un número entero positivo $n$, un vector con $n$ entradas reales es una lista ordenada de $n$ elementos, el cual escribiremos $(x_1,x_2,\ldots,x_n)$. El conjunto $\mathbb{R}^n$ consiste de todos los vectores con $n$ entradas reales.

Así, podemos ver que tenemos que $(1,-3.5,e,1)$ es un vector en $\mathbb{R}^4$, mientras que $(1,1,2,3,5,7,13)$ es un vector en $\mathbb{R}^7$. En notación de conjuntos, $(1,-3.5,e,1)\in\mathbb{R}^4$ y $(1,1,2,3,5,7,13)\in\mathbb{R}^7$.

Una forma de empezar a ver cómo los vectores se relacionan entre ellos es preguntándonos cuándo estos son iguales. La primera condición que seguramente se nos vendrá a la mente es que los dos vectores deben tener la misma longitud; de este modo, podemos inmediatamente descartar que $(5, \pi)$ y $(8, \sqrt{2}, \tfrac{4}{3})$ sean iguales.

Otra condición que seguramente consideraremos es que todas sus entradas deben ser iguales. Así, podemos también descartar que $(5, \pi)$ y $(4, 8)$ sean iguales. Sin embargo, ¿son $(5,\pi)$ y $(\pi, 5)$ iguales? Como recordarás, los vectores son listas ordenadas, por lo que no sólo es importante que tengan las mismas entradas, sino que también aparezcan en el mismo orden. Así, podemos también descartar que $(5,\pi)$ y $(\pi, 5)$ sean iguales: basta ver con que la primera entrada del $(5,\pi)$ es $5$, mientras que la primera entrada de $(\pi,5)$ es $\pi$, y claramente $5\ne\pi$. Así mismo, $(1,5,8,1,3)$ es distinto de $(1,5,8,1,4)$ pues aunque compartan muchos elementos en varias de sus posiciones, en el primer vector la última entrada es $3$ y el el segundo la última entrada es $4$.

Definición. Diremos que dos vectores $(x_1,\ldots,x_n)$ y $(y_1,\ldots,y_n)$ de $\mathbb{R}^n$ son iguales si para toda $i=1,\ldots,n$ se tiene que $x_i=y_i$

Por otra parte, antes dijimos que los vectores tienen varias formas de ser representados. Como ejemplo de esto, podemos ver que el vector $(1,-3.5,e,1)$ puede ser representado como

\[

\begin{pmatrix}

1 \\

-3.5 \\

e \\

1

\end{pmatrix}

\qquad

\text{y}

\qquad

\begin{pmatrix}

1 & -3.5 & e & 1

\end{pmatrix}.

\]

Al formato de la izquierda se le conoce como vector vertical o vector columna, mientras que al formato de la derecha se le conoce como vector horizontal o vector fila. Dependiendo del contexto, en ocasiones nos encontraremos con estas representaciones en vez de la que mostramos inicialmente, aunque es importante recordar que siguen siendo vectores con entradas reales, pues son listas ordenadas de números reales.

Matrices con entradas reales

Otro objeto matemático en el que también se enlistan varios números reales se conoce como matriz, con la diferencia de que esta lista tiene forma de arreglo rectangular.

Definición. Una matriz con entradas reales es un arreglo rectangular en donde en cada una de sus posiciones se coloca un número real.

Por ejemplo, las siguientes son matrices con entradas reales:

\[

\begin{pmatrix}

0 & 8 & -4.5 \\

2 & 9 & 0 \\

1 & \pi & 5

\end{pmatrix},

\qquad

\begin{pmatrix}

0 & -3 & 9 & 4.25 \\

100 & 0.1 & -2 & \sqrt{2}

\end{pmatrix}.

\]

Como podrás ver, para poder identificar a una entrada de una matriz debemos de hacer referencia a dos propiedades: el número de fila y el número de columna en el que se encuentra. Las filas se cuentan de arriba hacia abajo, y las columnas de izquierda a derecha. Así, vemos que la entrada que se encuentra en la fila 3 y columna 2 de la primera matriz es $\pi$. A cada entrada le asignamos una coordenada $(i,j)$, donde $i$ es el número de fila y $j$ es el número de columna. Así, $\pi$ se encuentra en la posición $(3,2)$ de la primera matriz.

Por convención, cuando mencionamos el tamaño de una matriz, primero se especifica el número de filas y posteriormente el número de columnas. Así, la primera matriz es de tamaño $3\times 3$, mientras que la segunda es de tamaño $2 \times 4$. Ya que elegimos el tamaño de una matriz, podemos considerar a todas las matrices de ese tamaño.

Definición. El conjunto $M_{m,n}(\mathbb{R})$ consiste de todas las matrices de $m$ filas, $n$ columnas y en donde cada entrada es un número real.

En el caso de que la cantidad de filas y de columnas de la matriz sean el mismo, diremos que se trata de una matriz cuadrada. De nuestros ejemplos anteriores, la primera sí es una matriz cuadrada, pero la segunda no. Para simplificar un poco la notación, introducimos lo siguiente.

Definición. El conjunto $M_n(\mathbb{R})$ consiste de todas las matrices de $n$ filas, $n$ columnas y en donde cada entrada es un número real.

Es decir, simplemente $M_n(\mathbb{R})=M_{n,n}(\mathbb{R})$.

Al igual que pasa con los vectores, podemos comparar dos matrices para saber si estas son iguales. Como te podrás imaginar, hay algunas condiciones que dos matrices deben cumplir para ser iguales: en primera, ambas deben de tener el mismo tamaño; es decir, sus números de filas deben de ser iguales y sus números de columnas deben de ser iguales. Por lo tanto, vemos que las matrices mostradas anteriormente son diferentes. Además, sus correspondientes entradas deben de ser iguales. Podemos escribir esto en una definición como sigue.

Definición. Sean $A$ y $B$ matrices en $M_{m,n}(\mathbb{R})$. Diremos que estas matrices son iguales si para cada $i\in \{1,\ldots,m\}$ y cada $j\in \{1,\ldots,n\}$ se cumple que la entrada $(i,j)$ de $A$ es la misma que la entrada $(i,j)$ de $B$.

¿Puedes decir por qué las siguientes matrices son diferentes?

\[

\begin{pmatrix}

1 & 2 & 3 \\

4 & 5 & 6 \\

7 & 8 & 9

\end{pmatrix}

\ne

\begin{pmatrix}

1 & 4 & 7 \\

2 & 5 & 8 \\

3 & 6 & 9

\end{pmatrix}.

\]

Notación y algunos vectores y matrices especiales

En matemáticas, es usual que denotemos los vectores con letras minúsculas (siendo las más comunes la $u$, $v$ y $w$) aunque muchas veces te podrás encontrar con notaciones especiales que los hacen más fáciles de distinguir, por ejemplo, $\overrightarrow{a}$ o $\mathbf{a}$. Nosotros no haremos esta distinción y usaremos simplemente letras minúsculas. Por ejemplo podríamos tomar al vector $u=(1,2,3)$ de $\mathbb{R}^3$.

Por su parte, las matrices las solemos representar con letras mayúsculas (generalmente las primeras del abecedario: $A$, $B$, $C$). Si la entrada que se encuentra en la fila $i$ y colmuna $j$ de la matriz se le denota como con la correspondiente letra minúscula y con subíndices la posición de su entrada: $a_{ij}$. Así, tendríamos que en

\[

A=

\begin{pmatrix}

0 & 8 & -4.5 \\

2 & 9 & 0 \\

1 & \pi & 5

\end{pmatrix}

\]

la entrada $a_{13} = -4.5$ y la entrada $a_{31} = 1$. ¿Cuál es la entrada $a_{23}$?

Además, existen algunos vectores y matrices con entradas reales que nos encontraremos con bastante frecuencia, y por esta razón reciben nombres especiales:

- El vector en el que todas sus entradas son el número cero se conoce como vector cero o vector nulo. Por ejemplo, el vector nulo en $\mathbb{R}^2$ es $ (0,0)$ mientras que el nulo en $\mathbb{R}^3$ es $(0,0,0)$. Generalmente, denotamos este vector como $0$ (o, en ocasiones, como $\overrightarrow{0}$ o $\mathbf{0}$) .Es importante observar que se usa el mismo símbolo para representar a los vectores nulos con números distintos de entradas (de modo que podremos encontrar que $0=(0,0)$, en el caso de $\mathbb{R}^2$, o que $0=(0,0,0)$, en el caso de $\mathbb{R}^3$). Esto es algo que debemos tener en cuenta, aunque no suele representar mayores complicaciones, pues el contexto nos dirá 1) Si el símbolo $0$ se usa para el real cero o el vector cero y 2) Con cuántas entradas estamos trabajando.

- La matriz en el que todas sus entradas son cero se conoce como matriz cero o matriz nula. Ejemplos de matrices nulas son

\[

\begin{pmatrix}

0 & 0 & 0 & 0 \\

0 & 0 & 0 & 0 \\

0 & 0 & 0 & 0

\end{pmatrix}

\qquad

\text{y}

\qquad

\begin{pmatrix}

0 & 0 \\

0 & 0

\end{pmatrix}.

\]

Estas matrices se suelen denotar con el símbolo $\mathcal{O}$, aunque en el caso de las matrices sí es común especificar las dimensiones de la matriz, de modo que la primera matriz escrita en este inciso se denota como $\mathcal{O}_{3\times 4}$ mientras que una matriz cuadrada, como la segunda de este inciso, se denota como $\mathcal{O}_2$.

- El vector en $\mathbb{R}^n$ cuya $i$-ésima entrada es $1$ y el resto de sus entradas es $0$ se conoce como vector canónico, y se denota $\mathrm{e}_i$. Por ejemplo, el vector canónico $\mathrm{e}_3$ en $\mathbb{R}^4$ es $(0,0,1,0)$.

- Además, al conjunto de todos los posibles vectores canónicos en $\mathbb{R}^n$ se conoce como la base canónica de $\mathbb{R}^n$; así, la base canónica de $\mathbb{R}^4$ es

\[

\{(1,0,0,0), \ (0,1,0,0), \ (0,0,1,0), (0,0,0,1)\} = \{\mathrm{e}_1, \mathrm{e}_2, \mathrm{e}_3, \mathrm{e}_4\}.

\] - Llamamos diagonal de una matriz cuadrada a las componentes cuyos número de fila y número de columna coinciden. Además, diremos que una matriz es una matriz diagonal si es una matriz cuadrada en la que todas sus entradas que no están en la diagonal (es decir, que su número de fila es distinto a su número de columna) son cero. Ejemplos de matrices diagonales son

\[

\begin{pmatrix}

5 & 0 & 0 \\

0 & 8 & 0 \\

0 & 0 & \pi

\end{pmatrix}

\qquad

\text{y}

\qquad

\begin{pmatrix}

6 & 0 & 0 & 0 \\

0 & 7 & 0 & 0 \\

0 & 0 & 0 & 0 \\

0 & 0 & 0 & 9

\end{pmatrix}

\]

(Observemos que aquellas entradas que se encuentran sobre su diagonal también pueden ser cero, aquí no tenemos ninguna restricción). - La matriz diagonal en la que todas sus entradas sobre la diagonal son 1 se conoce como matriz identidad. Ejemplos de matrices identidad son

\[

\begin{pmatrix}

1 & 0 & 0\\

0 & 1 & 0 \\

0 & 0 & 1

\end{pmatrix}

\qquad

\text{y} \\

\qquad

\begin{pmatrix}

1

\end{pmatrix}.

\]

A esta matriz la denotamos por $\mathcal{I}$ y especificamos su tamaño como subíndice. Así, las matrices anteriores son ${I}_3$ e $\mathcal{I}_1$.

Más adelante…

En esta entrada vimos las definiciones de vectores y matrices con entradas reales que usaremos para trabajar en este curso. También revisamos cuándo dos vectores (o matrices) son iguales. Además, vimos algunos ejemplos de vectores y matrices que nos encontraremos con bastante frecuencia en las matemáticas.

En las siguientes entradas veremos que también se pueden hacer operaciones entre vectores y matrices, aunque necesitaremos que se cumplan algunas condiciones especiales.

Tarea moral

- Basándonos en la definiciones, verifica las siguientes igualdades:

- El vector $(4-4,1,3)$ es igual al vector $(0,2-1,2+1)$.

- La matriz $A=\begin{pmatrix} 1 & 2 \\ 2 & 4\end{pmatrix}$ es igual a la matriz $B$ de $2\times 2$ cuyas entradas están dadas por $b_{ij}=i\cdot j$.

- Encuentra todos los posibles vectores que hay en $\mathbb{R}^3$ cuyas entradas sean únicamente los números $1$ y $2$. ¿Cuántos deben de ser?

- Seguramente algunos los nombres de los vectores y matrices especiales te recuerdan a algún tipo de operación. ¿Qué operaciones crees que podamos hacer con los vectores y/o matrices, y qué comportamiento tendrían aquellos que reciben un nombre especial?

- ¿Por qué podemos decir que una matriz nula cuadrada cumple con ser una matriz diagonal?

- Escribe todos los elementos de la base canónica de $\mathbb{R}^6$.

Entradas relacionadas

- Ir a Álgebra Superior I

- Entrada anterior del curso: Problemas de triángulo de Pascal y binomio de Newton

- Entrada siguiente del curso: Operaciones de suma y producto escalar con vectores y matrices

Agradecimientos

Trabajo realizado con el apoyo del Programa UNAM-DGAPA-PAPIME PE109323 «Hacia una modalidad a distancia de la Licenciatura en Matemáticas de la FC-UNAM – Etapa 3»