Introducción

En la entrada anterior introdujimos el concepto de determinante de matrices cuadradas. Dimos la definición para matrices de $2\times 2$. Aunque no dimos la definición en general (pues corresponde a un curso de Álgebra Lineal I), dijimos cómo se pueden calcular los determinantes de manera recursiva. Pero, ¿hay otras herramientas para hacer el cálculo de determinantes más sencillo?

En esta entrada hablaremos de más propiedades de los determinantes. Comenzaremos viendo que si en una matriz tenemos dos filas o columnas iguales, el determinante se hace igual a cero. Luego, veremos que los determinantes son lineales (por renglón o columna), que están muy contectados con las operaciones elementales y platicaremos de algunos determinantes especiales.

Linealidad por filas o columnas

El determinante «abre sumas y saca escalares», pero hay que ser muy cuidadosos, pues no lo hace para toda una matriz, sino sólo renglón a renglón, o columna a columna. Enunciemos esto en las siguientes proposiciones.

Proposición. El determinante saca escalares renglón por renglón o columna por columna. Por ejemplo, pensemos en sacar escalares por renglón. Si $k$ es un número real y tenemos una matriz de la forma

\[

\begin{pmatrix}

a_{11} & a_{12} & \cdots & a_{1n} \\

\vdots & \vdots & & \vdots \\

ka_{i1} & ka_{i2} & \cdots & ka_{in} \\

\vdots & \vdots & & \vdots \\

a_{n1} & a_{n2} & \cdots & a_{nn}

\end{pmatrix},

\]

entonces

\[

\operatorname{det}

\begin{pmatrix}

a_{11} & a_{12} & \cdots & a_{1n} \\

\vdots & \vdots & & \vdots \\

ka_{i1} & ka_{i2} & \cdots & ka_{in} \\

\vdots & \vdots & & \vdots \\

a_{n1} & a_{n2} & \cdots & a_{nn}

\end{pmatrix}

=

k\operatorname{det}

\begin{pmatrix}

a_{11} & a_{12} & \cdots & a_{1n} \\

\vdots & \vdots & & \vdots \\

a_{i1} & a_{i2} & \cdots & a_{in} \\

\vdots & \vdots & & \vdots \\

a_{n1} & a_{n2} & \cdots & a_{nn}

\end{pmatrix}.

\]

No podemos dar la demostración muy formalmente, pues necesitamos de más herramientas. Pero puedes convencerte de que esta proposición es cierta pensando en lo que sucede cuando se calcula el determinante recursivamente en la fila $i$. En la matriz de la izquierda, usamos los coeficientes $ka_{i1},\ldots,ka_{in}$ para acompañar a los determinantes de las matrices de $(n-1)\times (n-1)$ que van saliendo. Pero entonces en cada término aparece $k$ y se puede factorizar. Lo que queda es $k$ veces el desarrollo recursivo de la matriz sin las $k$’s en el renglón $i$.

Ejemplo. Calculemos el determinante de la matriz $A=\begin{pmatrix} 2 & 2 & -1 \\ 0 & 2 & 3 \\ -3 & 2 & 1\end{pmatrix}$. En la primera columna hay un $0$, así que nos conviene usar esta columna para encontrar el determinante. Aplicando la regla recursiva, obtenemos que:

\begin{align*}

\det(A)=\begin{vmatrix} 2 & 2 & -1 \\ 0 & 2 & 3 \\ -3 & 2 & 1\end{vmatrix} &= (2) \begin{vmatrix} 2 & 3 \\ 2 & 1 \end{vmatrix} – (0) \begin{vmatrix} 2 & -1 \\ 2 & 1 \end{vmatrix} + (-3) \begin{vmatrix} 2 & -1 \\ 2 & 3 \end{vmatrix}\\

&=2(2\cdot 1 – 3 \cdot 2) – 0 (2 \cdot 1 – (-1)\cdot 2) – 3 (2\cdot 3 – (-1)\cdot 2)\\

&=2(-4)-0(4)-3(8)\\

&=-32.

\end{align*}

¿Qué sucedería si quisiéramos ahora el determinante de la matriz $B=\begin{pmatrix} 2 & 1 & -1 \\ 0 & 1 & 3 \\ -3 & 1 & 1\end{pmatrix}$? Podríamos hacer algo similar para desarrollar en la primera fila. Pero esta matriz está muy relacionada con la primera. La segunda columna de $B$ es $1/2$ veces la segunda columna de $A$. Por la propiedad que dijimos arriba, tendríamos entonces que $$\det(B)=\frac{1}{2}\det(A)=\frac{-32}{2}=-16.$$

$\triangle$

Ejemplo. Hay que tener mucho cuidado, pues el determinante no saca escalares con el producto escalar de matrices. Observa que si $A=\begin{pmatrix} 2 & 1 \\ 1 & 1 \end{pmatrix}$, entonces $\begin{vmatrix} 2 & 1 \\ 1 & 1 \end{vmatrix} = 2\cdot 1 – 1\cdot 1 = 1$. Sin embargo, $$\det(2A)=\begin{vmatrix} 4 & 2 \\ 2 & 2 \end{vmatrix}=4\cdot 2 – 2 \cdot 2 = 4\neq 2\det(A).$$

En vez de salir dos veces el determinante, salió cuatro veces el determinante. Esto tiene sentido de acuerdo a la propiedad anterior: sale un factor $2$ pues la primera fila es el doble, y sale otro factor $2$ porque la segunda fila también es el doble.

$\square$

Proposición. El determinante abre sumas renglón por renglón, o columa por columna. Por ejemplo, veamos el caso para columnas. Si tenemos una matriz de la forma

\[

\begin{pmatrix}

a_{11} & \cdots & a_{1i} + b_{1i} & \cdots & a_{1n} \\

a_{21} & \cdots & a_{2i} + b_{2i} & \cdots & a_{2n} \\

\vdots & & \vdots & & \vdots \\

a_{n1} & \cdots & a_{ni} + b_{ni} & \cdots & a_{nn}

\end{pmatrix},

\]

entonces este determinante es igual a

\begin{align*}

\operatorname{det}

\begin{pmatrix}

a_{11} & \cdots & a_{1i} & \cdots & a_{1n} \\

a_{21} & \cdots & a_{2i} & \cdots & a_{2n} \\

\vdots & & \vdots & & \vdots \\

a_{n1} & \cdots & a_{ni} & \cdots & a_{nn}

\end{pmatrix}

+

\operatorname{det}

\begin{pmatrix}

a_{11} & \cdots & b_{1i} & \cdots & a_{1n} \\

a_{21} & \cdots & b_{2i} & \cdots & a_{2n} \\

\vdots & & \vdots & & \vdots \\

a_{n1} & \cdots & b_{ni} & \cdots & a_{nn}

\end{pmatrix}.

\end{align*}

Una vez más, no podemos dar una demostración muy formal a estas alturas. Pero como en el caso de sacar escalares, también podemos argumentar un poco informalmente qué sucede. Si realizamos el cálculo de determinantes en la columna $i$, entonces cada término de la forma $a_{ji}+b_{ji}$ acompaña a un determinante $D_{ji}$ de una matriz de $(n-1)\times (n-1)$ que ya no incluye a esa columna. Por ley distributiva, cada sumando es entonces $(a_{ji}+b_{ji})D_{ji}=a_{ji}D_{ji}+b_{ji}D_{ji}$ (acompañado por un $+$ o un $-$). Agrupando en un lado los sumandos con $a_{ji}$’s y por otro los sumandos con $b_{ji}$’s obtenemos la identidad deseada.

Ejemplo. Las matrices $\begin{pmatrix} 5 & 2 \\ 2 & 1 \end{pmatrix}$ y $\begin{pmatrix} 2 & 5 \\ 2 & 1 \end{pmatrix}$ tienen determinantes $1$ y $-8$ respectivamente (verifícalo). De acuerdo a la propiedad anterior, el determinante de la matriz $$\begin{pmatrix} 5 + 2 & 2 + 5 \\ 2 & 1 \end{pmatrix} = \begin{pmatrix} 7 & 7 \\ 2 & 1 \end{pmatrix}$$

debería ser $1 + (-8) = -7$. Y sí, en efecto $7\cdot 1 – 2 \times 7 = -7$.

$\triangle$

Hay que tener mucho cuidado, pues en esta propiedad de la suma las dos matrices tienen que ser iguales en casi todas las filas (o columnas), excepto en una. En esa fila (o columna) es donde se da la suma. En general, no sucede que $\det(A+B)=\det(A)+\det(B)$.

Ejemplo. Puedes verificar que las matrices $A=\begin{pmatrix} 1 & 0 & 0 & 0 \\ 0 & 1 & 0 & 0 \\ 0 & 0 & 1 & 0 \\ 0 & 0 & 0 & 1\end{pmatrix}$ y $B=\begin{pmatrix} -1 & 0 & 0 & 0 \\ 0 & -1 & 0 & 0 \\ 0 & 0 & -1 & 0 \\ 0 & 0 & 0 & -1\end{pmatrix}$ tienen ambas determinante $1$. Sin embargo, su suma es la matriz de puros ceros, que tiene determinante $0$. Así, $$\det(A)+\det(B)=2\neq 0 = \det(A+B).$$

$\triangle$

El determinante y operaciones elementales

El siguiente resultado nos dice qué sucede al determinante de una matriz cuando le aplicamos operaciones elementales.

Teorema. Sea $A$ una matriz cuadrada.

- Si $B$ es una matriz que se obtiene de $A$ al reescalar un renglón con el escalar $\alpha$, entonces $\det(B)=\alpha\det(A)$.

- Si $B$ es una matriz que se obtiene de $A$ al intercambiar dos renglones, entonces $\det(B)=-\det(A)$.

- Si $B$ es una matriz que se obtiene de $A$ al hacer una transvección, entonces $\det(B)=\det(A)$.

No nos enfocaremos mucho en demostrar estas propiedades, pues se demuestran con más generalidad en el curso de Álgebra Lineal I. Sin embargo, a partir de ellas podemos encontrar un método de cálculo de determinantes haciendo reducción gaussiana.

Teorema. Sea $A$ una matriz cuadrada. Supongamos que para llevar $A$ a su forma escalonada reducida $A_{red}$ se aplicaron algunas transvecciones, $m$ intercambios de renglones y $k$ reescalamientos por escalares no cero $\alpha_1,\ldots,\alpha_k$ (en el orden apropiado). Entonces $$\det(A)=\frac{(-1)^m\det(A_{red})}{\alpha_1\alpha_2\cdots\alpha_k}.$$ En particular:

- Si $A_{red}$ no es la identidad, entonces $\det(A_{red})=0$ y entonces $\det(A)=0$.

- Si $A_{red}$ es la identidad, entonces $\det(A_{red})=1$ y entonces $$\det(A)=\frac{(-1)^m}{\alpha_1\alpha_2\cdots\alpha_k}.$$

Veamos un ejemplo.

Ejemplo. Calculemos el determinante de la matriz $A=\begin{pmatrix} 2 & 2 & -2 \\ 0 & 2 & 3 \\ -3 & 2 & 1\end{pmatrix}$ usando reducción gaussiana. Multiplicamos la primera fila por $\alpha_1=1/2$ y la sumamos tres veces a la última (transvección no cambia el determinante):

$$\begin{pmatrix} 1 & 1 & -1 \\ 0 & 2 & 3 \\ 0 & 5 & -2\end{pmatrix}$$

Multiplicamos por $\alpha_2=1/5$ la segunda fila y la intercambiamos con la tercera (va $m=1$).

$$\begin{pmatrix} 1 & 1 & -1 \\ 0 & 1 & -\frac{2}{5} \\ 0 & 2 & 3\end{pmatrix}.$$

Restamos dos veces la segunda fila a la tercera (transvección no cambia el determinante)

$$\begin{pmatrix} 1 & 1 & -1 \\ 0 & 1 & -\frac{2}{5} \\ 0 & 0 & \frac{19}{5}\end{pmatrix},$$

y multiplicamos la tercera fila por $\alpha_3=5/19$:

$$\begin{pmatrix} 1 & 1 & -1 \\ 0 & 1 & -\frac{2}{5}\\ 0 & 0 & 1\end{pmatrix}.$$

Hacemos transvecciones para hacer cero las entradas arriba de la diagonal principal (transvecciones no cambian el determinante): $$\begin{pmatrix} 1 & 0 & 0 \\ 0 & 1 & 0 \\ 0 & 0 & 1\end{pmatrix}.$$

Ya llegamos a la identidad. Los reescalamientos fueron por $1/2$, $1/5$ y $5/19$ y usamos en total $1$ intercambio. Así, $$\det(A)=\frac{(-1)^1}{(1/2)(1/5)(5/19)}=-38.$$

$\triangle$

Es recomendable que calcules el determinante del ejemplo anterior con la regla recursiva de expansión por menores para que verifiques que da lo mismo.

Algunos determinantes especiales

A continuación enunciamos otras propiedades que cumplen los determinantes. Todas estas puedes demostrarlas suponiendo propiedades que ya hemos enunciado.

Proposición. Para cualquier entero positivo $n$ se cumple que la matriz identidad $\mathcal{I}_n$ tiene como determinante $\operatorname{det}(\mathcal{I}_n) = 1$.

Este resultado es un caso particular de una proposición más general.

Proposición. El determinante de una matriz diagonal es igual al producto de los elementos de su diagonal; es decir,

\[

\operatorname{det}

\begin{pmatrix}

a_{11} & 0 & \cdots & 0 \\

0 & a_{22} & \cdots & 0 \\

\vdots & \vdots & \ddots & \vdots \\

0 & 0 & \cdots & a_{nn}

\end{pmatrix}

=

a_{11} a_{12} \cdots a_{nn}.

\]

Para probar esta proposición, puedes usar la regla recursiva para hacer la expansión por la última fila (o columna) y usar inducción.

Proposición. $\operatorname{det}(A^T) = \operatorname{det}(A)$.

Este resultado también sale inductivamente. Como los determinantes se pueden expandir por renglones o columnas, entonces puedes hacer una expansión en alguna fila de $A$ y será equivalente a hacer la expansión por columnas en $A^T$.

Proposición. Si $A$ es una matriz invertible, entonces $\operatorname{det}(A^{-1}) = \dfrac{1}{\operatorname{det}(A)}$.

Para demostrar este resultado, se puede usar la proposición del determinante de la identidad, y lo que vimos la entrada pasada sobre que $\det(AB)=\det(A)\det(B)$.

Los argumentos que hemos dado son un poco informales, pero quedará en los ejercicios de esta entrada que pienses en cómo justificarlos con más formalidad.

Ejemplos interesantes de cálculo de determinantes

Las propiedades anteriores nos permiten hacer el cálculo de determinantes de varias maneras (no sólo expansión por menores). A continuación presentamos dos ejemplos que usan varias de las técnicas discutidas arriba.

Ejemplo. Calculemos el siguiente determinante:

$$\begin{vmatrix} 1 & 5 & 3 \\ 2 & 9 & 1 \\ 5 & 4 & 3 \end{vmatrix}.$$

Como aplicar transvecciones no cambia el determinante, podemos restar la primera fila a la segunda, y luego cinco veces la primera fila a la tercera y el determinante no cambia. Así, este determinante es el mismo que

$$\begin{vmatrix} 1 & 5 & 3 \\ 0 & -1 & -5 \\ 0 & -21 & -12 \end{vmatrix}.$$

Multiplicar la segunda fila por $-1$ cambia el determinante en $-1$. Y luego multiplicar la tercera por $-1$ lo vuelve a cambiar en $-1$. Entonces haciendo ambas operaciones el determinante no cambia y obtenemos que el determinante es igual a

$$\begin{vmatrix} 1 & 5 & 3 \\ 0 & 1 & 5 \\ 0 & 21 & 12 \end{vmatrix}.$$

En esta matriz podemos expandir por la primera columna en donde hay dos ceros. Por ello, el determinante es

$$\begin{vmatrix} 1 & 5 \\ 21 & 12 \end{vmatrix}= (1\cdot 12) – (5 \cdot 21) = -93.$$

$\triangle$

Ejemplo. Calculemos el siguiente determinante:

$$\begin{vmatrix} 1 & 2 & 3 & 4 \\ 2 & 3 & 4 & 1 \\ 3 & 4 & 1 & 2 \\ 4 & 1 & 2 & 3 \end{vmatrix}.$$

Hacer transvecciones no cambia el determinante, entonces podemos sumar todas las filas a la última sin alterar el determinante. Como $1+2+3+4=10$, obtenemos:

$$\begin{vmatrix} 1 & 2 & 3 & 4 \\ 2 & 3 & 4 & 1 \\ 3 & 4 & 1 & 2 \\ 10 & 10 & 10 & 10 \end{vmatrix}.$$

Ahora, la última fila tiene un factor $10$ que podemos factorizar:

$$10\cdot \begin{vmatrix} 1 & 2 & 3 & 4 \\ 2 & 3 & 4 & 1 \\ 3 & 4 & 1 & 2 \\ 1 & 1 & 1 & 1 \end{vmatrix}.$$

Ahora, podemos restar la primera columna a todas las demás, sin cambiar el determinante:

$$10\cdot \begin{vmatrix} 1 & 1 & 2 & 3 \\ 2 & 1 & 2 & -1 \\ 3 & 1 & -2 & 1 \\ 1 & 0 & 0 & 0 \end{vmatrix}.$$

Luego, podemos sumar la segunda fila a la tercera sin cambiar el determinante:

$$10\cdot \begin{vmatrix} 1 & 1 & 2 & 3 \\ 2 & 1 & 2 & -1 \\ 5 & 2 & 0 & 0 \\ 1 & 0 & 0 & 0 \end{vmatrix}.$$

Expandiendo por la última fila:

$$-10\cdot \begin{vmatrix} 1 & 2 & 3 \\ 1 & 2 & -1 \\ 2 & 0 & 0 \end{vmatrix}.$$

Expandiendo nuevamente por la última fila:

$$-10 \cdot 2 \cdot \begin{vmatrix} 2 & 3 \\ 2 & -1 \end{vmatrix}.$$

El determinante de $2\times 2$ que queda ya sale directo de la fórmula como $2\cdot (-1)-3\cdot 2 = -8$. Así, el determinante buscado es $(-10)\cdot 2 \cdot (-8)=160$.

$\triangle$

Más adelante…

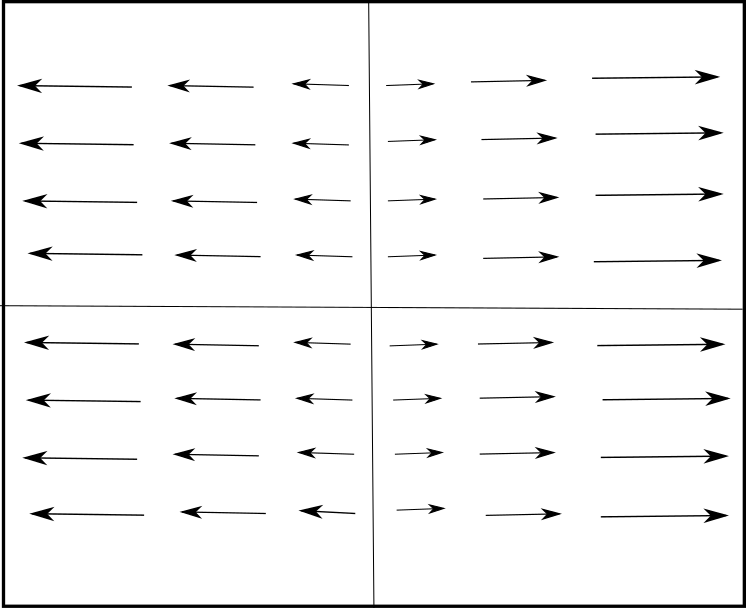

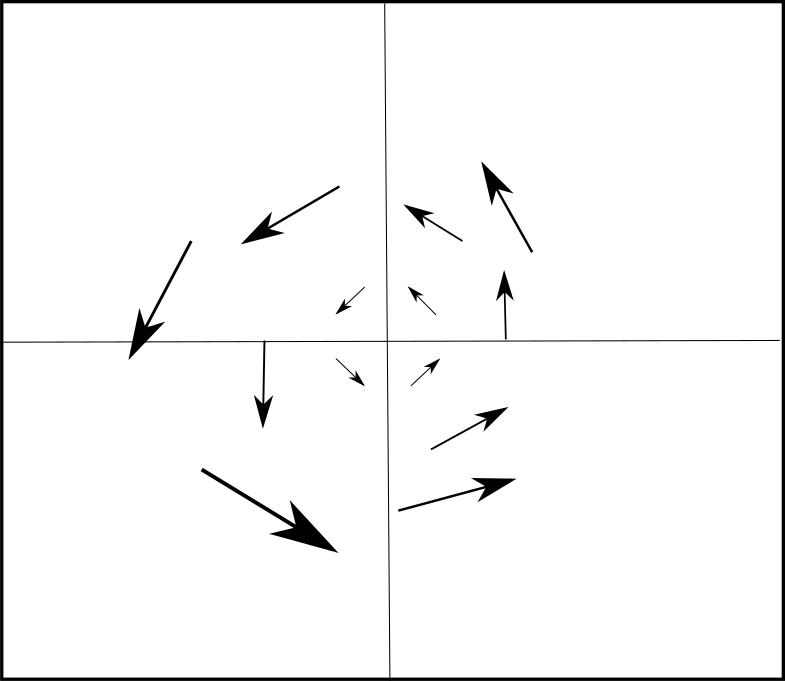

Los determinantes son una propiedad fundamental de las matrices. En estas entradas apenas comenzamos a platicar un poco de ellos. Por un lado, son muy importantes algebraicamente pues ayudan a decidir cuándo una matriz es invertible. Se pueden utilizar para resolver sistemas de $n$ ecuaciones lineales en $n$ incógnitas con algo conocido como la regla de Cramer. Por otro lado, los determinantes también tienen una interpretación geométrica que es sumamente importante en geometría analítica y en cálculo integral de varias variables. En cursos posteriores en tu formación matemática te los seguirás encontrando.

Tarea moral

- Calcula el siguiente determinante: $$\begin{vmatrix} 1 & 1 & 1 & 1 \\ 2 & 0 & 2 & 2 \\ 0 & 3 & 3 & 0 \\ 0 & 0 & 4 & 0 \end{vmatrix}.$$ Intenta hacerlo de varias formas, aprovechando todas las herramientas que hemos discutido en esta entrada.

- También se pueden obtener determinantes en matrices en donde hay variables en vez de escalares. Encuentra el determinante de la matriz $$\begin{pmatrix} a & b & c \\ b & c & a \\ c & a & b \end{pmatrix}.$$

- Encuentra todas las matrices $A$ de $2\times 2$ que existen tales que $$\det(A+I_2)=\det(A)+1.$$

- Demuestra todas las propiedades de la sección de «Algunos determinantes especiales». Ahí mismo hay sugerencias de cómo puedes proceder.

- Revisa las entradas Álgebra Lineal I: Técnicas básicas de cálculo de determinantes y Seminario de Resolución de Problemas: Cálculo de determinantes para conocer todavía más estrategias y ejemplos de cálculo de determinantes.

Entradas relacionadas

- Ir a Álgebra Superior I

- Entrada anterior del curso: Determinante de matrices y propiedades

- Entrada siguiente del curso: Los espacios vectoriales $\mathbb{R}^2$ y $\mathbb{R}^3$