Introducción

Con la teoría que hemos desarrollado acerca de espacios vectoriales, de determinantes y con las herramientas que hemos adquirido para calcularlos, podemos volver a visitar el tema de sistemas de ecuaciones lineales y verlo desde una perspectiva más completa. Los determinantes en sistemas de ecuaciones lineales nos sirven para varias cosas.

Por un lado, sirven para encontrar el rango de una matriz. El rango está relacionado con la dimensión del espacio de soluciones a un sistema lineal de ecuaciones. Esto es parte del contenido del importante teorema de Rouché-Capelli que enunciaremos y demostraremos.

Por otro lado, cuando tenemos sistemas lineales con matriz asociada cuadrada e invertible, podemos usar determinantes para encontrar las soluciones. A esto se le conoce como las fórmulas de Cramer o la regla de Cramer. También enunciaremos y demostraremos esto. La regla de Cramer es parcialmente útil en términos prácticos, pues para sistemas concretos conviene más usar reducción gaussiana. Sin embargo, es muy importante en términos teóricos, cuando se quieren probar propiedades de las soluciones a un sistema de ecuaciones.

Rango de una matriz y determinantes

Recuerda que el rango de una matriz $A$ en $M_{m,n}(F)$ es, por definición, la dimensión del espacio vectorial que es la imagen de la transformación $X\mapsto AX$ de $F^n\to F^m$. Anteriormente, mostramos que esto coincide con la dimensión del espacio vectorial generado por los vectores columna de $A$. Como el rango de una matriz coincide con su transpuesta, entonces también es la dimensión del espacio vectorial generado por los vectores fila de $A$.

Lo que veremos ahora es que podemos determinar el rango de una matriz $A$ calculando algunos determinantes de matrices pequeñas asociadas a $A$. Una submatriz de $A$ es una matriz que se obtiene de eliminar algunas filas o columnas de $A$.

Teorema. Sea $A$ una matriz en $M_{m,n}(F)$. El rango de $A$ es igual al tamaño de la submatriz cuadrada más grande de $A$ que sea invertible.

Demostración. Llamemos $C_1,\ldots,C_n$ a las columnas de $A$. Sabemos que $$r=\dim \text{span}(C_1,\ldots,C_n).$$

Mostraremos primero que hay una submatriz cuadrada de tamaño $r$. Por el lema de Steinitz, podemos escoger $r$ enteros $1\leq i_1<\ldots<i_r\leq n$ tal que las columnas $C_{i_1},\ldots,C_{i_r}$ de $A$ cumplen $$\text{span}(C_1,\ldots,C_n)=\text{span}(C_{i_1},\ldots,C_{i_r}).$$ Así, la matriz $B$ hecha por columnas $C_{i_1},\ldots,C_{i_r}$ está en $M_{m,r}(F)$ y es de rango $r$.

Ahora podemos calcular el rango de $B$ por filas. Si $F_1,\ldots,F_m$ son las filas de $B$, tenemos que $$r=\dim \text{span}(F_1,\ldots,F_m).$$ De nuevo, por el lema de Steinitz, existen enteros $1\leq j_1<\ldots<j_r\leq m$ tales que $$\text{span}(F_1,\ldots,F_m)=\text{span}(F_{i_1},\ldots,F_{i_r}).$$ De esta forma, la matriz $C$ hecha por las filas $F_{j_1},\ldots,F_{j_r}$ está en $M_r(F)$ y es de rango $r$. Por lo tanto, $C$ es una matriz cuadrada de tamaño $r$ y es invertible.

Esta matriz $C$ es una submatriz de $A$ pues se obtiene al eliminar de $A$ todas las columnas en posiciones distintas a $i_1,\ldots,i_r$ y todas las filas en posiciones distintas a $j_1,\ldots,j_r$. Esto muestra una parte de lo que queremos.

Ahora mostraremos que si $B$ es una submatriz de $A$ cuadrada e invertible de tamaño $d$, entonces $d\leq r$. En efecto, tomemos una $B$ así. Sus columnas son linealmente independientes. Si $i_1<\ldots<i_n$ corresponden a los índices de las columnas de $A$ que se preservan al pasar a $B$, entonces las columnas $C_{i_1},\ldots,C_{i_d}$ de $A$ son linealmente independientes, ya que si hubiera una combinación no trivial de ellas igual a cero, entonces la habría de las columnas de $B$, lo cual sería una contradicción a que son linealmente independientes.

De esta forma,

\begin{align*}

d&=\dim \text{span}(C_{i_1},\ldots,C_{i_d})\\

&\leq \dim \text{span} (C_1,\ldots,C_d)\\

&=r,

\end{align*}

que es la desigualdad que nos faltaba para terminar la prueba.

$\square$

Ejemplo. Supongamos que queremos encontrar el rango de la siguiente matriz en $M_{3,5}(\mathbb{R})$: $$A=\begin{pmatrix}4 & 5 & -4 & 7 & 2\\ 0 & -3 & -1 & 0 & 9\\ 0 & -5 & 0 & 9 & -3 \end{pmatrix}.$$

Por propiedades de rango que vimos anteriormente, ya sabemos que su rango es a lo más el mínimo de sus dimensiones, así que su rango es como mucho $\min(3,5)=3$.

Por otro lado, notemos que si eliminamos la segunda y cuarta columnas, entonces obtenemos la submatriz cuadrada $$\begin{pmatrix} 4 & -4 & 2\\ 0 & -1 & 9\\ 0 & 0 & -3\end{pmatrix}.$$ Esta es una matriz triangular superior, así que su determinante es el producto de las diagonales, que es $4\cdot (-1)\cdot (-3)=12$.

Como el determinante no es cero, es una matriz invertible de tamaño $3$. Por la proposición anterior, el rango de $A$ debe ser entonces mayor o igual a $3$. Juntando las dos desigualdades que encontramos, el rango de $A$ debe ser igual a $3$.

$\triangle$

Estas ideas nos servirán al aplicar determinantes en sistemas de ecuaciones.

Teorema de Rouché-Capelli

Recordemos que un sistema lineal de ecuaciones con $m$ ecuaciones y $n$ incógnitas es de la forma

\begin{align*}

a_{11}x_1 + a_{12} x_2 + \ldots + a_{1n}x_n &= b_1\\

a_{21}x_1 + a_{22} x_2 + \ldots + a_{2n}x_n &= b_2\\

\vdots&\\

a_{m1}x_1 + a_{m2} x_2 + \ldots + a_{mn}x_n &= b_m,

\end{align*}

lo cual se puede reescribir en términos matriciales tomando una matriz, un vector de escalares y un vector de incógnitas así:

\begin{align*}

A&=\begin{pmatrix}a_{11} & a_{12} & \cdots & a_{1n}\\ a_{21} & a_{22} & \cdots & a_{2n} \\ \vdots & & \ddots & \vdots \\ a_{m1} & a_{m2} & \cdots & a_{mn} \end{pmatrix},\\

b&=\begin{pmatrix}b_1\\ \vdots\\ b_m\end{pmatrix} \text{ y }\; X=\begin{pmatrix}x_1\\ \vdots\\ x_n\end{pmatrix},

\end{align*} y reescribiendo el sistema como $$AX=b.$$

Si $C_1,\ldots, C_n$ son las columnas de la matriz $A$, también sabemos que $$AX=x_1C_1+\ldots + x_nC_n,$$ de modo que el sistema de ecuaciones puede ser escrito como $$x_1C_1+\ldots + x_nC_n=b.$$

Esto nos da una intuición fuerte de lo que es un sistema lineal de ecuaciones: se trata de determinar si $b$ está en el espacio generado por las columnas de $A$, y si es así, ver todas las formas en las que podemos obtenerlo.

El teorema de la sección anterior nos permite aplicar determinantes en sistemas de ecuaciones lineales mediante el siguiente resultado.

Teorema (Rouché-Capelli). Sean $A\in M_n(F)$ y $b\in F^m$. Sea $(A|b)$ la matriz en $M_{n,n+1}(F)$ obtenida de agregar a $b$ como columna hasta la derecha de la matriz $A$. Entonces:

- El sistema lineal de ecuaciones $AX=b$ tiene al menos una solución si y sólo si $\rank(A)=\rank((A|b))$.

- El conjunto de soluciones $\mathcal{S}_h$ al sistema homogéneo es un subespacio de $F^n$ de dimensión $n-\rank(A)$.

Demostración. Por la discusión previa, el sistema tiene una solución si y sólo si $b$ es una combinación lineal de las columnas de $A$. De esta forma, si existe una solución, entonces $\rank(A)=\rank((A|b))$, pues el espacio generado por las columnas de $A$ sería el mismo que el de las columnas de $(A|b)$.

Por otro lado, si $\rank(A)=\rank((A|b))$ es porque las columnas de $A$ y las de $(A|b)$ generan el mismo espacio, de modo que $b$ está en el espacio vectorial generado por las columnas. Esto prueba la primer parte.

Para la segunda parte, el sistema homogéneo es $AX=0$, de modo que el conjunto solución es precisamente el kernel de la transformación $T:F^n\to F^m$ tal que $X\mapsto AX$. Por el teorema de rango-nulidad, tenemos que $$\dim \mathcal{S}_h = n-\dim \text{Im}(T)=n-\text{rank}(A).$$ Esto termina la demostración.

$\square$

Como discutimos con anterioridad, ya que tenemos una solución $x_0$ para el sistema de ecuaciones $AX=b$, entonces todas las soluciones son el conjunto $$x_0+\mathcal S_h:=\{x_0 + x: x\in \mathcal S_h\}.$$ En otras palabras, cualquier solución al sistema se puede obtener sumando a $x_0$ una solución al sistema lineal homogéneo asociado.

Ejemplo. Consideremos el siguiente sistema de ecuaciones en $\mathbb{R}$ en tres variables:

\begin{align*}

2x+3y-z=1\\

3x-y+2z=0\\

3x+10y-5z=0

\end{align*}

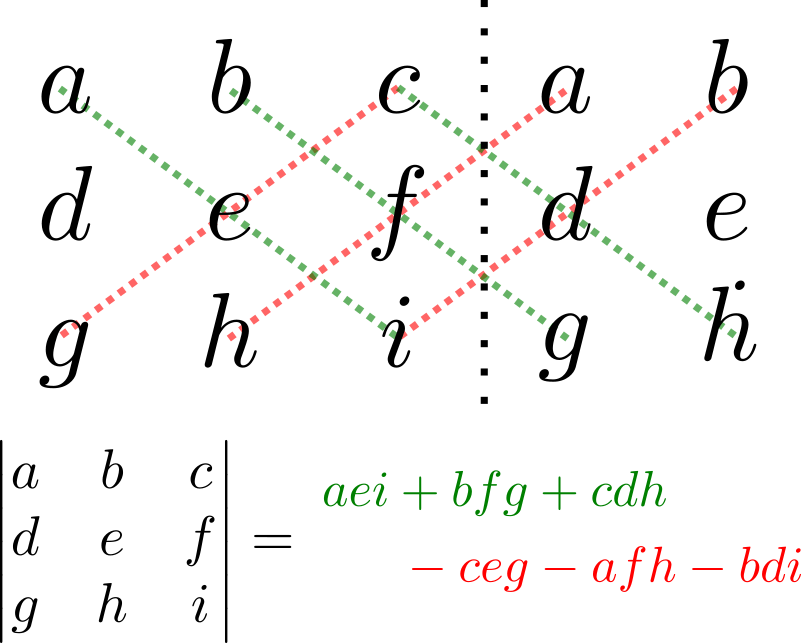

Afirmamos que el sistema no tiene solución. La matriz asociada es $A=\begin{pmatrix} 2 & 3 & -1\\ 3 & -1 & 2 \\ 3 & 10 & -5\end{pmatrix}$. Por lo que sabemos de determinantes de $3\times 3$, podemos calcular su determinante como

\begin{align*}

\begin{vmatrix}

2 & 3 & -1\\ 3 & -1 & 2 \\ 3 & 10 & -5

\end{vmatrix} &= (2)(-1)(-5)+(3)(10)(-1)+(3)(3)(2)\\

&-(-1)(-1)(3)-(2)(10)(2)-(3)(3)(-5)\\

&=10-30+18-3-40+45\\

&=0.

\end{align*}

Esto muestra que $A$ no es invertible, y que por lo tanto tiene rango a lo más $2$. Como $$\begin{vmatrix} 2 & 3 \\ 3 & -1 \end{vmatrix} = (2)(-1)-(3)(3)=-11$$ es un subdeterminante no cero de tamaño 2, entonces $A$ tiene rango $2$.

Ahora consideremos la matriz $$(A|b)=\begin{pmatrix} 2 & 3 & -1 & 1\\ 3 & -1 & 2 & 0 \\ 3 & 10 & -5 & 0\end{pmatrix}.$$ Eliminemos la tercer columna. Podemos calcular al siguiente subdeterminante de $3\times 3$ por expansión de Laplace en la última columna:

\begin{align*}

\begin{vmatrix}

2 & 3 & 1\\ 3 & -1 & 0 \\ 3 & 10 & 0

\end{vmatrix} &= 1 \cdot \begin{vmatrix} 3 & -1 \\ 3 & 10 \end{vmatrix} – 0 \begin{vmatrix} 2 & 3 \\ 3 & 10 \end{vmatrix} + 0 \cdot \begin{vmatrix} 2 & 3 \\ 3 & -1 \end{vmatrix}\\

&= 1 \cdot (3\cdot 10 + 1\cdot 3)\\

&=33.

\end{align*}

De esta forma, $(A|b)$ tiene una submatriz de $3\times 3$ invertible, y por lo tanto tiene rango al menos $3$. Como tiene $3$ filas, su rango es a lo más $3$. Con esto concluimos que su rango es exactamente $3$. Conluimos que $$\text{rank} A = 2 \neq 3 = \text{rank} (A|b),$$ de modo que por el teorema de Rouché-Capelli, el sistema de ecuaciones no tiene solución.

$\triangle$

Antes de ver un ejemplo en el que el sistema sí tiene solución, pensemos qué sucede en este caso. Si la matriz $A$ es de rango $r$, por el teorema de la sección pasada podemos encontrar una submatriz cuadrada $B$ de tamaño $r$ que es invertible. Tras una permutación de las variables o de las ecuaciones, podemos suponer sin perder generalidad que corresponde a las variables $x_1,\ldots,x_r$ y a las primeras $r$ ecuaciones. De esta forma, el sistema $AX=b$ se resume en el siguiente sistema de ecuaciones equivalente:

\begin{align*}

a_{11}x_1 + a_{12} x_2 + \ldots + a_{1r}x_r &= b_1-a_{1,r+1}x_{r+1}-\ldots -a_{1,n} x_n\\

a_{21}x_1 + a_{22} x_2 + \ldots + a_{2r}x_r &= b_2-a_{2,r+1}x_{r+1}-\ldots -a_{2,n} x_n\\

\vdots\\

a_{r1}x_1 + a_{r2} x_2 + \ldots + a_{rr}x_r &= b_m-a_{r,r+1}x_{r+1}-\ldots -a_{r,n} x_n,

\end{align*}

Aquí $x_{r+1},\ldots,x_n$ son lo que antes llamábamos las variables libres y $x_1,\ldots,x_r$ son lo que llamábamos variables pivote. Como la submatriz $B$ correspondiente al lado izquierdo es invertible, para cualquier elección de las variables libres podemos encontrar una única solución para las variables pivote. Ya habíamos probado la existencia y unicidad de cierta solución. Pero de hecho, hay una forma explícita de resolver sistemas de ecuaciones correspondientes a matrices cuadradas. Esto es el contenido de la siguiente sección.

Fórmulas de Cramer para sistemas cuadrados

El siguiente teorema es otra aplicación de determinantes en sistemas de ecuaciones lineales. Nos habla de las soluciones de un sistema lineal $AX=b$ en donde $A$ es una matriz cuadrada e invertible.

Teorema (fórmulas de Cramer). Sea $A$ una matriz invertible en $M_n(F)$ y $b=(b_1,\ldots,b_n)$ un vector en $F^n$. Entonces el sistema lineal de ecuaciones $AX=b$ tiene una única solución $X=(x_1,\ldots,x_n)$ dada por $$x_i=\frac{\det A_i}{\det A},$$ en donde $A_i$ es la matriz obtenida al reemplazar la $i$-ésima columna de $A$ por el vector columna $b$.

Demostración. La existencia y unicidad de la solución ya las habíamos mostrado anteriormente, cuando vimos que la única solución está dada por $$X=(x_1,\ldots,x_n)=A^{-1}b.$$

Si $C_1,\ldots,C_n$ son las columnas de $A$, que $(x_1,\ldots,x_n)$ sea solución al sistema quiere decir que $$x_1C_1+\ldots+x_nC_n=b.$$

El determinante pensado como una función en $n$ vectores columna es $n$-lineal, de modo que usando la linealidad en la $i$-ésima entrada y que el determinantes es alternante, tenemos que:

\begin{align*}

\det A_i &= \det(C_1,\ldots,C_{i-1},b,C_{i+1},\ldots,C_n)\\

&= \det(C_1,\ldots,C_{i-1},\sum_{j=1}^n x_j C_j,C_{i+1},\ldots,C_n)\\

&=\sum_{j=1}^n x_j \det(C_1,\ldots,C_{i-1},C_j,C_{i+1},\ldots,C_n)\\

&=x_i \det(C_1,\ldots,C_{i-1},C_i,C_{i+1},\ldots,C_n)\\

&=x_i \det A

\end{align*}

Como $A$ es invertible, su determinante no es $0$, de modo que $$x_i=\frac{\det A_i}{\det A},$$ como queríamos.

$\square$

Veamos un ejemplo concreto de la aplicación de las fórmulas de Cramer.

Ejemplo. Consideremos el siguiente sistema de ecuaciones en $\mathbb{R}$ en tres variables:

\begin{align*}

2x+3y-z=1\\

3x-y+2z=0\\

3x+10y-5z=3

\end{align*}

En un ejemplo anterior vimos que la matriz asociada $A=\begin{pmatrix} 2 & 3 & -1\\ 3 & -1 & 2 \\ 3 & 10 & -5\end{pmatrix}$ tiene rango $2$. Se puede verificar que la matriz aumentada $$(A|b)=\begin{pmatrix} 2 & 3 & -1 & 1\\ 3 & -1 & 2 & 0 \\ 3 & 10 & -5 & 3 \end{pmatrix}$$ también tiene rango $2$. Por el teorema de Rouché-Capelli, debe existir una solución al sistema de ecuaciones $AX=b$, y el sistema homogéneo tiene espacio de soluciones de dimensión $3-2=1$.

Como la submatriz de las primeras dos filas y columnas es invertible por tener determinante $2(-1)-(3)(3)=-11\neq 0$, entonces el sistema de ecuaciones original es equivalente al subsistema

\begin{align*}

2x+3y=1+z\\

3x-y=-2z.

\end{align*}

Para encontrar su solución, fijamos una $z$ arbitraria. Usando la regla de Cramer, la solución al sistema

está dada por

\begin{align*}

x&=\frac{\begin{vmatrix} 1+z & 3 \\ -2z & -1 \end{vmatrix}}{-11}=\frac{1-5z}{11}\\

y&=\frac{\begin{vmatrix} 2 & 1+z \\ 3 & -2z \end{vmatrix}}{-11}=\frac{3+7z}{11}.

\end{align*}

De esta forma, las soluciones al sistema original están dadas por $$\left(\frac{1-5z}{11}, \frac{3+7z}{11},z\right)=\left(\frac{1}{11},\frac{3}{11},0\right) + z \left(-\frac{5}{11},\frac{7}{11},1\right).$$

Observa que en efecto el espacio de soluciones del sistema homogéneo es de dimensión $1$, pues está generado por el vector $$\left(-\frac{5}{11},\frac{7}{11},1\right),$$ y que todas las soluciones al sistema original son una de estas soluciones, más la solución particular $$\left(\frac{1}{11},\frac{3}{11},0\right).$$

$\square$

Para terminar, veamos un ejemplo muy sencillo de cómo usar las fórmulas de Cramer en un sistema de ecuaciones de $2\times 2$ con un parámetro $\theta$. La intepretación geométrica del siguiente sistema de ecuaciones es «encuentra el punto $(x,y)$ del plano tal que al rotarse en $\theta$ alrededor del origen, llega al punto $(a,b)$ » .

Problema. Sea $a,b,\theta$ números reales. Encuentra las soluciones $x,y$ al sistema de ecuaciones

\begin{align*}

x \cos \theta – y \sin \theta = a\\

x \sin \theta + y \cos \theta = b.

\end{align*}

Solución. La matriz asociada al sistema es $$A=\begin{pmatrix} \cos \theta & -\sin\theta \\ \sin \theta & \cos \theta\end{pmatrix}$$ que tiene determinante $$\det A = \cos ^2 \theta + \sin^2 \theta = 1.$$

De acuerdo al teorema de Cramer, las soluciones al sistema están dadas por:

\begin{align*}

x&=\frac{\begin{vmatrix}a & -\sin \theta\\ b & \cos \theta \end{vmatrix}}{\det A} = a\cos \theta + b\sin \theta\\

y&=\frac{\begin{vmatrix}\cos \theta & a \\ \sin \theta & b \end{vmatrix}}{\det A} = b\cos \theta – a\sin \theta.

\end{align*}

$\triangle$

Hay herramientas en línea que te permiten ver de manera interactiva cómo usar las fórmulas de Cramer para sistemas de ecuaciones en los reales. Una de ellas es el Cramer’s Rule Calculator de matrix RESHISH, en donde puedes ver la solución por pasos para ejemplos que tú fijes.

Más adelante…

En esta entrada volvimos a hablar de sistemas de ecuaciones lineales, pero ahora que ya sabemos determinantes, pudimos verlo con un enfoque diferente al que habíamos utilizado para abordar el tema en la primera unidad. También hablamos de la regla de Cramer, una herramienta muy poderosa cuando estamos intentando resolver sistemas de ecuaciones.

Ahora, vamos a ver cómo se usa lo que vimos en esta entrada resolviendo varios ejemplos. Después, empezaremos a abordar el tema de eigenvalores y eigenvectores.

Tarea moral

A continuación hay algunos ejercicios para que practiques los conceptos vistos en esta entrada. Te será de mucha utilidad intentarlos para entender más la teoría vista.

- Determina el rango de la matriz $$A=\begin{pmatrix} 2 & 0 & -1 \\ 3 & -2 & 4 \\ 5 & -2 & 3 \\ -1 & 2 & -5 \end{pmatrix}.$$

- Para la matriz $A$ del inciso anterior, resuelve los sistemas de ecuaciones lineales $AX=\begin{pmatrix}5\\8\\3\\2\end{pmatrix}$ y $AX=\begin{pmatrix}5\\8\\13\\-3\end{pmatrix}$.

- Verifica que la matriz aumentada en el último ejemplo en efecto tiene rango $2$.

- Muestra que si $A$ es una matriz en $M_n(\mathbb{R})$ con entradas enteras y de determinante $1$, y $b$ es un vector en $R^n$ con entradas enteras, entonces la solución $X$ del sistema de ecuaciones $AX=b$ tiene entradas enteras.

- ¿Cómo puedes usar la regla de Cramer para encontrar la inversa de una matriz invertible $A$?

- Considera un sistema de ecuaciones con coeficientes en un campo $F_1$ y una extensión de campo $F_2$. Muestra que si el sistema tiene una solución en $F_2$, entonces también tiene una solución en $F_1$.

Entradas relacionadas

- Ir a Álgebra Lineal I

- Entrada anterior del curso: Problemas de cálculo de determinantes

- Siguiente entrada del curso: Problemas de determinantes y ecuaciones lineales

Agradecimientos

Trabajo realizado con el apoyo del Programa UNAM-DGAPA-PAPIME PE104721 «Hacia una modalidad a distancia de la Licenciatura en Matemáticas de la FC-UNAM»