(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

INTRODUCCIÓN

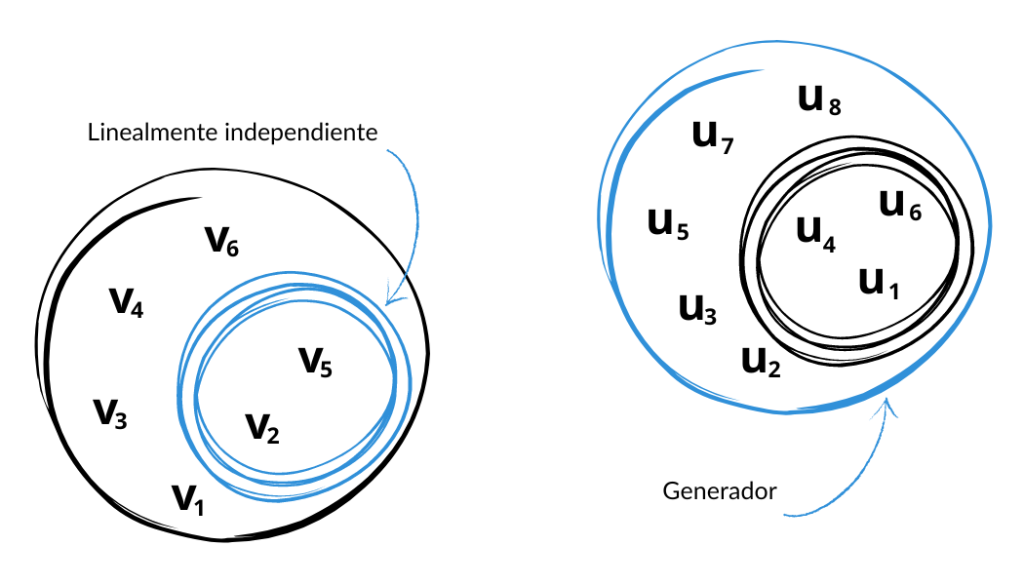

Hemos estudiado a los conjuntos generadores y a los conjuntos linealmente independientes. Los conjuntos generadores son útiles porque nos permiten describir a todo vector del espacio en términos sólo de los vectores del conjunto generador. Por otro lado los conjuntos linealmente independientes son importante porque no tienen vectores que se escriban como combinación lineal de los demás por lo que intuitivamente no contienen información redundante. Será conveniente entonces considerar conjuntos de vectores que sean generadores y linealmente independientes al mismo tiempo y a éstos les llamaremos bases. Además la cardinalidad de un conjunto que cumpla ambas características se vuelve relevante.

De acuerdo a lo que hemos observado en $\mathbb{R}^3$ sabemos que sucede lo siguiente:

1) De todo subconjunto linealmente dependiente que genere podemos encontrar un subconjunto propio linealmente independiente que siga generando.

2) A todo subconjunto de $V$ linealmente independiente podemos agregarle elementos de $V$ hasta crear un conjunto generador de $V$ que siga siendo linealmente independiente.

Estudiaremos a continuación lo que es una base: un conjunto lo «suficientemente grande» para generar al espacio y lo «suficientemente pequeño» para ser linealmente independiente.

BASE DE UN ESPACIO VECTORIAL

Definición: Sean $V$ un $K$ – espacio vectorial, $B\subseteq V$. Decimos que $B$ es una base de $V$ si genera a $V$ y es linealmente independiente. Además, decimos que $V$ es de dimensión finita si tiene una base finita.

Ejemplos

- Sea $K$ un campo.

Consideremos las $n$-adas $e_1=(1_K,0_K,0_K,0_K,…,0_K,0_K), e_2=(0_K,1_K,0_K,0_K,…,0_K,0_K),$ $…,e_n=(0_K,0_K,0_K,0_K,…,0_K,1_K)$. El conjunto $\{ e_1,e_2,…,e_n\}$ es una base de $K^n$.

Justificación. Como $B =\{e_1,e_2,…,e_n\}$ es l.i., sólo falta ver que $\langle B\rangle =K^n$.

Sabemos que $K^n$ es un espacio vectorial y cada $e_i\in K^n$, entonces $\langle B\rangle\subseteq K^n$.

Ahora bien, sea $(x_1,x_2,…,x_n)\in K^n$.

Es claro que $(x_1,x_2,…,x_n)=x_1e_1+x_2e_2+…+x_ne_n\in\langle B\rangle$.

De donde $K^n\subseteq\langle B\rangle$.

$\therefore\langle B\rangle =K^n.$

- Sea $W=\{(x,y,z)\in\mathbb{R}^3|x-y+2z=0\}$ que es un subespacio de $\mathbb{R}^3$.

Tenemos que $1-1+2(0)=0$ y $-2-0+2(1)=0$, entonces $(1,1,0),(-2,0,1)\in W$.

Resulta que $\{(1,1,0),(-2,0,1)\}$ es una base de $W$.

Justificación. Primero veamos que $B =\{(1,1,0),(-2,0,1)\}$ es l.i.

Sean $\lambda_1,\lambda_2\in\mathbb{R}$ tales que $\lambda_1(1,1,0)+\lambda_2(-2,0,1)=(0,0,0)$.

Entonces, $(\lambda_1-2\lambda_2,\lambda_1,\lambda_2)=(0,0,0)$.

Inmediatamente se concluye de lo anterior que $\lambda_1=\lambda_2=0$.

$\therefore B$ es l.i.

Como $W$ es un subespacio y $(1,1,0),(-2,0,1)\in W$, entonces $\langle B\rangle\subseteq W$.

Ahora bien, sea $(x,y,z)\in W$.

Por definición de $W$ tenemos que $x=y-2z$, y en consecuencia $(x,y,z)=(y-2z,y,z)$.

Es claro que $(x,y,z)=(y-2z,y,z)=y(1,1,0)+z(-2,0,1)\in\langle B\rangle$.

Así, $W\subseteq\langle B\rangle$.

$\therefore\langle B\rangle.$

Proposición (1.9.1.): Sea $V$ un $K$ – espacio vectorial. Si $V$ tiene un conjunto generador finito, entonces $V$ tiene una base finita.

Demostración: Sea $S=\{v_1,v_2,…,v_n\}$ un conjunto generador finito de $V$.

Caso 1. $S$ es l.i.

Entonces $S$ es una base finita de $V$.

Caso 2. $S$ es l.d.

Por el lema de dependencia lineal existe $v_{j_1}\in S$ tal que $\langle S\setminus\{v_{j_1}\}\rangle =\langle S\rangle $. Así, podemos definir el siguiente conjunto:

$S_1=S\setminus\{v_{j_1}\}$ donde $j_1\in\{1,2,…,n\}$ y $\langle S\setminus\{v_{j_1}\}\rangle =\langle S\rangle =V.$

Si $S_1$ es l.i., entonces $S_1$ es una base finita de $V$.

Si $S_1$ es l.d., entonces repetimos el proceso. Observemos que de esta forma vamos encontrando $S_1, S_2, \dots$ subconjuntos de $S$ con $n-1,n-2,\dots$ elementos respectivamente, tales que $\langle S_i \rangle =\langle S\rangle =V$ para toda $i=1,2,\dots$. Este proceso es finito ya que $S$ lo es y termina después de a lo más $n$ pasos. El proceso termina en el momento en que encontramos un $S_t$ con $t\in\{1,\dots ,n\}$ subconjunto de $S$ tal que $S_t$ es l.i. y por la forma en que se construyeron los subconjuntos de $S$ en este proceso se tiene además que $\langle S_t \rangle =\langle S\rangle =V$.

Tenemos entonces que $S_t$ es una base finita de $V$.

Corolario (1.9.2.): Sea $V$ un $K$ – espacio vectorial. $V$ tiene un conjunto generador finito si y sólo si $V$ es de dimensión finita.

Demostración: $\Rightarrow )$ Se cumple por el teorema anterior y la definición de espacio vectorial de dimensión finita.

$\Leftarrow )$ Por definición de espacio vectorial de dimensión finita, existe una base finita, es decir, un conjunto l.i. generador de cardinalidad finita, en particular esta base es un conjunto generador finito.

Observación: Si un $V$ espacio vectorial es de dimensión finita, entonces todo conjunto l.i. es finito.

Teorema (1.9.3.): Sea $V$ un $K$ – espacio vectorial de dimensión finita. Todas las bases de $V$ son finitas y tienen el mismo número de elementos.

Demostración: Por la observación previa tenemos que todas las bases de $V$ son finitas, pues en particular son conjuntos l.i. Veamos que todas tienen la misma cardinalidad.

Sean $B_1$ y $B_2$ bases de $V$, que son finitas por lo antes mencionado.

Por definición de bases tenemos:

a) $B_1$ es l.i., b) $B_1$ es generador de $V$, c) $B_2$ es l.i., d) $B_2$ es generador de $V$.

Recordando la relación entre conjuntos linealmente independientes y conjuntos generadores tenemos que:

a) y d) implican que $|B_1|\leq |B_2|$,

b) y c) implican que $|B_2|\leq |B_1|$.

$\therefore |B_1|=|B_2|.$

A lo largo de esta entrada hemos logrado concluir que, si bien las bases no son únicas, su cardinalidad (en el caso de espacios de dimensión finita) sí es única.

DIMENSIÓN DE UN ESPACIO VECTORIAL

Definición: Sea $V$ un $K$ – espacio vectorial de dimensión finita. Decimos que la dimensión de $V$ es la cardinalidad de cualquiera de sus bases. Se denota como $dim_K V$.

Ejemplos

- Sea $W=\langle 2-x+5x^2,3-2x^2,7-2x+8x^2\rangle\leq\mathcal{P}_2[\mathbb{R}]$.

Tenemos que $dim_{\mathbb{R}}W=2$.

Justificación. Primero describamos los elementos de $V$ como combinaciones lineales de los vectores del conjunto generador.

Sea $a+bx+cx^2 \in V$. Entonces existen $\lambda,\mu,\nu\in\mathbb{R}$ tales que $\lambda (2-x+5x^2) + \mu (3-2x^2) + \nu (7-2x+8x^2)=a+bx+cx^2$

Entonces $(2\lambda + 3\mu +7\nu) + (-\lambda – 2\nu)x + (5\lambda – 2\mu + 8\nu)x^2=a+bx+cx^2$. Por lo tanto:

\begin{align*}2\lambda + 3\mu +7\nu&=a\\

-\lambda – 2\nu&=b\\

5\lambda – 2\mu + 8\nu&=c.\end{align*}

Tenemos entonces:

$\left( \begin{array}{rrr|r} 2 & 3 & 7 & a \\ -1 & 0 & -2 & b\\

5 & -2 & 8 & c \end{array} \right)$$~\left( \begin{array}{rrr|r} -1 & 0 & -2 & b \\ 0 & 3 & 3 & a+2b\\ 0 & -2 & -2 & c+5b \end{array} \right)$$~\left( \begin{array}{rrr|r} -1 & 0 & -2 & b \\ 0 & 1 & 1 & \frac{1}{3}(a+2b)\\ 0 & 1 & 1 & -\frac{1}{2}(c+5b) \end{array} \right)$$~\left( \begin{array}{rrr|r} -1 & 0 & -2 & b \\ 0 & 1 & 1 & \frac{1}{3}(a+2b)\\ 0 & 0 & 0 & -\frac{1}{2}(c+5b) -\frac{1}{3}(a+2b) \end{array} \right)$

Así, $0=-\frac{1}{2}(c+5b) -\frac{1}{3}(a+2b)$.

Y esto ocurre si y sólo si $0=2a+19b+3c$.

Por lo tanto, $a=-\frac{19}{2}b-\frac{3}{2}c$.

$W=\{ a+bx+cx^2 \in \mathcal{P}_2(\mathbb{R})| a=-\frac{19}{2}b-\frac{3}{2}c \}$$=\{ (-\frac{19}{2}b-\frac{3}{2}c)+bx+cx^2\in \mathcal{P}_2(\mathbb{R})| b,c\in\mathbb{R} \}$$=\{ b(-19+x)+c(-1+x^2)|b,c\in\mathbb{R} \}$$=\langle -19+x,-1+x^2 \rangle$.

Se puede verificar que $\{ -19+x,-1+x^2 \}$ es linealmente independiente y claramente genera a $W$, entonces es una base de $W$.

Por lo tanto, $dim_{\mathbb{R}}W=2$.

Tarea Moral

- Determina cuáles de los siguiente conjuntos son bases para $\mathbb{R}^3$:

a) $\{ (1, 0, -1), (2,5,1), (0,-4,3) \}$

b) $\{ (1,-3,-2), (-3,1,3), (-2,-10,-2) \}$

c) $\{ (-1,3,1), (2,-4,-3), (-3,8,2) \}$ - Sea $V$ un espacio vectorial con base $\gamma$. Demuestra que si $\gamma = \{ e_1,e_2,…,e_n \}$, entonces $\{e_1,e_1+e_2,…,e_1+e_2+…+e_n\}$ también es base de $V$.

Más adelante…

Partiendo de cualquier espacio vectorial de dimensión finita $V$, veremos cómo obtener bases. Además analizaremos qué relación hay entre: a) la dimensión de $V$ y las dimensiones de sus subespacios y b) la base de $V$ y las bases de sus subespacios.

Entradas relacionadas

- Ir a Álgebra Lineal I

- Entrada anterior del curso: 1.8. CONJUNTOS LINEALMENTE (IN)DEPENDIENTES Y CONJUNTOS GENERADORES: relación entre sí

- Siguiente entrada del curso: 1.10. BASE DE ESPACIOS VECTORIALES: obtención a partir de un conjunto linealmente independiente o generador