(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

INTRODUCCIÓN

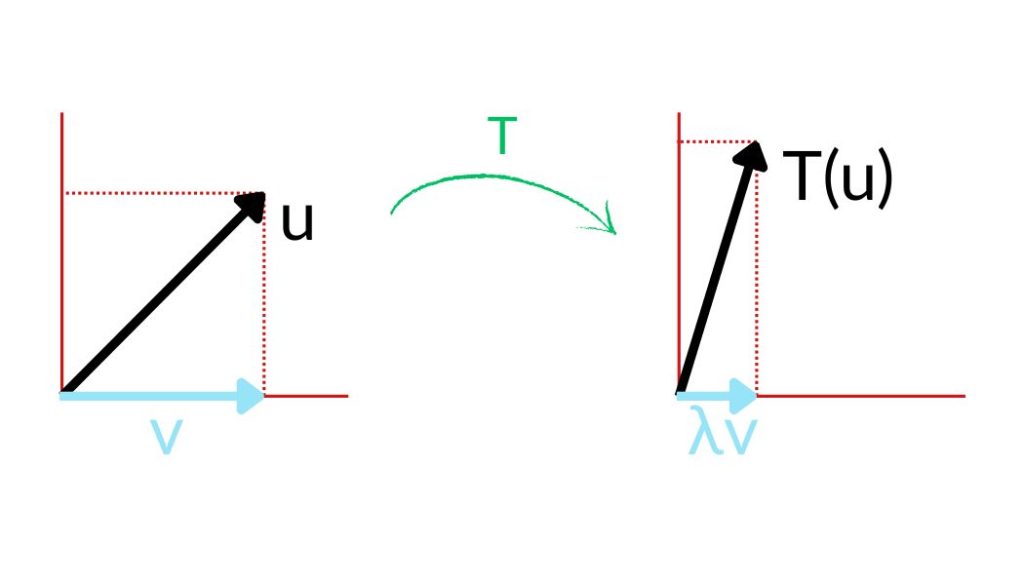

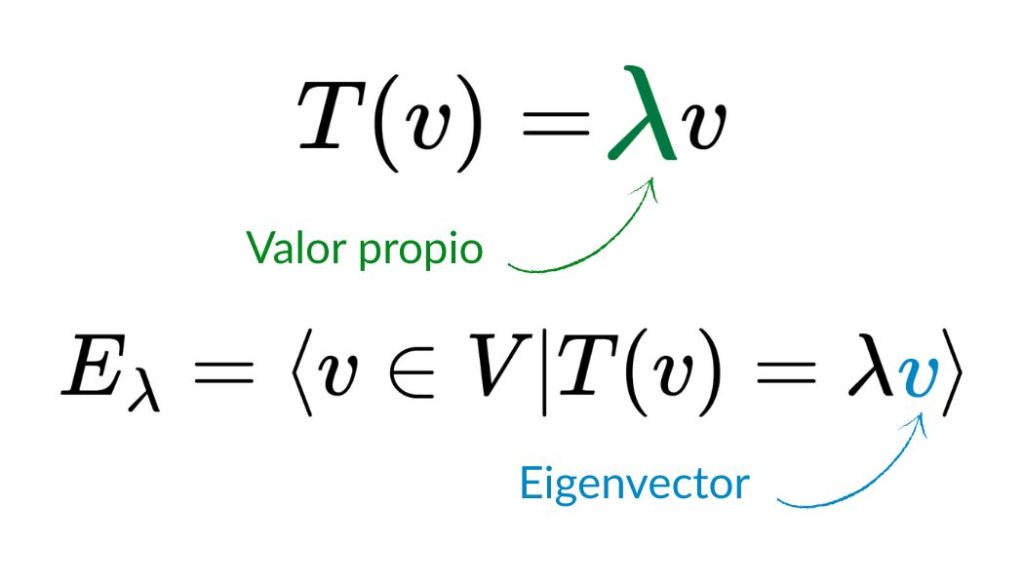

Estudiaremos cómo el hecho de que una matriz real simétrica tenga valores propios reales garantiza la existencia de vectores propios con entradas reales y cómo la simetría preserva la ortogonalidad bajo la acción del operador.

Pero lo más importante es que veremos el teorema espectral para operadores simétricos, el cual no solo revela una estructura profunda en los operadores definidos sobre espacios con producto interno, sino que también conecta elegantemente conceptos clave como valores y vectores propios, ortogonalidad y diagonalización. Veremos cómo, bajo condiciones de simetría, es posible encontrar una base ortogonal compuesta exclusivamente por vectores propios, lo que tiene aplicaciones directas en la física, la ingeniería y la ciencias de datos.

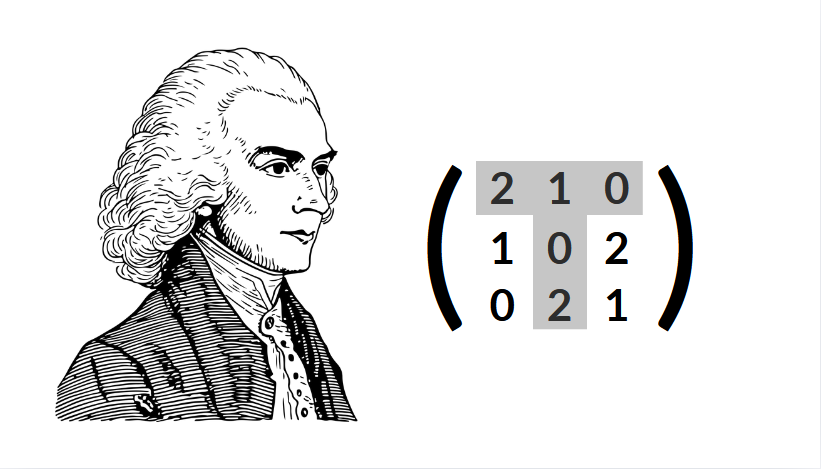

Teorema (5.7.1.): Sean $A \in \mathcal{M}_{n \times n} (\mathbb{R})$ una matriz simétrica y $T \in \mathcal{L}(\mathbb{C}^n , \mathbb{C}^n)$ dado por $T(X) = AX$ para toda $X \in \mathbb{C}^n$ . Entonces $T$ tiene un vector propio no nulo con entradas reales.

Demostración: Sean $A \in \mathcal{M}_{n \times n} (\mathbb{R})$ tal que $A^t = A$ y $T \in \mathcal{L}(\mathbb{C}^n , \mathbb{C}^n)$ dado por $T(X) = AX$ para toda $X \in \mathbb{C}^n$.

Sabemos por el (teorema 5.6.1.) que $T$ tiene un valor propio $\lambda$ que, por el teorema (5.6.3.), es real.

Sea $Z$ un vector propio de $T$ no nulo asociado a $\lambda$, escribamos $Z = X + iY$ con $X,Y \in \mathbb{R}^n$. Entonces, $AZ = A(X + iY) = AX + iAY.$ Por otro lado, $AZ = T(Z) = \lambda Z = \lambda (X + iY) = \lambda X + i \lambda Y.$

Igualando parte reales y partes imaginarias $AX = \lambda X$ y $AY = \lambda Y$. Así, $X , Y$ son vectores propios de $T$ asociados a $\lambda$ y como $Z$ es no nulo, entonces al menos uno de $X$ o $Y$ es no nulo y es entonces un vector propio no nulo de $T$ con entradas reales.

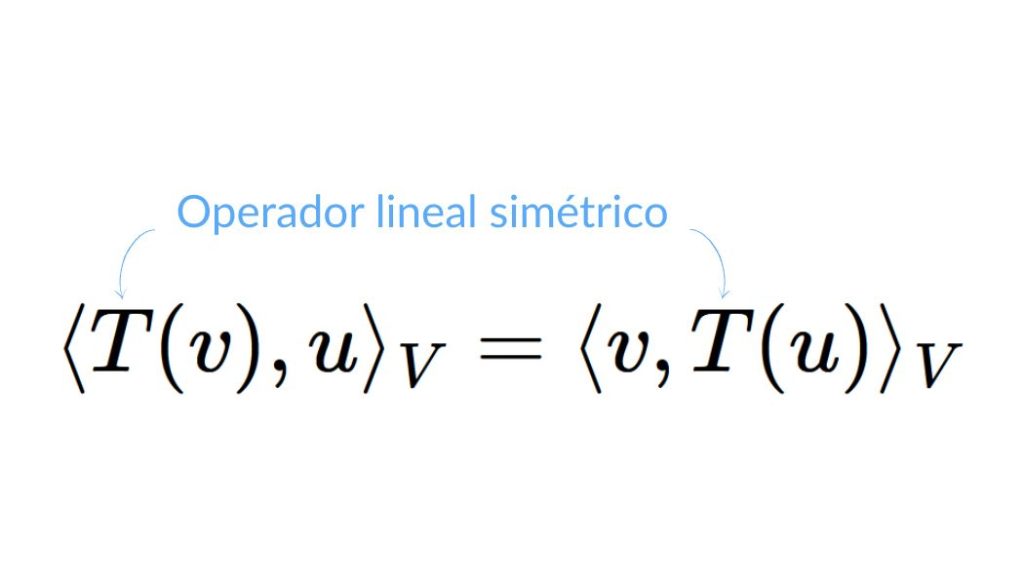

OPERADOR LINEAL SIMÉTRICO

Definición: Sea $V$ un $\mathbb{R}$-espacio vectorial con un producto interno $\langle\, ,\, \rangle_V$ y $T \in \mathcal{L} (V,V)$. Decimos que $T$ es simétrico si $\langle T(v) , u \rangle_V = \langle v , T(u) \rangle_V$ para todo $u,v \in V.$

Corolario (5.7.2.): Sea $V$ un $\mathbb{R}$-espacio vectorial de dimensión finita con un producto interno. Sea $T \in \mathcal{L} (V,V)$, $B$ una base ortonormal de $V$ y $A = \lceil T \rceil_{B}^{B}.$

Si $T$ es simétrico, entonces $A^t = A$ y $T$ tiene un vector propio no nulo en $V.$

Demostración: Sea $V$ un $\mathbb{R}$-espacio vectorial de dimensión finita $n$ con un producto interno $\langle\, ,\, \rangle_V$ y $B = (v_1 , … , v_n)$ base ordenada ortonormal de $V$ (que existe gracias al teorema (4.6.1.)).

Sean $w,u \in V$. Tenemos que $w = \lambda_1 v_1 + … + \lambda_n v_n$ y $u = \mu_1 v_1 + … + \mu_n v_n$ para algunos $\lambda_1 ,\dots , \lambda_n ,\mu_1 ,\dots ,\mu_n\in\mathbb{R}.$ Entonces,

$\langle w , u \rangle_V = \langle \displaystyle \sum_{i=1}^{n} \lambda_i v_i , \displaystyle \sum_{i=1}^{n} \mu_i v_i \rangle_V$ $= \lambda_1 \mu_1 + … + \lambda_n \mu_n = \langle [w]_{\beta} , [u]_{\beta} \rangle$ con el producto usual de $\mathbb{R}^n$.

En particular, para $w=T(v_i)$ y $u=v_j$ tenemos que $\langle T(v_i) , v_j \rangle_V$ $= \langle [T(v_i)]_{B} , [v_j]_{B} \rangle$ $= \langle [T]_{B}^{B} [v_i]_{B} , [v_j]_{B} \rangle$ y para $w=v_j$ y $u=T(v_i)$ tenemos que $\langle v_j , T(v_i) \rangle_V = $ $=\langle [v_j]_{B} , [T(v_i)]_{B} \rangle$$=\langle [v_j]_{B} , [T]_{B}^{B} [v_i]_{B} \rangle$.

Sea $A = [T]_{B}^{B}$. Entonces $\langle T(v_i) , v_j \rangle_V =\langle [T]_{B}^{B} [v_i]_{B} , [v_j]_{B} \rangle$ $=\langle A e_i , e_j \rangle = A_{ij}$ y $\langle v_j , T(v_i) \rangle_V = \langle [v_j]_{B} , [T]_{B}^{B} [v_i]_{B} \rangle$ $=\langle e_j , Ae_i \rangle = A_{ji}.$

Pero como $T$ es simétrico tenemos que $\langle T(v_j) , v_i \rangle = \langle v_j , T(v_i) \rangle $ y como el campo es el de los reales $\langle v_j , T(v_i) \rangle = \langle T(v_i) , v_j \rangle$. Entonces, $\langle T(v_j) , v_i \rangle = \langle T(v_i) , v_j \rangle$.

$\therefore A_{ij} = A_{ji}.$

Así, $A = A^t$. Además, al considerar el operador $X \mapsto AX$ para todo $X\in\mathbb{C}^n$, por el teorema anterior existe $Y \in \mathbb{R}^n$ un vector propio de dicho operador no nulo con entradas reales asociado a un valor propio $\lambda \in \mathbb{R}.$

Consideremos el vector $v \in V$ tal que $[v]_{B} = Y$. Entonces, $[T(v)]_{B} = [T]_{B}^{B} [v]_{B}$ $= AY = \lambda Y$ $= \lambda [v]_{B} = [\lambda v]_{B}.$

$\therefore T(v) = \lambda v$.

Concluimos que y $v$ un vector propio no nulo de $T$.

Observación: Sea $V$ un $\mathbb{R}$-espacio vectorial con producto interno y $T \in \mathcal{L} (V,V)$ un operador simétrico.

Si $v \in \mathbb{R}^n$ es un vector propio de $T$ y $w \in \mathbb{R}^n$ es ortogonal a $v$, entonces $T(w)$ también es ortogonal a $v.$

Justificación. Sea $v \in \mathbb{R}^n$ un vector propio de $T$ asociado a $\lambda$ y $w \in \mathbb{R}^n$ tal que $\langle v,w \rangle = 0.$

$\langle v , T(w) \rangle = \langle T(v) , w \rangle$ $= \langle \lambda v , w \rangle = \lambda \langle v , w \rangle$ $= \lambda (0) = 0.$

$\therefore T(w)$ es ortogonal a $v$.

Teorema espectral para operadores simétricos (5.7.3.): Sean $V$ un $\mathbb{R}$-espacio vectorial con producto interno de dimensión finita y $T \in \mathcal{L} (V,V)$ un operador simétrico.

Entonces existe una base ortogonal de $V$ formada por vectores propios de $T.$

Demostración: Sean $V$ un $\mathbb{R}$-espacio vectorial con producto interno de dimensión finita $n$ y $T \in \mathcal{L} (V,V)$ un operador simétrico. Hagamos inducción sobre $n.$

Para $n = 1$:

Consideremos $B = (v)$ es una base de $T$. Como $T(v)\in V=\langle v \rangle$ tenemos que $T(v) = \lambda v$ para alguna $\lambda \in \mathbb{R}$ y así $v$ es un vector propio de $T$ asociado a $\lambda$.

Sea $V$ de dimensión $n+1$.

Hipótesis de inducción:

Supongamos que si $W$ es un $\mathbb{R}$-espacio vectorial con producto interno de dimensión finita $n$ y $S \in \mathcal{L} (W,W)$ es un operador simétrico, entonces existe una base ortogonal de $W$ formada por vectores propios de $S.$

Por el corolario (5.7.2.), tenemos que existe $v \in V$ un vector propio no nulo de $T.$

Sea $W = \{ w \in V | \langle w , v \rangle = 0 \} = \langle v \rangle^{\perp}.$

Sabemos que $n+1 = dim \,V$ $= dim\, \langle v \rangle + dim \,\langle v \rangle^{\perp}$, entonces $dim \,W = dim\, \langle v \rangle^{\perp}$ $= n+1 \,-\, dim \langle v \rangle = n.$

Además, por la observación previa al teorema, $T(w) \in W$ para toda $w \in W$, por lo que podemos considerar el operador $T|_W : W \longrightarrow W$ que es simétrico, pues $T$ lo es.

Por hipótesis de inducción, existe $(w_1 , … , w_n)$ una base ortogonal de $W$ formada por vectores propios de $T|_W$ y por tanto, de $T.$

Como $V = W \oplus W^{\perp}$, se tiene que $(w_1 , … , w_n , v)$ es una base de $V$ y, por construcción, está formada por vectores propios de $T.$

Además, como $w_i \in W = \langle v \rangle^{\perp}$ para toda $i \in \{ 1 , … , n \}$, entonces $\langle w_i , v \rangle = 0$ para toda $i \in \{ 1 , … , n \}.$

Así, $(w_1 , … , w_n , v)$ es una base ortogonal de $V$.

Tarea Moral

- Justifica para cada una de las siguientes transformaciones si son o no simétricas:

a) $T: \mathbb{R}^2 \longrightarrow \mathbb{R}^2$ con $T(x,y) = (2x,y)$

b) $T: \mathbb{R}^3 \longrightarrow \mathbb{R}^3$ con $T(x,y,z) = (x,y,0)$

c) $T: \mathbb{R}^2 \longrightarrow \mathbb{R}^2$ con $T(x,y) = (-y,x)$ - Para cada uno de los casos afirmativos en la pregunta anterior, encuentra una base ortogonal de $V$ formada por vectores propios de $T$.

Más adelante…

Durante este curso construimos una visión cada vez más amplia del álgebra lineal. Fuimos desarrollando herramientas generales como espacios vectoriales, transformaciones lineales, bases, producto interno, determinantes y valores propios.

Vimos que el álgebra lineal no consiste en realizar cálculos. Detrás de cada definición y cada teorema hay una manera de interpretar fenómenos geométricos, físicos y tecnológicos: desde sistemas de ecuaciones y transformaciones del espacio hasta robótica y gráficos por computadora. Las herramientas desarrolladas en este curso forman parte del lenguaje matemático que utilizan muchas áreas modernas de la ciencia.

Esto fue solo el inicio de una etapa más profunda. El recorrido continúa y cada nueva herramienta permitirá observar las matemáticas y el mundo desde una perspectiva aún más completa. Descúbrelo en los demás cursos disponibles.

Entradas relacionadas

- Ir a Álgebra Lineal I

- Entrada anterior del curso: 5.6. POLINOMIO CARACTERÍSTICO Y MATRIZ SIMÉTRICA: definiciones y propiedades de valores propios