Introducción

En la entrada anterior definimos las transformaciones ortogonales y probamos algunas de sus propiedades relacionadas con el producto interior, norma y la transformación adjunta. Vimos también que el conjunto de todas las transformaciones ortogonales de un espacio euclideano $V$ forma un grupo $O(V)$ bajo composición.

En esta entrada queremos entender mucho mejor dicho grupo. El resultado principal que probaremos nos dirá exactamente cómo son todas las posibles transformaciones ortogonales en un espacio euclideano (que podemos pensar que es $\mathbb{R}^n$). Para llegar a este punto, comenzaremos con algunos resultados auxiliares y luego con un lema que nos ayudará a entender a las transformaciones ortogonales en dimensión $2$. Aprovecharemos este lema para probar el resultado para cualquier dimensión.

El lema de los subespacios estables

Lo primero que veremos es que las transformaciones ortogonales preservan completamente los subespacios estables, así como sus espacios ortogonales. Este es el resultado que nos permitirá un poco más adelante trabajar inductivamente.

Lema. Sean $V$ un espacio euclidiano, $T\in O(V)$ y $W$ un subespacio de $V$ estable bajo $T$.

- Se tiene que $T(W)=W$ y $T(W^\bot)=W^\bot$.

- Se tiene que $T|_W\in O(W)$ y $T|_{W^\bot}\in W^\bot$.

Demostración. 1. Como $T(W)\subseteq W$ y $T|_W$ es inyectiva (pues $T$ es inyectiva en $V$), se sigue que $T|_W:W\to W$ es suprayectiva y por lo tanto $T(W)=W$. Veamos ahora que $W^\bot$ también es estable bajo $T$. Tomemos $x\in W^\bot$ y $y\in W$. Queremos demostrar que $T(x)\in W^\bot$, es decir, que $\langle T(x),y \rangle=0$. Como $T$ es ortogonal, entonces $T^*=T^{-1}$ y por lo tanto

$$\langle T(x),y \rangle=\langle x,T^{-1}(y) \rangle.$$

Como $T|_W:W\to W$ es biyectiva, se tiene que $W$ es estable bajo $T^{-1}$. Entonces $T^{-1}(y)\in W$, y como $x\in W^\bot$, entonces $\langle x,T^{-1}(y) \rangle=0$. Por lo tanto $\langle T(x),y \rangle=0$. Esto muestra que $W^\bot$ es estable bajo $T$ y por la primer parte de este inciso, llegamos a $T(W^\bot)=W^\bot$.

2. Para todo $x\in W$ se tiene que

$$||T|_W(x)||=||T(x)||=||x||,$$

lo que significa que $T|_W\in O(W)$. De manera análoga se tiene que $T_{W^\bot}\in O(W^\bot)$.

$\square$

El lema de la invarianza de una recta o un plano

Para poder aplicar el lema de la sección anterior, tendremos que poder encontrar subespacios estables. El siguiente lema nos dice que siempre podemos encontrar subespacios estables en espacios euclideanos.

Lema. Sea $V$ un espacio euclidiano y $T$ una transformación lineal sobre $V$. Entonces existe una recta (subespacio de dimensión $1$) o un plano (subespacio de dimensión $2$) en $V$ estable bajo $T$.

Demostración. El polinomio mínimo de $T$ es un polinomio $\mu_T(x)$ con coeficientes reales. Si tiene una raíz real, se sigue que $T$ tiene un eigenvalor y por consiguiente, la recta generada por un eigenvector es estable bajo $T$.

Ahora supongamos que $\mu_T(x)$ no tiene raíces reales. Sea $z$ una raíz compeja de $\mu_T(x)$, que existe por el teorema fundamental del álgebra. Como $\mu_T(x)$ tiene coeficientes reales, entonces $\overline{z}$ también es raíz de $\mu_T(x)$.Por lo tanto, $Q(x)=(x-z)(x-\overline{z})$ divide a $\mu_T(x)$.

Es imposible que $Q(T)$ sea una matriz invertible, pues de serlo, tendríamos que $\frac{\mu_T}{Q}(x)$ sería un polinomio de grado más chico que $\mu_T(x)$ y anularía a $T$. Esto nos dice que existe $x\in V$ distinto de $0$ tal que $Q(T)(x)=0$. Si $Q(x)=x^2+ax+b$, esto se traduce a $T^2(x)+aT(x)+bx=0$. De aquí, se tiene que $x$ y $T(x)$ generan un plano estable bajo $T$.

$\square$

Las transformaciones ortogonales en dimensión $2$

Los lemas de las secciones anteriores nos permitirán ir partiendo a un espacio euclideano $T$ en «cachitos estables» ya sea de dimensión $1$ o de dimensión $2$. En los de dimensión $1$ ya sabemos cómo debe verse una matriz que represente a $T$: simplemente corresponden a eigenvectores y entonces consistirán en reescalamientos (que deben de ser por factor $1$ ó $-1$ para tener ortogonalidad). Pero, ¿cómo se verá matricialmente la transformación $T$ en subespacios estables de dimensión $2$ que no se puedan descomponer más? Esto es lo que nos responde el siguiente lema.

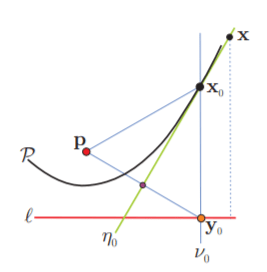

Lema. Sea $V$ un espacio euclidiano de dimensión $2$ y $T\in O(V)$ sin eigenvalores reales. Entonces existe una base ortonormal de $V$ tal que la matriz asociada a $T$ en dicha base es de la forma

$$R_\theta=\begin{pmatrix}

\cos\theta & -\sin\theta\\

\sin\theta & \cos\theta\end{pmatrix}.$$

Demostración. Sea $\beta=\{e_1,e_2\}$ una base ortonormal de $V$ y escribimos $T(e_1)=ae_1+be_2$ para algunos números reales $a,b$. Como

$$a^2+b^2=||T(e_1)||^2=||e_1||^2=1,$$ entonces podemos encontrar un número real $\theta$ tal que $(a,b)=(\cos\theta,\sin\theta)$.

Para que $\langle T(e_1), T(e_2)\rangle = 0$, necesitamos que exista un $c$ tal que $T(e_2)=c(-\sin\theta e_1+\cos \theta e_2)$. Finalmente, ya que $$||T(e_2)||=||e_2||=1, $$ debemos tener $|c|=1$ y así $c\in \{-1,1\}$.

El caso $c=-1$ podemos descartarlo pues la matriz que representa a $T$ en la base $\beta$ sería

$$\begin{pmatrix}

\cos \theta & \sin \theta\\

\sin \theta & -\cos\theta\end{pmatrix},$$

cuyo polinomio caracterísitco es $x^2-1$ y por lo tanto tiene a $1$ como eigenvalor, lo cual no entra en nuestras hipótesis. Así, $c=1$ y por lo tanto la matriz que representa a $T$ en la base $\beta$ es

$$\begin{pmatrix}

\cos\theta & -\sin\theta\\

\sin\theta & \cos\theta\end{pmatrix},$$

como queríamos.

$\square$

El teorema de clasificación

Con lo visto hasta ahora, ya estamos listos para demostrar el teorema fundamental de clasificación de transformaciones lineales ortogonales de un espacio euclidiano.

Teorema (clasificación de ortogonales). Sea $V$ un espacio euclidiano y $T\in O(V)$. Entonces podemos encontrar una base ortonormal $\beta$ de $V$ tal que la matriz asociada a $T$ con respecto a la base $\beta$ es de la forma

\begin{equation}\label{forma}

A=\begin{pmatrix}

I_p & 0 & 0 & \dots & 0\\

0 & -I_q & 0 & \dots & 0\\

0 & 0 & R_{\theta_1} & \dots & 0\\

\vdots & \vdots & \vdots &\ddots & \vdots\\

0 & 0 & 0 &\dots & R_{\theta_k}

\end{pmatrix},\end{equation}

donde $\theta_1,\dots, \theta_k$ son números reales y

$$R_\theta=\begin{pmatrix}

\cos\theta & -\sin\theta\\

\sin\theta & \cos\theta

\end{pmatrix}.$$

Demostración. Procederemos por inducción sobre $\dim V$. Si $\dim V=1$, entonces ya terminamos, pues se tendría que $T=\pm id$ (esto quedó de tarea moral en la entrada anterior).

Supongamos que el resultado se satisface para todos los espacios euclideanos de dimensión a lo más $n-1$. Tomemos $V$ un espacio euclideano de dimensión $n$ y $T$ una transformación ortogonal de $V$. Por el lema de la invarianza de una recta o un plano, o bien $V$ tiene una recta estable bajo $T$, o bien un plano estable bajo $T$.

El caso en que $T$ tiene una recta estable bajo $T$ corresponde a que $T$ tiene un eigenvalor real $t$ con eigenvector, digamos, $e_1$. Entonces $$|t|||e_1||=||te_1||=||T(e_1)||=||e_1||,$$

por lo cual $t\in\{-1,1\}$. Sea $W$ la recta generada por $e_1$.

Tenemos que $V=W\oplus W^\bot$. Por el lema de subespacios estables, $T(W)=W$ y $T|_{W^\bot}$ es ortogonal de $W^\bot$. Por hipótesis inductiva, $W^\bot$ tiene una base ortonormal $\{e_2,\dots , e_n\}$ tal que la matriz asociada a dicha base y restringida a $W^\bot$ es de la forma \eqref{forma}. Añadiendo el vector $\frac{e_1}{||e_1||}$ se añade un $1$ o $-1$ en la diagonal, así que, posiblemente permutando la base ortonormal resultante $\{\frac{e_1}{||e_1||},e_2,\dots ,e_n\}$ de $V$ obtenemos una base ortonormal tal que la matriz asociada a $T$ con respecto a esta base es de la forma \eqref{forma}.

Ahora supongamos que $T$ no tiene valores propios reales, es decir, que estamos en el caso de tener un plano estable bajo $T$. Como $T$ es ortogonal, el espacio $W^\bot$ también es estable bajo $T$, y las restricciones de $T$ a $W$ y $W^\bot$ son transformaciones otogonales sobre estos espacios. Por hipótesis inductiva, $W^\bot$ tiene una base ortonormal $\{e_3,\dots,e_n\}$ tal que la matriz asociada a $T|_{W^\bot}$ con respecto a esta base es una matriz diagonal de bloques de la forma $R_{\theta_i}$. Por el lema de transformaciones ortogonales en dimensión $2$, el subespacio $W$ tiene una base ortonormla $\{e_1,e_2\}$ tal que la matriz asociada a $T|_W$ con respecto a esta base es de la forma $R_\theta$. Como $V=W\oplus W^\bot$, entonces la matriz asociada a $T$ con respecto a la base $\{e_1,\dots, e_n\}$ es de la forma \eqref{forma}, con lo cual concluimos con la prueba deseada.

$\square$

También podemos enunciar el teorema anterior en términos de matrices:

Corolario. Sea $A\in M_n(\mathbb{R})$ una matriz ortogonal. Entonces existen enteros $p,q,k$ que satisfacen $p+q+2k=n$, una matriz ortogonal $P\in M_n(\mathbb{R})$ y números reales $\theta_1,\dots , \theta_n$ tales que

$$A=P^{-1}\begin{pmatrix}

I_p & 0 & 0 & \dots & 0\\

0 & -I_q & 0 & \dots & 0\\

0 & 0 & R_{\theta_1} & \dots & 0\\

\vdots & \vdots & \vdots &\ddots & \vdots\\

0 & 0 & 0 &\dots & R_{\theta_k}

\end{pmatrix}P.$$

Observación. El determinante de la matriz

$$\begin{pmatrix}

I_p & 0 & 0 & \dots & 0\\

0 & -I_q & 0 & \dots & 0\\

0 & 0 & R_{\theta_1} & \dots & 0\\

\vdots & \vdots & \vdots &\ddots & \vdots\\

0 & 0 & 0 &\dots & R_{\theta_k}

\end{pmatrix}$$

es $(-1)^q\in\{1,-1\}$ (estamos usando $\det R_{\theta_i}=1$ para $1\leq i\leq k$). Se sigue que $$\det T\in\{-1,1\}$$ para cualquier $T\in O(V)$.

Más adelante…

Por lo platicado en esta entrada, ya podemos decir cómo es cualquier transformación ortogonal, y no es tan complicado: simplemente en alguna base apropiada, se rota en pares de coordenadas, o bien se refleja en coordenadas, o bien no se hace nada en alguna coordenada (o una combinación de estas cosas). Todo esto intuitivamente deja fijas las normas y el teorema de clasificación nos dice que si se fijan normas entonces debe ser así. Por ello, podemos pensar a las transformaciones ortonormales como «sencillas» o por lo menos «entendibles».

Aprovecharemos esto en el siguiente tema, pues enunciaremos el teorema espectral real, que nos dice que las transformaciones simétricas se entienden muy bien a partir de las ortogonales y de las diagonales. Así, las transformaciones simétricas también serán «entendibles». Finalmente, con el teorema de descomposición polar llevaremos este entendimiento a todas, todas las matrices.

Tarea moral

- Verifica que, en efecto, las matrices $R_\theta$ de la entrada tienen determinante igual a $1$.

- Sea $V$ un espacio euclidiano y $T:V\to V$ una transformación lineal. Demuestra que $T$ es ortogonal si y sólo si $||T(x)||=||x||$ para los vectores $x$ de norma $1$.

- Encuentra la matriz de rotación de ángulo $\frac{\pi}{3}$ alrededor de la recta generada por el vector $(1,1,1)$.

- Describe todas las matrices en $M_3(\mathbb{R})$ que son simultaneamente ortogonales y diagonales.

- Describe todas las matrices en $M_3(\mathbb{R})$ que sean simultáneamente ortogonales y triangulares superiores.

Entradas relacionadas

- Ir a Álgebra Lineal II

- Entrada anterior del curso: Isometrías reales, transformaciones ortogonales y sus propiedades

- Siguiente entrada del curso: El teorema espectral real

Agradecimientos

Trabajo realizado con el apoyo del Programa UNAM-DGAPA-PAPIME PE109323 «Hacia una modalidad a distancia de la Licenciatura en Matemáticas de la FC-UNAM – Etapa 3»