(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

INTRODUCCIÓN

Hasta ahora, hemos trabajado en un mundo donde los vectores son entidades que podemos sumar, escalar, medir y descomponer. Nos hemos enfocado en sus relaciones internas, su dirección, su longitud y su interacción con otros vectores mediante el producto interno. Pero ahora damos un paso distinto: dejamos de mirar a los vectores como objetos para pasar a preguntarnos cómo se les puede “evaluar”. En otras palabras, comenzamos a interesarnos por las acciones lineales que se aplican sobre vectores, aquellas que, dado un vector, nos devuelven un número. ¿Quiénes son esas acciones? Son los funcionales lineales que juntos forman un nuevo espacio vectorial: el espacio dual.

Este cambio de perspectiva nos permitirá ver los espacios vectoriales desde una dimensión más profunda. Construiremos funciones que «leen» a los vectores, aprenderemos a asociar a cada base una base dual y veremos que incluso podemos regresar al espacio original desde el dual del dual. ¿Te has preguntado si un espacio puede ser “observado” desde fuera para entender toda su estructura? Hoy empezamos a explorar eso. El espacio dual no es solo una curiosidad abstracta: es una herramienta esencial para entender la simetría, el lenguaje de coordenadas, las transformaciones y mucho más. En este nuevo terreno, cada vector deja de ser solo una flecha… y se convierte también en algo que puede ser interpretado.

ESPACIO DUAL

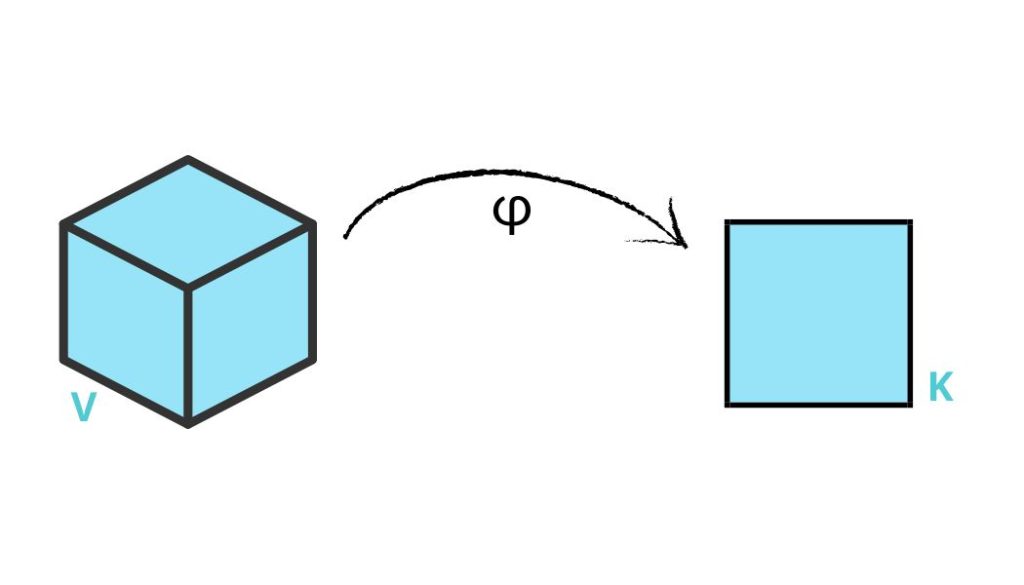

Definición: Sea $V$ un $K$ – espacio vectorial. El espacio dual de $V$ es $V^* = \{ \varphi : V \longrightarrow K | \varphi \text{ es lineal} \}$

A los elementos de $V^*$ se les llama funcionales.

Teorema (4.9.1.): Sea $V$ un $K$ – espacio vectorial de dimensión finita. Entonces $V \cong V^*$.

Demostración: Sea $V$ un $K$ – espacio vectorial de dimensión finita. Por definición $\varphi = \mathcal{L} (V,K).$ Dado que $V$ y $K$ son espacios de dimensión finita, por el corolario (3.5.3) de la entrada 3.5 tenemos que $\varphi = \mathcal{L} (V,K)$ también es de dimensión finita y

$\dim_K V^* = \dim_K \mathcal{L} (V,K)$ $= \dim_K V \cdot \dim_K K$ $= dim_K V.$

Así, tenemos que $V^*$ también es de dimensión finita y tiene la misma dimensión que $V$. Finalmente, por el teorema (2.7.3) de la entrada 2.7 concluimos que $ V \cong V^*$.

Nota: Si queremos construir una base de $V^*$ a partir de una base de $V$ procedemos de la siguiente forma:

Sea $V$ un $K$ – espacio vectorial de dimensión finita.

Consideremos $B= (v_1 , … , v_n)$ una base ordenada de $V$.

Por el teorema (3.5.2) de la entrada 3.5 sabemos que $V^* = \mathcal{L} (V,K) \cong \mathcal{M}_{1 \times n} (K)$ mediante el isomorfismo $F:\mathcal{L} (V,K) \rightarrow \mathcal{M}_{1 \times n} (K)$ que asigna a cada $T \in \mathcal{L} (V,K)$ la matriz $[T ]_{B}^{\Gamma}$ con $\Gamma = (1)$ la base canónica de $K$, es decir, tal que $F(T)=[T]_{B}^{\Gamma} $.

Sabemos que $( e_1 , … , e_n )=( (1 \, 0 \, … \, 0) , … , (0 \, … \, 0 \, 1) )$ es la base canónica de $\mathcal{M}_{1 \times n} (K)$ y bajo el isomorfismo descrito debe provenir de una base $( \varphi_1 , … , \varphi_n )$ de $\mathcal{L}(V,K)$, es decir, existe una base $( \varphi_1 , … , \varphi_n )$ de $\mathcal{L}(V,K)$ tal que $F(\varphi_i)=[\varphi_i ]_{B}^{\Gamma}$ es el $i$-ésimo vector de la base canónica de $\mathcal{M}_{1 \times n} (K)$, esto es $[\varphi_i ]_{B}^{\Gamma}=e_i.$

Pero de acuerdo a la forma en que se construye la matrIz asociada a una transformación, lo anterior nos indica que

$\varphi_i (v_j) = \begin{cases} 1,\;j=i \\ 0, \;j \not= i. \end{cases}$

La base $(\varphi_1 , … , \varphi_n)$ de $V^*$ se llamada la base dual de $B$ y se denota por $B^*$.

Ejemplo

- Sea $B = ( (3,4) , (1,5) )$ una base ordenada de $\mathbb{R}^2.$

La base dual es $B^* = ( \varphi_1 , \varphi_2 )$ donde para cualquier $(x,y) \in \mathbb{R}^2$ se tiene que $\varphi_1 (x,y) = \frac{5}{11} x \;-\; \frac{1}{11} y$, $\;\varphi_2 (x,y) = – \frac{4}{11} x \;+\; \frac{3}{11} y.$

Justificación. Dada $B = ( (3,4) , (1,5) )$, tenemos que $B^* = ( \varphi_1 , \varphi_2 )$ es tal que:

$\varphi_1 (3,4) = 1$

$\varphi_1 (1,5) = 0$

$\varphi_2 (3,4) = 0$

$\varphi_2 (1,5) = 1.$

Sabemos que $\varphi_1 (x,y) = ax + by$, $\varphi_2 (x,y) = cx + dy$ con $a,b,c,d \in \mathbb{R}$. AsÍ:

$a(3) + b(4) = 1$

$a(1) + b(5) = 0$

$c(3) + d(4) = 0$

$c(1) + d(5) = 1$

Las matrices aumentadas de estos sistemas son:

$\left( \begin{array}{cc|c} 3 & 4 & 1 \\ 1 & 5 & 0 \end{array} \right)$ y $\left( \begin{array}{cc|c} 3 & 4 & 0 \\ 1 & 5 & 1 \end{array} \right).$

Resolviéndolas simultáneamente:

$\left( \begin{array}{cc|cc} 3 & 4 & 1 & 0 \\ 1 & 5 & 0 & 1 \end{array} \right) \sim \left( \begin{array}{cc|cc} 1 & 5 & 0 & 1 \\ 3 & 4 & 1 & 0 \end{array} \right)$ $\sim \left( \begin{array}{cc|cc} 1 & 5 & 0 & 1 \\ 0 & -11 & 1 & -3 \end{array} \right)$ $\sim \left( \begin{array}{cc|cc} 1 & 5 & 0 & 1 \\ 0 & 1 & – \frac{1}{11} & \frac{3}{11} \end{array} \right)$ $\sim \left( \begin{array}{cc|cc} 1 & 0 & \frac{5}{11} & – \frac{4}{11} \\ 0 & 1 & – \frac{1}{11} & \frac{3}{11} \end{array} \right),$

de donde $a = \frac{5}{11}$, $b = – \frac{1}{11}$, $c = – \frac{4}{11}$, $d = \frac{1}{11}.$

$\therefore \varphi_1 (x,y) = \frac{5}{11} x \;-\; \frac{1}{11} y$, $\;\varphi_2 (x,y) = – \frac{4}{11} x \;+\; \frac{3}{11} y$.

Nota: Dado $V$ un $K$ – espacio vectorial, podemos considerar $(V^*)^*$, llamado el doble dual y denotado por $V^{**}$. Y así sucesivamente.

Si $V$ es de dimensión finita podemos usar la misma estructura de demostración del teorema (4.9.1) para notar que $V$ será isomorfo a todos sus duales.

Teorema (4.9.2.): Sea $V$ un $K$ – espacio vectorial de dimensión finita. La transformación $\Psi : V \longrightarrow V^{**}$ tal que para todo $v\in V$ $\Psi(v)=f_v$, donde $f_v : V^* \longrightarrow K$ es tal que $f_v (\varphi) = \varphi (v)$ para toda $\varphi \in V^*$, es un isomorfismo de $V$ en $V^{**}$.

Demostración: Sea $V$ un $K$ – espacio vectorial de dimensión finita. Consideremos la transformación $\Psi : V \longrightarrow V^{**}$ tal que para todo $v\in V$ $\Psi(v)=f_v$, donde $f_v : V^* \longrightarrow K$ es tal que $f_v (\varphi) = \varphi (v)$ para toda $\varphi \in V^*$.

Veamos que $\Psi$ es lineal.

Observemos que demostrar que $\forall \lambda \in K , u,v \in V ( \Psi (\lambda v + u) = \lambda \Psi (v) + \Psi (u) )$ es equivalente a demostrar que $\forall \lambda \in K, u,v \in V (\lambda f_{\lambda v + u} = \lambda f_v + f_u)$. Así que demostraremos lo segundo.

Sea $\varphi \in V^*$. Sean $\lambda \in K$ y $u,v \in V$. Como $\phi$ es lineal, tenemos que

$f_{\lambda v + u} (\varphi) = \varphi ( \lambda v + u )$ $= \lambda \varphi (v) + \varphi (u)$ $= \lambda f_v(\varphi) + f_u(\varphi)=(\lambda f_v + f_u)(\varphi)$.

$\therefore \lambda f_{\lambda v + u} = \lambda f_v + f_u$ y entonces $\Psi$ es lineal.

Veamos que $\Psi$ es inyectiva, que por el teorema (2.3.2) de la entrada 2.3, es equivalente a ver que $Núc \Psi = \{ \theta_V \}$.

Sea $v \in Núc \Psi$. Tenemos que $\Psi (v) = \theta_{V^{**}}$, es decir, $f_v = \theta_{V^{**}}$.

Entonces $\forall \varphi \in V^*$ tenemos que $\varphi (v) = f_v (\varphi) =\theta_{V^{**}}(\varphi)= 0_K.$ Así, $\forall \varphi \in V^*$ tenemos que $\varphi (v) = 0_K.$

Sea $n=\dim V$, consideremos $B = ( v_1 , … , v_n)$ una base ordenada de $V$ y $B^* = (\varphi_1 , … , \varphi_n)$ su base dual.

Sabemos que $v = \lambda_1 v_1 + … + \lambda_n v_n$ con $\lambda_1 , … , \lambda_n \in K$. Dado que $\forall \varphi \in V^*$, $\varphi (v) = 0_K,$ en particular $\forall i\in\{1,\dots ,n\}$, $\varphi_i (v) = 0_K$. Entonces, $\forall i\in\{1,\dots ,n\}$,

$0_K = \varphi_i (v) = \varphi_i (\lambda_1 v_1 + … + \lambda_n v_n)$ $= \lambda_1 \varphi_i (v_1) + … + \lambda_n \varphi_i (v_n) = \lambda_i \cdot 1 = \lambda_i.$

Así, $\forall i \in \{ 1, … , n \}$ tenemos que $\lambda_i = 0$ y por lo tanto, $v = \theta_V$.

$\therefore Núc \Psi = \{ \theta_V \}.$

Como $\Psi : V \longrightarrow V^{**}$ es inyectiva y $\dim_K V = \dim_K V^{**}$, entonces, por el corolario (2.3.3) de la entrada 2.3, $\Psi$ también es suprayectiva, concluyendo así que $\Psi$ es un isomorfismo.

Tarea Moral

- Demuestra o da un contraejemplo:

Sean $V$ y $W$ espacios vectoriales sobre el mismo $K$ campo.

Si $V$ es isomorfo a $W$, entonces $V^*$ es isomorfo a $W^*$. - Sea $B = ((1,2,0) , (0,1,1) , (1,0,1))$ una base ordenada de $\mathbb{R}^3.$

Encuentra la base dual $B^* = ( \varphi_1 , \varphi_2 , \varphi_3 ).$

Más adelante…

Daremos un paso más allá: ¿qué ocurre cuando no aplicamos una función a un solo vector, sino a varios simultáneamente?

Entraremos al mundo de las funciones multilineales, donde la linealidad se extiende a varias entradas y las interacciones entre vectores se vuelven más ricas. Estas funciones no sólo revelan relaciones entre vectores, sino que permiten construir conceptos profundos.

Comenzaremos a ver al espacio no sólo como un conjunto de vectores aislados, sino como un entramado de relaciones que se pueden comparar.

Entradas relacionadas

- Ir a Álgebra Lineal I

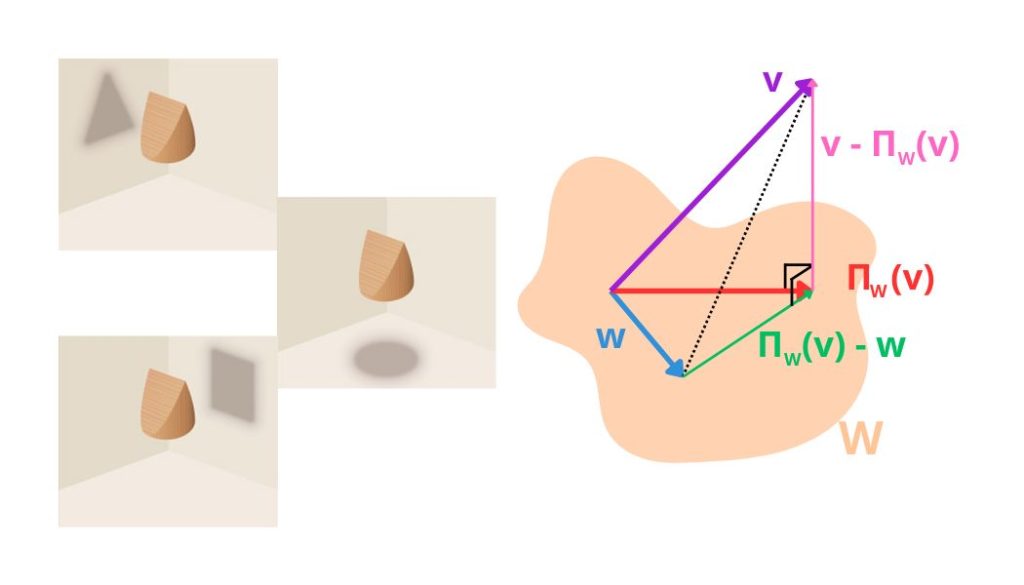

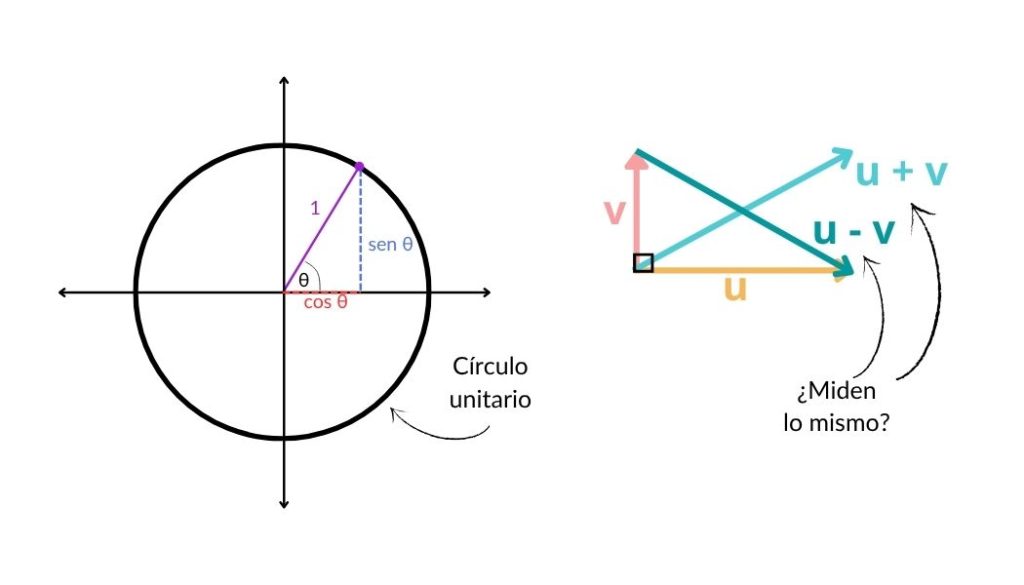

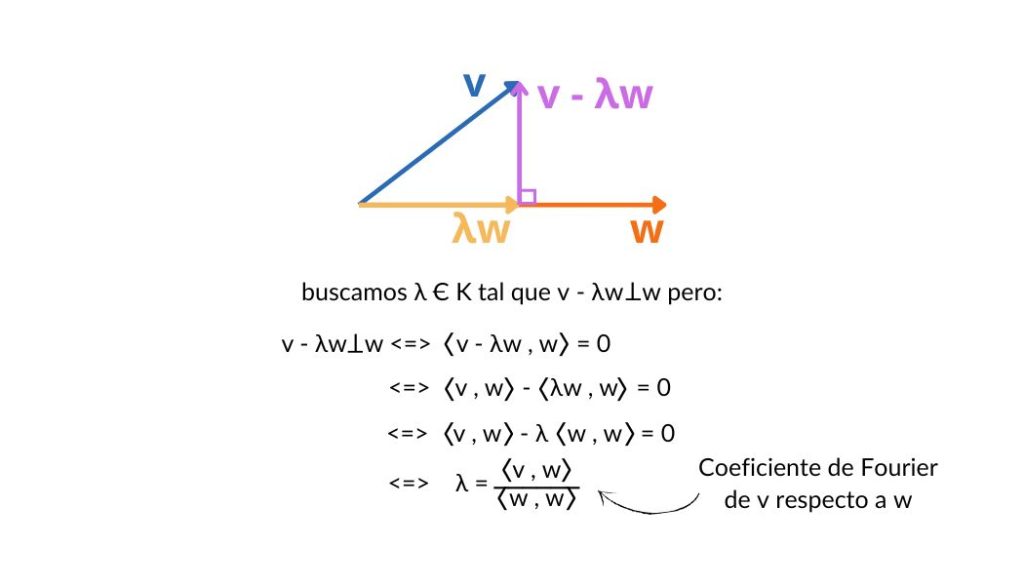

- Entrada anterior del curso: 4.8. PROYECCIÓN DE UN VECTOR: definición y descomposición de un espacio como suma directa de un subespacio y su ortogonal

- Siguiente entrada del curso: 5.1. FUNCIONES MULTILINEALES, $n$-MULTILINEALES Y ALTERNANTES: definiciones, propiedades y ejemplos