Ejemplo

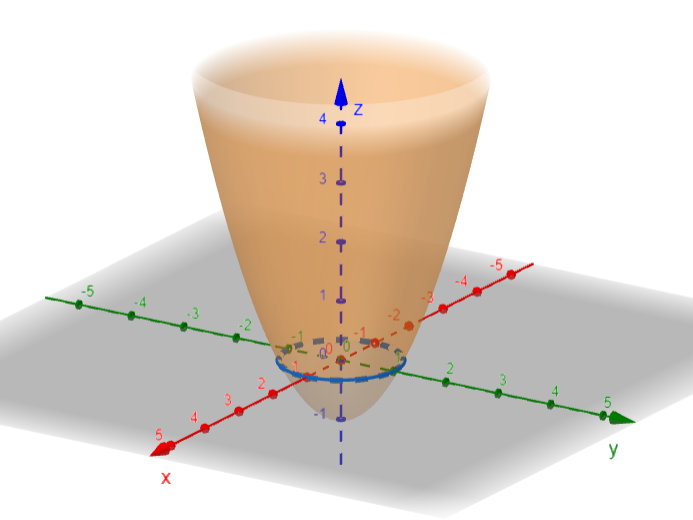

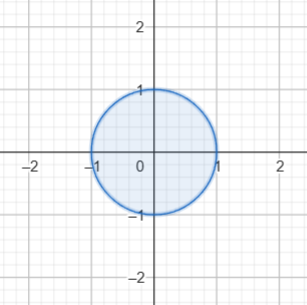

Determine el valor máximo y mínimo de $ f (x, y, z) = \, – \, x \, + \, 2y \, + \, 2z$ en la elipse $\mathcal{E}$ en el espacio dada por la intersección de las superficies $x^2 + y^2 = 2$ y $ y + 2z = 1$

Una forma de abordar el problema

Las dos restricciones

$ \begin{align*} g_1 ( x, y, z) &= 0 \\ g_2 ( x, y, z) &= 0 \end{align*}$

nos dan un sistema de dos ecuaciones con tres incógnitas.

En principio, podemos despejar dos variables en función de la tercera.

Sin pérdida de generalidad, supongamos $x = {\varphi}_1 (z)$ y $y = {\varphi}_2 (z).$

$z \rightarrow \big( {\varphi}_1 (z) , {\varphi}_2 (z) , {\varphi}_3 (z) \big)$ es una parametrización de la curva.

Necesitamos una versión adecuada del teorema de la función implícita.

$ g : \mathbb{R}^3 \rightarrow \mathbb{R}^2$

$ g (x, y, z) = \Big( g_1 (x, y, z), g_2 (x, y, z) \Big)$

$ (x_0 , y_0 , z_0 ) \in \mathbb{R}^3$ tal que $g_1 ( x, y, z) = 0 $ y $ g_2 ( x, y, z) = 0$

El vector tangente a la curva será colineal con el producto cruz de los vectores normales $\nabla g_1$ y $\nabla g_2$

$$ \nabla g_1 \times \nabla g_2$$

Tres vectores en $\mathbb{R}^3$ anclados en el punto son $\nabla g_1$, $\nabla g_2$ y $\nabla f.$

Si $T$ es el vector tangente a la curva anclado en el punto $P=(x_0, y_0, z_0)$ donde la restricción de $f$ alcanza un máximo o un mínimo, entonces

$$T \perp \nabla g_1(P)$$

$$T \perp \nabla g_2(P)$$

$$T \perp \nabla f(P) $$

$$\nabla f(P) = {\lambda}_1 \nabla g_1(P) \, + \, {\lambda}_2 \nabla g_2(P)$$

Calculemos los gradientes

$\nabla f (x, y, z) = \Big(\dfrac{\partial f}{\partial x}, \dfrac{\partial f}{\partial y}, \dfrac{\partial f}{\partial z} \Big)$

$\nabla f (x, y, z) = ( \, – \, 1, 2, 2 )$

$\nabla g_1 (x, y, z) = ( 2x , 2y , 0 )$

$\nabla g_2 (x, y, z) = ( 0 , 1 , 2 )$

Si $f \Big|_{\mathcal{E}}$, con $\mathcal{E}$ es la elipse dada por las ecuaciones $ g_1 = 0 $ y $ g_2 = 0$, alcanza un valor extremo en un punto $(x_0, y_0, z_0)$, entonces ese punto satisface el sistema de ecuaciones:

$g_1 (x, y, z) = 0$

$g_2 (x, y, z) = 0$

$\nabla f = {\lambda}_1 \nabla g_1 \, + \, {\lambda}_2 \nabla g_2$

$\begin{pmatrix} \, – \, 1 \\ 2 \\ 2 \end{pmatrix} = {\lambda}_1 \begin{pmatrix} 2x \\ 2y \\ 0 \end{pmatrix} \, + \, {\lambda}_2 \begin{pmatrix} 0 \\ 1 \\ 2 \end{pmatrix}$

Entonces tenemos el siguiente sistema de cinco ecuaciones con cinco incógnitas:

$\left\{ \begin{align*} – \, 1 &= 2x {\lambda}_1 \\ \\ 2 &= 2y {\lambda}_1 + {\lambda}_2 \\ \\2 &= 2 {\lambda}_2 \\ \\ x^2 + y^2 &= 2 \\ \\ y + 2z &= 1 \end{align*} \right.$

Resolviendo este sistema se tiene que:

$ {\lambda}_2 = 1$

${\lambda}_1 = \pm \dfrac{1}{2}$

Para ${\lambda}_1 = \dfrac{1}{2}$ se tiene que

$x = \, – \, 1$, $ y = 1$ , $z = 0$

Para ${\lambda}_1 = \, – \, \dfrac{1}{2}$ se tiene que

$x = 1$, $ y = \, – \,1$ , $z = 1$

Por lo que encontramos dos puntos: $(\, – \, 1, 1, 0 )$ y el $( 1, \, – \, 1 , 1 ).$

La elipse $\mathcal{E}$ es un conjunto compacto, suave, por lo que $f \Big|_{\mathcal{E}}$ alcanza un máximo y un mínimo.

$ f (\, – \, 1, 1, 0 ) = 3$ es el valor máximo.

$ f ( 1, \, – \, 1 , 1 ) = \, – \, 1$ es el valor mínimo.

En la animación siguiente el plano que se mueve representa las superficies de nivel de $f$, en cambio el cilindro y la elipse en él están fijos.