El vínculo a esta página lo encontrarás al final de cada entrada y al inicio del índice en Análisis Matemático I.

Introducción

Aprender Análisis Matemático es, en gran medida, aprender a leer un nuevo idioma. A lo largo de estas notas, hemos adoptado la notación clásica de los grandes referentes del Análisis Matemático para dar rigor a cada concepto. Sin embargo, sabemos que a veces estos símbolos pueden sentirse como una barrera.

He preparado esta Guía de notación como un mapa de consulta rápida. Aquí encontrarás desde los símbolos lógicos fundamentales hasta las definiciones de las métricas y normas más complejas que exploramos en cada sesión. Si alguna vez te pierdes entre subíndices o definiciones alternativas, vuelve aquí. Los términos están enlistados por orden de aparición en la exposición de acuerdo con el índice en Análisis Matemático I e incluyen un enlace directo a la entrada donde fueron definidos a fondo por primera vez. ¡Que la notación sea tu herramienta, no un obstáculo!

Notación general

$

\renewcommand{\arraystretch}{1}

\begin{array}{c|l}

\text{Símbolo} & \text{Significado} \\

\hline \hline

\forall & \text{Para todo} \\ \hline

\exists & \text{Existe} \\ \hline

\exists! & \text{Existe un único} \\ \hline

\nexists & \text{No existe} \\ \hline

\implies & \text{Implica (entonces)} \\ \hline

\iff & \text{Si y solo si (equivalencia)} \\ \hline

\therefore & \text{Por lo tanto} \\ \hline

\in / \notin & \text{Pertenece / No pertenece} \\ \hline

\subset & \text{Contenido en (subconjunto)} \\ \hline

\cup / \cap & \text{Unión / Intersección} \\ \hline

A \setminus B & \text{Diferencia de conjuntos} \\ \hline

A^c & \text{Complemento del conjunto } A \\ \hline

\emptyset & \text{Conjunto vacío} \\ \hline

\mathbb{N} & \text{Números Naturales} \\ \hline

\mathbb{Z} & \text{Números Enteros} \\ \hline

\mathbb{Q} & \text{Números Racionales} \\ \hline

\mathbb{R} & \text{Números Reales} \\ \hline

\mathbb{R}^n & \text{Espacio Euclidiano } n\text{-dimensional} \\ \hline

\mathbb{I} & \text{Números Irracionales } (\mathbb{R} \setminus \mathbb{Q}) \\ \hline

\mathbb{C} & \text{Números Complejos} \\

\end{array}

$

Unidad 1. Espacios Métricos

$

\renewcommand{\arraystretch}{1.5}

\begin{array}{c|l|l}

\text{Símbolo} & \text{Significado} & \text{Aparece en…} \\ \hline \hline

(X,d) & \text{Espacio métrico (conjunto y métrica)} & \href{https://blog.nekomath.com/espacios-metricos/}{\textcolor{blue}{\text{Espacios métricos}}} \\ \hline

d(x,y) & \text{Distancia entre los puntos } x \text{ y } y & \href{https://blog.nekomath.com/espacios-metricos/}{\textcolor{blue}{\text{Espacios métricos}}} \\ \hline

d_X & \text{Distancia en el espacio métrico } X & \href{https://blog.nekomath.com/espacios-metricos/}{\textcolor{blue}{\text{Espacios métricos}}} \\ \hline

f: A \to B & \text{Función de } A \text{ en } B & \href{https://blog.nekomath.com/espacios-metricos/}{\textcolor{blue}{\text{Espacios métricos}}} \\ \hline

(X,d_{disc}) & \text{Métrica discreta} & \href{https://blog.nekomath.com/espacios-metricos/}{\textcolor{blue}{\text{Espacios métricos}}} \\ \hline

|x-y| & \text{Métrica usual en } \mathbb{R} & \href{https://blog.nekomath.com/espacios-metricos/}{\textcolor{blue}{\text{Espacios métricos}}} \\ \hline

\mathcal{C}^0[a,b] & \text{Funciones continuas en } [a,b] & \href{https://blog.nekomath.com/espacios-metricos/}{\textcolor{blue}{\text{Espacios métricos}}} \\ \hline

\mathcal{B}(A, \mathbb{R}) & \text{Funciones acotadas de } A \text{ en } \mathbb{R} & \href{https://blog.nekomath.com/espacios-metricos/}{\textcolor{blue}{\text{Espacios métricos}}} \\ \hline

d_\infty(f,g) & \text{Distancia del supremo} & \href{https://blog.nekomath.com/espacios-metricos/}{\textcolor{blue}{\text{Espacios métricos}}} \\ \hline

\norm{\cdot} & \text{Norma en un espacio vectorial } V & \href{https://blog.nekomath.com/espacios-normados/}{\textcolor{blue}{\text{Espacios normados}}} \\ \hline

\ell_\infty & \text{Sucesiones reales acotadas} & \href{https://blog.nekomath.com/espacios-normados/}{\textcolor{blue}{\text{Espacios normados}}} \\ \hline

\| x \|_p := (\sum_{i=1}^n |x_i|^p ) ^ {1/p} & \text{Norma } p \text{ en } \mathbb{R}^n & \href{https://blog.nekomath.com/espacios-normados/}{\textcolor{blue}{\text{Espacios normados}}} \\ \hline

\|x\|_\infty := max \{|x_1|,…,|x_n|\} & \text{Norma infinito en } \mathbb{R}^n & \href{https://blog.nekomath.com/espacios-normados/}{\textcolor{blue}{\text{Espacios normados}}} \\ \hline

\norm{f}_\infty :=\underset{a \leq x \leq b}{max} \, |f(x)| & \text{Norma infinito en } \mathcal{C}^0[a,b] & \href{https://blog.nekomath.com/espacios-normados/}{\textcolor{blue}{\text{Espacios normados}}} \\ \hline

\norm{z} := \sqrt{a^2+b^2} & \text{Norma usual en } \mathbb{C} \text{ para } z = a+bi & \href{https://blog.nekomath.com/espacios-normados/}{\textcolor{blue}{\text{Espacios normados}}} \\ \hline

\ell_p & \text{Espacio de sucesiones } p\text{-sumables} & \href{https://blog.nekomath.com/espacios-normados/}{\textcolor{blue}{\text{Espacios normados}}} \\ \hline

\norm{(x_{n})_{n \in \mathbb{N}}}_{\infty} :=\underset{n \in \mathbb{N}}{sup} \, |x_{n}| & \begin{matrix} \text{Norma infinito en el conjunto} \\ \text {de sucesiones reales acotadas } \ell_\infty \end{matrix} & \href{https://blog.nekomath.com/espacios-normados/}{\textcolor{blue}{\text{Espacios normados}}} \\ \hline

\norm{(x_{n})_{n \in \mathbb{N}}}_p := (\sum_{i=1}^{\infty} |x_i|^p )^{1/p} & \text{Norma } p \text{ en el conjunto de sucesiones } \ell_p & \href{https://blog.nekomath.com/espacios-normados/}{\textcolor{blue}{\text{Espacios normados}}} \\ \hline

\norm{f}_p:= \left(\int_{a}^{b} |f(x)|^p \,dx \right)^{1/p} & \text{Norma } p \text{ en } \mathcal{C}^0[a,b] \text{ (integral)} & \href{https://blog.nekomath.com/espacios-normados/}{\textcolor{blue}{\text{Espacios normados}}} \\ \hline

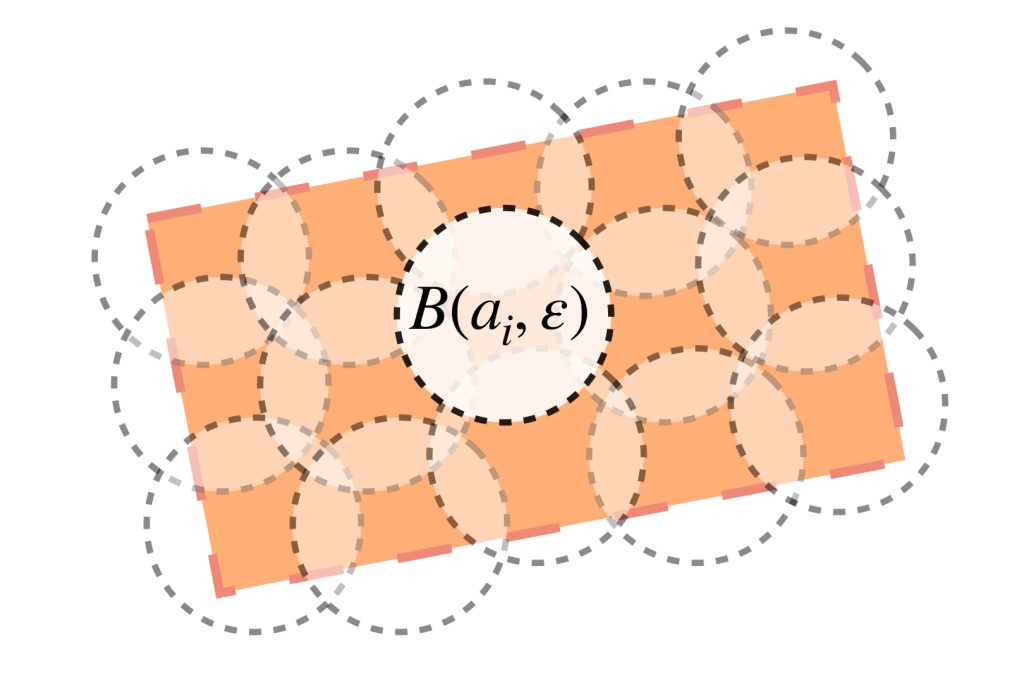

B(x,\varepsilon) & \text{Bola abierta (centro } x, \text{ radio } \varepsilon) & \href{https://blog.nekomath.com/la-bola-abierta-en-un-espacio-metrico/}{\textcolor{blue}{\text{La bola abierta}}} \\ \hline

B_X(x,\varepsilon) & \text{Bola abierta en el espacio métrico } X & \href{https://blog.nekomath.com/la-bola-abierta-en-un-espacio-metrico/}{\textcolor{blue}{\text{La bola abierta}}} \\ \hline

Int(A) & \text{Interior de un conjunto } A & \href{https://blog.nekomath.com/nociones-topologicas-basicas/}{\textcolor{blue}{\text{Nociones topológicas}}} \\ \hline

\overline{A} & \text{Cerradura o adherencia de } A & \href{https://blog.nekomath.com/nociones-topologicas-basicas/}{\textcolor{blue}{\text{Nociones topológicas}}} \\ \hline

\overline{B}(x,\varepsilon) & \text{Bola cerrada (centro } x, \text{ radio } \varepsilon) & \href{https://blog.nekomath.com/nociones-topologicas-basicas/}{\textcolor{blue}{\text{Nociones topológicas}}} \\ \hline

\partial A & \text{Frontera de un conjunto } A & \href{https://blog.nekomath.com/nociones-topologicas-basicas/}{\textcolor{blue}{\text{Nociones topológicas}}} \\ \hline

\mathcal{B}(S,X) & \begin{matrix} \text{Conjunto de funciones} \\ \text{acotadas de } S \text{ en } X \end{matrix} & \href{https://blog.nekomath.com/espacios-de-funciones/}{\textcolor{blue}{\text{Espacios de funciones}}} \\ \hline

d_\infty (f,g) & \begin{matrix} \text{Métrica uniforme: } \\ \sup_{z\in S} d(f(z),g(z)) \end{matrix} & \href{https://blog.nekomath.com/espacios-de-funciones/}{\textcolor{blue}{\text{Espacios de funciones}}} \\ \hline

\mathcal{C}^0([0,1], \mathbb{R}^2) & \begin{matrix} \text{Funciones continuas de} \\ \text{un intervalo a un plano} \end{matrix} & \href{https://blog.nekomath.com/espacios-de-funciones/}{\textcolor{blue}{\text{Espacios de funciones}}} \\ \hline

\end{array}

$

Unidad 2. Continuidad

$

\renewcommand{\arraystretch}{1.5}

\begin{array}{c|l|l}

\text{Símbolo} & \text{Significado} & \text{Aparece en…} \\ \hline \hline

\begin{matrix} (x_n)_{n \in \mathbb{N}} \\ (x_n) \end{matrix} & \begin{matrix} \text{Sucesión definida como} \\ \text{función } x: \mathbb{N} \to X \end{matrix} & \href{https://blog.nekomath.com/convergencia/}{\textcolor{blue}{\text{Convergencia}}} \\ \hline x_n & \text{Término n-ésimo de la sucesión} & \href{https://blog.nekomath.com/convergencia/}{\textcolor{blue}{\text{Convergencia}}} \\ \hline \begin{matrix} x_n \to x \\ \underset{n \to \infty}{lim} \, x_n = x \end{matrix} & \begin{matrix} \text{La sucesión converge} \\ \text{al punto } x \end{matrix} & \href{https://blog.nekomath.com/convergencia/}{\textcolor{blue}{\text{Convergencia}}} \\ \hline

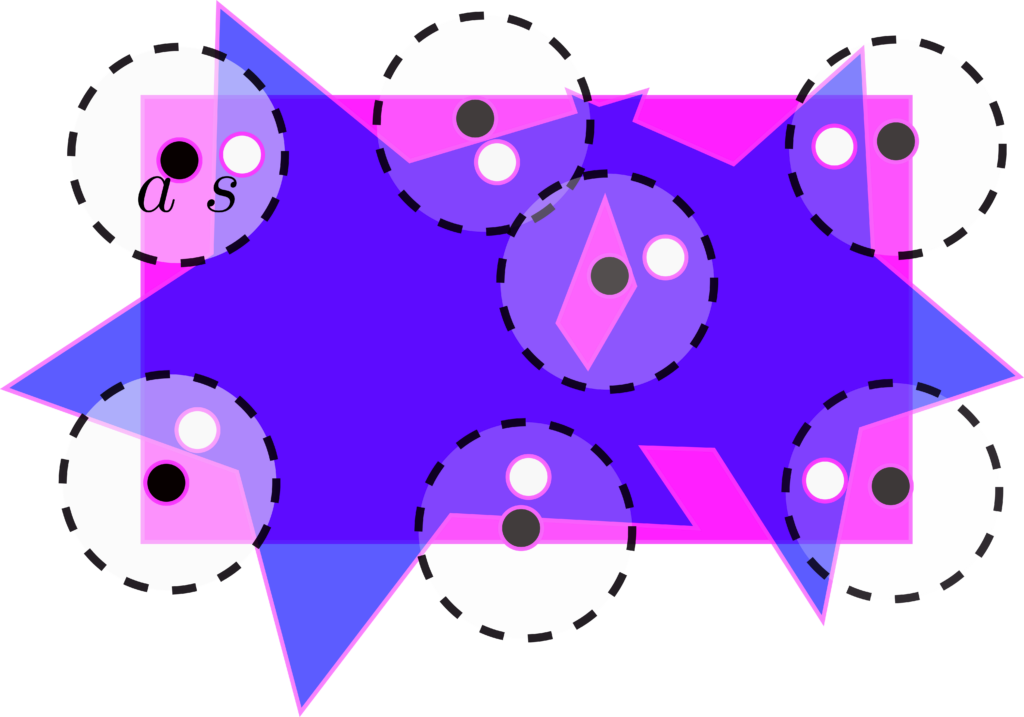

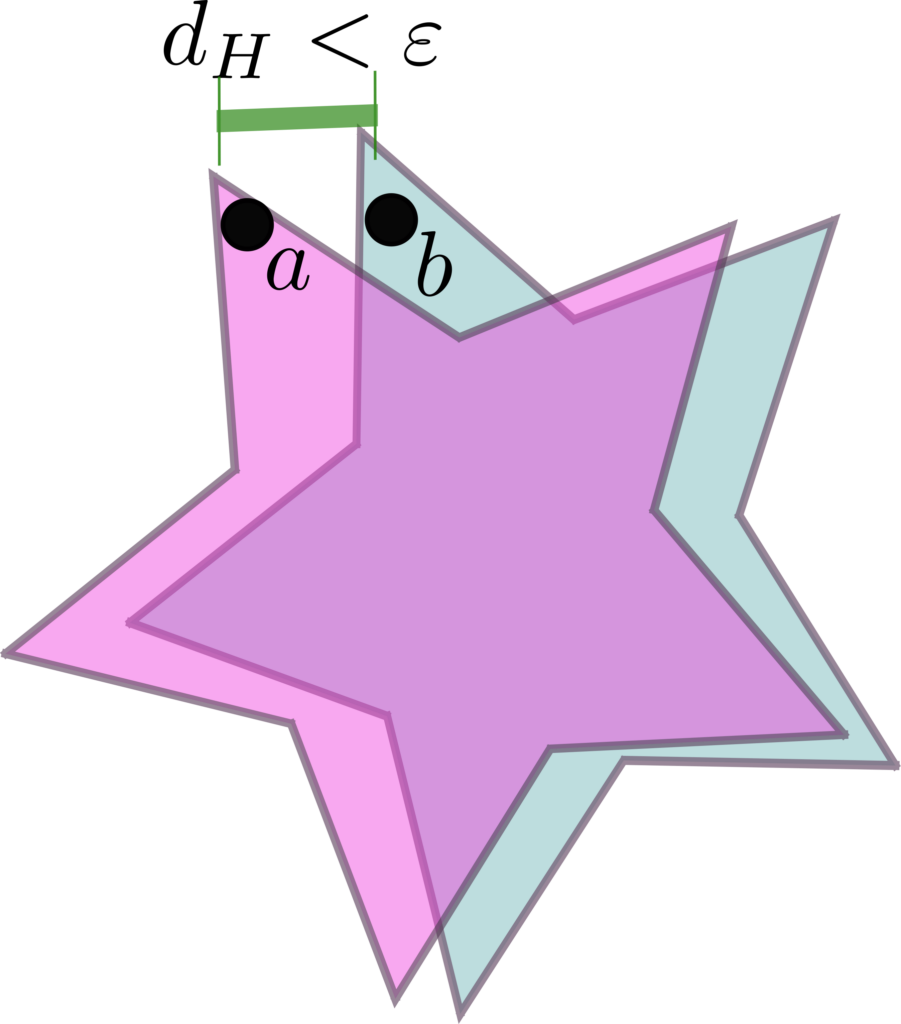

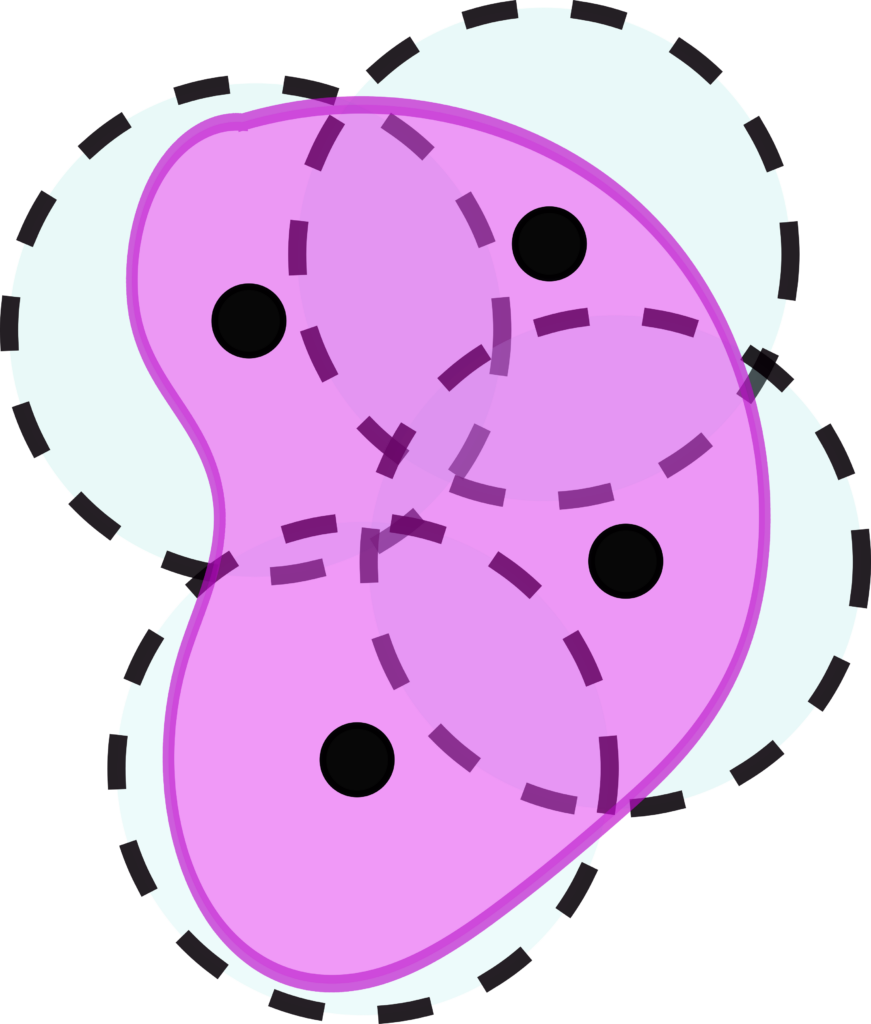

U_\varepsilon(A) & \begin{matrix} \text{Unión de bolas de radio } \varepsilon \\ \text{con centro en } A \end{matrix} & \href{https://blog.nekomath.com/la-metrica-de-hausdorff/}{\textcolor{blue}{\text{Métrica de Hausdorff}}} \\ \hline

d_H(A,B) & \begin{matrix} \text{Distancia de Hausdorff} \\ \text{entre conjuntos} \end{matrix} & \href{https://blog.nekomath.com/la-metrica-de-hausdorff/}{\textcolor{blue}{\text{Métrica de Hausdorff}}} \\ \hline

\text{dist}(a,B) & \inf_{b \in B} d(a,b) & \href{https://blog.nekomath.com/la-metrica-de-hausdorff/}{\textcolor{blue}{\text{Métrica de Hausdorff}}} \\ \hline

\mathcal{M}(X) & \begin{matrix} \text{Espacio de cerrados y acotados} \\ \text{de } X \text{ con la métrica } d_H \end{matrix} & \href{https://blog.nekomath.com/la-metrica-de-hausdorff/}{\textcolor{blue}{\text{Métrica de Hausdorff}}} \\ \hline

f(A) & \text{Imagen del conjunto } A \text{ bajo } f & \href{https://blog.nekomath.com/limite-de-una-funcion/}{\textcolor{blue}{\text{Límite de una función}}} \\ \hline

\begin{matrix} \underset{x \to x_0}{lim} \, f(x) = L \\ f(x) \to L \end{matrix} & \begin{matrix} \text{Límite de la función cuando} \\ x \text{ tiende a } x_0 \end{matrix} & \href{https://blog.nekomath.com/limite-de-una-funcion/}{\textcolor{blue}{\text{Límite de una función}}} \\ \hline

f^{-1}(U) & \text{Imagen inversa del conjunto } U & \href{https://blog.nekomath.com/funciones-continuas-en-espacios-metricos/}{\textcolor{blue}{\text{Funciones continuas}}} \\

\end{array}

$

Unidad 3. Completez

$

\renewcommand{\arraystretch}{1.5}

\begin{array}{c|l|l}

\text{Símbolo} & \text{Significado} & \text{Aparece en…} \\ \hline \hline

diam(A) & \underset{x_1,x_2 \in A}{sup}{d(x_1,x_2)} & \href{https://blog.nekomath.com/conjuntos-anidados/}{\textcolor{blue}{\text{Conjuntos anidados}}} \\ \hline

(x_n) \sim (x’n) & \underset{n \to \infty}{lim} d(x_n, x’_n) = 0 & \href{https://blog.nekomath.com/completacion-de-un-espacio-metrico/}{\textcolor{blue}{\text{Completación}}} \\ \hline

\\

\end{array}

$

Unidad 4. Convergencia uniforme su relación con la derivada y la integral

$

\renewcommand{\arraystretch}{1.5}

\begin{array}{c|l|l}

\text{Símbolo} & \text{Significado} & \text{Aparece en…} \\ \hline \hline

\mathcal{C}_b^0(X,Y) & \begin{matrix} \text{Funciones continuas y} \\ \text{acotadas de } X \text{ a } Y \end{matrix} & \href{https://blog.nekomath.com/convergencia-uniforme-y-continuidad/}{\textcolor{blue}{\text{Conv. uniforme y cont.}}} \\ \hline d_{\infty}(f,g) & \underset{x \in X}{sup} \, d_Y(f(x), g(x)) & \href{https://blog.nekomath.com/convergencia-uniforme-y-continuidad/}{\textcolor{blue}{\text{Conv. uniforme y cont.}}} \\ \hline

\mathcal{C}^0(A,X) & \text{Funciones continuas de } A \text{ a } X & \href{https://blog.nekomath.com/convergencia-uniforme-y-continuidad/}{\textcolor{blue}{\text{Conv. uniforme y cont.}}} \\ \hline

\sum_{k=1}^{\infty} v_k & \begin{matrix} \text{Serie convergente:} \\ \underset{n \to \infty}{lim} \sum_{k=1}^{n} v_k \end{matrix} & \href{https://blog.nekomath.com/convergencia-uniforme-de-series-en-espacios-de-banach/}{\textcolor{blue}{\text{Series en Banach}}} \\

\end{array}

$

Unidad 5. Teoremas de punto fijo y aplicación a las ecuaciones diferenciales

$

\renewcommand{\arraystretch}{2}

\begin{array}{c|l|l}

\text{Símbolo} & \text{Significado} & \text{Aparece en…} \\ \hline \hline

(\phi^n(x_0))_{n \in \mathbb{N}} & \begin{matrix} \text{Sucesión de iteraciones de} \ \text{punto fijo que converge a } x^* \end{matrix} & \href{https://blog.nekomath.com/funcion-contraccion/}{\textcolor{blue}{\text{Contracciones}}} \\ \hline

\phi^n & \underset{n \text{ veces}}{\underbrace{\phi \circ \dots \circ \phi}} & \href{https://blog.nekomath.com/funcion-contraccion/}{\textcolor{blue}{\text{Contracciones}}} \\

\end{array}

$

Unidad 6. Compacidad, Heine-Borel y Árzela-Ascoli

$

\renewcommand{\arraystretch}{2}

\begin{array}{c|l|l}

\text{Símbolo} & \text{Significado} & \text{Aparece en…} \\ \hline \hline

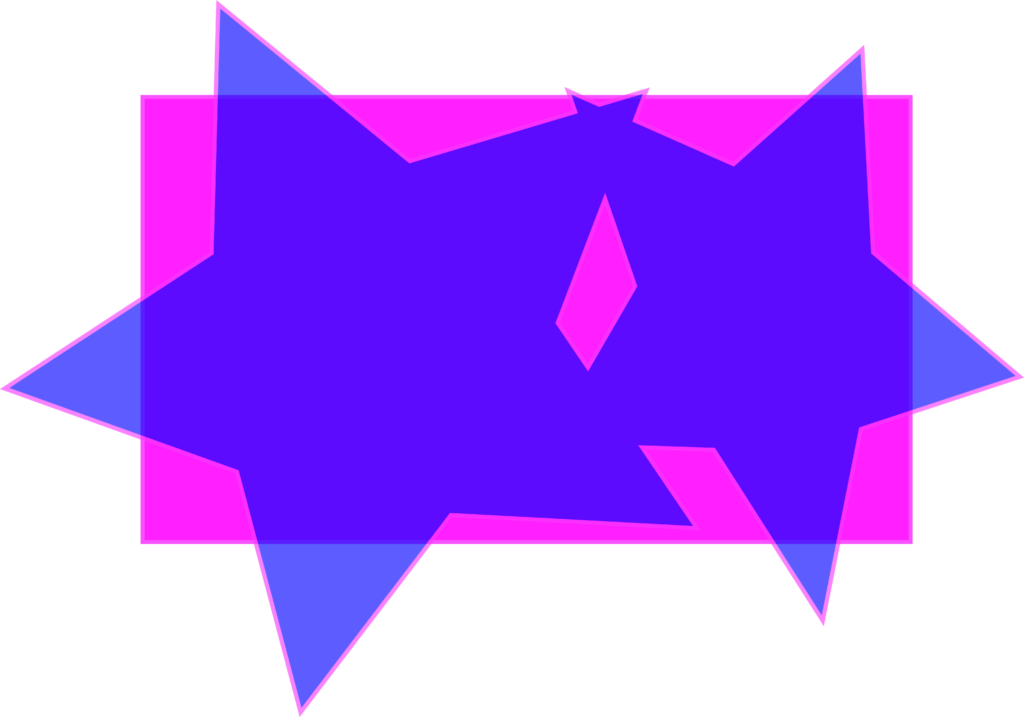

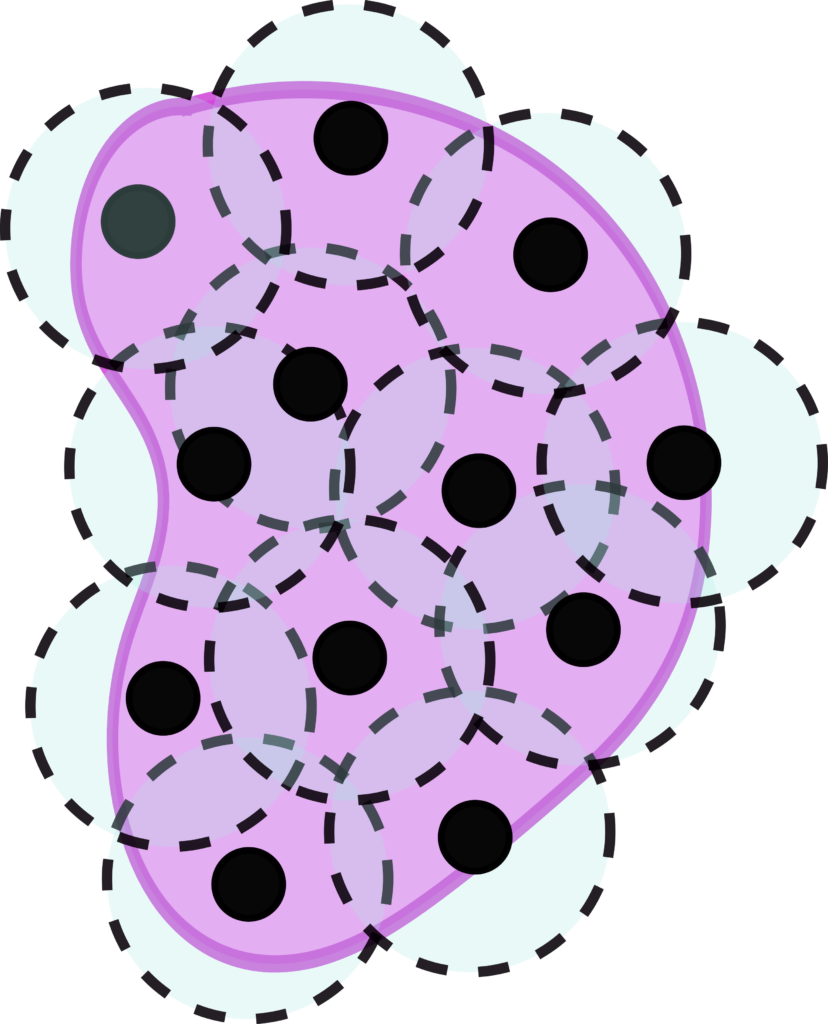

\mathcal{C} = {A_i}_{i \in \mathcal{I}} & \begin{matrix} \text{Cubierta de } A \text{ si} \\ A \subset \underset{i \in \mathcal{I}}{\cup} A_i \end{matrix} & \href{https://blog.nekomath.com/compacidad-en-espacios-metricos/}{\textcolor{blue}{\text{Compacidad}}} \\ \hline

\overline{f}(x_0) & \underset{\varepsilon \to 0}{lim} \left[ \underset{x \in B_X(x_0, \varepsilon)}{sup} f(x) \right] & \href{https://blog.nekomath.com/funciones-semicontinuas/}{\textcolor{blue}{\text{Semicontinuas}}} \\ \hline

\underline{f}(x_0) & \underset{\varepsilon \to 0}{lim} \left[ \underset{x \in B_X(x_0, \varepsilon)}{inf} f(x) \right] & \href{https://blog.nekomath.com/funciones-semicontinuas/}{\textcolor{blue}{\text{Semicontinuas}}} \\ \hline

\omega f(x_0) & \overline{f}(x_0) – \underline{f}(x_0) & \href{https://blog.nekomath.com/funciones-semicontinuas/}{\textcolor{blue}{\text{Semicontinuas}}} \\ \hline

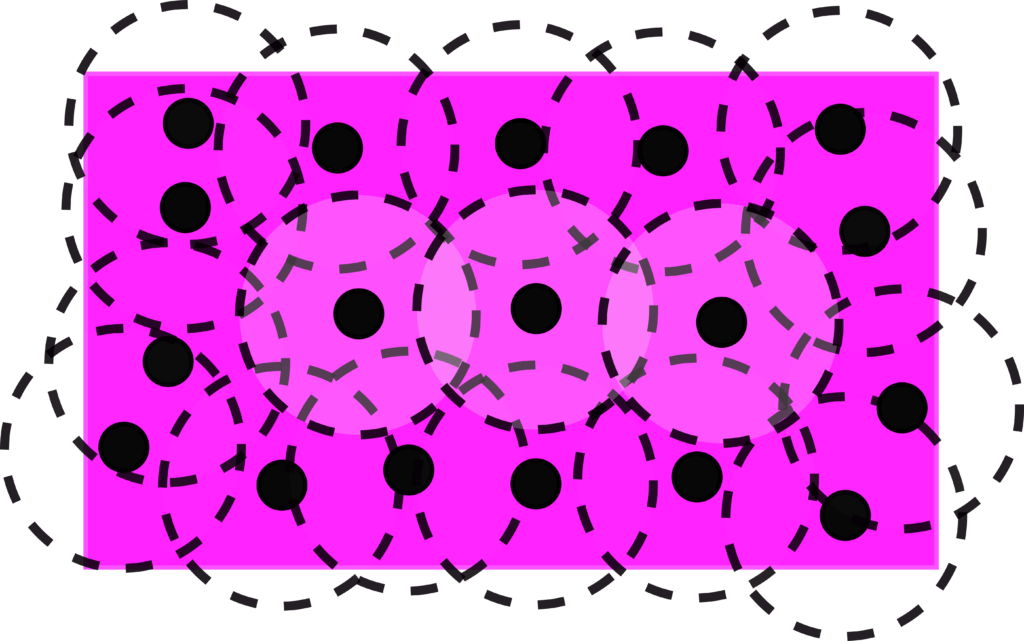

\varepsilon\text{-$red$} & \text{Conjunto finito que «pixeliza» el espacio} & \href{https://blog.nekomath.com/varepsilon-redes/}{\textcolor{blue}{\varepsilon\text{-$redes$} }} \

\end{array}

$

Unidad 8. Integral de Riemann-Stieltjes

$

\renewcommand{\arraystretch}{2}

\begin{array}{c|l|l}

\text{Símbolo} & \text{Significado} & \text{Aparece en…} \\ \hline \hline

P, \, \mathcal{P}_{[a,b]} & \text{Partición y conjunto de particiones de } [a,b] & \href{https://blog.nekomath.com/funciones-de-variacion-acotada/}{\textcolor{blue}{\text{Variación acotada}}} \\ \hline

S_P[f;a,b] & \sum_{i=1}^{n} |f(x_i) – f(x_{i-1})| & \href{https://blog.nekomath.com/funciones-de-variacion-acotada/}{\textcolor{blue}{\text{Variación acotada}}} \\ \hline

\begin{matrix} V[f;a,b] := V[a,b] \ := V := \underset{P \in \mathcal{P}_{[a,b]}}{sup} S_P \end{matrix} & \text{Variación de } f \text{ sobre } [a,b] & \href{https://blog.nekomath.com/funciones-de-variacion-acotada/}{\textcolor{blue}{\text{Variación acotada}}} \\ \hline

x^+, x^- & \text{Partes positiva y negativa de } x \in \mathbb{R} & \href{https://blog.nekomath.com/funciones-de-variacion-acotada/}{\textcolor{blue}{\text{Variación acotada}}} \\ \hline

S_P^+ := S_P^+[f;a,b] & \sum_{i=1}^{n} (f(x_i) – f(x_{i-1}))^+ & \href{https://blog.nekomath.com/funciones-de-variacion-acotada/}{\textcolor{blue}{\text{Variación acotada}}} \\ \hline

S_P^- := S_P^-[f;a,b] & \sum_{i=1}^{n} (f(x_i) – f(x_{i-1}))^- & \href{https://blog.nekomath.com/funciones-de-variacion-acotada/}{\textcolor{blue}{\text{Variación acotada}}} \\ \hline

S^+ := S^+[f;a,b] & \text{Variación positiva: } \underset{P \in \mathcal{P}}{sup} S_P^+ & \href{https://blog.nekomath.com/funciones-de-variacion-acotada/}{\textcolor{blue}{\text{Variación acotada}}} \\ \hline

S^- := S^-[f;a,b] & \text{Variación negativa: } \underset{P \in \mathcal{P}}{sup} S_P^- & \href{https://blog.nekomath.com/funciones-de-variacion-acotada/}{\textcolor{blue}{\text{Variación acotada}}} \\ \hline

\underset{x \to x_0^+}{lim} f(x), \, \underset{x \to x_0^-}{lim} f(x) & \text{Límites por la derecha y por la izquierda} & \href{https://blog.nekomath.com/funciones-de-variacion-acotada-parte-2/}{\textcolor{blue}{\text{Variación acotada 2}}} \\ \hline

S(P, f, \alpha) & \sum_{i=1}^{n} f(\xi_i)(\alpha(x_i) – \alpha(x_{i-1})) & \href{https://blog.nekomath.com/propiedades-de-la-integral-de-riemann-stieltjes-parte-1/}{\textcolor{blue}{\text{Integral R-S 1}}} \\ \hline

\int_a^b f d\alpha := \int_a^b f(x) d\alpha(x) & \text{Integral de Riemann-Stieltjes} & \href{https://blog.nekomath.com/propiedades-de-la-integral-de-riemann-stieltjes-parte-1/}{\textcolor{blue}{\text{Integral R-S 1}}} \\ \hline

m_i, M_i & \inf \text{ y } \sup \text{ de } f \text{ en } [x_{i-1}, x_i] & \href{https://blog.nekomath.com/propiedades-de-la-integral-de-riemann-stieltjes-parte-2/}{\textcolor{blue}{\text{Integral R-S 2}}} \\ \hline

\underline{S}_P, \overline{S}_P & \text{Suma inferior y suma superior de R-S} & \href{https://blog.nekomath.com/propiedades-de-la-integral-de-riemann-stieltjes-parte-2/}{\textcolor{blue}{\text{Integral R-S 2}}} \\

\end{array}

$