(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

Introducción

Como hemos visto en las entradas anteriores, muchas pruebas de grupos se realizan por inducción sobre $|G|$ usando información de un subgrupo normal $N$ y el cociente $G/N$.

Pero para poder usar $G/N$ se requiere que exista un subgrupo normal $N$ de $G$ con $1\lneq |N| \lneq |G|$ y en ocasiones no existe un $N$ normal que no sea el mismo $G$ o $\{e_G\}$, entonces conviene estudiar a los grupos $G$ no triviales tales que tienen sólo dos subgrupos normales.

Por otro lado, ¿es posible tener una secuencia de grupos normales contenidos entre sí? A esta situación lo conocemos como una serie de composición.

Esta entrada está dedicada a los conceptos de grupos simples y series de composición de grupos, será útil para que, más adelante, entendamos el Teorema de Jordan Hölder.

Qué simples son los grupos simples

Definición. Sea $G$ un grupo con $G\neq \{e\}$. Decimos que $G$ es simple si sus únicos subgrupos normales son $G$ y $\{e\}$.

Ejemplo.

Sea $p\in \z^+$ un número primo, $G$ un grupo con $|G| = p$. Entonces $G$ es un grupo simple ya que si $N\unlhd G$ se tiene que $|N| \Big| |G| = p$ y así $|N| = 1$ ó $|N| = p$, esto implica que $N = \{e\}$ ó $N = G$.

Proposición. Todo grupo finito simple abeliano es isomorfo a $\z_p$.

Demostración.

Sea $G$ un grupo finito simple abeliano. Dado que $G\neq\{e\}$ consideremos $a\in G, a\neq e$. Como $G$ es abeliano, todo subgrupo es normal, así

\begin{align*}

\{e\} \lneq \left< a \right> \unlhd G

\end{align*}

pero $G$ es simple, entonces $\left< a \right> = G$ y $G$ es cíclico.

Más aún, $G\cong \z_n$ con $n= |G|$. Veamos que $n$ es primo.

P. D. $n$ es primo.

Supongamos por reducción al absurdo que $n$ es compuesto, es decir $n = st$ con $s,t\in \z^+$, donde $s<n$ y $t< n$.

Entonces $a^s \neq e$ ya que $s<n = o(a)$, por lo que $\{e\} \lneq \left< a^s\right>$.

Además $$(a^s)^t = e$$ y así $o(a^s)$ divide a $ t$, lo que implica que $o(a^s) \leq t < n$ y en consecuencia $\left< a^s\right> \lneq \; G$.

Por lo tanto $\{e\} \lneq \left< a^s\right> \lneq \; G$. Pero como $G$ es un grupo abeliano todos sus subgrupos son normales, por lo que $\left< a^s\right>$ sería un subgrupo normal de $G$ distinto de $\{e\} $ y de $G$, lo que es una contradicción.

Concluimos que $n$ es primo y así $G\cong \z_n$ con $n$ primo.

$\blacksquare$

Nota. Hay grupos simples infinitos.

Para poder dar un ejemplo de la nota, necesitamos la siguiente proposición.

Proposición. Sea $n \in \n$ tal que $n \geq 5$. Entonces $A_n$ es simple.

Demostración. La demostración queda como tarea moral.

Ejemplo de grupo simple infinito

Ahora sí veamos un ejemplo de grupo simple no abeliano e infinito.

Ejemplo.

Sea $G$ el conjunto de permutaciones pares de naturales positivos con soporte finito. Recordemos que si $n, \in \n^+$ con $m < n$, toda permutación de $m$ elementos puede visualizarse como una de $n$ elementos, y éstas a su vez, como una permutación de los naturales positivos con soporte finito. Por ejemplo, $(1 \, 2)(3 \, 4)$ se puede ver como una permutación en $A_5$ si agregamos al elemento fijo $5$, es decir $(1 \, 2)(3 \, 4)=(1 \, 2) (3\, 4) (5)$. Por lo anterior,

\begin{align*}

G = \{\alpha \,|\alpha \in A_n,\, n \in \n^+ \text{ y } |\text{sop}\;\alpha| = m \text{ para algún } m\in \n\}.

\end{align*}

O bien, $G$ se puede ver como la unión de todos los $A_n$ con $n \geq 5.$

\[

G = \bigcup_{5 \leq n} A_n.

\]

Si consideramos la composición de funciones $\circ$, entonces $(G, \circ)$ es un grupo no abeliano. Además, $G \neq \{e\}$, porque $(1\, 2)(3\, 4) \in G.$

Ahora, $G$ es infinito porque en particular tiene como elementos a las permutaciones $(1\, 2)(3\, n)$ con $n \in \n, n>3$.

Sólo nos falta demostrar que es un grupo simple. Para eso necesitamos demostrar que sus únicos subgrupos normales son $G$ y $\{e\}$.

P.D. $G$ es simple.

Procederemos por contradicción. Supongamos que $G$ no es simple.

Sea $N \unlhd G$ tal que $N \neq G$ y $N \neq \{e\}.$

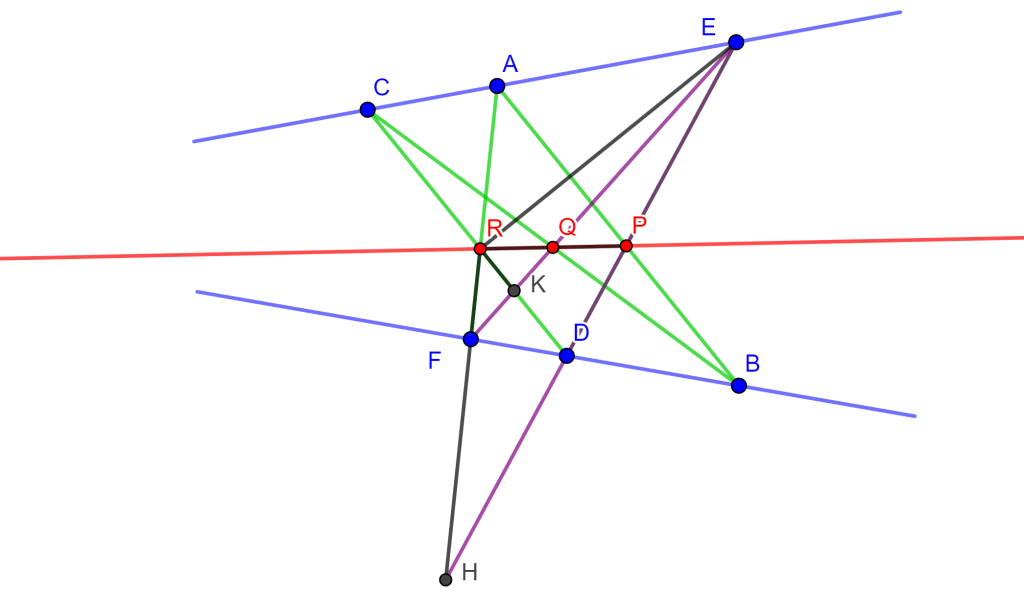

Sabemos que $N = G \cap N$ y que esta intersección no es trivial, es decir $G \cap N \neq \{e\}.$

\begin{align*}

N & = G \cap N \\

& = \bigcup_{5 \leq n} A_n \cap N \neq \{e\}.

\end{align*}

Esto nos indica que existe $m \in \n^+$ con $5 \leq m$ tal que la intersección $A_m \cap N$ es no trivial. Además como para toda $n\geq m$ se tiene que $A_m \subseteq A_n$, entonces para toda $n\geq m$ $\{e\}\neq A_m \cap N\subseteq A_n\cap N$ y así

$$\forall n\geq m,\,\{e\}\neq A_n\cap N.\quad (1)$$

Recordemos el ejercicio 2 de la tarea moral de la entrada en donde introducimos los subgrupos normales. Éste nos dice si tenemos un grupo $G$, un subgrupo $H$ de $G$ y un subgrupo normal $N$ de $G$. Entonces, $N \cap H$ es normal en $H$.

Sea $n \geq m$. Tenemos que $A_n$ es subgrupo de $G$ y $N$ es normal en $G$. Entonces, por el ejercicio mencionado en el párrafo previo, $A_n \cap N$ es normal en $A_n$. Dado que $5\leq m \leq n$, por la última proposición de la sección anterior $A_n$ es simple. Esto implica que $A_n \cap N = A_n$ o $A_n \cap N = \{e\}$, pero por la igualdad $(1)$ sabemos que lo último no ocurre. Así, $A_n \cap N = A_n$, lo que implica que $A_n\subseteq N$.

Hemos concluido entonces que para toda $n \geq m$ se tiene que $A_n\subseteq N$. Más aún, como para toda $5\leq n\leq m$ se tiene que $A_n\subseteq A_m$ y $A_m\subseteq N$, entonces para toda $n \geq 5$ se tiene que $A_n\subseteq N$. Así,

$$G= \bigcup_{5 \leq n} A_n\subseteq N$$

y al ser $N$ un subgrupo de $G$ tenemos que $G=N$. Esto es una contradicción porque al inicio establecimos que $N \neq G$. Así, $G$ es simple.

Por lo tanto, $G$ es un ejemplo de un grupo simple no abeliano e infinito.

Series de grupos

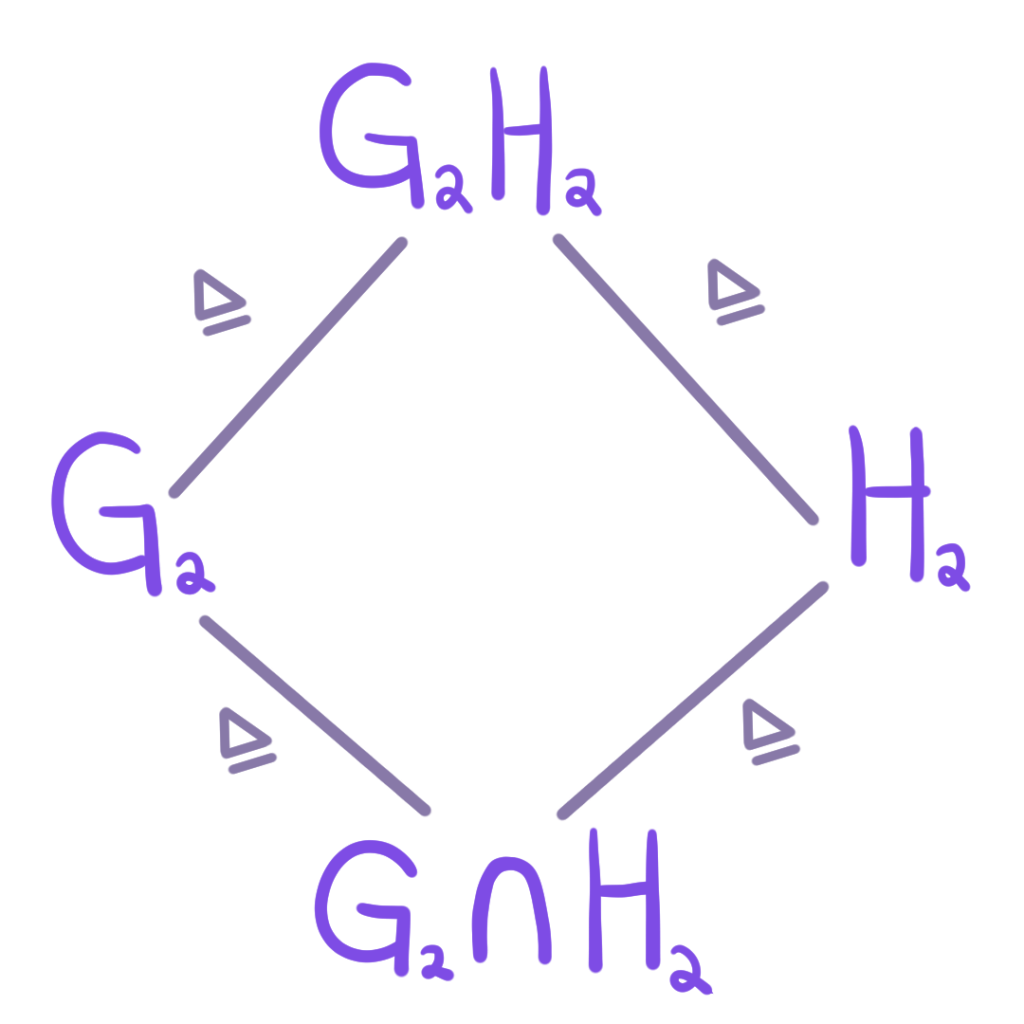

Definición. Sea $G$ un grupo. Una secuencia de subgrupos

\begin{align*}

G = G_1 \geq G_2 \geq \cdots \geq G_{k+1} = \{e\}

\end{align*}

es una serie de composición para $G$ si $G_{i+1} \unlhd G_{i}$ y $G_i/G_{i+1}$ es simple para toda $i\in\{1,\dots, k\}$.

Esto cocientes se llaman factores de composición.

A pesar de que estamos dando una definición, es importante señalar que en el caso de un grupo finito es el Cuarto teorema de isomorfía el que justifica que en efecto estas series de composición existen:

Proposición 1. Sean $G$ un grupo finito y $N$ un subgrupo normal propio de $G$ tal que es máximo con esta propiedad, es decir tal que si $N\leq H\lneq G$ con $H$ normal en $G$, entonces $N=H$. Se tiene que $G/N$ es simple.

Demostración.

Sean $G$ un grupo finito y $N$ un subgrupo normal de $G$ tal que es máximo con esta propiedad. Supongamos que $\mathcal{H}$ es un subgrupo normal de $G/N$ con $$\{e_{G/N}\}\leq \mathcal{H}\lneq G/N.$$ Por el Cuarto teorema de isomorfía sabemos que $\mathcal{H}=H/N$ para algún $N\leq H\lneq G.$ Además, como $\mathcal{H}\unlhd G/N$ sabemos que $H\unlhd G$. Pero al ser $N$ un subgrupo normal máximo tenemos que $N=H$ por lo cual $\mathcal{H}=N/N=\{e_{G/N}\}$. Así, $G/N$ es simple.

Proposición 2. Si $G$ es finito, estas series de composición existen.

Demostración (sencilla).

Si $G$ es trivial entonces $G$ mismo es una serie de composición para $G$.

Supongamos entonces que $G$ es no trivial. Consideramos $G_1=G$ y $G_2$ un subgrupo normal propio de $G$ tal que es máximo con esta propiedad. Entonces por la proposición 1 $G_1/G_2$ es simple.

Si $G_2=\{e\}$, $G_1\geq G_2$ es una serie de composición para $G$.

Si $G_2\neq\{e\}$ tomamos $G_3$ un subgrupo normal propio de $G_2$, máximo, y así sucesivamente. Como $G$ es finito este proceso termina y da lugar a una serie de composición para $G$.

$\blacksquare$

Ejemplos

Ejemplo 1. Tomemos $\z_{12}$. Notemos que en este caso el grupo es abeliano por lo que todos sus subgrupos son normales. Proponemos

\begin{align}\label{ejemplo1}

\z_{12} \unrhd \left<\bar{3}\right> \unrhd \left<\bar{6}\right> \unrhd\{\bar{0}\}.

\end{align}

Como $\left| \left<\bar{3}\right>\right| = 4$, entonces $\left| \z_{12} \Big/ \left<\bar{3}\right>\right| = \frac{12}{4} = 3$ y así $\z_{12} \Big/ \left<\bar{3}\right> \cong \z_3$ que es simple.

Sabemos que $\left| \left<\bar{6}\right> \right|= 2$, así $\left| \left<\bar{3}\right> \Big/ \left<\bar{6}\right>\right| = \frac{4}{2} = 2$ y entonces $ \left<\bar{3}\right> \Big/ \left<\bar{6}\right> \cong \z_2$ que es simple.

Finalmente $ \left<\bar{6}\right> \Big/ \{\bar{0}\} \cong \left<\bar{6}\right> \cong \z_2$ que es simple. Así $(\ref{ejemplo1})$ es una serie de composición para $\z_{12}$.

También $\z_{12} \unrhd \left<\bar{2}\right> \unrhd \left<\bar{6}\right> \unrhd \{\bar{0}\}$ lo es.

Ejemplo 2. Tomemos $D_{2(4)} = \{\text{id}, a, a^2, a^3, b, ab, a^2b, a^3b\}$. Donde $a$ es la rotación de $\frac{\pi}{4}$ y $b$ es la reflexión respecto al eje $x$.

Tenemos que

\begin{align*}

\left<a^2,b\right> = \{\text{id}, a^2, b, a^2b\}

\end{align*}

es de orden cuatro, entonces $\left[ D_{2(4)} : \left<a^2,b\right> \right] = 2$. Así $D_{2(4)} \unrhd \left< a^2, b \right>$ y $D_{2(4)}/ \left< a^2,b \right> \cong \z_2$ que es simple.

También $\left[ \left<a^2,b\right> : \left< b \right> \right] = 2$ y $ \left<a^2,b\right> / \left<b\right>\cong \z_2$ que es simple. Finalmente $\left< b \right> / \{\text{id}\} \cong \z_2$ que es simple.

Así,

\begin{align*}

D_{2(4)} \unrhd \left< a^2, b\right> \unrhd \left<b\right> \unrhd \{\text{id}\}

\end{align*}

es una serie de composición para $D_{2(4)}$.

También

\begin{align*}

D_{2(4)} \unrhd \left< a \right> \unrhd \left< a^2 \right> \unrhd \{\text{id}\}.

\end{align*}

Proposición 3. En una serie de composición $G_{i-1} \unrhd G_i$ pero no necesariamente $G \unrhd G_i$.

Observación 4. Puede ser que dos grupos no isomorfos tengan los mismos factores de composición salvo isomorfía.

Tarea moral

A continuación hay algunos ejercicios para que practiques los conceptos vistos en esta entrada. Te será de mucha utilidad intentarlos para entender más la teoría vista.

- Demuestra la proposición: Sea $n \in \n$ tal que $n \geq 5$. Entonces $A_n$ es simple.

- Considera la nota que aparece en esta entrada: hay grupos simples no abelianos finitos e infinitos.

- Encuentra un grupo simple no abeliano finito.

- ¿Qué pasará con los grupos abelianos infinitos? ¿existirán los grupos abelianos infinitos simples?

- Encuentra un grupo $G$ que cumpla la proposición 3: $G_{i-1} \unrhd G_i$ pero no necesariamente $G \unrhd G_i$.

- Describe un ejemplo de grupos tales que no sean isomorfos y tengan los mismos factores de composición salvo isomorfía.

- En cada uno de los siguientes casos encuentra todas las series de composición de $G$ y compara los factores de composición obtenidos:

- $G = \z_{60}$.

- $G = \z_{48}$.

- $S_3 \times \z_2.$

Más adelante…

Estos conceptos que pueden parecer muy sencillos, al combinarlos nos dan el último teorema que veremos en este curso: el Teorema de Jordan-Hölder. Una poderosa herramienta que nos dice que los factores de composición de dos series distintas de un mismo grupo son los mismos salvo isomorfía.

Entradas relacionadas