$\textit{MATERIAL EN REVISIÓN}$

Introducción

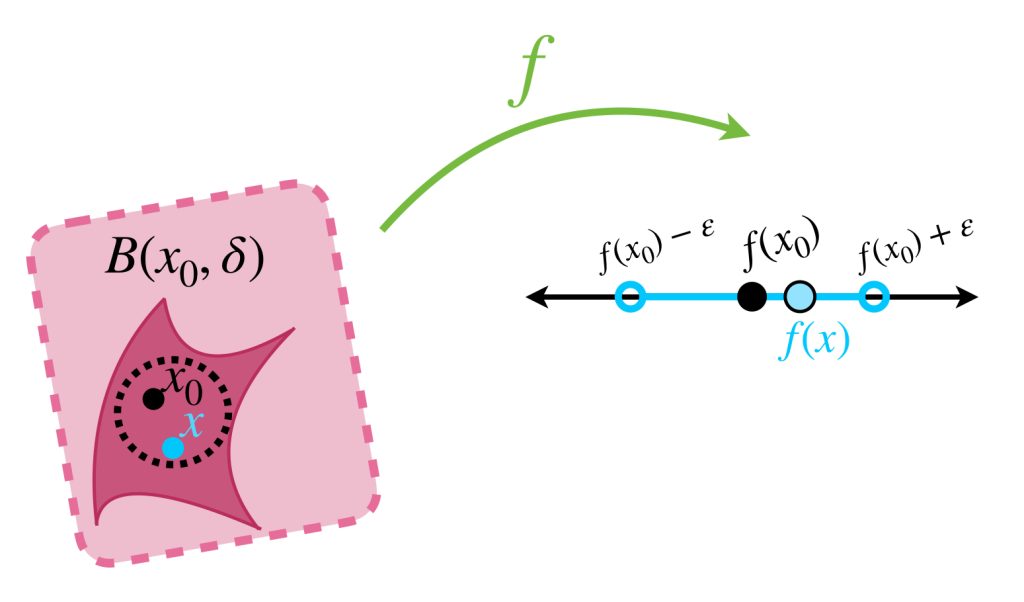

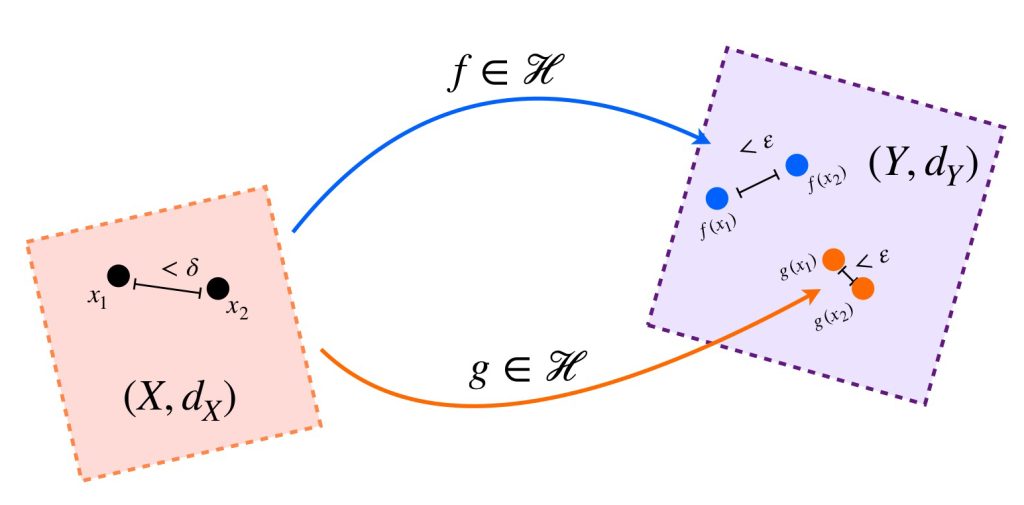

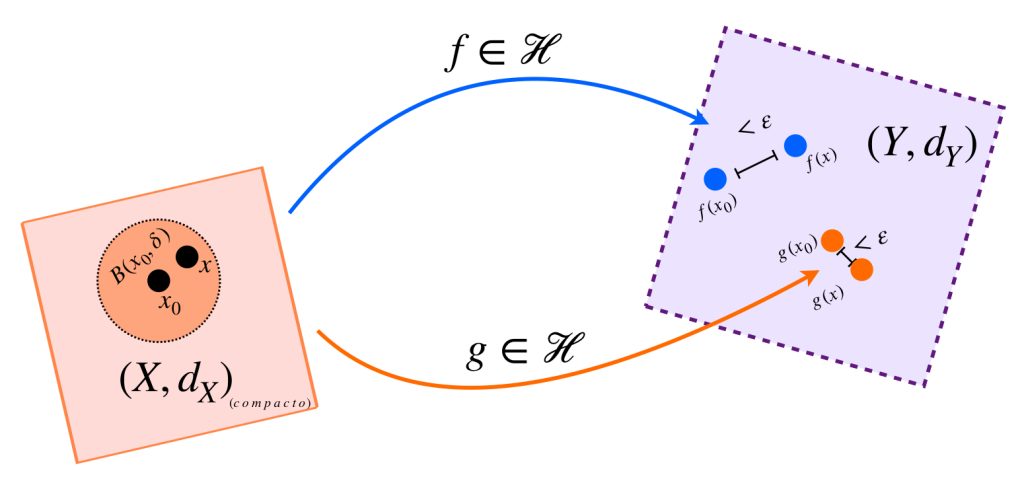

En la entrada anterior aprendimos que es posible acercarnos a funciones continuas que tienen su dominio en un intervalo cerrado en $\mathbb{R}.$ En esta sección probaremos que esta idea puede generalizarse en funciones cuyo dominio es un espacio métrico compacto. Presentamos el teorema y la demostración de dos lemas que usaremos para probarlo.

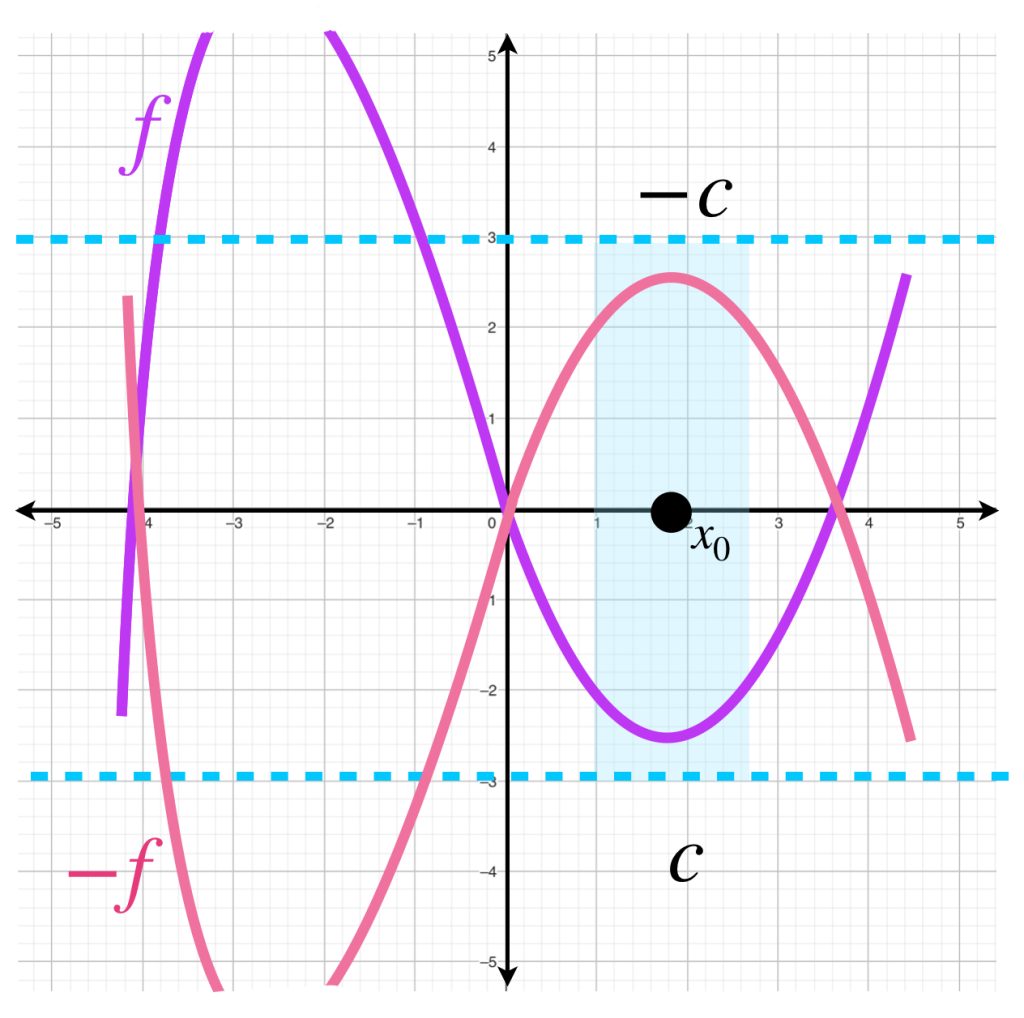

Teorema. Stone-Weierstrass. Sea $K$ un espacio métrico compacto. Sea $A \subset \mathcal{C}^0(K, \mathbb{R}),$ es decir, $A$ es un conjunto de funciones continuas de $K$ en $\mathbb{R}.$ Si $A$ satisface las siguientes propiedades:

a) Para cada $\lambda, \mu \, \in \mathbb{R}$ y $f,g \in A$ se cumple que $$\lambda f + \mu g \, \in A.$$ Esto es, $A$ es cerrado bajo combinaciones lineales.

b) Para cada $f,g \in A$ se cumple que $$f \cdot g \, \in A.$$ Esto es, $A$ es cerrado bajo producto de funciones.

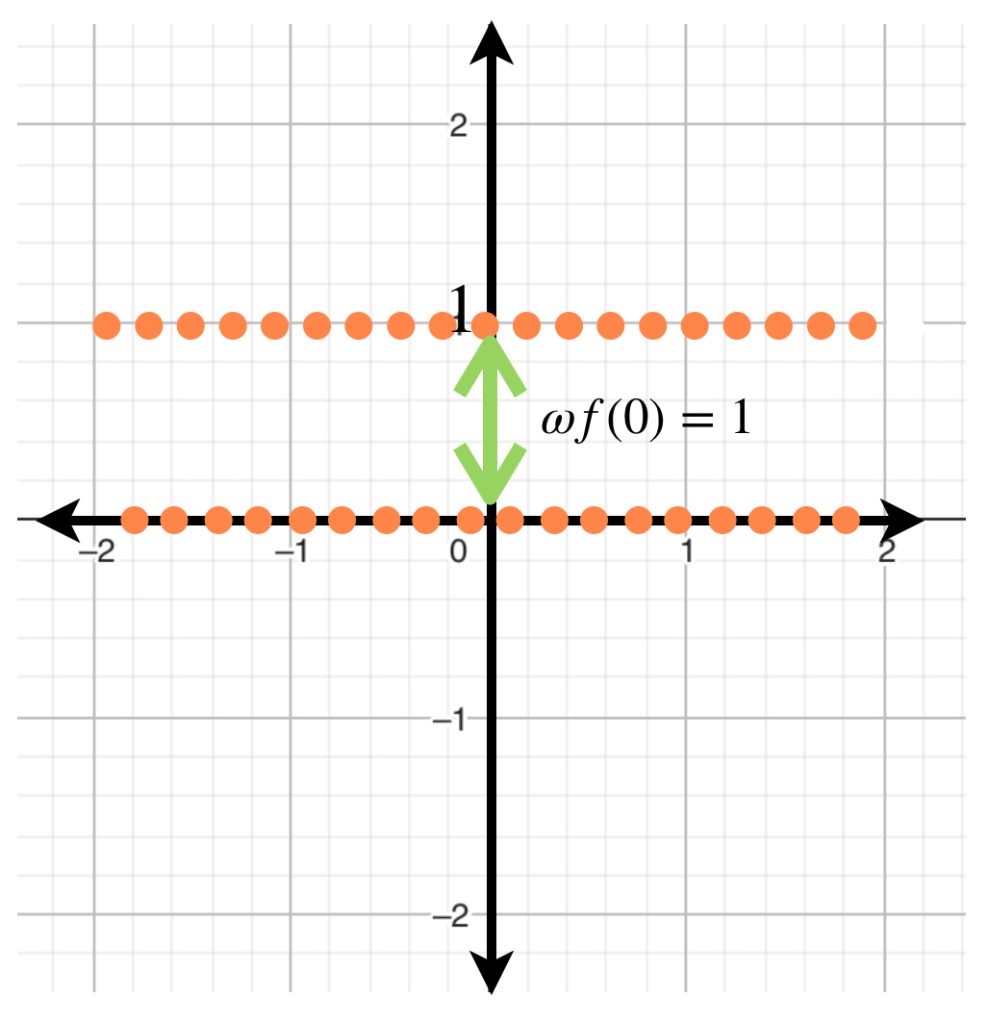

c) $1 \in A,$ donde $1$ es la función constante que para cada $x \in K$ asigna el valor $1.$

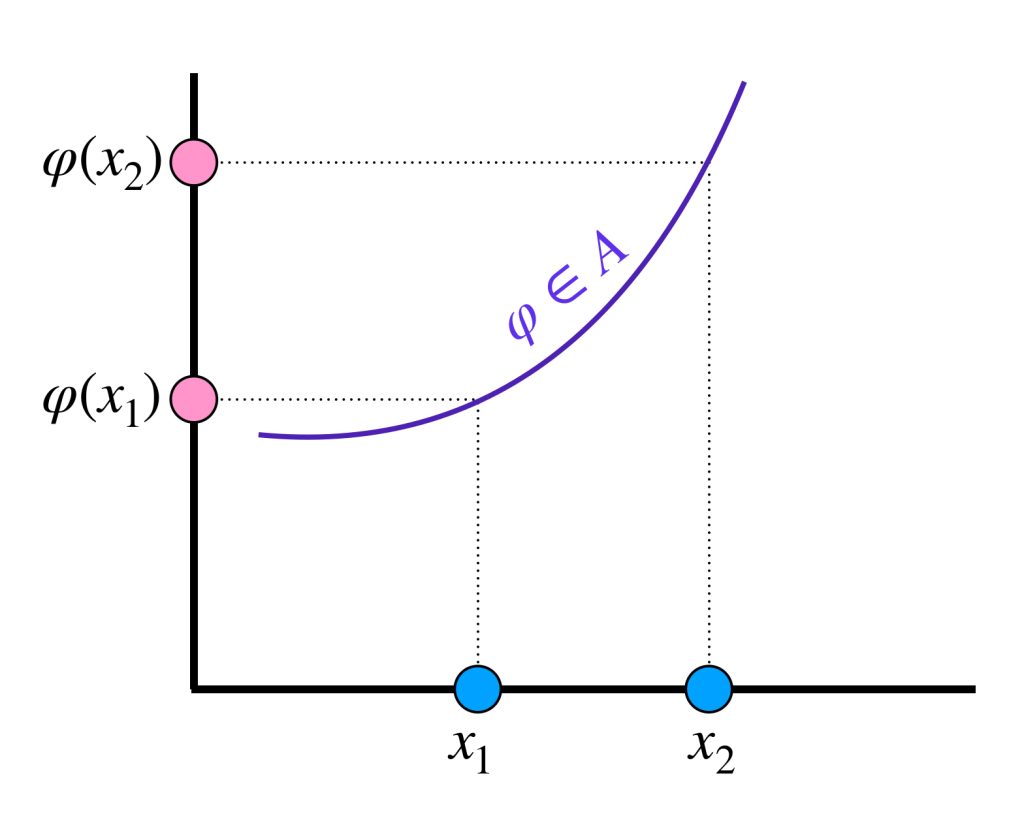

d) Para cualesquiera $x_1, x_2 \in K$ tales que $x_1 \neq x_2$ existe una función $\varphi \in A$ tal que $\varphi (x_1) \neq \varphi(x_2).$

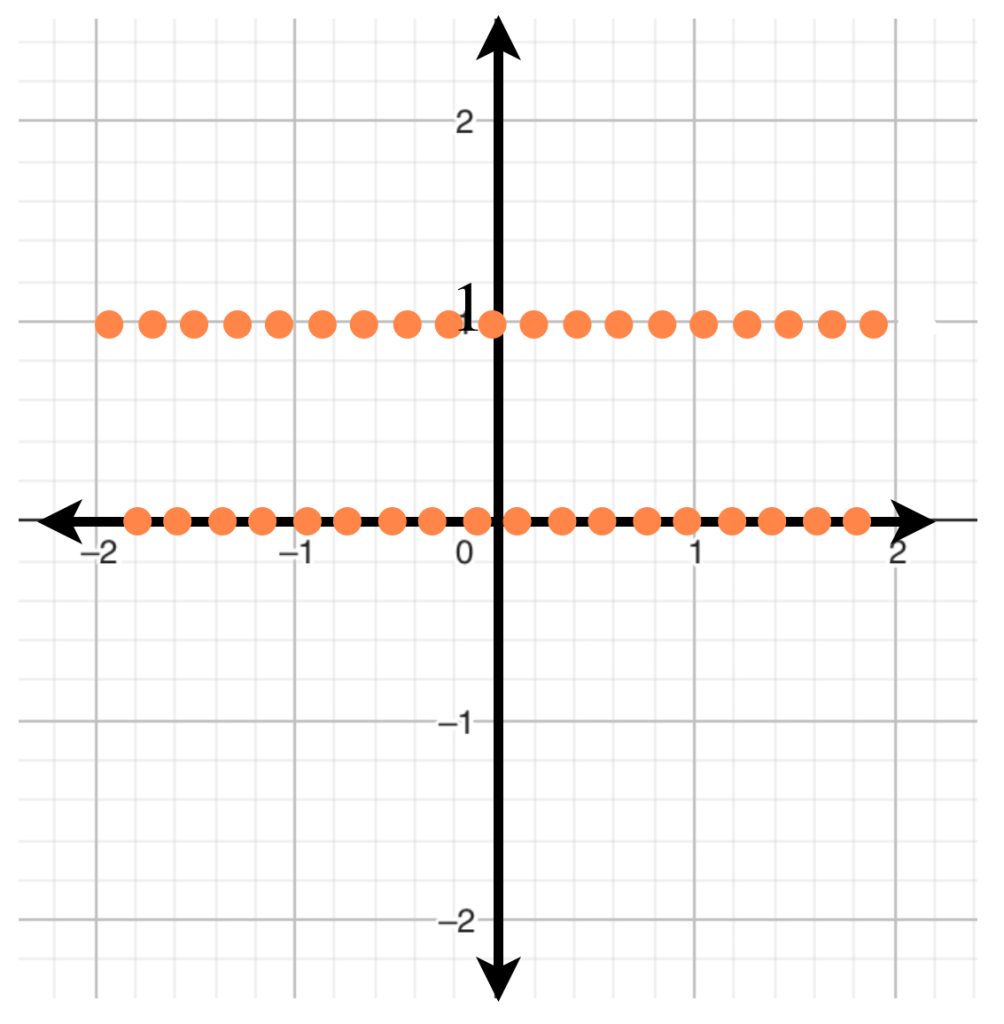

Entonces $A$ es denso en $\mathcal{C}^0(K, \mathbb{R}),$ es decir, $\overline{A}=\mathcal{C}^0(K, \mathbb{R}).$

Nota que esto significa que toda función continua $f: K \to \mathbb{R}$ está en la cerradura de $A$ y por lo visto en la entrada Convergencia, tenemos que $f$ puede aproximarse con funciones en $A$ según la métrica uniforme $d_\infty.$

La demostración de este teorema se hará a través de cuatro lemas. En el primero garantizaremos la existencia de una función que tome dos valores específicos en dos puntos específicos.

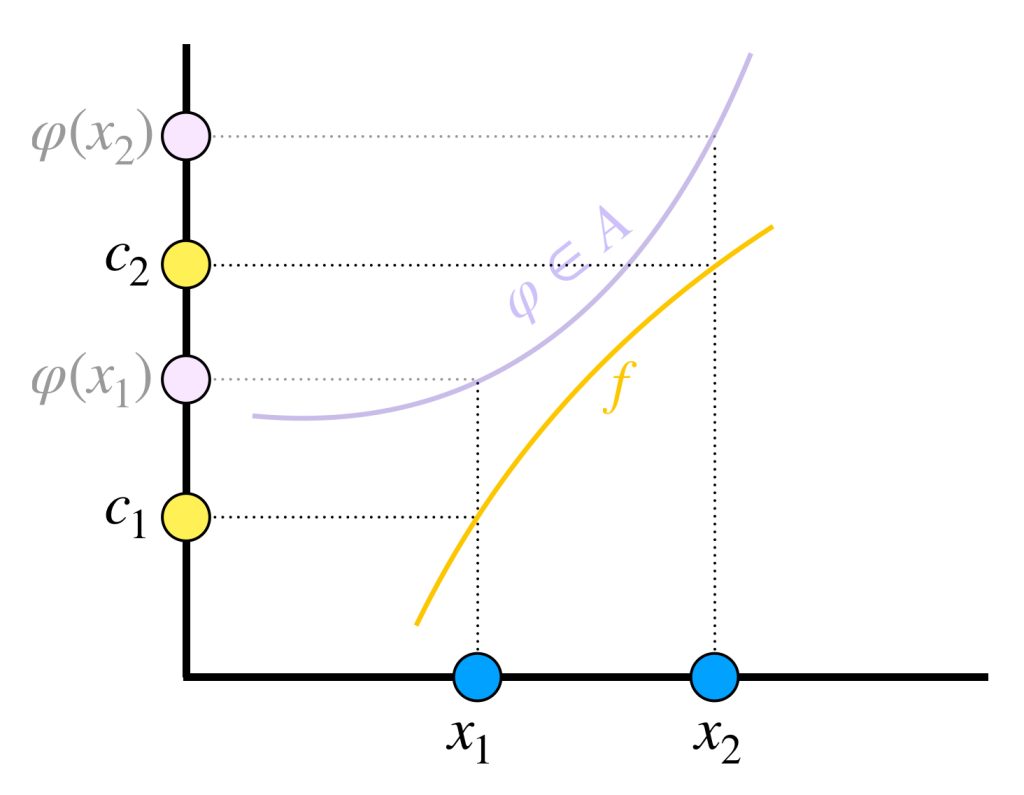

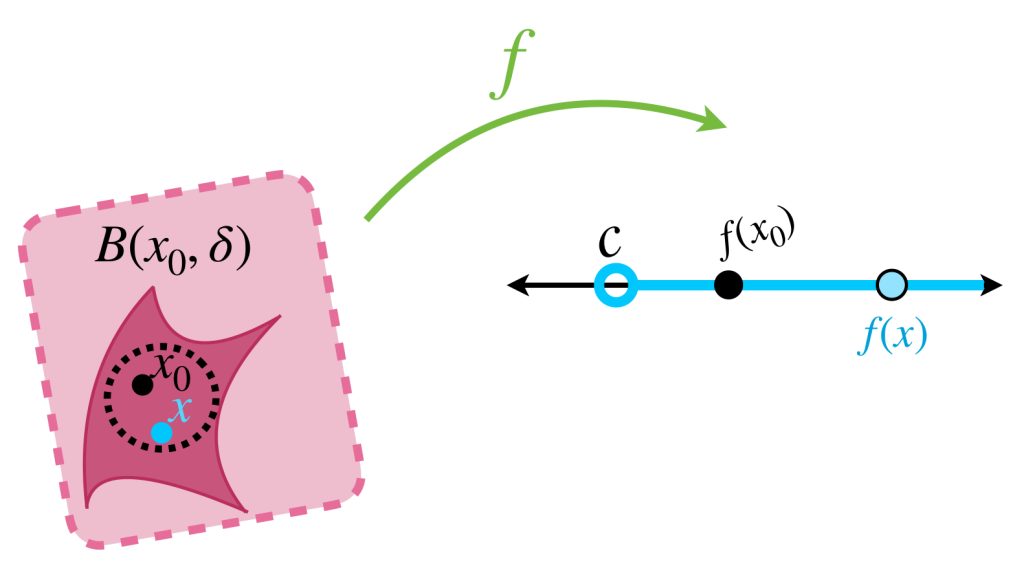

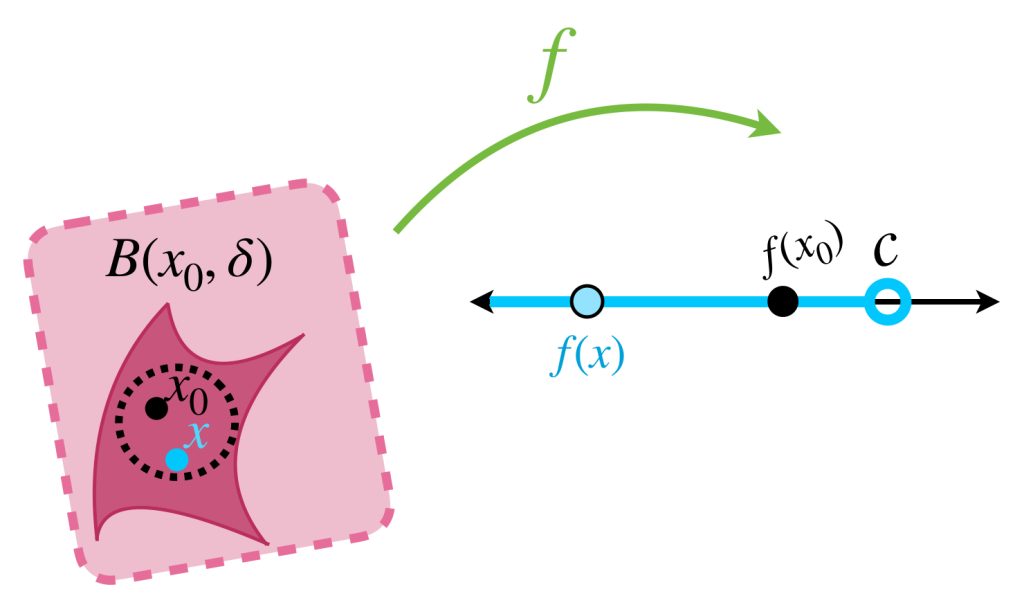

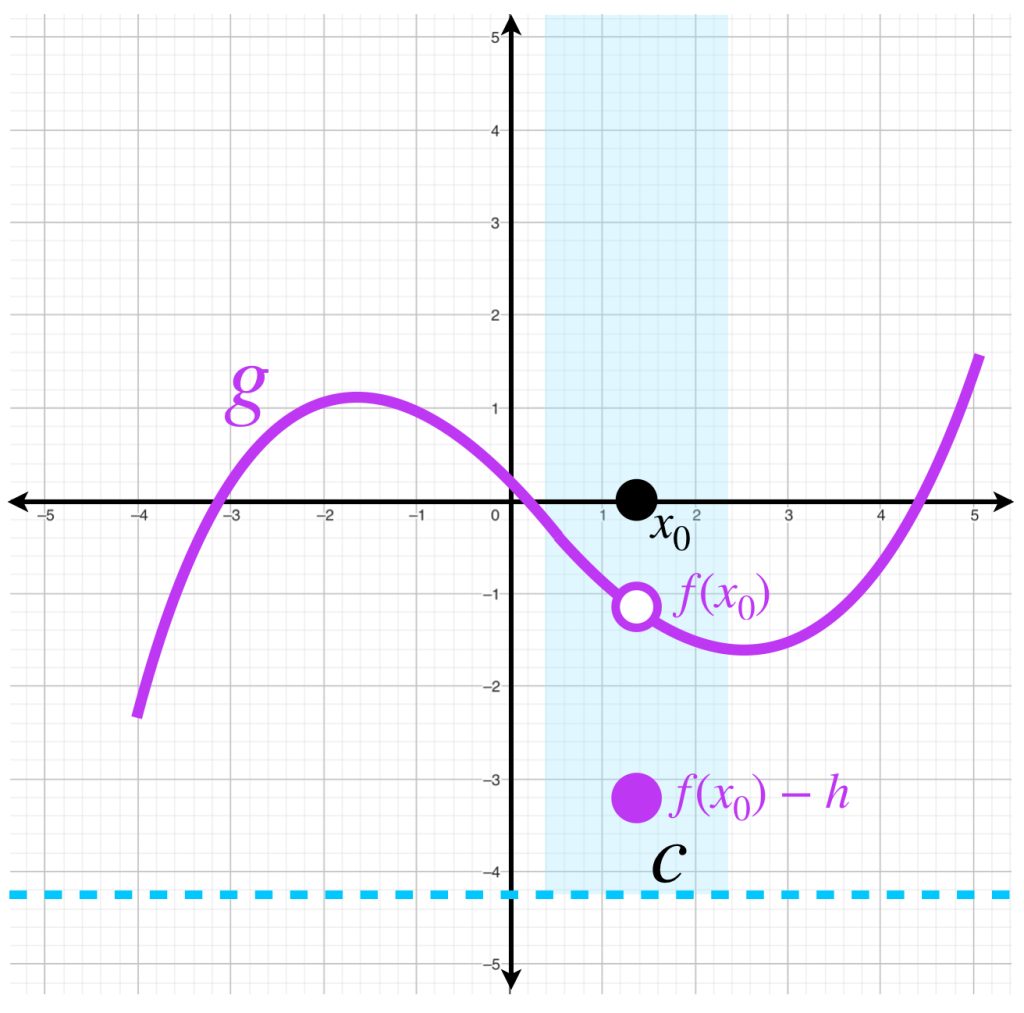

Lema 1: Sean $K$ y $A$ como en las hipótesis del teorema. Dados $x_1 \neq x_2 \in K$ y $c_1, c_2 \in \mathbb{R}$ existe $f \in A$ tal que $f(x_1) = c_1$ y $f(x_2) = c_2.$

Demostración:

De acuerdo con el inciso d), existe $\varphi \in A$ tal que $\varphi (x_1) \neq \varphi (x_2).$

Sin embargo buscamos $f$ que en $x_1$ vale específicamente $c_1$ y en $x_2$ vale $c_2.$

Veamos si dicha $f$ puede obtenerse como combinación lineal de $\varphi$ y la función constante $1,$ es decir que $f(x) = \lambda \varphi(x) + \mu 1$ para algunos $\lambda, \mu \in \mathbb{R}.$

Encontrar $\lambda$ y $\mu$ que satisfacen lo deseado equivale a resolver el sistema de ecuaciones

\begin{equation*}

\left\{

\begin{array}

\lambda \lambda \varphi(x_1) + \mu &= c_1 \\

\lambda \varphi(x_2) + \mu &= c_2

\end{array}

\right.

\end{equation*}

Según las fórmulas de Cramer para sistemas cuadrados, que pueden consultarse en Álgebra Lineal I: Determinantes en sistemas de ecuaciones lineales y regla de Cramer la solución existe y es única si y solo sí el determinante de la matriz de coeficientes dada por

\begin{equation*}

\left|

\begin{array}{cc}

\varphi(x_1) & 1 \\

\varphi(x_2) & 1

\end{array}

\right|

\end{equation*}

satisface:

\begin{equation*}

\left|

\begin{array}{cc}

\varphi(x_1) & 1 \\

\varphi(x_2) & 1

\end{array}

\right| = \varphi(x_1) \, – \, \varphi(x_2) \neq 0

\end{equation*}

Lo cual sí ocurre, pues $\varphi(x_1) \neq \varphi(x_2) \, \Rightarrow \, \varphi(x_1) \, – \, \varphi(x_2) \neq 0.$

Por lo tanto existe la solución única al sistema de ecuaciones y así existe $f \in A$ con $f(x) = \lambda \varphi(x) + \mu \,$ tal que $\, f(x_1) = c_1$ y $f(x_2) = c_2.$

Lema 2: Si $A \subset \mathcal{C}^0(K, \mathbb{R})$ es tal que tiene las propiedades a), b), c) del teorema, entonces $\overline{A}$ también las tiene.

Demostración:

a) Sean $\lambda, \mu \in \mathbb{R}$ y $\varphi, \, \gamma \in \overline{A},$ queremos probar que $\lambda \varphi + \mu \gamma$ también está en $\overline{A}.$

Como $\varphi \in \overline{A}$ entonces, por lo visto en Convergencia sabemos que existe una sucesión $(f_n)_{n \in \mathbb{N}} \,$ de elementos de $A$ tales que $f_n \to \varphi,$ es decir

\begin{align}

\underset{n \to \infty}{lim} \, f_n = \varphi.

\end{align}

De igual manera existe una sucesión $(g_n)_{n \in \mathbb{N}} \,$ de elementos de $A$ tales que $g_n \to \gamma,$ es decir

\begin{align}

\underset{n \to \infty}{lim} \, g_n = \gamma.

\end{align}

Ya que para cada $n \in \mathbb{N}$ se cumple que $\lambda f_n + \mu g_n \, \in A.$ Si demostramos que la sucesión $(\lambda f_n + \mu g_n)_{n \in \mathbb{N}} \, $ converge a $\lambda \varphi + \mu \gamma \,$ esto probaría que $ \lambda \varphi + \mu \gamma \in \overline{A}.$ Probemos que $\underset{n \to \infty}{lim} \, d_\infty(\lambda f_n + \mu g_n, \, \lambda \varphi + \mu \gamma)=0.$ Sea $\varepsilon >0.$ Por 1) y 2) sabemos que existen $N_1$ y $N_2 \in \mathbb{N}$ tales que para cada $n \geq N_1,$

$$d_\infty(f_n, \varphi) < \frac{\varepsilon}{2|\lambda|}$$

Y así

\begin{align*}

\textcolor{blue}{|\lambda|d_\infty(f_n, \varphi) < \frac{\varepsilon}{2}}

\end{align*}

Y para cada $n \geq N_2,$

$$d_\infty(g_n, \gamma) < \frac{\varepsilon}{2|\mu|}$$

Y así

\begin{align*}

\textcolor{purple}{|\mu|d_\infty(g_n, \gamma) < \frac{\varepsilon}{2}}.

\end{align*}

Entonces para cada $n \geq max\{N_1,N_2\}$ y para cada $x \in K$ tenemos:

\begin{align*}

d(\lambda f_n(x) + \mu g_n(x), \, \lambda \varphi(x) + \mu \gamma(x)) &= |\lambda f_n(x) + \mu g_n(x) \, – \, \lambda \varphi(x) \, – \, \mu \gamma(x)|\\

&= |\lambda f_n(x) \, – \, \lambda \varphi(x)+ \mu g_n(x) \, – \, \mu \gamma(x)|\\

&\leq |\lambda f_n(x) \, – \, \lambda \varphi(x)|+ |\mu g_n(x) \, – \, \mu \gamma(x)|\\

&= |\lambda|| f_n(x) \, – \, \varphi(x)|+ |\mu|| g_n(x) \, – \, \gamma(x)|\\

&\leq \textcolor{blue}{|\lambda|d_\infty(f_n,f)}+ \textcolor{purple}{|\mu|d_\infty(g_n, \gamma)}\\

&<\textcolor{blue}{\frac{\varepsilon}{2}}+\textcolor{purple}{\frac{\varepsilon}{2}}\\

&= \varepsilon.

\end{align*}

Por lo tanto $d_\infty(\lambda f_n + \mu g_n, \, \lambda \varphi + \mu \gamma) \to 0$ y así $(\lambda f_n + \mu g_n)_{n \in \mathbb{N}} \, \to \, \lambda \varphi + \mu \gamma$ lo que demuestra que $\lambda \varphi + \mu \gamma \, \in \overline{A}.$

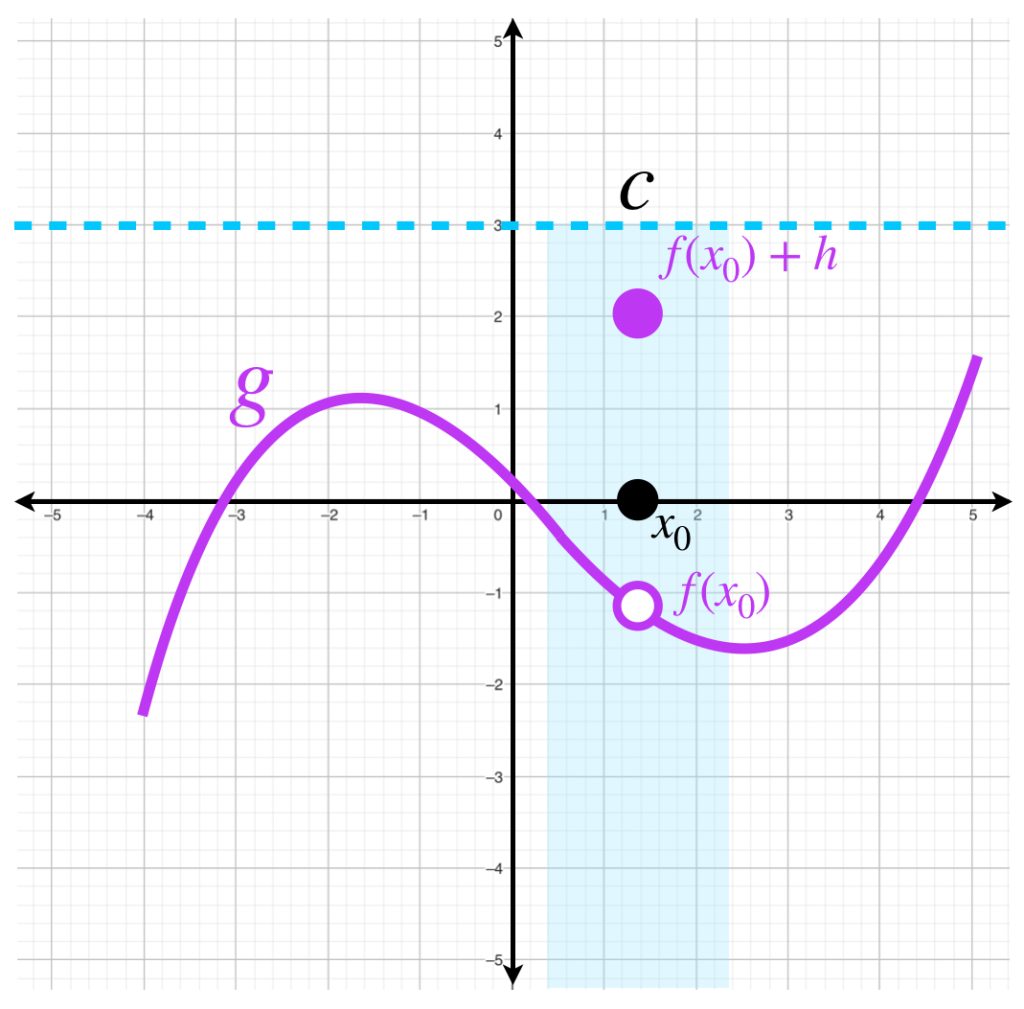

b) Buscamos demostrar que para cualesquiera $\varphi, \, \gamma \in \overline{A}$ también se cumple que $\varphi \cdot \gamma \in \overline{A}.$

Ya que para cada $n \in \mathbb{N}$ se cumple que $f_n \cdot g_n \, \in A.$ Si demostramos que la sucesión $(f_n \cdot g_n)_{n \in \mathbb{N}} \, $ converge a $\varphi \cdot \gamma \,$ esto probaría que $ \varphi \cdot \gamma \in \overline{A}.$

Probemos entonces que $\, \underset{n \to \infty}{lim} \, d_\infty(f_n \cdot g_n, \, \varphi \cdot \gamma) = 0.$ Esto se logrará si conseguimos acotar el valor de $d(f_n (x) \cdot g_n(x), \, \varphi(x) \cdot \gamma(x)) \in \mathbb{R}$ para cada $x \in K.$

Dado que $\varphi, \, \gamma$ son continuas en un compacto, concluimos que son acotadas en el dominio. Así existen reales mayores que cero $M_1$ y $M_2$ tales que para cada $x \in K:$

\begin{align}

\textcolor{green}{|\varphi(x)|}&\leq \textcolor{green}{M_1}\, \, \text{ y }\\

|\gamma(x)|&\leq M_2.

\end{align}

Por otro lado, como $\underset{n \to \infty}{lim} \, g_n = \gamma,$ existe $N_3 \in \mathbb{N}$ tal que para cada $n \geq N_3, \, |g_n(x) \, – \, \gamma(x)| \leq 1.$ Entonces

\begin{align*}

&&-1 &\leq & &g_n(x) \, – \, \gamma(x)& &\leq 1\\

&\Rightarrow& -1+\gamma(x) &\leq& &g_n(x)& &\leq 1+\gamma(x)\\

&\Rightarrow& -1-M_2 \leq -1+\gamma(x) &\leq& &g_n(x)& &\leq 1+\gamma(x) \leq 1+M_2

\end{align*}

Por lo tanto si $n \geq N_3,$

\begin{align}

\textcolor{orange}{|g_n(x)|}\leq \textcolor{orange}{M_2 +1}.

\end{align}

Además, por 1) y 2) sabemos que para cada $\varepsilon >0$ existen $N_4$ y $N_5 \in \mathbb{N}$ tal que para cada $n \geq N_4$

$$\textcolor{purple}{d_\infty(f_n, \varphi) < \frac{\varepsilon}{2(M_2+1)}},$$

y para $n \geq N_5,$

$$\textcolor{magenta}{d_\infty(g_n, \gamma) < \frac{\varepsilon}{2M_1}}.$$

De lo anterior se sigue que para cada $n \geq max \{N_3, N_4, N_5\}$

\begin{align*}

|f_n (x) \cdot g_n(x) \, – \, \varphi(x) \cdot \gamma(x)|&= |f_n (x) \cdot g_n(x) \, \textcolor{blue}{- \, \varphi(x) \cdot g_n(x)+\varphi(x) \cdot g_n(x)}- \, \varphi(x) \cdot \gamma(x)|\\

&\leq |f_n (x) \cdot g_n(x) \, – \, \varphi(x) \cdot g_n(x)|+|\varphi(x) \cdot g_n(x)- \, \varphi(x) \cdot \gamma(x)|\\

&= \textcolor{orange}{|g_n(x)|}\cdot|f_n(x) \, – \, \varphi(x)|+\textcolor{green}{|\varphi(x)|}\cdot |g_n(x)-\gamma(x)|\\

&\leq \textcolor{orange}{(M_2 +1)}\textcolor{purple}{|f_n(x) \, – \, \varphi(x)|} + \textcolor{green}{M_1} \textcolor{magenta}{|g_n(x)-\gamma(x)|}\\

&< (M_2 +1)\textcolor{purple}{\frac{\varepsilon}{2(M_2+1)}} + M_1\textcolor{magenta}{\frac{\varepsilon}{2M_1}}\\

&= \varepsilon

\end{align*}

Por lo tanto $\, \underset{n \to \infty}{lim} \, d_\infty(f_n \cdot g_n, \, \varphi \cdot \gamma) = 0$ y así $(f_n \cdot g_n)_{n \in \mathbb{N}} \, \to \, \varphi \cdot \gamma \,$ lo que demuestra que $\varphi \cdot \gamma \in \overline{A}.$

c) Dado que la función $1 \in A$ se sigue que $1 \in \overline{A}$ pues $A \subset \overline{A}.$

Más adelante…

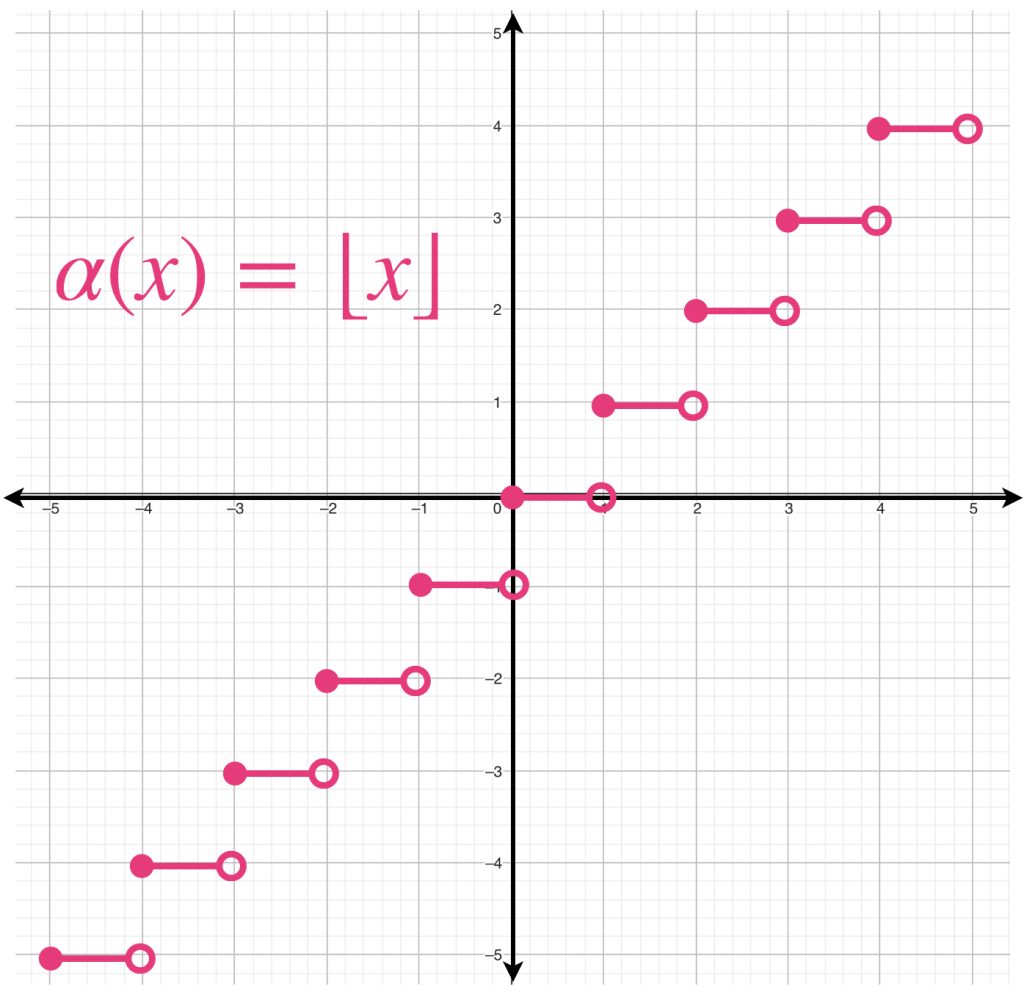

Veremos dos lemas más que necesitamos en la demostración del teorema de Stone-Weierstrass. Por el momento sugerimos trabajar con los siguientes ejercicios para desarrollar más la idea de densidad.

Tarea moral

- Sea $X$ un espacio métrico y sean $Z$ y $Y$ tales que $Z \subset Y \subset X$ y $Z$ es denso en $X.$ Demuestra que $Y$ es denso en $X.$

- Sea $\phi: X \to Y$ continua y suprayectiva. Demuestra que si $A$ es denso en $X,$ entonces $\phi(A)$ es denso en $Y.$

- Antes dos definiciones:

Un conjunto $A$ es a lo más numerable si existe una función inyectiva $f:A \to \mathbb{N}.$

Un espacio métrico es separable si contiene un subconjunto que es a lo más numerable y denso en $X.$

Demuestra que todo espacio métrico compacto es separable. Se recomienda tomar un conjunto finito de bolas de radio $\frac{1}{k}$ para cada $k \in \mathbb{N}$ cuya unión es $X.$

Bibliografía

- Bartle, R.G., The Elements of Real Analysis. New York: J. Wiley, 1964. Págs: 184-186.

- Clapp, M., Análisis Matemático. Ciudad de México: Editorial Papirhos, IM-UNAM, 2013. Págs: 154-158.

- Rudin, W., Principles of Mathematical Analysis (3rd ed.). New York: McGraw–Hill, 1953. Págs: 159-165.