(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

INTRODUCCIÓN

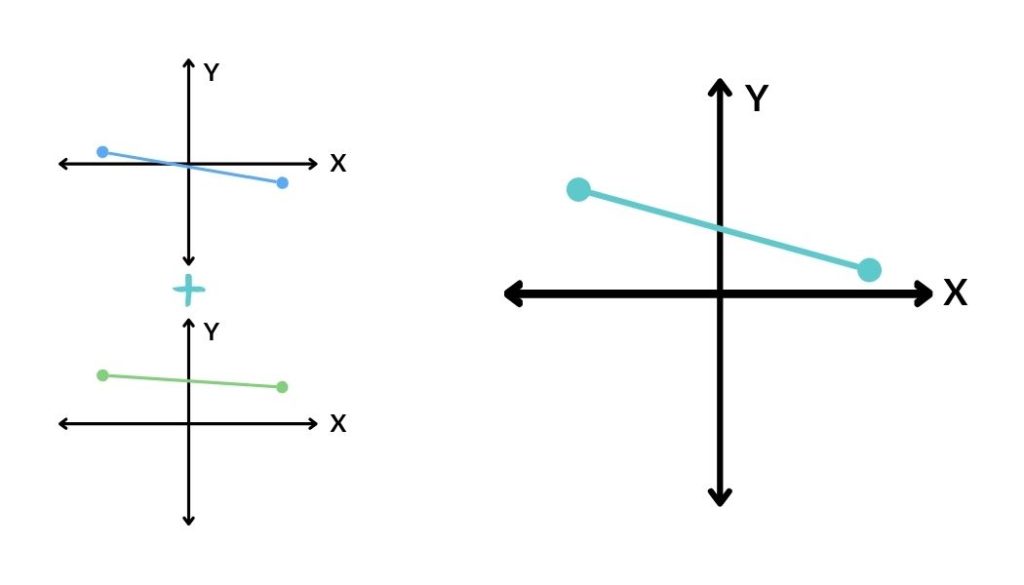

Cuando transformamos un objeto en el espacio, como girarlo, estirarlo o reflejarlo, estamos realizando una acción que puede parecer sencilla, pero que encierra ideas matemáticas muy poderosas. Las transformaciones lineales nos permiten describir estos cambios con precisión, y entender cómo afectan a los puntos y estructuras dentro de un espacio. Pero, ¿qué ocurre cuando aplicamos varias transformaciones una tras otra? ¿Se pueden combinar en una sola acción? Aquí es donde entra en juego la composición de transformaciones.

Pues así sucede con la composición de transformaciones

Además, existe una transformación muy especial: aquella que no cambia nada. Aunque pueda parecer trivial, la transformación identidad juega un papel clave como punto de partida o referencia en este mundo de cambios. Explorar cómo se combinan las transformaciones lineales y cómo actúa la identidad nos permite ver la estructura profunda detrás de muchos procesos matemáticos y físicos. ¡Vamos a descubrir cómo funciona este lenguaje de transformaciones!

COMPOSICIÓN DE TRANSFORMACIONES LINEALES

Definición: Sean $U,V,W$ $K$ – espacios vectoriales y $T\in\mathcal{L}(V,W)$, $S\in\mathcal{L}(W,U)$. Definimos la composición de $S$ con $T$ como $S\circ T:V\longrightarrow U$ donde $\forall v\in V((S\circ T)(v)=S(T(v)))$

Ejemplos

- Sean $T_1 , T_2 \in \mathcal{L}(\mathbb{R}^2 , \mathbb{R}^2)$ definidas para todo $(x,y) \in \mathbb{R}^2$ como:

$T_1 (x,y) = (3x , 3y)$

$T_2 (x,y) = (-y , x)$

$(T_1 \circ T_2)(x,y) = (-3y , 3x) = (T_2 \circ T_1)(x,y)$

Justificación. Sea $(x,y) \in \mathbb{R}^2$

$(T_1 \circ T_2)(x,y) = T_1 (T_2 (x,y) )$ $= T_1 (-y , x) = (-3y , 3x)$

$(T_2 \circ T_1)(x,y) = T_2 (T_1 (x,y) )$ $= T_2 (3x , 3y) = (-3y , 3x)$

- Sean $T_1 , T_2 \in \mathcal{L}(\mathbb{R}^2 , \mathbb{R}^2)$ definidas para todo $(x,y) \in \mathbb{R}^2$ como:

$T_1 (x,y) = (y , x)$

$T_2 (x,y) = (x , 2y)$

$(T_1 \circ T_2)(x,y) = (2y , x)$

$(T_2 \circ T_1)(x,y) = (y , 2x)$

Justificación. Sea $(x,y) \in \mathbb{R}^2$

$(T_1 \circ T_2)(x,y) = T_1 (T_2 (x,y) )$ $= T_1 (x , 2y) = (2y , x)$

$(T_2 \circ T_1)(x,y) = T_2 (T_1 (x,y) )$ $= T_2 (y , x) = (y , 2x)$

Teorema (2.6.1.): La composición de transformaciones lineales es lineal.

Demostración: Sean $U,V,W$ $K$ – espacios vectoriales y $T\in\mathcal{L}(V,W)$, $S\in\mathcal{L}(W,U)$.

P.D. $S\circ T\in\mathcal{L}(V,U)$.

Sean $x,y\in V$ y $\lambda\in K$.

Entonces $(S\circ T)(\lambda x + y)=S(T(\lambda x + y))$$=S(\lambda T(x) + T(y))=\lambda S(T(x)) + S(T(y))$$=\lambda (S\circ T)(x) + (S\circ T)(y)$.

Como $(S\circ T)(\lambda x + y)=\lambda (S\circ T)(x) + (S\circ T)(y)$, entonces $S\circ T\in\mathcal{L}(V,U)$.

Observación: La composición de transformaciones lineales es asociativa.

Proposición (2.6.2.): Sean $U,V,W$ $K$ – espacios vectoriales, $T_1, T_2\in\mathcal{L}(V,W)$ y $S_1,S_2\in\mathcal{L}(W,U)$. Se cumple que:

a) $(S_1+S_2)\circ T_1=(S_1\circ T_1)+(S_2\circ T_1)$

b) $S_1\circ (T_1+T_2)=(S_1\circ T_1)+(S_1\circ T_2)$

Demostración: Sea $v\in V$.

a) $((S_1+S_2)\circ T_1)(v)=(S_1+S_2)(T_1(v))=S_1(T_1(v))+S_2(T_1(v))$$=(S_1\circ T_1)(v)+(S_2\circ T_1)(v)=((S_1\circ T_1)+(S_2\circ T_1))(v)$

Como $\forall v\in V(((S_1+S_2)\circ T_1)(v)=((S_1\circ T_1)+(S_2\circ T_1))(v))$, entonces $(S_1+S_2)\circ T_1=(S_1\circ T_1)+(S_2\circ T_1)$.

b) $(S_1\circ (T_1+T_2))(v)=S_1((T_1+T_2)(v))=S_1(T_1(v)+T_2(v))$$=S_1(T_1(v))+S_1(T_2(v))=(S_1\circ T_1)(v) + (S_1\circ T_2)(v)$$=((S_1\circ T_1)+(S_1\circ T_2))(v)$

Como $\forall v\in V ((S_1\circ (T_1+T_2))(v)=(S_1\circ T_1)+(S_1\circ T_2))$

Observación: Si $V$ es un $K$ – espacio vectorial y definimos $T:V\longrightarrow V$ como $T(v)=v$ para toda $v\in V$, entonces $T\in\mathcal{L}(V,V)$. Porque para cualesquiera $u, v\in V$ y $\lambda\in K$ tenemos que $T (\lambda u + v)=\lambda u + v = \lambda T (u) + T (v)$.

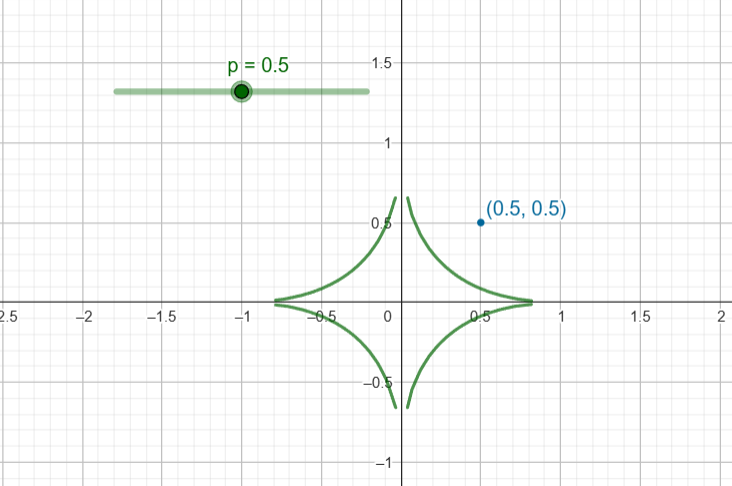

TRANSFORMACIÓN IDENTIDAD

Definición: Sea $V$ un $K$ – espacio vectorial. Definimos la transformación identidad en $V$ como $id_V:V\longrightarrow V$ donde $\forall v\in V(id_V (v)=v)$

Observación: Sean $V,W$ $K$ – espacios vectoriales y $T\mathcal{L}(V,W)$. Se tiene que $id_W\circ T=T$ y $T\circ id_V=T$. Porque para cualquier $v\in V$ tenemos que $(id_W\circ T)(v)=id_W(T(v))=T(v)$ y $(T\circ id_V)(v)=T(id_V(v))=T(v)$.

Nota: En los cursos básicos de Cálculo se demuestra que si tenemos dos conjuntos $A$ y $B$ y una función $f:A\longrightarrow B$, entonces $f$ es invertible si y sólo si $f$ es biyectiva. Donde se define $f$ invertible como una función para la cual existe una función, denotada como $f^{-1}:B\longrightarrow A$, tal que $f^{-1}\circ f=id_A$ y $f\circ f^{-1}=id_B$.

Proposición (2.6.3.): Sean $V,W$ $K$ – espacios vectoriales y $T\in\mathcal{L}(V,W)$.

Si $T$ es invertible, entonces $T^{-1}\in\mathcal{L}(W,V)$.

Demostración: Sup. $T$ es invertible, i.e. $\exists T^{-1}:W\longrightarrow V$ tal que $T^{-1}\circ T=id_V$ y $T\circ T^{-1}=id_W$.

Entonces la Nota nos asegura que $T$ es biyectiva.

Sean $w_1,w_2\in W$ y $\lambda\in K$.

Como $T$ es suprayectiva, entonces $\exists v_1,v_2\in V$ tales que $T(v_1)=w_1$ y $T(v_2)=w_2$.

Así, $T^{-1}(\lambda w_1+w_2)=T^{-1}(\lambda T(v_1)+T(v_2))$$=T^{-1}(T(\lambda v_1+v_2))=(T^{-1}\circ T)(\lambda v_1+v_2)=id_V(\lambda v_1+v_2)$$=\lambda v_1+v_2$.

Tenemos que $T^{-1}(\lambda w_1+w_2)=\lambda v_1+v_2$.

Ahora bien, $v_1=Id_V(v_1)=(T^{-1}\circ T)(v_1)=T^{-1}(T(v_1))=T^{-1}(w_1)$ y análogamente $v_2=T^{-1}(w_2)$.

Entonces $T^{-1}(\lambda w_1+w_2)=\lambda v_1+v_2=\lambda T^{-1}(w_1)+T^{-1}(w_2)$.

Por lo tanto, $T^{-1}\in\mathcal{L}(V,W)$.

Tarea Moral

- Demuestra que la composición de transformaciones lineales es asociativa.

- Sean $T, S : \mathbb{R}[x] \longrightarrow \mathbb{R}[x]$ definidas para todo $f(x) \in \mathbb{R}[x]$:

$T ( f(x) ) = \int_0^x f(t) dt$

$S ( f(x) ) = \int f(x) dx$ con constante de integración $C = 0$

Demuestra si $S \circ T = T \circ S$ o da un contraejemplo.

Más adelante…

Ahora veremos la equivalencia que existe entre $5$ breves enunciados que ya dominamos y que comprendemos bien lo que nos dicen sobre la estructura de las transformaciones.

Además aparecerá un nuevo concepto vital no solo en Álgebra Lineal, sino en las Matemáticas como ciencia… posiblemente ya lo haz visto antes: Isomorfismo.

Entradas relacionadas

- Ir a Álgebra Lineal I

- Entrada anterior del curso: 2.5. TRANSFORMACIONES LINEALES ENTRE DOS ESPACIOS: operaciones para formar un espacio vectorial

- Siguiente entrada del curso: 2.7. TRANSFORMACIONES LINEALES INVERTIBLES E ISOMORFISMOS: definiciones, equivalencias y propiedades