(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

INTRODUCCIÓN

El desarrollo de esta entrada consiste en un solo teorema (que nos habla únicamente de la existencia de «algo»… «algo» impresionante) y un solo ejemplo. ¿En qué consiste su relevancia?

La demostración del teorema, nos dice paso a paso la construcción de ese «algo» (que no es ninguna sorpresa, pues hay una pista en el adelanto que se dio en la entrada anterior).

Recordemos que la cantidad de vectores en una base dependerá de la dimensión del espacio.

Ahora bien, el teorema no solo es importante por asegurar la existencia y dar la construcción. De hecho, los requisitos no son más que pedir dimensión finita en el espacio vectorial y que se tenga un producto interno. Es decir, este teorema junta todos los conceptos que estuvimos viendo tan breve pero intensamente en las entradas anteriores: producto interno, conjuntos ortogonales, coeficientes de Fourier y norma… y todo esto se une para la construcción de BASES ORTOGONALES. Así que, sí, el enunciado es muy breve, pero su carga y demostración lo vuelven esencial.

Teorema (4.6.1. Gram Schmidt): Sean $K=\mathbb{R}$ o $K=\mathbb{C}$ y $V$ un $K$ – espacio vectorial de dimensión finita con producto interno $\langle \;\; , \; \rangle$. Entonces $V$ tiene una base ortogonal.

Demostración: Sean $K=\mathbb{R}$ o $K=\mathbb{C}$ y $V$ un $K$ – espacio vectorial de dimensión finita con producto interno $\langle \;\; , \; \rangle$. Supongamos $\dim V = n$ y que $B = \{ v_1 , … , v_n \}$ una base ordenada de $V$.

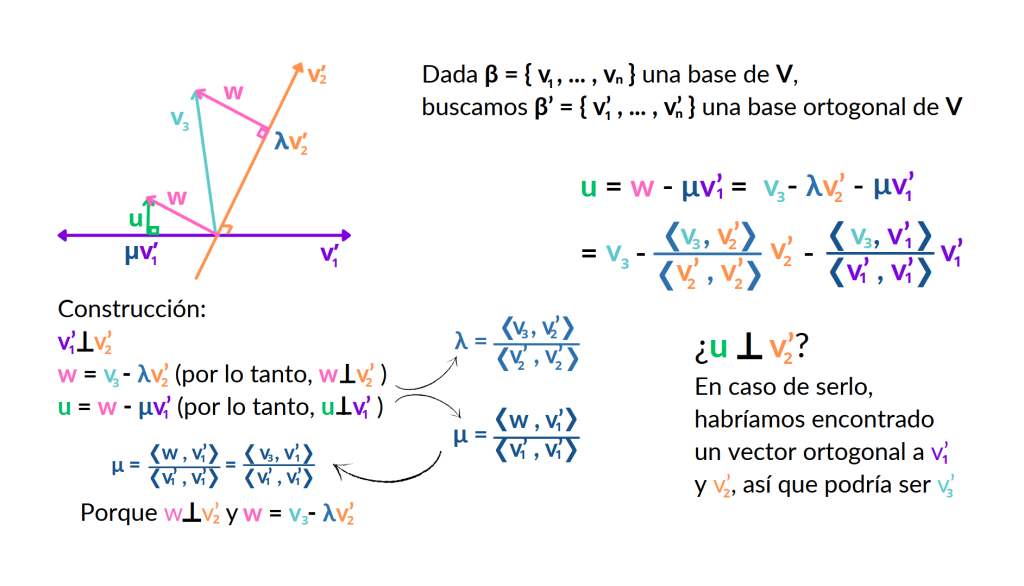

Tomaremos los elementos de esta base para crear una base ortogonal $B’= \{ {v}’_1, … , {v}’_n \}$ definiendo los vectores $v_i’$ del siguiente modo:

${v}’_1 = v_1$

${v}’_2 = v_2 – \lambda_{21} {v}’_1$ con $\lambda_{21} = \frac{ \langle v_2 , {v}’_1 \rangle }{ \langle {v}’_1 , {v}’_1 \rangle }$

y en general para $i \in \{ 2,…,n \}$, teniendo ya definidos los vectores ${v}’_1, … , {v}’_{i-1} $, definimos:

${v}’_i = v_i – \lambda_{i i-1} {v}’_{i-1} – … – \lambda_{i1}{v}’_1$ con $\lambda_{ij} = \frac{ \langle v_i , {v}’_j \rangle }{ \langle {v}’_j , {v}’_j \rangle }$ para toda $j\in\{1, … , i-1\}$.

Veamos por inducción que: $\{ {v}’_1 , … , {v}’_i \}$ es ortogonal, $\theta_V \notin \{ {v}’_1 , … , {v}’_i \}$ y $\langle {v}’_1 , … , {v}’_i \rangle = \langle v_1 , … , v_i \rangle$.

Caso $i=1$

Dado que ${v}’_1 = v_1$ por definición, entonces $\{ {v}’_1 \} = \{ v_1 \}$, que es ortogonal. Además, como $v_1 \in B$ y $B$ es una base, entonces ${v}’_1 = v_1 \not= \theta_V$.

Además, $\langle {v}’_1 \rangle = \langle v_1 \rangle$.

Hipótesis de inducción

Supongamos que $\{ {v}’_1 , … , {v}’_{i-1} \}$ es ortogonal, $\theta_V \notin \{ {v}’_1 , … , {v}’_{i-1} \}$ y $\langle {v}’_1 , … , {v}’_{i-1} \rangle = \langle v_1 , … , v_{i-1} \rangle$.

Demostremos que: $\{ {v}’_1 , … , {v}’_{i} \}$ es ortogonal, $\theta_V \notin \{ {v}’_1 , … , {v}’_{i} \}$ y $\langle {v}’_1 , … , {v}’_{i} \rangle = \langle v_1 , … , v_{i} \rangle$.

Probemos primero que $\{ {v}’_1 , … , {v}’_{i} \}$ es un conjunto ortogonal. Por la hipótesis de inducción sabemos que $\{ {v}’_1 , … , {v}’_{i-1} \}$ es ortogonal, así que basta probar ahora que ${v}’_i$ es ortogonal a cada ${v}’_1 , … , {v}’_{i-1}$. Sea $k \in \{ 1 , … , i-1 \}$.

$\langle {v}’_i , {v}’_k \rangle = \langle v_i \; -\; \displaystyle \sum_{j=1}^{i-1} \lambda_{ij} {v}’_j , {v}’_k \rangle$ $= \langle v_i , {v}’_k \rangle \; -\; \displaystyle \sum_{j=1}^{i-1} \lambda_{ij} \langle {v}’_j , {v}’_k \rangle$

Ahora bien, como para toda $j\in \{1,\dots , i-1\}$ con $ j \not= k$ sabemos que ${v}’_j \perp {v}’_k$, es decir, $\langle {v}’_j , {v}’_k \rangle = 0$, entonces:

$\langle v_i , {v}’_k \rangle \; -\; \displaystyle \sum_{j=1}^{i-1} \lambda_{ij} \langle {v}’_j , {v}’_k \rangle = \langle v_i , {v}’_k \rangle \; -\;\lambda_{ik} \langle {v}’_k , {v}’_k \rangle$ $= \langle v_i , {v}’_k \rangle \;- \; \frac{ \langle v_i , {v}’_k \rangle }{ \langle {v}’_k , {v}’_k \rangle } \langle {v}’_k , {v}’_k \rangle$ $= \langle v_i , {v}’_k \rangle\; -\; \langle v_i , {v}’_k \rangle = 0$.

Por lo tanto, $\{ {v}’_1 , … , {v}’_{i-1} , {v}’_i \}$ es un conjunto ortogonal.

Veamos ahora que $\theta_V \notin \{ {v}’_1 , … , {v}’_{i} \}$. Sabemos por la hipótesis de inducción que $\theta_V \notin \{ {v}’_1 , … , {v}’_{i-1} \}$, así que basta verificar que ${v}’_i \not= \theta_V$, lo que demostremos usando reducción al absurdo.

Supongamos que ${v}’_i = \theta_V$. Entonces $v_i\; -\; \displaystyle \sum_{j=1}^{i-1} \lambda_{ij} {v}’_j = {v}’_i = \theta_V$, de donde $v_i = \displaystyle \sum_{j=1}^{i-1} \lambda_{ij} {v}’_j \in \langle {v}’_1 , … , {v}’_{i-1} \rangle$.

Pero sabemos por la hipótesis de inducción que $\langle {v}’_1 , … , {v}’_{i-1} \rangle = \langle v_1 , … , v_{i-1} \rangle$, entonces $v_i \in \langle v_1 , … , v_{i-1} \rangle$ y eso implica que $\{ v_1 , … , v_{i-1} , v_i \}$ es linealmente dependiente, contradiciendo que $B$ sea una base.

Por lo tanto, ${v}’_i \not= \theta_V$. Así, concluimos que $\theta_V \notin \{ {v}’_1 , … , {v}’_{i-1} , {v}’_i \}$.

Finalmente veamos que $\langle v_1 , … , v_i \rangle = \langle {v}’_1 , … , {v}’_i \rangle$.

Por la hipótesis de inducción tenemos que $\langle {v}’_1 , … , {v}’_{i-1} \rangle = \langle v_1 , … , v_{i-1} \rangle$, en particular $ \langle v_1 , … , v_{i-1} \rangle\subseteq \langle {v}’_1 , … , {v}’_{i-1} \rangle $. Además, $v_i = {v}’_i \; +\; \displaystyle \sum_{j=1}^{i-1} \lambda_{ij} {v}’_j \in \langle {v}’_1 , … , {v}’_i \rangle$, por lo cual, $\langle v_1 , … , v_i \rangle \subseteq \langle {v}’_1 , … , {v}’_i \rangle$.

Dado que $\{ v_1 , … , v_i \}$ es linealmente independiente porque está contenido en la base $B$, entonces $\dim \langle v_1 , … , v_i \rangle = i .$

Además, probamos anteriormente que $\{ {v}’_1 , … , {v}’_i \}$ es otorgonal y que $\theta_V \notin \{ {v}’_1 , … , {v}’_i \}$, entonces por la proposición (4.4.1.) de la entrada 4.4 sabemos que $\{ {v}’_1 , … , {v}’_i \}$ es linealmente independiente y en consecuencia $\dim \langle {v}’_1 , … , {v}’_i \rangle $.

Así, $\langle v_1 , … , v_i \rangle \subseteq \langle {v}’_1 , … , {v}’_i \rangle$, con $\dim \langle v_1 , … , v_i \rangle = i = \dim \langle {v}’_1 , … , {v}’_i \rangle $. Por lo tanto, $\langle v_1 , … , v_i \rangle = \langle {v}’_1 , … , {v}’_i \rangle$.

De lo anterior concluimos que ${B}’ = \langle {v}’_1 , … , {v}’_n \rangle$ es un conjunto ortogonal y $\theta_V \notin {B}’$, por lo que ${B}’$ es linealmente independiente. Además, $\langle {B}’ \rangle = \langle B \rangle = V$.

Por lo tanto, ${B}’$ es una base ortogonal de $V$.

Ejemplo

- Sea $B = \{ v_1 , v_2 , v_3 \} \subseteq \mathbb{R}^3$ con $v_1 = (1,1,1)$, $v_2 = (1,1,0)$ y $v_3 = (1,0,0)$. ${B}’ = \left\{ (1,1,1) , ( \frac{1}{3} , \frac{1}{3} , – \frac{2}{3} ) ( \frac{1}{2} , – \frac{1}{2} , 0 ) \right\}$ es una base ortogonal de $\mathbb{R}^3.$

Justificación. Usando la construcción de la demostración anterior, definimos:

${v}’_1 = v_1 = (1,1,1)$

${v}’_2 = v_2 \; -\; \frac{ \langle v_2 , {v}’_1 \rangle }{ \langle {v}’_1 , {v}’_1 \rangle } {v}’_1$ $= (1,1,0) \; -\;\frac{2}{3} (1,1,1) = \left( \frac{1}{3} , \frac{1}{3} , – \frac{2}{3} \right)$

${v}’_3 = v_3 \; -\; \frac{ \langle v_3 , {v}’_1 \rangle }{ \langle {v}’_1 , {v}’_1 \rangle } {v}’_1 \; -\; \frac{ \langle v_3 , {v}’_2 \rangle }{ \langle {v}’_2 , {v}’_2 \rangle } {v}’_2$ $= (1,0,0) \; -\; \frac{1}{3} (1,1,1) \;-\; \frac{1}{2} \left( \frac{1}{3} , \frac{1}{3} , – \frac{2}{3} \right) = \left( \frac{1}{2} , – \frac{1}{2} , 0 \right)$.

Tarea Moral

- Sean $K=\mathbb{R}$ o $K=\mathbb{C}$ y $V$ un $K$ – espacio vectorial de dimensión finita con producto interno $\langle \;\; , \; \rangle$. Dado un vector $v \in V$ no nulo.

¿Cómo podemos encontrar un vector $w \in V – \{ v \}$ que sea ortogonal a $v$?

Sugerencia: Proponer un vector $u \in V$ tal que podamos aplicar el proceso de Gram Schmidt al conjunto $B= \{ v,u \}$. - Sea $V = \mathcal{M}_{2 \times 2} (\mathbb{R})$ con el producto interno $\langle \;\; , \; \rangle$ tal que $\forall A,B \in V ( \langle A,B \rangle = tr (A^t B) )$.

Considera la base $ \Gamma= \left\{ \begin{pmatrix} 1 & 0 \\ 2 & 1 \end{pmatrix} , \begin{pmatrix} 0 & 1 \\ 1 & 1 \end{pmatrix} , \begin{pmatrix} 1 & 1 \\ 0 & 1 \end{pmatrix} \right\}.$

Obtén una base ortogonal para $V$ usando el proceso Gram Schmidt. - Sea $V = \mathcal{C} [0,1]$ con el producto interno $\langle \;\; , \; \rangle$ tal que $\forall f,g \in V \left( \langle f,g \rangle = \int_{0}^{1} f(x)g(x)dx \right)$.

Considera la base $B = \{ 1 , x , x^2 \}$.

Obtén una base ortogonal de $V$ usando el proceso Gram Schmidt.

Más adelante…

El procedimiento Gram-Schmidt no solo nos permite trabajar con bases ortogonales. Ahora agregaremos una condición extra a estas bases y pediremos que sus vectores sean además unitarios. Llamaremos a dichas bases ortonormales.

Aprenderemos cómo pasar de una base ortogonal a una ortonormal, y entenderemos por qué tener vectores de norma uno facilita enormemente ciertos cálculos. Este paso será clave para lo que viene después: con bases ortonormales, podremos abordar de forma sencilla y ordenada conceptos como las proyecciones, que nos permitirán responder preguntas como “¿qué tan grande es la componente de este vector que está en la dirección de cierto vector de la base?” Así, lo que viene no es solo una mejora técnica, sino un avance que abre nuevas puertas.

Entradas relacionadas

- Ir a Álgebra Lineal I

- Entrada anterior del curso: 4.5. NORMA DE UN VECTOR: propiedades, Cauchy Schwarz, Pitágoras y vector unitario

- Siguiente entrada del curso: 4.7. BASE ORTONORMAL: definición y construcción