5.4 El demonio de Laplace y el fin de la infancia: sensibilidad a las condiciones iniciales, bifurcaciones y caos

A lo largo de este bloque hemos trabajado con modelos matemáticos que podrían haberte dado la impresión de que el futuro de un sistema es completamente predecible. Damos una condición inicial, aplicamos una regla o fórmula (por ejemplo, el modelo logístico o el de Malthus), y obtenemos una secuencia de valores que muestran cómo evoluciona una población a lo largo del tiempo. Este proceso sugiere que, si conocemos suficientemente bien cómo funciona un sistema y con qué valores iniciales comenzamos, podríamos predecir su comportamiento futuro con exactitud. Pero, ¿es realmente así como sucede?

Esta noción no es nueva. A comienzos del siglo XIX, el matemático y filósofo Pierre-Simon Laplace propuso una idea que, en su momento, se volvió tendencia en la comunidad científica: imaginen una inteligencia capaz de conocer absolutamente todas las leyes de la naturaleza y la posición de cada partícula del universo en un momento dado. Esa inteligencia, conocida como el demonio de Laplace, podría predecir el futuro con total certeza, ya que todo el universo seguiría un comportamiento determinista, todo lo que ocurre está determinado por lo que ocurrió antes.

Es importante aclarar que Laplace nunca utilizó la figura del demonio de manera explícita en sus escritos, este concepto fue popularizado por filósofos y científicos posteriores. En su Essai philosophique sur les probabilités (1814), Laplace especuló sobre un universo gobernado por el determinismo absoluto:

“Podemos considerar el estado actual del universo como el efecto de su pasado y la causa de su futuro. Un intelecto que, en cualquier momento dado, conociera todas las fuerzas que animan la naturaleza y las posiciones mutuas de los seres que la componen, si este intelecto fuera lo suficientemente vasto como para someter los datos a análisis, podría condensar en una sola fórmula el movimiento de los cuerpos más grandes del universo y el del átomo más ligero; para tal intelecto nada sería incierto y el futuro, al igual que el pasado, estaría presente ante sus ojos.”

Esta idea, aunada a la mecánica Newtoniana, tuvo una fuerte influencia, muchos científicos creyeron que la naturaleza, al igual que una máquina de relojería, podría ser comprendida de manera determinista. De acuerdo con esta visión, si pudiéramos medir con precisión todas las condiciones iniciales, podríamos predecir el futuro con exactitud. A continuación vamos a considerar la complejidad de los sistemas no lineales, como los que encontramos en la biología y en otros sistemas dinámicos.

El fin de la infancia: cuando el orden se vuelve caótico

A mediados del siglo XX, se comenzó a investigar lo que sucede en sistemas no lineales, como el modelo logístico que ya hemos visto en este curso. Lo que descubrieron es que, para ciertos valores de los parámetros, pequeñas diferencias en las condiciones iniciales pueden llevar a resultados completamente distintos después de varias iteraciones. Este fenómeno se conoce como sensibilidad a las condiciones iniciales. Como explica Robert May (1976), incluso modelos tan simples como el logístico pueden mostrar un comportamiento caótico.

Veamos un ejemplo sencillo. Supongamos que usamos el modelo logístico que ya hemos trabajado:

$x_{n+1} = r x_n (1 – x_n)$

Y elegimos un valor de r = 3.9, con dos condiciones iniciales muy cercanas: $x_0 = 0.500$ y $x_0 = 0.501$. Si calculamos las siguientes generaciones, al principio los resultados de $x_n$ pueden parecer muy similares, pero después de unas cuantas iteraciones, las diferencias entre ambos valores se amplifican hasta que parecen completamente distintas. Esto significa que, aunque el modelo es determinista (es decir, no tiene ninguna parte aleatoria), es tan sensible a los valores iniciales que el resultado final no es predecible con certeza. Este comportamiento se llama caos determinista, y aunque el término caos se suele asociar con desorden, en este contexto se refiere a un tipo de orden muy complejo, pero impredecible a largo plazo.

Y esto, ¿qué tiene que ver con la biología?

Algunos modelos muestran sensibilidad a las condiciones iniciales, incluso aquellos que pueden comportarse de manera determinista para ciertos parámetros, con otros ligeramente diferentes pueden mostrar caos. Esto significa que una ligera variación en factores como la tasa de crecimiento, la disponibilidad de recursos o la proporción de individuos de una especie puede cambiar completamente las predicciones del modelo.

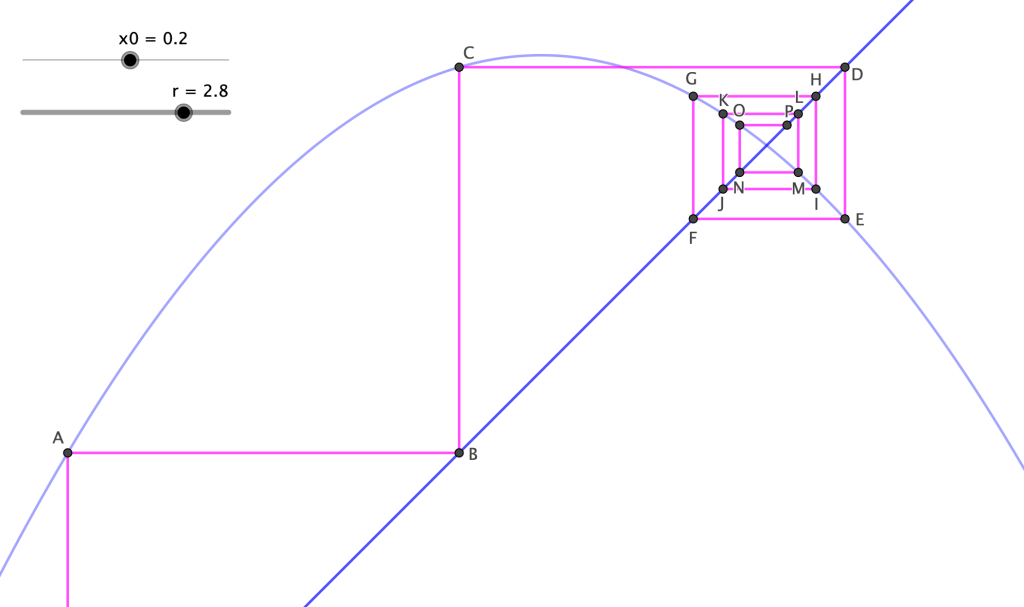

Para mostrar lo que ligeras variaciones en los parámetros de un sistema pueden ocasionar, revisar el ejemplo gráfico del subtema 5.3, en https://www.geogebra.org/m/wpurkns6 puedes encontrar la construcción del ejemplo mencionado.

A pesar de que los modelos matemáticos son herramientas importantes y muy útiles, la predicción exacta en biología es extremadamente difícil. En la mayoría de los casos, no se trata de predecir con certeza lo que sucederá, sino de entender las posibles trayectorias y comportamientos del sistema. Los modelos nos permiten explorar diferentes escenarios y conocer qué podría suceder bajo ciertas condiciones, pero las predicciones precisas, especialmente a largo plazo, son prácticamente imposibles.

Como reflexionó Ian Stewart (Stewart, I., 1989), la aparición del concepto del caos determinista representa el fin de la inocencia del pensamiento científico, es el momento en el que dejamos de creer que todo puede preverse y comenzamos a aceptar que la naturaleza no sigue caminos predecibles, sino que siempre tiene comportamientos inesperados. Es esencial comprender y ser conscientes de las limitaciones al usar modelos matemáticos, así como tener en cuenta que nuestras mediciones son aproximadas, y que los resultados pueden verse influenciados por factores que no hemos considerado en el modelo.

5.5 Otros sistemas dinámicos en tiempo discreto: ley del equilibrio de Hardy-Weinberg. Modelos de selección natural

Hasta ahora hemos estudiado cómo algunos modelos pueden describir la evolución de una población a lo largo del tiempo: cómo crece, cómo se estabiliza o incluso cómo cambia drásticamente dependiendo de sus condiciones iniciales. En este subtema aplicaremos ideas similares al estudio de la genética de poblaciones, es decir, a cómo cambian las frecuencias de alelos y genotipos a través de las generaciones.

En este contexto, nos enfocaremos en un caso particular que funciona como punto de partida en genética poblacional: el modelo de equilibrio de Hardy-Weinberg. Este modelo no describe el cambio, sino la ausencia de cambio, y establece las condiciones bajo las cuales se espera que las frecuencias genéticas se mantengan constantes generación tras generación. Sirve, por tanto, como modelo nulo para evaluar si hay o no fuerzas evolutivas actuando sobre una población.

¿Qué es una hipótesis nula?

Se trata de una suposición base en un análisis científico que plantea que no hay efecto significativo entre las variables que se estudian. En genética, la hipótesis nula suele ser que las frecuencias alélicas y genotípicas no están cambiando en la población.

El equilibrio de Hardy-Weinberg representa justamente esta hipótesis nula. Según este modelo, si no hay selección natural, mutación, migración, deriva genética ni apareamiento no aleatorio, las frecuencias de los alelos y de los genotipos permanecerán estables de una generación a otra. Cualquier desviación entre lo que predice el modelo y lo que se observa en la realidad sugiere que alguna fuerza evolutiva podría estar actuando.

El modelo de Hardy-Weinberg

Este modelo establece que, en una población ideal, las frecuencias esperadas de los alelos y los genotipos permanecen constantes de una generación a otra si se cumple las siguientes condiciones:

$\quad$• Población de tamaño muy grande (sin deriva genética).

$\quad$• Apareamiento aleatorio (sin selección sexual).

$\quad$• Ausencia de selección natural.

$\quad$• Ausencia de mutaciones.

$\quad$• Ausencia de migración (flujo génico).

Bajo estos supuestos, se generan expectativas sobre cómo deberían distribuirse los genotipos. Para una población con dos alelos, $A$ y $a$:

$\quad$Sea $p$ la frecuencia relativa del alelo $A$,

$\quad$sea $q$ la frecuencia relativa del alelo $a$,

$\quad$como sólo hay dos alelos, $p+q=1$, luego $q=1-p$.

Las frecuencias genotípicas en equilibrio se calculan:

$\quad$Frecuencia del genotipo AA: $f_{AA} = p^2$

$\quad$Frecuencia del genotipo Aa: $f_{Aa} = 2pq$

$\quad$Frecuencia del genotipo aa: $f_{aa} = q^2$

Si suponemos que hay una población con datos genotípicos observados. Para saber si está en equilibrio:

$\quad$1. Calculamos p y q a partir de los datos observados, por ejemplo, si se conocen los genotipos $AA$, $Aa$ y $aa$:

$$p = \frac{2 \times (\text{número de individuos AA}) + (\text{número de individuos Aa})}{2 \times (\text{número total de individuos})}$$

2. Calculamos las frecuencias esperadas $p^2$, $2pq$, $q^2$.

3. Comparamos con los valores observados usando una prueba como chi-cuadrada:

$$\chi^2 = \sum \frac{(O_i – E_i)^2}{E_i}$$

donde $O_i$ y $E_i$ son los valores observados y esperados para cada genotipo.

4. La aptitud puede verse como la probabilidad de que ese genotipo contribuya descendencia a la siguiente generación. Para calcular la frecuencia del alelo $A$ en la siguiente generación, usamos esta fórmula:

$$p’ = \frac{p^2 w_{AA} + pq w_{Aa}}{\overline{w}}$$

Donde $\overline{w}$ es la aptitud media de la población: $\overline{w} = p^2 w_{AA} + 2pq w_{Aa} + q^2 w_{aa}$

Guía rápida de prueba chi-cuadrada

1. Obtener el número de individuos para cada genotipo y el tamaño total de la muestra (N).

2. Calcular $p$ y $q$ a partir de los datos observados.

3. Calcular $p^2$, $2pq$, $q^2$ y multiplica cada frecuencia por $N$ para obtener las frecuencias esperadas.

3. Aplicar la fórmula de chi-cuadrada: $\chi^2 = \sum \frac{(O_i – E_i)^2}{E_i}$

4. Determinar los grados de libertad (gl):

gl = número de clases – número de parámetros estimados – 1

(p. e. supongamos que hay 3 genotipos (AA, Aa, aa), luego, hay 3 clases; y hay 1 parámetro estimado que es la frecuencia alélica $p$. Entonces: gl = 3 – 1 – 1 = 1)

5. Comparar con $\chi^2$ crítico, que es un número usado como umbral para decidir si la diferencia observada es significativa o no.

Una vez calculado $\chi^2$, se compara con el valor crítico correspondiente al número de grados de libertad.

| gl | 1 | 2 | 3 |

| Valor crítico (α = 0.05) | 3.841 | 5.991 | 7.815 |

$\quad$• Si $\chi^2 > \chi^2_{\text{crítico}}$: se rechaza la hipótesis nula → hay evidencia de que no hay equilibrio.

$\quad$• Si $\chi^2 < \chi^2_{\text{crítico}}$: no se rechaza la hipótesis nula → la población podría estar en equilibrio.

¿Y si hay selección natural?

Cuando hay selección natural se incorporan valores de aptitud relativa o fitness. Se supone que:

$\quad$• $AA$ tiene aptitud $w_{AA}$

$\quad$• $Aa$ tiene aptitud $w_{Aa}$

$\quad$• $aa$ tiene aptitud $w_{aa}$

Hay dos formas comunes de obtener estos valores:

1. Si hay datos de supervivencia, fertilidad o tasas de reproducción, entonces

$$w_{\text{genotipo}} = \frac{\text{número promedio de crías viables o descendencia de ese genotipo}}{\text{número promedio de crías viables del genotipo más exitoso}}$$

Es decir, se normalizan los valores comparándolos con el genotipo más exitoso (que tendrá $w = 1$).

2. Si se conocen las frecuencias genotípicas antes y después de la selección, se puede estimar las aptitudes comparando qué tan bien se mantiene cada genotipo. Este método requiere más información empírica, y es útil en estudios de campo o laboratorio.

Ahora, las frecuencias genotípicas después de la selección se calculan con:

$$\begin{align*}\text{Frecuencia(AA)}’ = \frac{p^2 w_{AA}}{\overline{w}} \\

\text{Frecuencia(Aa)}’ = \frac{2pq w_{Aa}}{\overline{w}}\\

\text{Frecuencia(aa)}’ = \frac{q^2 w_{aa}}{\overline{w}} \end{align*}$$

¿Qué implica cuando se cumplen (o no) las frecuencias esperadas?

Cuando las frecuencias observadas en una población coinciden con las frecuencias esperadas según el modelo de Hardy-Weinberg, significa que no hay evidencia que indique que las frecuencias estén cambiando por acción de una fuerza evolutiva.

Por otro lado, cuando las frecuencias observadas no coinciden con las esperadas, esto sugiere que alguna o varias de las fuerzas evolutivas están influyendo en la población, como:

$\quad$• Selección natural: si ciertos genotipos tienen una mayor aptitud.

$\quad$• Migración: si hay flujo génico entre poblaciones.

$\quad$• Deriva genética: en poblaciones pequeñas, los alelos pueden cambiar debido a fluctuaciones aleatorias.

$\quad$• Mutaciones: si se producen nuevos alelos en la población.

En este caso, se puede usar la diferencia entre las frecuencias observadas y las esperadas para inferir qué fuerzas podrían estar sucediendo.

Es importante recordar que cumplir con las frecuencias esperadas según el modelo de Hardy-Weinberg no implica que se haya confirmado que una población sigue este modelo ideal. Existen múltiples factores que pueden influir en la genética de una población, y algunas de estas influencias pueden no ser obvias o medibles en un análisis.

El cumplimiento con las frecuencias esperadas simplemente indica que no hay evidencia en contra del equilibrio de Hardy-Weinberg en ese momento, pero no podemos concluir que no haya otras dinámicas o factores ocultos interviniendo en la población. Algunas razones por las que el modelo podría no confirmarse aunque las frecuencias sí coincidan son:

$\quad$• Tamaño muestral insuficiente: si la muestra analizada es pequeña, puede no reflejar con precisión las verdaderas frecuencias alélicas de la población.

$\quad$• Temporalidad: las poblaciones pueden estar en desequilibrio durante ciertas generaciones antes de alcanzar el equilibrio.

$\quad$• Factores no medidos: pueden existir factores que no se están midiendo, como la migración o la selección sexual.

Estas sutilezas metodológicas son esenciales en ciencia: no basta con observar coincidencias, también hay que preguntarse qué significa esa coincidencia y qué limitaciones tiene nuestra medición o interpretación.

Ejemplo

En algunas regiones de África, la malaria es una enfermedad común y peligrosa. Sin embargo, existe un alelo llamado HbS, que en estado heterocigoto (AS) proporciona resistencia parcial a esta enfermedad. Cuando una persona hereda dos copias del alelo (SS), sufre anemia falciforme, una enfermedad severa. Este caso es un ejemplo clásico donde la heterocigosis ofrece una ventaja adaptativa.

Paso 1. Datos iniciales

En una población de Nigeria con alta incidencia de malaria, se observa:

$\quad$• Frecuencia inicial del alelo A (normal): $p = 0.7 \quad \Rightarrow \quad q = 1 – p = 0.3$

$\quad$• Aptitudes relativas:

$\qquad$○ $w_{AA} = 0.9$ (más susceptibles a la malaria)

$\qquad$○ $w_{AS} = 1.0$ (mayor resistencia)

$\qquad$○ $w_{SS} = 0.2$ (anemia falciforme grave)

Paso 2. Calcular frecuencias genotípicas

Usando las fórmulas de Hardy-Weinberg:

$f_{AA} = p^2 = \underline{\quad(0.7)^2\quad} = \underline{\quad0.49\quad}$

$f_{AS} = 2pq = \underline{\quad2(0.7)(0.3)\quad} = \underline{\quad0.42\quad}$

$f_{SS} = q^2 = \underline{\quad(0.3)^2\quad} = \underline{0.09\quad}$

Paso 3. Calcular la media de aptitud $\bar{w}$

$\bar{w} = f_{AA} \cdot w_{AA} + f_{AS} \cdot w_{AS} + f_{SS} \cdot w_{SS}$

$\bar{w} = \underline{\quad(0.49)(0.9) + (0.42)(1.0) + (0.09)(0.2) = 0.441 + 0.42 + 0.018 = 0.879\quad}$

Paso 4. Calcular la nueva frecuencia del alelo A ($p’$)

$$p’ = \frac{p^2 w_{AA} + p q w_{AS}}{\bar{w}}$$

$$p’ = \underline{\quad \frac{(0.49)(0.9) + (0.21)(1.0)}{0.879} = \frac{0.441 + 0.21}{0.879} = \frac{0.651}{0.879} \approx 0.741\quad}$$

Entonces:

$q’ = 1 – p’ \approx \underline{1 – 0.741 = 0.259\quad}$

Paso 5. Interpretación

a. ¿Aumentó o disminuyó la frecuencia del alelo A?

Respuesta: La frecuencia del alelo A aumentó de 0.7 a 0.741 en una generación.

b. ¿Qué se puede concluir sobre la persistencia del alelo HbS (alelo S) en la población?

Respuesta: El heterocigoto AS tiene mayor aptitud que ambos homocigotos, pero el alelo A (hemoglobina normal) sigue siendo más frecuente que HbS. Debido a la ventaja heterocigótica, el alelo HbS no desaparece. El sistema tiende hacia un equilibrio estable en el que se mantiene la diversidad genética –ambos alelos coexisten–.

Ejemplo

El Quercus mulleri es una especie de encino endémica de zonas montañosas de Oaxaca. Se encuentra en ambientes de alta diversidad biológica, pero está bajo presión por cambio de uso de suelo. Se desea saber si la población local está en equilibrio genético o si alguna fuerza evolutiva (como fragmentación del hábitat) podría estar afectando la distribución de los genotipos.

Se recolectaron muestras de 100 individuos. Los genotipos observados fueron:

| Genotipo | Frecuencia Observada (O) |

| AA | 30 |

| Aa | 45 |

| aa | 25 |

Paso 1. Calcula $p$ y $q$

$$p = \underline{\quad\frac{2 \cdot 30 + 45}{2 \cdot 100} = \frac{105}{200} = 0.525 \quad\Rightarrow\quad q = 1 – 0.525 = 0.475 \quad}$$

Paso 2. Calcula las frecuencias esperadas (E)

$f_{AA} = \underline{\quad(0.525)^2 = 0.2756 \\ f_{Aa} = 2(0.525)(0.475) = 0.4988 \\ f_{aa} = (0.475)^2 = 0.2256\quad}$

$E_{AA} = \underline{\quad27.56\quad},\quad E_{Aa} = \underline{\quad49.88\quad},\quad E_{aa} = \underline{\quad22.56\quad}$

Paso 3. Realiza una tabla comparativa con los datos observados

| Genotipo | Observado (O) | Esperado (E) |

| AA | 30 | 27.56 |

| Aa | 45 | 49.88 |

| aa | 25 | 22.56 |

Paso 4. Aplica la prueba de chi-cuadrada

$$\chi^2 = \underline{\quad\frac{(30 – 27.56)^2}{27.56} + \frac{(45 – 49.88)^2}{49.88} + \frac{(25 – 22.56)^2}{22.56}\quad}$$

$$\chi^2 \approx \underline{\quad\frac{5.95}{27.56} + \frac{23.81}{49.88} + \frac{5.95}{22.56} = 0.22 + 0.48 + 0.26 = 0.96\quad}$$

Paso 5. Determina rados de libertad (gl)

Hay 3 genotipos (AA, Aa, aa), luego, hay 3 clases. Hay 1 parámetro estimado (frecuencia alélica $p$). Entonces: gl = 3 – 1 – 1 = 1.

Paso 6. Comparar con $\chi^2$ crítico

Con gl = 1, el valor crítico de $\chi^2$ a $0.05 \approx 3.84$.

Como 0.96 < 3.84, no se rechaza la hipótesis nula.

Paso 7. Interpretación

• ¿Qué significa que los valores observados y esperados sean tan cercanos?

Respuesta: Que la población probablemente está en equilibrio genético para los genotipos observados.

• ¿Podemos concluir que no hay evolución en esta población?

Respuesta: No necesariamente. Podrían existir otras fuerzas actuando en otros genes o momentos.

Ejercicio

En un campo de maíz, se está estudiando una población con variabilidad en el color del grano, que depende de un alelo B (para color amarillo) y su alelo recesivo b (para color blanco).

a. Registra los datos iniciales

Sea una muestra de 100 plantas de maíz, los genotipos observados son:

$\quad$• BB (color amarillo): 30 individuos

$\quad$• Bb (color amarillo, heterocigotos): 50 individuos

$\quad$• bb (color blanco): 20 individuos

b. Calcular las frecuencias alélicas

c. Calcular las frecuencias genotípicas esperadas

d. Realiza la prueba de chi-cuadrada

e. Determina el grado de libertad (gl)

f. Compara con el valor crítico de chi-cuadrada

g. Responde: ¿Está la población en equilibrio genético?

Respuestas esperadas

a.

$\quad$• BB (color amarillo): 30 individuos

$\quad$• Bb (color amarillo, heterocigotos): 50 individuos

$\quad$• bb (color blanco): 20 individuos

b.

$\quad$$f_{BB} = \frac{30}{100} = 0.3$

$\quad$$f_{Bb} = \frac{50}{100} = 0.5$

$\quad$$f_{bb} = \frac{20}{100} = 0.2$

Las frecuencias alélicas son:

$\quad$$p = \frac{2(30) + 50}{2(100)} = \frac{110}{200} = 0.55$

$\quad$$q = 1 – p = 1 – 0.55 = 0.45$

c. Con $p = 0.55$ y $q = 0.45$:

$\quad$$f_{BB} = p^2 = (0.55)^2 = 0.3025$

$\quad$$f_{Bb} = 2pq = 2(0.55)(0.45) = 0.495$

$\quad$$f_{bb} = q^2 = (0.45)^2 = 0.2025$

Multiplicando por el tamaño de la población:

$\quad E_{BB} = 0.3025 (100) = 30.25$

$\quad E_{Bb} = 0.495 (100) = 49.5$

$\quad E_{bb} = 0.2025 (100) = 20.25$

d.

$\begin{align*}\chi^2 &= \frac{(30 – 30.25)^2}{30.25} + \frac{(50 – 49.5)^2}{49.5} + \frac{(20 – 20.25)^2}{20.25} \\ \chi^2 &= \frac{(0.25)^2}{30.25} + \frac{(0.5)^2}{49.5} + \frac{(0.25)^2}{20.25} \\ \chi^2 &= \frac{0.0625}{30.25} + \frac{0.25}{49.5} + \frac{0.0625}{20.25} \\ \chi^2 &= 0.002 + 0.005 + 0.003 \approx 0.01 \end{align*}$

e. El número de genotipos es 3 (BB, Bb, bb) y estimamos 1 parámetro (frecuencia de alelo B), por lo que: gl = 3 – 1 – 1 = 1.

f. Con 1 grado de libertad y un nivel de significancia de $\alpha = 0.05$, el valor crítico de chi-cuadrada es $\chi^2_{crítico} \approx 3.84$.

Como $\chi^2 = 0.01 < 5.99$, no rechazamos la hipótesis nula.

g. Es probable que la población esté en equilibrio genético para los genotipos observados, sin embargo podrían existir otras fuerzas actuando en otros genes o momentos.

Referencias bibliográficas

Allman, E. S. & J. A. Rhodes. 2007. Mathematical models in biology: an introduction. Cambridge University Press, Cambridge.

Britton, N. F. 2003. Essential mathematical biology. Springer, Cham.

Torres Olin, Guillermo R. 2019. Estudio de la entropía y turbulencia como criterios de complejidad en sistemas dinámicos discretos (Tesis de licenciatura). UNAM, Facultad de Ciencias, Ciudad Universitaria, CDMX, México.

May, R. M. 1976. Simple mathematical models with very complicated dynamics. Nature, 261: 459-467

Stewart, I. (1989). Does God Play Dice? The New Mathematics of Chaos. Penguin.