(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

INTRODUCCIÓN

Cuando pensamos en vectores perpendiculares o en formar ángulos rectos, solemos imaginar figuras en el plano o en el espacio. Sin embargo, las matemáticas nos permiten llevar esa misma idea mucho más lejos: con la herramienta del producto interno, podemos hablar de ortogonalidad entre vectores en cualquier espacio vectorial, incluso en dimensiones altas o en contextos muy abstractos.

A continuación veremos una generalización del producto punto que nos permitirá más adelante definir el concepto de producto interno, ortogonalidad para cualquier espacio vectorial así como la norma de un vector. Estos conceptos no solo generalizan ideas geométricas conocidas, sino que abren la puerta a técnicas que simplifican cálculos, permiten aproximaciones óptimas y profundizan nuestro entendimiento de los espacios vectoriales.

PRODUCTO ESCALAR

Definición: Sea $V$ un $K$ – espacio vectorial. Un producto escalar en $V$ es una función $\langle \;\; ,\; \rangle : V \times V \longrightarrow K$ tal que:

1) $\forall u,v \in V ( \langle u , v \rangle = \langle v , u \rangle )$

2) $\forall u,v,w \in V ( \langle u+v , w \rangle = \langle u , w \rangle+ \langle v , w \rangle )$

3) $\forall \lambda \in K , \forall u,v \in V ( \langle \lambda u , v \rangle = \lambda \langle u , v \rangle )$

Observaciones: 1) $\forall u,v,w \in V ( \langle w , u + v \rangle = \langle w , u \rangle + \langle w , v \rangle ).$

2) $\forall \lambda \in K , \forall u,v \in V ( \langle u , \lambda v \rangle = \lambda \langle u , v \rangle ).$

3) $\forall v \in V$ $\langle \theta_V , v \rangle=0_K$. Esto se debe a que $\langle \theta_V , v \rangle$ $= \langle 0_K \cdot \theta_V , v \rangle= 0_K$.

Ejemplos

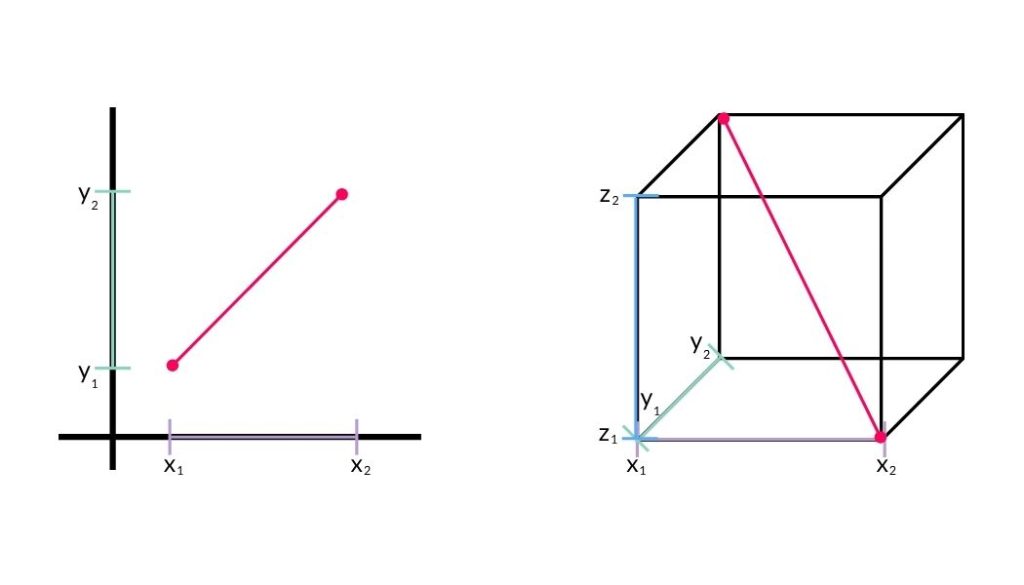

- Sean $K = \mathbb{R}$ y $V = \mathbb{R}^n$.

Si para cualesquiera $u = ( x_1 … , x_n ) , v = ( y_1 , … , y_n ) \in \mathbb{R}^n$ definimos $\langle u , v \rangle = u \cdot v$ $= x_1 y_1 + … + x_n y_n$ tenemos un producto escalar en $\mathbb{R}^n.$

- Sean $K = \mathbb{R}$ y $V = C ( [0,1] ) = \{ f : [0,1] \longrightarrow \mathbb{R} | f$ es continua$\}$.

Si para cualesquiera $f,g \in C ( [0,1] )$ definimos $\langle f,g \rangle = \int_{0}^{1} f(t) g(t) \,dt$ tenemos un producto escalar en $C ( [0,1] ).$ Esto se debe a las propiedades de la integral.

VECTOR Y SUBCONJUNTO ORTOGONAL

Definición: Sea $V$ un $K$ – espacio vectorial y $\langle\;\; ,\; \rangle$ un producto escalar en $V$. Dados $u,v \in V$ decimos que $u$ es ortogonal a $v$ si $\langle u,v \rangle = 0$ y lo denotamos por $u \perp v$.

Dado $S$ un subconjunto de $V$, el ortogonal a $S$ es $S^{\perp} = \{ w \in V | \langle w,v \rangle = 0$ $\forall v \in S \}$.

Ejemplos

- Sean $K = \mathbb{R}$, $V = \mathbb{R}^3$ y $\langle\;\; ,\; \rangle$ el producto punto usual.

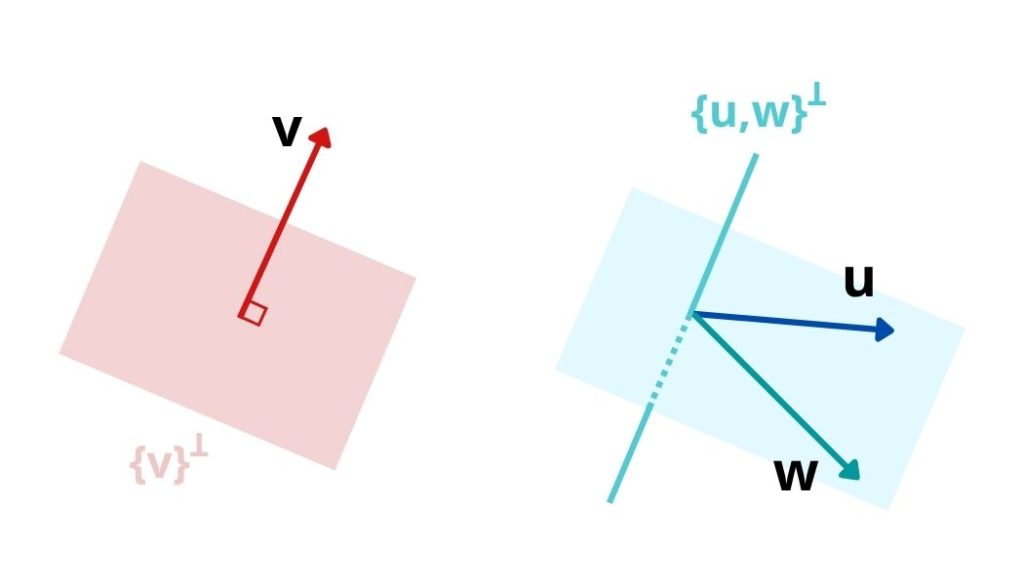

Si $v \in \mathbb{R}^3 \setminus \{ \theta \}$, entonces $\{ v \}^{\perp}$ es el plano con vector normal $v$.

Si $u,w \in \mathbb{R}^3\setminus \{ \theta \}$ no son colineales, entonces $\{ u,w \}^{\perp}$ es la recta que pasa por el origen ortogonal al plano determinado por $u$ y $w$.

$\{ (0,0,0) \}^{\perp} = \mathbb{R}^3.$

${\mathbb{R}^3}^{\perp} = \{ (0,0,0) \}.$

Proposición (4.1.1.): Sean $V$ un $K$ – espacio vectorial, $\langle\;\; ,\; \rangle$ producto escalar en $V$ y $S$ un subconjunto de $V$. Se cumple que:

a) $S^{\perp}$ es un subespacio de $V.$

b) $S^{\perp} = \langle S \rangle^{\perp}.$

Demostración: Sean $V$ un $K$ – espacio vectorial, $\langle\;\; ,\; \rangle$ producto escalar en $V$ y $S$ un subconjunto de $V$.

a) Veamos que $\theta_V \in S^{\perp}$ y que $S^{\perp}$ es cerrado bajo suma y bajo producto por escalar.

Por la observación 3) sabemos que para todo $v \in V$ $\langle \theta_V , v \rangle=0_K.$ Como se cumple para toda $v \in V$, en particular también se cumple que para toda $s \in S$ $\langle \theta_V , s \rangle = 0_K.$

Por lo tanto, $\theta_V \in S^{\perp}.$

Sean $\lambda \in K$, $u,v \in S^{\perp}$ y $s \in S.$ Por las propiedades del producto escalar

$\langle \lambda u + v , s \rangle$ $= \langle \lambda u , s \rangle + \langle v , s \rangle$ $= \lambda \langle u , s \rangle + \langle v , s \rangle$, y dado que $u,v \in S^{\perp}$ y $s \in S$ sabemos que $ \langle u , s \rangle = \langle v , s \rangle =0_K$. Entonces

$\langle \lambda u + v , s \rangle$ $= \lambda 0_K + 0_K$ $= 0_K + 0_K$ $= 0_K.$

Así, para toda $\lambda \in K$, $u,v \in S^{\perp}$ y $s \in S$ se cumple que $\langle \lambda u + v , s \rangle = 0_K.$

Por lo tanto, $\lambda u + v \in S^{\perp}.$

$\therefore S^{\perp} \leqslant V.$

b) Veamos la doble contención entre los conjuntos $S^{\perp}$ y $\langle S \rangle^{\perp}$

i) Sea $v \in S^{\perp}$

Veamos que $v$ es ortogonal a todo vector en $\langle S \rangle$. Consideremos $u \in \langle S \rangle$, entonces $u = \lambda_1 s_1 + … + \lambda_n s_n$ con $n \in \mathbb{N}^+$, $s_1, … , s_n \in S$, $\lambda_1, … , \lambda_n \in K.$

Tenemos que $\langle v,u \rangle$ $= \langle v , \lambda_1 s_1 + … + \lambda_n s_n \rangle$ $= \lambda_1 \langle v , s_1 \rangle + … + \lambda_n \langle v , s_n \rangle$. Dado que $v \in S^{\perp}$ y $s_1, … , s_n \in S$, sabemos que $\langle v , s_i \rangle=0_K$ para toda $i\in\{1,2,\dots , n\}$. Entonces

$\langle v,u \rangle$ $= \lambda_1 0_K + … + \lambda_n 0_K$ $= 0_K$.

Así, $\langle v,u \rangle = 0_K$.

Por lo tanto, $v \in \langle S \rangle^{\perp}$.

ii) Sea $v \in \langle S \rangle^{\perp}.$

Veamos que $v$ es ortogonal a todo vector en $S.$ Consideremos $s \in S$. Como $s \in S$ y $S\subseteq \langle S \rangle$, entonces $s \in \langle S \rangle$. Además, dado que $v \in \langle S \rangle^{\perp}$ sabemos que $\langle v,u \rangle$ para todo $u \in \langle S \rangle$. En particular, como $s \in \langle S \rangle$, se tiene que $\langle v,s \rangle = 0_K.$

Por tanto, $v \in S^{\perp}.$

$\therefore S^{\perp} = \langle S \rangle^{\perp}$.

Nomenclatura: A $S^{\perp}$ se llama el subespacio ortogonal a $S$.

Ejemplos

- Sea $A = (a_{ij}) \in \mathcal{M}_{m \times n} (K)$ cuyos renglones son $A_1 , … , A_m\in K^m$.

Sea $X \in K^n$.

$X$ es una solución del sistema homogéneo dado por $A$ $\iff X \in \{ A_1 , … , A_m \}^{\perp} = \langle A_1 , … , A_m \rangle^{\perp}$

Justificación. $X$ es una solución del sistema homogéneo dado por $A$ $\iff AX = 0$

$\iff \begin{equation*}

\begin{cases}

a_{11} x_1 + … + a_{1n} x_n =0\\

\phantom{ddd}\vdots\\

a_{m1} x_1 + … + a_{mn} x_n=0

\end{cases}

\end{equation*}$

$\iff \begin{equation*}

\begin{cases}

A_1 \cdot X =0\\

\phantom{ddd}\vdots\\

A_m \cdot X=0

\end{cases}

\end{equation*}$

$\iff X \in \{ A_1 , … , A_m \}^{\perp} = \langle A_1 , … , A_m \rangle^{\perp}$

Por ejemplo, si $A = \begin{pmatrix} 1 & 2 & -4 \\ \pi & 0 & -\frac{1}{3} \end{pmatrix} \in \mathcal{M}_{2 \times 3}(\mathbb{R})$, el conjunto de soluciones del sistema $AX = 0$ o bien de $\begin{equation*}

\begin{cases}

x_1 + 2x_2 -4x_3 =0\\

\pi x_1 +3x_2 -\frac{1}{3}x_3=0

\end{cases}

\end{equation*}$ es $\langle (1,2,-4) , (\pi , 0 , -\frac{1}{3}) \rangle^{\perp},$ es decir la recta por el origen ortogonal al plano determinado por $(1,2,-4)$ y $(\pi , 0 , -\frac{1}{3}).$

Tarea Moral

- Considera el espacio vectorial real $V = \mathbb{R}^2$ con el producto escalar dado por el producto punto usual, es decir, para todos $u,v\in V$ $\langle u , v \rangle = u \cdot v.$

Sean $A = \{(1,0)\}$ y $B = \{(1,1)\}.$

¿Se cumple que $(A \cup B)^{\perp } \subseteq A^{\perp} \cup B^{\perp}$?

¿Se cumple que $A^{\perp} \cup B^{\perp} \subseteq (A \cup B)^{\perp }$? - Considera el espacio vectorial real $V = \mathcal{C}[0,1]$ con el producto escalar definido como $\langle f,g \rangle = \int_{0}^{1} f(t) g(t) \,dt$ para cualesquiera $f,g \in C ( [0,1] )$.

Sean $f,g \in V$ definidas como: para toda $x \in [0,1]$ $f(x) = 1$ y $g(x) = 2.$

Sean $A = \{f\}$ y $B = \{g\}.$

¿Se cumple que $(A \cup B)^{\perp } \subseteq A^{\perp} \cup B^{\perp}$?

¿Se cumple que $A^{\perp} \cup B^{\perp} \subseteq (A \cup B)^{\perp }$? - Sea $V$ un $K$ – espacio vectorial. Sean $A, B \subseteq V$ y $\langle\;\; ,\; \rangle$ un producto escalar en $V.$

¿Se cumple en general que $(A \cup B)^{\perp } \subseteq A^{\perp} \cup B^{\perp}$?

¿Se cumple en general que $A^{\perp} \cup B^{\perp} \subseteq (A \cup B)^{\perp }$?

Más adelante…

Más allá de la definición, podemos pedir propiedades extras al producto escalar (de acuerdo a diferentes necesidades) y dependiendo de esas propiedades solicitadas, recibe un nombre especial, por ejemplo: «no degenerado», «degenerado» y «definido positivo.»

Entradas relacionadas

- Ir a Álgebra Lineal I

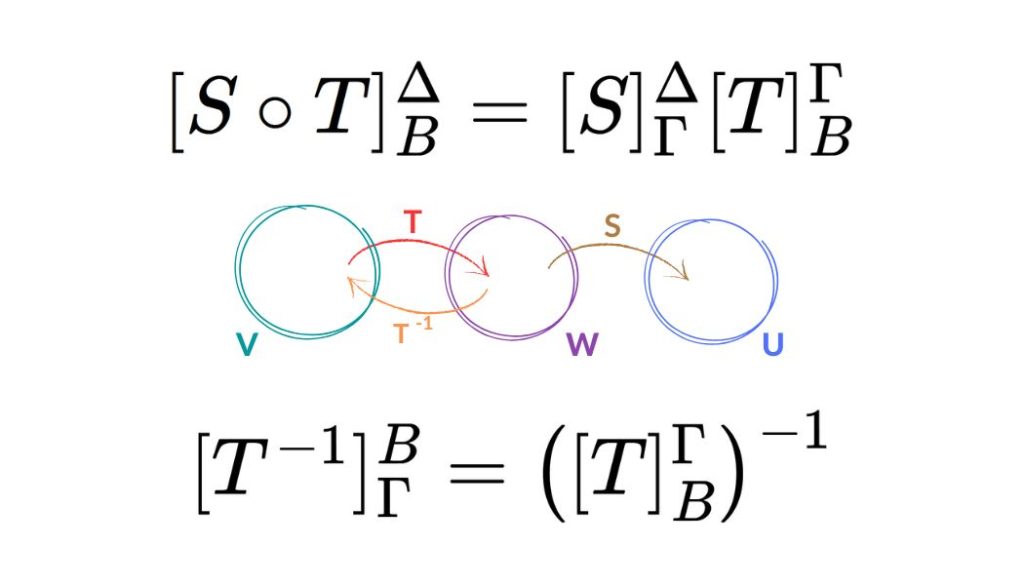

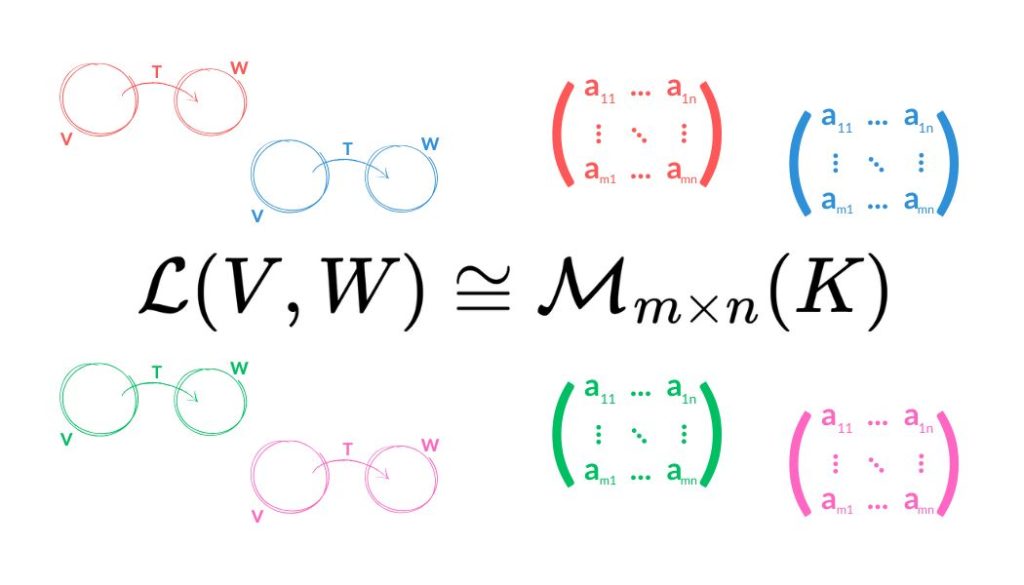

- Entrada anterior del curso: 3.8. MATRICES CONJUGADAS: matrices de cambio de base

- Siguiente entrada del curso: 4.2. PRODUCTO ESCALAR NO DEGENERADO, DEGENERADO Y DEFINIDO POSITIVO: definiciones y ejemplos