(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

INTRODUCCIÓN

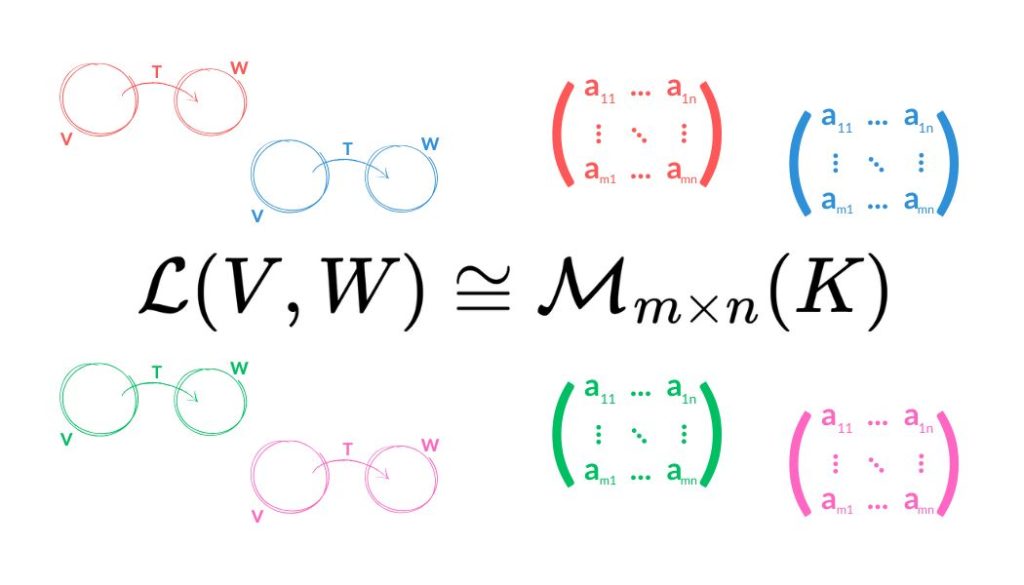

Dados dos espacios vectoriales $V$ y $W$ de dimensiones finitas $n$ y $m$ respectivamente veremos una correspondencia uno a uno entre el espacio vectorial de las transformaciones lineales entre esos espacios y el de las matrices de tamaño $m \times n$, mostrando que son isomorfos: comparten la misma estructura algebraica, aunque uno se describe en términos de funciones y el otro en términos de arreglos numéricos. Así, estudiar matrices no es solo una cuestión de cálculo, sino una forma concreta de explorar y comprender el comportamiento de las transformaciones entre espacios vectoriales.

Pero, dada una matriz, ¿cómo podríamos construir la transformación asociada?

Proposición (3.5.1.): Sean $V, W$ $K$ – espacios vectoriales de dimensión finita $n$ y $m$ respectivamente. Sean $B$ y $\Gamma$ bases ordenadas de $V$ y $W$ respectivamente. Para toda $A \in \mathcal{M}_{m \times n} (K)$ se cumple que: Existe $T \in \mathcal{L}(V,W)$ tal que $[ T]_{B}^{\Gamma} = A.$

Demostración: Sean $V, W$ $K$ – espacios vectoriales de dimensión finita $n$ y $m$ respectivamente. Sean $B = (v_1 , … , v_n)$ y $\Gamma= (w_1 , … , w_m)$ bases ordenadas de $V$ y $W$ respectivamente.

Sea $A = (a_{ij}) \in \mathcal{M}_{m \times n} (K).$

Usando el teorema 2.4.1 de la entrada 2.4 definamos $T : V \longrightarrow W$ como la transformación lineal tal que $T (v_j) = a_{1j} w_1 + … + a_{mj} w_m$ para toda $j \in \{ 1,…,n \}.$

Entonces $col_j[ T ]_{B}^{\Gamma} = [T(v_j) ]_{\Gamma}$ $= \begin{pmatrix} a_{1j} \\ \vdots \\ a_{mj} \end{pmatrix} = col_j A$ para toda $j \in \{ 1,…,n \}.$

Al coincidir las matrices $[ T ]_{B}^{\Gamma}$ y $A$ columna a columna, obtenemos que $[ T ]_{B}^{\Gamma} = A$.

Ejemplo

- Sean $K = \mathbb{R}$, $V = \mathbb{R}^3$ y $W = \mathbb{R}^2$.

Sea $B = ( (1,2,0) , (0,-1,0) , (1,0,1) )$ una base ordenada de $\mathbb{R}^3$.

Sea $\Gamma = ( (1,3) , (-1,1) )$ una base ordenada de $\mathbb{R}^2$

Si $A = \begin{pmatrix} 1 & 2 & -1 \\ 5 & 3 & 7 \end{pmatrix}_{2 \times 3}$ y $\forall (x,y,z) \in \mathbb{R}^3 ( T =(16x – 5y – 10z , 4x – 3y – 14z) )$, entonces $[ T ]_{B}^{\Gamma} = A$

Justificación. Veamos la construcción de $T$:

Para que $T \in \mathcal{L}( \mathbb{R}^3 , \mathbb{R}^2 )$ cumpla que $[ T ]_{B}^{\Gamma} = A$, necesitamos que:

$T(1,2,0) = 1 (1,3) + 5 (1,-1) = (6,-2)$

$T(0,-1,0) = 2(1,3) + 3(1,-1) = (5,3)$

$T(1,0,1) = -1(1,3) + 7(1,-1) = (6,-10)$

Y como $(x,y,z) = (x-z)(1,2,0) + (2x-2z-y)(0,-1,0) +z(1,0,1)$:

$T(x,y,z) = (x-z)T(1,2,0) + (2x-2z-y)T(0,-1,0) +zT(1,0,1)$ $= (x-z)(6,-2) + (2x-2z-y)(5,3) + z(6,-10)$ $= ( 6(x-z) + 5(2x-2z-y) + 6z , -2(x-z) + 3(2x-2z-y) -10z )$ $=( 6x – 6z + 10x – 10z – 5y + 6z , -2x + 2z + 6x – 6z – 3y – 10z )$ $= ( 16x – 5y – 10z , 4x – 3y – 14z )$

Por la construcción tomando en cuenta $B$ y $\Gamma$ se cumple que $[ T ]_{B}^{\Gamma} = A$.

Teorema (3.5.2.): Sean $V, W$ $K$ – espacios vectoriales de dimensiones finitas $n$ y $m$ respectivamente. Se cumple que $\mathcal{L} (V,W) \cong \mathcal{M}_{m \times n}(K)$.

Demostración: Sean $V, W$ $K$ – espacios vectoriales de dimensiones finitas $n$ y $m$ respectivamente.

Consideremos $\varphi : \mathcal{L}(V,W) \longrightarrow \mathcal{M}_{m \times n}(K)$ con $\varphi (T) = [ T]_{B}^{\Gamma}$ para toda $T \in \mathcal{L}(V,W).$

P.D. $\varphi$ es lineal.

Sean $T,S \in \mathcal{L}(V,W)$ y $\lambda \in K$. Por la proposición (3.4.1) de la entrada 3.4 sabemos que $[ \lambda S + T ]_{B}^{\Gamma}= \lambda [ S ]_{B}^{\Gamma} +[ T ]_{B}^{\Gamma} $, entonces

$\varphi (\lambda S + T) = [ \lambda S + T ]_{B}^{\Gamma}$ $= \lambda [ S ]_{B}^{\Gamma} +[ T ]_{B}^{\Gamma} = \lambda \varphi (S) + \varphi (T).$

$\therefore \varphi$ es lineal.

P.D. $\varphi$ es inyectiva.

Si $T,S \in \mathcal{L}(V,W)$ son tales que $\varphi (T) = \varphi (S)$, entonces $[ T ]_{B}^{\Gamma} = [ S]_{B}^{\Gamma}$ y por la proposición (3.4.2) de la entrada 3.4 tenemos que $T=S.$

$\therefore \varphi$ es inyectiva.

P.D. $\varphi$ es suprayectiva.

Si $A \in \mathcal{M}_{m \times n} (K)$, por la proposición (3.5.1) sabemos que existe $T \in \mathcal{L} (V,W)$ tal que $\varphi (T) = [ T]_{B}^{\Gamma} = A.$

$\therefore \varphi$ es suprayectiva.

$\therefore \varphi \text{ es un isomorfismo y }\mathcal{L} (V,W) \cong \mathcal{M}_{m \times n}(K).$

Corolario (3.5.3.): Sean $V,W$ $K$ – espacios vectoriales de dimensiones $n$ y $m$ respectivamente. Se cumple que $ \mathcal{L}(V,W) $ es de dimensión finita y $\dim \mathcal{L}(V,W) = nm.$

Demostración: Por el teorema (3.5.2.) tenemos que $\mathcal{L}(V,W) \cong \mathcal{M}_{m \times n} (K)$, entonces $\dim \mathcal{L}(V,W) = \dim \mathcal{M}_{m \times n} (K) = mn$.

Tarea Moral

- Considera el campo de los reales, $V=\{a+bx+cx^2\mid a,b,c\in \mathbb{R}\}$, $W=\{a+bx\mid a,b,\in \mathbb{R}\}$ con bases ordenadas $B = ( 1 , -x,x^2 )$ y $\Gamma = ( x-2 , x+1 )$ respectivamente. Encuentra la transformación lineal $T : \mathbb{R}^3 \longrightarrow \mathbb{R}^2$ tal que $[ T ]_{B}^{\Gamma} = \left(\begin{array}{rr} 1 & -3 \\ -2 & 1\\ 7& 0 \end{array}\right)$ describiendo explícitamente la regla de correspondencia, es decir, si $T(a+bx+cx^2) = e+fx$ describe cómo serían $e$ y $f$ en términos de $a,b$ y $c$.

- Considera $B = ( (1,0) , (-1,-1) )$ y $\Gamma = ( (0,1) , (1,1) )$ bases ordenadas de $\mathbb{R}^2$ y $\mu \in \mathbb{R}.$ Encuentra la transformación lineal $T : \mathbb{R}^2 \longrightarrow \mathbb{R}^2$ tal que $[ T ]_{B}^{\Gamma} = \begin{pmatrix} 2 \mu & 5 \mu \\ 3 \mu & \mu \end{pmatrix}$ describiendo explícitamente la regla de correspondencia, es decir, si $T(x,y) = (ax+by , cx + dy)$ describe cómo serían $a,b,c$ y $d$ en términos de $x,y$ y $\mu$.

Más adelante…

Ya que sabemos cómo se relaciona la matriz asociada a una transformación con la matriz asociada al producto de dicha transformación con algún escalar, y cómo se relacionan las matrices asociadas a dos transformaciones lineales con la matriz asociada a la suma de dichas transformaciones, ahora veremos cómo se relacionan las matrices asociadas a dos transformaciones lineales con la matriz asociada a la composición de dichas transformaciones y en consecuencia, para transformaciones invertibles, entenderemos cómo se relaciona la matriz asociada a una transformación con la matriz asociada a la transformación inversa.

Entradas relacionadas

- Ir a Álgebra Lineal I

- Entrada anterior del curso: 3.4. MATRIZ DE UNA COMBINACIÓN LINEAL DE TRANSFORMACIÓNES: ejemplos y propiedades

- Siguiente entrada del curso: 3.6. MATRIZ DE UNA COMPOSICIÓN Y DE LA INVERSA DE TRANSFORMACIONES: ejemplos y propiedades