(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

INTRODUCCIÓN

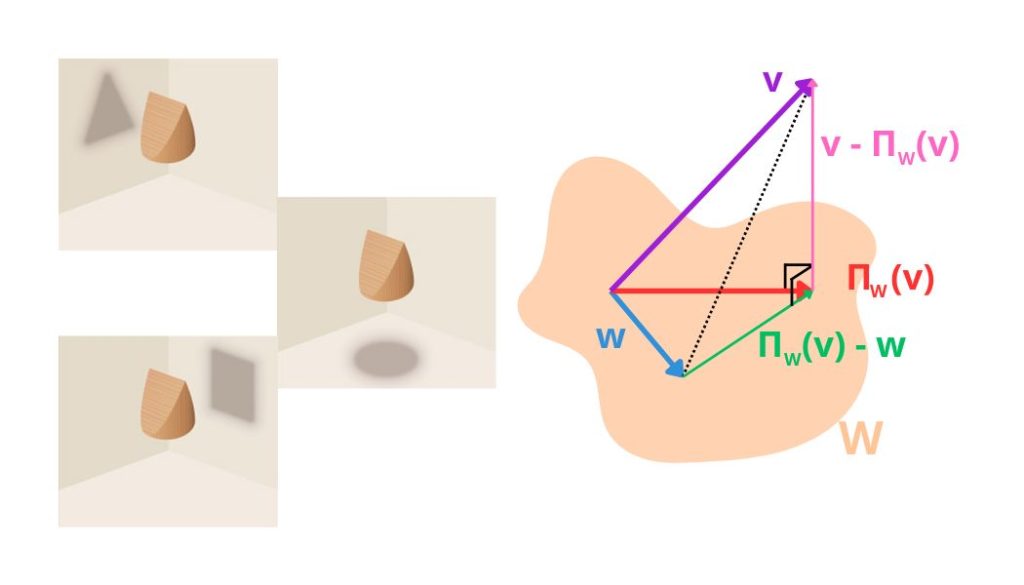

Siienes un subespacio y un vector que no está en él ¿podrías descomponer a ese vector como una suma de un vector que esté en el subespacio y uno que no?

¿Por qué es tan relevante proyectar un vector sobre un subespacio? Porque muchas veces no nos interesa el vector completo, sino solo la parte que “vive” dentro de un cierto contexto o restricción: un plano, una dirección, un conjunto de condiciones. Proyectar es una forma de extraer la componente útil de un vector respecto a un subespacio, descartando lo que no pertenece. Esta operación no solo tiene un significado geométrico muy claro, buscar el punto más cercano al vector dentro del subespacio, sino también una formulación algebraica precisa que podemos calcular usando producto interno y bases ortonormales.

Ahora, veremos que la proyección nos lleva a un resultado profundo: bajo ciertas condiciones todo vector del espacio puede descomponerse de forma única como la suma de uno que pertenece a un subespacio y otro que es ortogonal a él. Esta idea nos permitirá expresar el espacio completo como la suma directa del subespacio y su ortogonal, una estructura que aparece una y otra vez en matemáticas, física, estadística y más. En otras palabras, no solo sabremos proyectar, sino que podremos entender la geometría interna del espacio con una claridad que antes no teníamos.

PROYECCIÓN DE $v$ EN $W$ CON RESPECTO A $\Gamma$

Definición: Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial con producto interno $\langle\; ,\; \rangle$. Dados $W$ un subespacio de $V$ de dimensión finita $m$, $\Gamma = \{ w_1 , … , w_m \}$ una base ortonormal de $W$ y $v \in V$, definimos la proyección de $v$ en $W$ con respecto a $\Gamma$ como $\Pi_W^{\Gamma} (v) = \displaystyle \sum_{i=1}^{m} \langle v,w_i \rangle w_i.$

Observación 1: Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial con producto interno $\langle\; ,\; \rangle$, $W$ un subespacio de $V$ de dimensión finita $m$, $\Gamma = \{ w_1 , … , w_m \}$ una base ortonormal de $W$ y $v \in V$. Tenemos que $\Pi_W^{\Gamma} (v) \in W$ y $v \;-\; \Pi_W^{\Gamma} (v) \in W^{\perp}$.

Justificación. Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial con producto interno $\langle\; ,\; \rangle$, $W$ un subespacio de $V$ de dimensión finita $m$, $\Gamma = \{ w_1 , … , w_m \}$ una base ortonormal de $W$ y $v \in V$.

Por definición, $\Pi_W^{\Gamma} (v) = \displaystyle \sum_{i=1}^{m} \langle v,w_i \rangle w_i\in \langle \Gamma\rangle$, pero $\langle \Gamma \rangle =W$, entonces $\Pi_W^{\Gamma} (v)\in W$ . Por otro lado,

$\langle v \;-\; \Pi_W^{\Gamma} (v) , w_j \rangle$ $= \langle v , w_j \rangle \;-\;\langle \Pi_W^{\Gamma} (v) , w_j \rangle$ $= \langle v , w_j \rangle \;-\;\langle \displaystyle \sum_{i=1}^{m} \langle v , w_i \rangle w_i , w_j \rangle$ $= \langle v, w_j \rangle \;-\;\displaystyle \sum_{i=1}^{m}\langle v , w_i \rangle\langle w_i , w_j \rangle$.

Dado que $\Gamma = \{ w_1 , … , w_m \}$ una base ortonormal de $W$, sabemos que $\langle w_i , w_j \rangle = 0$ para todas $i,j\in\{1,\dots , m\}$ con $i \not= j$ y $\langle w_j , w_j \rangle = 1$ para toda $j\in\{1,\dots , m\}$.

Así, $\langle v \;-\; \Pi_W^{\Gamma} (v) , w_j \rangle = \langle v, w_j \rangle \;-\; \displaystyle \sum_{i=1}^{m}\langle v , w_i \rangle\langle w_i , w_j \rangle$ $= \langle v , w_j \rangle\;-\; \langle v , w_j \rangle \langle w_j , w_j \rangle$ $= \langle v , w_j \rangle \;-\; \langle v , w_j \rangle (1)$ $= \langle v , w_j \rangle \;-\; \langle v , w_j \rangle = 0$.

Tenemos entonces que $\langle v \;-\; \Pi_W^{\Gamma} (v) , w_j \rangle=0$ para toda $j\in\{1,\dots , m\}$, es decir, $v \;-\; \Pi_W (v)\in\Gamma^\perp$. Pero, por la proposición (4.1.1) de la entrada 4.1 sabemos que $\Gamma^\perp=\langle \Gamma\rangle ^\perp=W^\perp$. Por lo tanto $v \;-\; \Pi_W^{\Gamma} (v)\in W^\perp$.

Teorema (4.8.1.): Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial con producto interno $\langle\; ,\; \rangle$ y $W$ un subespacio de $V$ de dimensión finita. Entonces, $V = W \oplus W^{\perp}$.

Demostración: Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial con producto interno $\langle\; ,\; \rangle$, $W$ un subespacio de $V$ de dimensión finita y $\Gamma $ una base ortonormal de $W$.

Sea $v \in V$. Tenemos que

$v = v + \left( – \Pi_W^{\Gamma} (v) + \Pi_W (v) \right)$ $=\Pi_W^{\Gamma} (v) +\left( v \;-\; \Pi_W^{\Gamma} (v) \right) $.

Dado que $\Pi_W^{\Gamma} (v) \in W$ y $v \;-\; \Pi_W^{\Gamma} (v) \in W^{\perp}$, concluimos que $v \in W + W^{\perp}$. Así, $V \subseteq W + W^{\perp}$.

Como la otra contención es clara, concluimos que $V = W + W^{\perp}$.

Finalmente, para ver que la suma es directa consideremos $w \in W \cap W^{\perp}$. Como $w W^{\perp}$ enemos que $w$ es ortogonal a todo vector de $W$, en particular es ortogonal a sí mismo ya que $w\in W$. Así, $\langle w , w \rangle = 0$, pero por ser un producto interno, esto solo ocurre si $w = \theta_W$.

Por lo tanto, $V = W \oplus W^{\perp}$.

Observación 2: Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial con producto interno $\langle\; ,\; \rangle$ y $W$ un subespacio de $V$ de dimensión finita. Tenemos que $\Pi_W^{\Gamma} (v)$ no depende de $\Gamma$.

Justificación. Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial con producto interno $\langle\; ,\; \rangle$, $W$ un subespacio de $V$ de dimensión finita $m$, $\Gamma $ y ${\Gamma}’$ bases ortonormales de $W$.

$v = \Pi_W^{\Gamma} (v)+ \left( v \;-\; \Pi_W^{\Gamma} (v) \right) $ $= \Pi_W^{{\Gamma}’} (v)+\left( v \;-\; \Pi_W^{{\Gamma}’} (v) \right) $, con $\Pi_W^{\Gamma} (v), \Pi_W^{{\Gamma}’} (v)\in W$ y $ v \;-\; \Pi_W^{\Gamma} (v) , v \;-\; \Pi_W^{{\Gamma}’} (v) \in W^\perp$. Pero, dado que la suma $W \oplus W^{\perp}$ es directa, la descomposición de un vector como un vector en $W$ más uno en $W^{\perp}$ debe ser única, de donde concluimos que $\Pi_W^{\Gamma} (v) = \Pi_W^{{\Gamma}’} (v)$.

Debido a la observación anterior, denotaremos a partir de ahora como $\Pi_W (v) $ a la proyección de $v$ en $W$ con respecto a cualquier base de $W$.

Corolario (4.8.2.): Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial de dimensión finita con producto interno $\langle\; ,\; \rangle$ y $W$ un subespacio de $V$. Entonces,

a) $\dim V = \dim W + \dim W^{\perp}.$

b) Si $\Gamma = \{ w_1 , … , w_m \}$ es una base ortogonal de $W$ y $\beta = \{ w_1 , … , w_m , v_{m+1} , … , v_n \}$ es una base ortogonal de $V$, entonces $\{ v_{m+1} , … , v_n \}$ es una base ortogonal de $W^{\perp}$.

Demostración: Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial de dimensión finita $n$ con producto interno $\langle\; ,\; \rangle$ y $W$ un subespacio de $V$.

a) Por el teorema (1.10.3) de la entrada 1.10 sabemos que $W$ y $W^\perp$ también son de dimensión finita. Ademas, por el teorema (4.8.1.) sabemos que $V = W \oplus W^{\perp}$.

Por lo tanto, usando el teorema (1.11.1) de la entrada 1.11, $\dim V = \dim W \oplus W^{\perp} =\ dim W + \dim W^{\perp}\;-\; \dim W \cap W^{\perp} =\ dim W + \dim W^{\perp}$.

b) Sean $m=\dim W$, $\Gamma = \{ w_1 , … , w_m \}$ es una base ortogonal de $W$ y $B = \{ w_1 , … , w_m , v_{m+1} , … , v_n \}$ es una base ortogonal de $V$.

Entonces $v_j \perp w_i$ para cualesquiera $i \in \{ 1 , … , m \}$ y $j \in \{ m+1 , … , n \}$. Es decir, $\{ v_{m+1} , … , v_n \} \subseteq B^{\perp}=\langle B\rangle ^\perp=W^\perp.$

Además, por la igualdad del inciso a) tenemos que $\dim W^{\perp} = \dim V – \dim W = n-m$.

Como $\{ v_{m+1} , … , v_n \}$ es ortogonal y ninguno de esos vectores es $\theta_V$ (pues $\beta$ es una base), sabemos por la proposición (4.4.1) que $\{ v_{m+1} , … , v_n \}$ es un conjunto linealmente independiente. Además, tiene $n-m$ vectores,

$\therefore \{ v_{m+1} , … , v_n \}$ es una base de $W^{\perp}$.

Teorema (4.8.3.): Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial con producto interno $\langle\; ,\; \rangle$ y $W$ un subespacio de $V$ de dimensión finita.

Dado $v \in V$:

$\forall w\in W (||v\; -\; \Pi_W (v)|| \leq ||v-w||)$.

Nota: El teorema anterior nos asegura que $\Pi_W (v)$ es el vector de $W$ que se encuentra a la menor distancia posible de $v$. Decimos entonces que $\Pi_W (v)$ es la mejor aproximación de $v$ en $W$.

Demostración: Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial con producto interno $\langle\; ,\; \rangle$ y $W$ un subespacio de $V$ de dimensión finita. Sean $v \in V$ y $w \in W$. Como $\Pi_W (v) – w \in W$ y $v – \Pi_W (v)\in W^\perp$, tenemos que $\Pi_W (v) – w\perp v – \Pi_W (v)$ y entonces, por el lema (4.5.3 Pitágoras) de la entrada 4.5 sabemos que

$||v-w||^2 = || v – \Pi_W (v) + \Pi_W (v) – w ||^2$ $= || v – \Pi_W (v) ||^2 + || \Pi_W (v) – w ||^2$ $\geq || v – \Pi_W (v) ||^2$.

Así, $||v-w||^2\geq ||v\; -\; \Pi_W (v)||^2$ y en consecuencia $||v-w||\geq ||v\; -\; \Pi_W (v)||$, con lo que hemos concluido la prueba. Sin embargo, aprovechemos la demostración para notar además que la igualdad se cumple si y sólo si $w = \Pi_W (v)$.

Tarea Moral

- Sea $V = \mathbb{R}^3$ con el producto interno usual.

Sea $W$ el subespacio generado por $\left\{ \frac{1}{ \sqrt{2} } (1,1,0) , \frac{1}{ \sqrt{2} } (0,0,1) \right\}$.

Dado $v = (3,1,4)$, calcula $\Pi_W (v)$. - Sea $V = \mathcal{P}_2 (\mathbb{R})$ con el producto interno $\langle \;,\; \rangle$ dado por $\langle f,g \rangle = \int_{0}^{1} f(x) g(x) dx$ para cualesquiera $f,g \in V$

Sea $W$ el subespacio generado por $\{ 1 , 2x – 1 \}$.

Dado $f(x) = x^2$, calcula $\Pi_W (v)$. - Sea $V = \mathbb{R}^3$con el producto interno usual.

Sea $W$ el subespacio generado por $\{ (1,1,0) , (0,1,1) \}$.

Encuentra $W^{\perp}$ y una base ortonormal para $W^{\perp}$.

Más adelante…

Hasta ahora, hemos trabajado pensando en los vectores como objetos. En la siguiente entrada comenzaremos a verlos desde otro ángulo: ¿qué pasa si en lugar de fijarnos en los vectores, nos fijamos en lo que hacen? ¿qué pasa si consideramos un vector fijo y hacemos su producto con todos los vectores del espacio? Estas preguntas nos llevarán a un concepto fundamental: el espacio dual.

Entradas relacionadas

- Ir a Álgebra Lineal I

- Entrada anterior del curso: 4.7. BASE ORTONORMAL: definición y construcción

- Siguiente entrada del curso: 4.9. ESPACIO DUAL, FUNCIONALES, BASE DUAL, DOBLE DUAL: definición, construcción y ejemplos