(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

INTRODUCCIÓN

Ahora vamos a aprovechar una de las consecuencias más poderosas de tener un producto interno: la posibilidad de descomponer un vector en términos de un subconjunto ortogonal. Trabajaremos con conjuntos de vectores mutuamente ortogonales (lo que garantiza, si el vector nulo no es elemento del conjunto, que se tiene independencia lineal), y cuando podamos lograr construir bases formadas por vectores mutuamente ortogonales lograremos entender a cualquier vector del espacio a partir de sus proyecciones ortogonales sobre cada uno de los vectores de dicha base. Este proceso tiene un ingrediente central: coeficiente de Fourier. Veremos ejemplos concretos de cómo expresar a un vector en términos de una base ortogonal, usando dichos coeficientes.

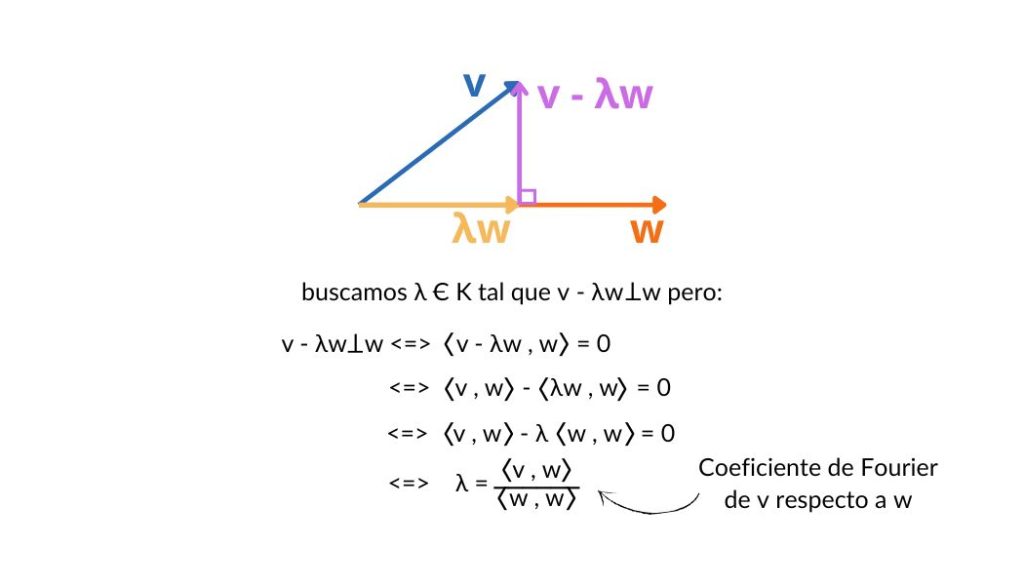

El desarrollo que se obtiene de pedir que $v – \lambda w$ sea ortogonal a $w$ es el que nos permite saber el valor de $\lambda$ y llamamos a este escalar «coeficiente de Fourier de $v$ respecto a $w$».

COEFICIENTE DE FOURIER DE $v$ RESPECTO A $w$

Definición: Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial con producto interno $\langle \;\;, \;\rangle$. Sean $v,w \in V$ con $w \not= \theta_V$. El coeficiente de Fourier de $v$ respecto a $w$ es

$\begin{equation} \frac{ \langle v,w \rangle }{ \langle w,w \rangle } \end{equation}$

Observación: Si $\lambda = \frac{ \langle v,w \rangle }{ \langle w,w \rangle }$, entonces $v – \lambda w \perp w$.

Justificación: $\langle v – \lambda w , w \rangle = \langle v,w \rangle – \lambda \langle w,w \rangle$ $= \langle v, w \rangle – \frac{ \langle v,w \rangle }{ \langle w,w \rangle } \langle w,w \rangle$ $= \langle v,w \rangle – \langle v,w \rangle = 0.$

SUBCONJUNTO ORTOGONAL

Definición: Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial con producto interno $\langle\;\; ,\; \rangle$ y $S \subseteq V$. Decimos que $S$ es ortogonal si $\forall v,w \in S, v \not= w (\langle v,w \rangle = 0)$.

Ejemplo

- Sea $V = \mathbb{R}^3$. $S = \{ (1,2,-4) , (2,-3,-1) , (0,0,0) \}$ es un conjunto ortogonal en $\mathbb{R}^3.$

Justificación. Como $\langle v,w \rangle = \overline{ \langle w,v \rangle }$, entonces $\langle v,w \rangle =0$ si y sólo si $ \langle w,v \rangle =0$, por lo que basta verificar que los siguiente tres productos entre vectores diferentes del conjunto dan cero:

$\langle (1,2,-4) ,(2,-3,-1) \rangle = (1)(2) + (2)(-3) + (-4)(-1) = 0$

$\langle (0,0,0) ,(1,2,-4) \rangle = 0$

$\langle (0,0,0) ,(2,-3,-1) \rangle = 0.$

Proposición (4.4.1.): Sean $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$- espacio vectorial con producto interno $\langle \;\;, \;\rangle$ y $S \subseteq V$. Si $S$ es ortogonal y $\theta_V \notin S$, entonces $S$ es linealmente independiente.

Demostración: Sean $V$ un $K$- espacio vectorial con producto interno $\langle \;\;, \;\rangle$ y $S \subseteq V$. Supongamos $S$ es ortogonal y $\theta_V \notin S$.

Sean $m \in \mathbb{N}$, $s_1,…,s_m \in S$ distintos, $\lambda_1 , … , \lambda_m \in K$ tales que $\lambda_1 s_1 + … + \lambda_m s_m = \theta_V.$

Sea $j \in \{ 1 , … , m \}$.

Como $S$ es ortogonal, entonces $\forall i \in \{ 1, … , j-1, j+1 , … m \} ( \langle s_i , s_j \rangle = 0)$.

De modo que $0 = \langle \theta_V , s_j \rangle$ $= \langle \lambda_1 s_1 + … + \lambda_m s_m , s_j \rangle$ $= \lambda_1 \langle s_1 , s_j \rangle + … + \lambda_j \langle s_j , s_j \rangle + … + \lambda_m \langle s_m , s_j \rangle$ $= \lambda_1 (0) + … + \lambda_j \langle s_j , s_j \rangle + … + \lambda_n (0) = \lambda_j \langle s_j , s_j \rangle$

Así, $0 = \lambda_j \langle s_j , s_j \rangle$. Como $s_j \not= \theta_V$ y $\langle \;\;, \;\rangle$ es un producto interno, sabemos que $ \langle s_j , s_j \rangle\neq 0$.

Por lo tanto, $\lambda_j = 0$.

$\therefore S$ es linealmente independiente.

Observación: Sea $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial de dimensión finita $n$ con producto interno $\langle \;\;, \;\rangle$. Sea $B = \{ v_1 , … , v_n \}$ una base ortogonal de $V$.

Si $v \in V$, entonces $v = \lambda_1 v_1 + … + \lambda_n v_n$ donde para cada $j$, $\lambda_j$ el coeficiente de Fourier de $v$ con respecto a $v_j$

Justificación. Sea $K=\mathbb{R}$ o $K=\mathbb{C}$, $V$ un $K$ – espacio vectorial de dimensión finita $n$ con producto interno $\langle \;\;, \;\rangle$. Sea $B = \{ v_1 , … , v_n \}$ una base ortogonal de $V$. Sea $v \in V$. Como $B$ es una base de $V$, entonces, $v = \lambda_1 v_1 + … + \lambda_n v_n$ con $\lambda_1 , … , \lambda_n\in K$, entonces para cada $j \in \{ 1,…,n \}$:

$\langle v,v_j \rangle = \langle \lambda_1 v_1 + … + \lambda_n v_n , v_j \rangle$ $= \lambda_1 \langle v_1 , v_j \rangle + … + \lambda_j \langle v_j , v_j \rangle + … + \lambda_n \langle v_n , v_j \rangle$ $= \lambda_1 (0) + … + \lambda_j \langle v_j , v_j \rangle + … + \lambda_n (0)$ $= \lambda_j \langle v_j , v_j \rangle$

Así, $\langle v,v_j \rangle = \lambda_j \langle v_j , v_j \rangle$. Finalmente, como $v_j$ es un elemento $B$ que es una base y en particular es un conjunto linealmente independiente, entonces $v_j\neq\theta_V$, por lo que $\langle v_j , v_j \rangle\neq 0$ y en consecuencia $\lambda_j = \frac{ \langle v , v_j \rangle }{ \langle v_j , v_j \rangle}$.

Ejemplo

- Sea $B = \{ v_1 , v_2 , v_3 \} \subseteq \mathbb{R}^3$ con $v_1 = (1,2,-4) , v_2 = (2,-3,-1)$ y $v_3 = (2,1,1)$. Sea $v = (5,-7,2)$.

Entonces $\lambda_1 = \frac{ -17 }{ 21 } , \lambda_2 = \frac{ 29 }{ 14 }$ y $\lambda_3 = \frac{ 5 }{ 6 }.$

Justificación. Veamos que $B$ es un conjunto ortogonal:

$\langle (1,2,-4) , (2,-3,-1) \rangle = (1)(2) + (2)(-3) + (-4)(-1) = 0$

$\langle (1,2,-4) , (2,1,1) \rangle = (1)(2) + (2)(1) + (-4)(1) = 0$

$\langle (2,-3,-1) , (2,1,1) \rangle = (2)(2) + (-3)(1) + (-1)(1) = 0$

Entonces $B$ es ortogonal y como $(0,0,0) \notin B$, entonces $B$ es linealmente independiente con cardinalidad $3$ y por tanto, es una base de $\mathbb{R}^3$. Es decir, $B$ es una base ortogonal de $\mathbb{R}^3.$ Calculemos los coeficientes de Fourier de $v$ respecto a cada vector de esta base:

$\begin{equation}

\lambda_ 1 = \frac{ \langle (5,-7,2) , (1,2,-4) \rangle }{ \langle (1,2,-4) , (1,2,-4) \rangle } = \frac{ (5)(1) + (-7)(2) + (2)(-4) }{ (1)(1) + (2)(2) + (-4)(-4) } = \frac{ -17 }{ 21 }

\end{equation}$

$\begin{equation}

\lambda_2 = \frac{ \langle (5,-7,2) , (2,-3,-1) \rangle }{ \langle (2,-3,-1) , (2,-3,-1) \rangle } = \frac{ (5)(2) + (-7)(-3) + (2)(-1) }{ (2)(2) + (-3)(-3) + (-1)(-1) } = \frac{ 29 }{ 14 }

\end{equation}$

$\begin{equation}

\lambda_3 = \frac{ \langle (5,-7,2) , (2,1,1) \rangle }{ \langle (2,1,1) , (2,1,1) \rangle } = \frac{ (5)(2) + (-7)(1) + (2)(1) }{ (2)(2) + (1)(1) + (1)(1) } = \frac{ 5 }{ 6 }

\end{equation}$

De donde: $(5,-7,2) = \frac{ -17 }{ 21 } (1,2,-4) + \frac{ 29 }{ 14 } (2,-3,-1) + \frac{ 5 }{ 6 } (2,1,1)$.

Tarea Moral

- Sea $V = \mathbb{R}^2$. Considera las bases de $ \mathbb{R}^2$ $B_1 = \{ (1,1) , (1,-1) \}$ y $B_2 = \{ (1,1) , (2,1) \}$

¿Son ortogonales?

En caso de que la base sea ortogonal encuentra el coeficiente de Fourier para $(3,-5)$ respecto a cada vector de la base y expresa a $(3,-5)$ en términos de la base. - Sea $V = \mathbb{R}^3$. Sean $B_1 = \{ (1,1,0) , (-1,1,0) , (0,0,2) \}$ y $B_2 = \{ (1,1,0) , (1,0,1) , (0,1,1) \}$

¿Son ortogonales?

En caso de que la base sea ortogonal encuentra el coeficiente de Fourier para $(2,-4,1)$ respecto a cada vector de la base y expresa a $(2,-4,1)$ en términos de la base.

Más adelante…

Desde la introducción, fue notorio el uso de la noción de distancia, para medir el «tamaño» de los vectores. A continuación vamos a formalizar y a generalizar este concepto, definiendo la «norma» de un vector. De manera natural surgirán dos grandes teoremas.

A partir del concepto de norma podremos hablar de vectores unitarios o de norma uno y descubriremos la utilidad de trabajar con bases ortogonales formadas por vectores unitarios… pero todo a su tiempo.

Entradas relacionadas

- Ir a Álgebra Lineal I

- Entrada anterior del curso: 4.3. ESPACIO REAL O COMPLEJO CON PRODUCTO INTERNO: definición y ejemplos

- Siguiente entrada del curso: 4.5. NORMA DE UN VECTOR: propiedades, Cauchy Schwarz, Pitágoras y vector unitario