(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

INTRODUCCIÓN

Imagina que quieres describir una interacción entre varios vectores al mismo tiempo, que capture relaciones no solo por pares, sino entre todos ellos a la vez. Aquí es donde entran las funciones multilineales, una poderosa herramienta para estudiar relaciones entre múltiples vectores simultáneamente.

En esta entrada vamos a construir una nueva manera de pensar la linealidad: ya no como una simple transformación de un solo vector, sino como una función que toma varios vectores y devuelve algo significativo —un número, un vector, o incluso otra función— respetando la estructura lineal en cada entrada. Además, descubriremos funciones que «reaccionan» de formas específicas cuando intercambiamos vectores o repetimos uno de ellos: funciones simétricas y alternantes.

FUNCIÓN MULTILINEAL, $n$-MULTILINEAL EN $V$ Y ALTERNANTE

Definición: Sean $n \in \mathbb{N}^+$ y $V_1 , … , V_n, W$ $K$ – vectoriales. Decimos que una función $\varphi : V_1 \times … \times V_n \longrightarrow W$ es:

- $n$-multilineal si para cada $i \in \{ 1,…,n \}$ al elegir cualesquiera $v_j \in V_j$ con $j \not= i$, se tiene que la función $T_i : V_i \longrightarrow W$ tal que $\forall x \in V_i ( \varphi ( v_1 , … , v_{i-1} , x , v_{i+1} , … , v_n ) )$ es una transformación lineal.

- $n$-multilineal en $V$ si es multilineal y $V_1 = … = V_n = V.$

Si además $W=K$, decimos que $\varphi$ es una forma $n$-multilineal en $V$. - alternante si es una forma $n$ – multilineal en $V$ y se anula cuando dos vectores consecutivos son iguales, es decir, $\varphi(v_1, … , v_n) = 0$ cuando $v_i = v_{i+1}$ para algún $i \in \{1, … , n-1\}$.

- simétrica si es $n$ – multilineal en $V$ y al intercambiar cualesquiera dos entradas de $( v_1 , … , v_n )$ el valor de $\varphi$ en ese elemento permanece igual.

Nota: Le llamamos:

bilineal si es $2$ – multilineal

trilineal si es $3$ – multilineal

multilineal si si es $n$ – multilineal y es claro el valor de $n$

Estas definiciones surgen al estudiar funciones que se evalúan en $n$-adas en los que cada entrada es un vector. La propiedad de multilinealidad garantiza que la función se comporta linealmente en cada una de sus entradas si fijamos las demás. Cuando todas las entradas provienen del mismo espacio vectorial y la imagen está en el campo, hablamos de una forma multilineal.

De acuerdo a las definiciones anteriores, una forma alternante da cero al evaluarse en $n$-adas en las que aparece el mismo vector en dos entradas consecutivas, mientras que el resultado de evaluar una función simétrica permanece inalterado bajo el intercambio de cualesquiera dos entradas de la $n$-ada en la que estemos evaluando.

Ejemplos

- Sean $K = \mathbb{R}$ y $V = \mathbb{R}^n$

$\varphi : V \times V \longrightarrow \mathbb{R}$ donde para todo $v_1 , v_2 \in V$ se define $\varphi (v_1 , v_2) = v_1 \cdot v_2$ (el producto punto usual) es un forma bilineal simétrica.

Justificación. Para verificar que es bilineal, consideremos cada entrada por separado:

Si fijamos $v_1 \in \mathbb{R}^n$, definimos $T_1 : \mathbb{R}^n \longrightarrow \mathbb{R}$ con $T_1(v_2) = v_1 \cdot v_2$ para todo $v_2 \in \mathbb{R}^n$.

Esta función es lineal porque para todos $v_2,w_2 \in \mathbb{R}^n$ y todo $\lambda \in \mathbb{R}$:

$T_1(\lambda v_2 + w_2) = v_1 \cdot (\lambda v_2 + w_2)$ $= v_1 \cdot (\lambda v_2) + v_1 \cdot w_2 = \lambda (v_1 \cdot v_2) + v_1 \cdot w_2$ $= \lambda T_1(v_2) + T_1(w_2).$

Si fijamos $v_2 \in \mathbb{R}^n$, la función $T_2 : \mathbb{R}^n \longrightarrow \mathbb{R}$ con $T_2(v_1) = v_1 \cdot v_2$ para todo $v_1 \in \mathbb{R}^n$, también es lineal ya que para todos $v_1,w_1 \in \mathbb{R}^n$ y todo $\lambda \in \mathbb{R}$:

$T_2(\lambda v_1 + w_1) = (\lambda v_1 + w_1)\cdot v_2$ $= (\lambda v_1)\cdot v_2 + w_1 \cdot v_2 = \lambda (v_1\cdot v_2) +w_1 \cdot v_2$ $= \lambda T_2(v_1) + T_2(w_1).$

Además, $\varphi$ es simétrica porque para cualesquiera $v_1,v_2 \in \mathbb{R}^n$ se tiene que $v_1 \cdot v_2 = v_2 \cdot v_1$, así que para cualesquiera $v_1,v_2 \in \mathbb{R}^n$ se tiene que $\varphi(v_1, v_2) = \varphi(v_2, v_1)$.

- Sean $K = \mathbb{R}$, $V_1 = \mathbb{R}^m$, $V_2 = \mathbb{R}^n$ y $A \in \mathcal{M}_{m \times n} (\mathbb{R})$

$\varphi : \mathbb{R}^m \times \mathbb{R}^n \longrightarrow \mathbb{R}$ donde para todo $x \in \mathbb{R}^m$, $y \in \mathbb{R}^n$ se define $\varphi (x,y) = x^t A y$ es una función bilineal.

(En este caso identificamos a $ \mathbb{R}^m$ con $\mathcal{M}_{m \times 1} (\mathbb{R})$ y a $ \mathbb{R}^n$ con $\mathcal{M}_{n \times 1} (\mathbb{R})$).

Justificación. Para verificar que es bilineal, consideremos cada entrada por separado:

Si fijamos $x \in \mathbb{R}^m$, definimos $T_x : \mathbb{R}^n \longrightarrow \mathbb{R}$ con $T_x(y) = x^t A y$ para todo $y \in \mathbb{R}^n$.

Esta función es lineal porque para todos $y_1,y_2 \in \mathbb{R}^n$ y todo $\lambda \in\mathbb{R}$ se cumple:

$T_x(\lambda y_1 + y_2) = x^t A (\lambda y_1 + y_2)$ $= \lambda x^t A y_1 + x^t A y_2$ $= \lambda T_x(y_1) + T_x(y_2)$.

Si fijamos $y \in \mathbb{R}^n$, definimos $T_y : \mathbb{R}^m \longrightarrow \mathbb{R}$ con $T_y(x) = x^t A y$ para todo $x \in \mathbb{R}^m$. También $T_y$ es lineal porque para todos $x_1,x_2 \in \mathbb{R}^m$ y todo $\lambda \in\mathbb{R}$:

$T_y(\lambda x_1 + x_2) = (\lambda x_1 + x_2)^t A y$ $= \lambda x_1^t A y + x_2^t A y$ $= \lambda T_y(x_1) + T_y(x_2)$.

- Sean $K = \mathbb{R}$, $V_1 = V_2 = \mathbb{R}^n$ y $A \in \mathcal{M}_{n \times n} (\mathbb{R})$ tal que $A^t=A$.

$\varphi : \mathbb{R}^n \times \mathbb{R}^n \longrightarrow \mathbb{R}$ donde para todo $x,y \in \mathbb{R}^n$ se define $\varphi (x,y) = x^t A y$ es una función bilineal simétrica.

Justificación. Debido al ejemplo anterior, sabemos que $\varphi$ es una función bilineal.

Sean $x,y\in \mathbb{R}^n$. Como $A^t=A$, entonces $\varphi (x,y) = x^t A y =x^t A^ty=(y^t A x)^t$. Además, dado que $y^t A x \in \mathcal{M}_{1 \times 1}$, coincide con su transpuesta, es decir $(y^t A x)^t=y^t A x$. Así, $\varphi (x,y) =y^t A x = \varphi (y,x).$

Por lo tanto, $\varphi$ es simétrica.

- Sean $K = \mathbb{R}$, $V_1 = V_2 = V_3 = \mathbb{R}^3$

$\varphi : \mathbb{R}^3 \times \mathbb{R}^3 \times \mathbb{R}^3 \longrightarrow \mathbb{R}$ donde para todo $x_1,x_2,x_3 \in \mathbb{R}^3$ se define $\varphi (x_1,x_2,x_3) = (x_1 \times x_2) \cdot x_3$, donde $x_1\times x_2$ es el producto cruz de los vectores $x_1$ y $x_2$, es una función trilineal alternante.

Justificación. Para verificar que es trilineal, consideremos cada entrada por separado:

Si fijamos $x_1,x_2 \in \mathbb{R}^3$, definimos: $T_{x_1 , x_2} : \mathbb{R}^3 \longrightarrow \mathbb{R}$ con $T_{x_1 , x_2}(x_3) = (x_1 \times x_2) \cdot x_3$ para todo $x_3 \in \mathbb{R}^3$, es lineal porque el producto punto es lineal en su segunda entrada.

Si fijamos $x_1,x_3 \in \mathbb{R}^3$, definimos: $T_{x_1 , x_3} : \mathbb{R}^3 \longrightarrow \mathbb{R}$ con $T_{x_1 , x_3}(x_2) = (x_1 \times x_2) \cdot x_3$ para todo $x_2 \in \mathbb{R}^3$, es lineal porque el producto cruz es lineal en su segunda entrada.

Si fijamos $x_2,x_3 \in \mathbb{R}^3$, definimos: $T_{x_2 , x_3} : \mathbb{R}^3 \longrightarrow \mathbb{R}$ con $T_{x_2 , x_3}(x_1) = (x_1 \times x_2) \cdot x_3$ para todo $x_1 \in \mathbb{R}^3$, es lineal porque el producto cruz es lineal en su primera entrada y el producto punto es lineal en su primera entrada.

Para ver que es alternante, tenemos que analizar lo que pasa cuando dos entradas son iguales:

Supongamos que $x_1 = x_2$. Entonces $\varphi (x_1 , x_2 , x_3) = \varphi (x_1 , x_1 , x_3)$ $= (x_1 \times x_1) \cdot x_3 = 0 \cdot x_3 = 0$

Supongamos que $x_1 = x_3$. Entonces $\varphi (x_1 , x_2 , x_3) = \varphi (x_1 , x_2 , x_1)$ $= (x_1 \times x_2) \cdot x_1 = 0$ porque $x_1 \times x_2$ es ortogonal a $x_1$ y a $x_2$ por construcción y por lo tanto, su producto punto con cualquiera de esos dos vectores da cero. Esto también justifica que si $x_2 = x_3$, entonces $\varphi (x_1 , x_2 , x_3) = 0$.

Proposición (5.1.1.): Sean $n \in \mathbb{N}^+$, $V$ un $K$ – espacio vectorial, $\varphi$ una forma $n$ – multilineal alternante en $V$. Se cumple que:

$\varphi (v_1 , … , v_{i-1}, v_{i+1} , v_i , v_{i+2} , … , v_n)$ $= – \varphi (v_1 , … , v_{i-1}, v_{i-1} , v_i , v_{i+1},v_{i+2} , … , v_n)$ para cualquier $i \in \{ 1 , … , n \}.$

b) $\varphi (v_1 , … , v_{i-1} , v_i , v_{i+1} , … , v_{j-1} , v_j , v_{j+1} , … , v_n )$ $= – \varphi (v_1 , … , v_{i-1} , v_j , v_{i+1} , … , v_{j-1} , v_i , v_{j+1} , … , v_n)$ para cualesquiera $i,j \in \{ 1 , … , n \}$ con $i \not= j.$

c) Dada $\sigma \in S_n$

$\varphi (v_{\sigma (1)} , … , v_{\sigma (n)})$ $= sgn\,\sigma \left( \varphi (v_1 , … , v_n) \right)$ con $sgn\, \sigma $ el signo de $\sigma$, $sgn \,\sigma = 1$ si $\sigma$ es un producto de un número par de transposiciones y es $-1$ si $\sigma$ es un producto de un número impar de transposiciones).

d) Si $v_i = v_j$ para algunos $i,j \in \{ 1 , … , n \}$ con $i \not = j$, entonces $\varphi (v_1 , … , v_n) = 0$.

e) Si $i,j \in \{ 1 , … , n \}$ con $i \not= j$ y $\alpha \in K$, entonces $\varphi (v_1 , … , v_i , … , v_j , … , v_n)$ $= \varphi (v_1 , … , v_i + \alpha v_j , … , v_j , … , v_n)$.

Demostración:

Sean $n \in \mathbb{N}^+$, $V$ un $K$ – espacio vectorial, $\varphi$ una función $n$ – multilineal alternante en $V$.

a) Sea $i \in \{ 1 , … , n \}$:

$0 = \varphi (v_1 , … , v_{i-1} , v_i + v_{i+1} , v_i + v_{i+1} , v_{i+2},… , v_n)$ $= \varphi (v_1 , … , v_{i-1}, v_i , v_i + v_{i+1} ,v_{i+2}, … , v_n) + \varphi (v_1 , … , v_{i-1}, v_{i+1} , v_i + v_{i+1} ,v_{i+2}, … , v_n)$ $= \varphi (v_1 , … , v_{i-1}, v_i , v_i ,v_{i+2}, … , v_n) + \varphi (v_1 , … , v_{i-1}, v_i , v_{i+1} ,v_{i+2}, … , v_n)$ $+ \varphi (v_1 , … , v_{i-1}, v_{i+1} , v_i ,v_{i+2}, … , v_n) + \varphi (v_1 , … , v_{i-1}, v_{i+1} , v_{i+1} ,v_{i+2}, … , v_n)$ $= 0 + \varphi (v_1 , … , v_{i-1}, v_i , v_{i+1} ,v_{i+2}, … , v_n) + \varphi (v_1 , … , v_{i-1}, v_{i+1} , v_i ,v_{i+2}, … , v_n) + 0$ $= \varphi (v_1 , …, v_{i-1} , v_i , v_{i+1} ,v_{i+2}, … , v_n) + \varphi (v_1 , …, v_{i-1} , v_{i+1} , v_i ,v_{i+2}, … , v_n) .$

Así, $0 = \varphi (v_1 , … , v_{i-1}, v_i , v_{i+1},v_{i+2} , … , v_n) + \varphi (v_1 , … , v_{i-1}, v_{i+1} , v_i,v_{i+2} , … , v_n)$ y por lo tanto, $\varphi (v_1 , … , v_{i-1}, v_{i+1} , v_i , v_{i+2} , … , v_n)$ $= – \varphi (v_1 , … , v_{i-1}, v_{i-1} , v_i , v_{i+1},v_{i+2} , … , v_n)$

b) Sean $i,j \in \{ 1 , … , n \}$ diferentes. Supongamos sin pérdida de generalidad que $i < j$, entonces $j = i + k$ para algún $k \in \mathbb{N}^+.$

Haremos inducción sobre $k$:

Observemos que para $k = 1$ se cumple por el inciso anterior en donde $j = i+1.$

Hipótesis de inducción: Supongamos que la función $\varphi$ cambia de signo si se intercambian dos entradas que disten $k-1$ unidades.

Por hipótesis de inducción, tenemos que $\varphi (v_1 , … , v_{i-1} , v_i , v_{i+1} , … , v_{j-1} , v_j , v_{j+1} , … , v_n )$ $= – \varphi (v_1 , … , v_{i-1} , v_{j-1} , v_{i+1} , … , v_{j-2} , v_i , v_j , v_{j+1} , … , v_n )$ pues $i$ y $j -1$ distan $k-1$ unidades.

Además, al intercambiar las entradas $j-1$ y $j$, se tiene que $- \varphi (v_1 , … , v_{i-1} , v_{j-1} , v_{i+1} , … , v_{j-2} , v_i , v_j , v_{j+1} , … , v_n )$ $= \varphi (v_1 , … , v_{i-1} , v_{j-1} , v_{i+1} , … , v_{j-2} , v_j , v_i , v_{j+1} , … , v_n )$ gracias al inciso a).

Por último, usando la hipótesis de inducción, al intercambiar las entradas $i$ y la $j-1$ que distan $k-1$ unidades, se tiene que $= \varphi (v_1 , … , v_{i-1} , v_{j-1} , v_{i+1} , … , v_{j-2} , v_j , v_i , v_{j+1} , … , v_n )$ $= – \varphi (v_1 , … , v_{i-1} , v_j , v_{i+1} , … , v_{j-2} , v_{j-1} , v_i , v_{j+1} , … , v_n )$.

c) Sea $\sigma \in S_n$.

Supongamos que $\sigma = \tau_m \circ … \circ \tau_1$ con $\tau_1 , … , \tau_m \in S_n$ transposiciones. (Recordemos que aunque la descomposición de $\sigma$ en transposiciones no es única, la paridad de la cantidad de transposiciones en la descomposición no cambia).

Una transposición intercambia la posición de dos vectores y aplicar varias transposiciones (como en el caso de la composición de transposiciones) no es más que intercambiar varios vectores consecutivamente y por el inciso anterior, cada uno de estos intercambios representa un cambio de signo.

Contemplando todo esto, tenemos:

$\varphi ( v_{\sigma (1)} , … , v_{\sigma (n)} ) = \varphi ( v_{\tau_m \circ … \circ \tau_1(1) } , … , v_{\tau_m \circ … \circ \tau_1 (n) } )$ $= – \varphi ( v_{ \tau_{m-1} \circ … \circ \tau_1(1) } , … , v_{ \tau_{m-1} \circ … \circ \tau_1 (n)}$ $= – ( – \varphi ( v_{ \tau_{m-2} \circ … \circ \tau_1(1) } , … , v_{ \tau_{m-2} \circ … \circ \tau_1 (n)} ) )$ $= (-1)^m \varphi (v_1 , … , v_m)$ $= sgn \,\sigma \left( \varphi (v_1 , … , v_m) \right).$

d) Si $v_i = v_j$ para algunos $i,j \in \{ 1 , … , n \}$ con $i \not= j$, se tiene que:

$(v_1 , … , v_{i-1}, v_i ,v_{i+1}, … ,v_{j-1}, v_j ,v_{j+1}, … , v_n) = (v_1 , …,v_{i-1} , v_j ,v_{i+1}, …,v_{j-1} , v_i ,v_{j+1}, … , v_n).$

Así, $\varphi(v_1 , … , v_{i-1}, v_i ,v_{i+1}, … ,v_{j-1}, v_j ,v_{j+1}, … , v_n) = \varphi (v_1 , …,v_{i-1} , v_j ,v_{i+1}, …,v_{j-1} , v_i ,v_{j+1}, … , v_n).$

Por otro lado, del inciso b) sabemos que $\varphi(v_1 , … , v_{i-1}, v_i ,v_{i+1}, … ,v_{j-1}, v_j ,v_{j+1}, … , v_n) =- \varphi (v_1 , …,v_{i-1} , v_j ,v_{i+1}, …,v_{j-1} , v_i ,v_{j+1}, … , v_n).$

Por lo tanto, $\varphi(v_1 , … , v_{i-1}, v_i ,v_{i+1}, … ,v_{j-1}, v_j ,v_{j+1}, … , v_n) =-\varphi(v_1 , … , v_{i-1}, v_i ,v_{i+1}, … ,v_{j-1}, v_j ,v_{j+1}, … , v_n) .$

Concluimos que $\varphi(v_1 , … , v_{i-1}, v_i ,v_{i+1}, … ,v_{j-1}, v_j ,v_{j+1}, … , v_n)= 0$.

e) Sean $i,j \in \{ 1 , … , n \}$ con $i \not= j$ y $\alpha \in K$:

$\varphi ( v_1 , … , v_{i-1} , v_i + \alpha v_j , v_{i+1} , … , v_j , … , v_n )$ $= \varphi ( v_1 , … , v_{i-1} , v_i , v_{i+1} , … , v_j , … , v_n ) + \alpha \varphi ( v_1 , … , v_{i-1} , v_j , v_{i+1}, … , v_j , … , v_n )$ $= \varphi ( v_1 , … , v_{i-1} , v_i , v_{i+1} , … , v_j , … , v_n ) +0$ $= \varphi ( v_1 , … , v_{i-1} , v_i , v_{i+1} , … , v_j , … , v_n ) .$

Tarea Moral

- Sean $K = \mathbb{R}$ y $V_1 = V_2 = V_3 = \mathbb{R}^3.$

Sea $\varphi : \mathbb{R}^3 \times \mathbb{R}^3 \times \mathbb{R}^3 \longrightarrow \mathbb{R}$ una forma trilineal alternante tal que $\varphi((1,0,0), (0,1,0), (0,0,1)) = 1.$

Calcula el valor de $\varphi((2,0,0), (3,4,0), (0,5,6)).$

Sugerencia: Escribe los vectores $(2,0,0), (3,4,0)$ y $(0,5,6)$ como combinación lineal de los vectores $(1,0,0), (0,1,0)$ y $(0,0,1).$ Como es $3$ – lineal, puedes ocupar el inciso e) de la proposición (5.1.1.) y finalmente la definición de ser alternante para anular una parte. - Sean $K = \mathbb{R}$ y $V_1 = V_2 = \mathbb{R}^2.$

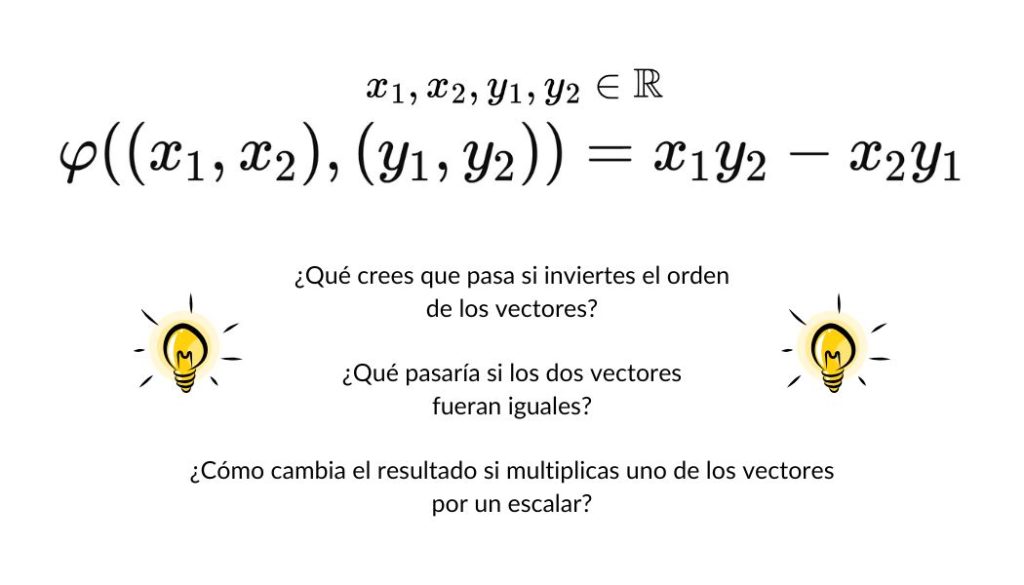

Sea $\varphi : \mathbb{R}^2 \times \mathbb{R}^2 \longrightarrow \mathbb{R}$ definida para cada $(x_1 , x_2) , (y_1 , y_2) \in \mathbb{R}^2$ como $\varphi ((x_1 , x_2) , (y_1 , y_2)) = \alpha x_1 y_2 – \alpha x_2 y_1 + \beta x_1 y_1.$

a) Demuestra que $\varphi$ es bilineal para todo $\alpha , \beta \in \mathbb{R}.$

b) Determina para qué valores de $\alpha$ y $\beta$ la forma alternante.

c) ¿Para esos valores del inciso anterior se cumple que $\varphi$ es simétrica?

Más adelante…

Veremos que las formas multilineales alternantes tienen un papel fundamental al dar origen a una de las herramientas más poderosas del álgebra lineal: el determinante. Esta función, que a primera vista parece una simple fórmula con signos y productos, en realidad captura de manera elegante información clave sobre una matriz, por ejemplo, si es invertible o no. Lo que aprenderemos a continuación conecta directamente con lo que acabamos de ver: la multilinealidad y la alternancia no son solo propiedades curiosas, sino la base que hace único al determinante.

Entradas relacionadas

- Ir a Álgebra Lineal I

- Entrada anterior del curso: 4.9. ESPACIO DUAL, FUNCIONALES, BASE DUAL, DOBLE DUAL: definición, construcción y ejemplos

- Siguiente entrada del curso: 5.2. DETERMINANTE: definición, fórmula y unicidad