(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

INTRODUCCIÓN

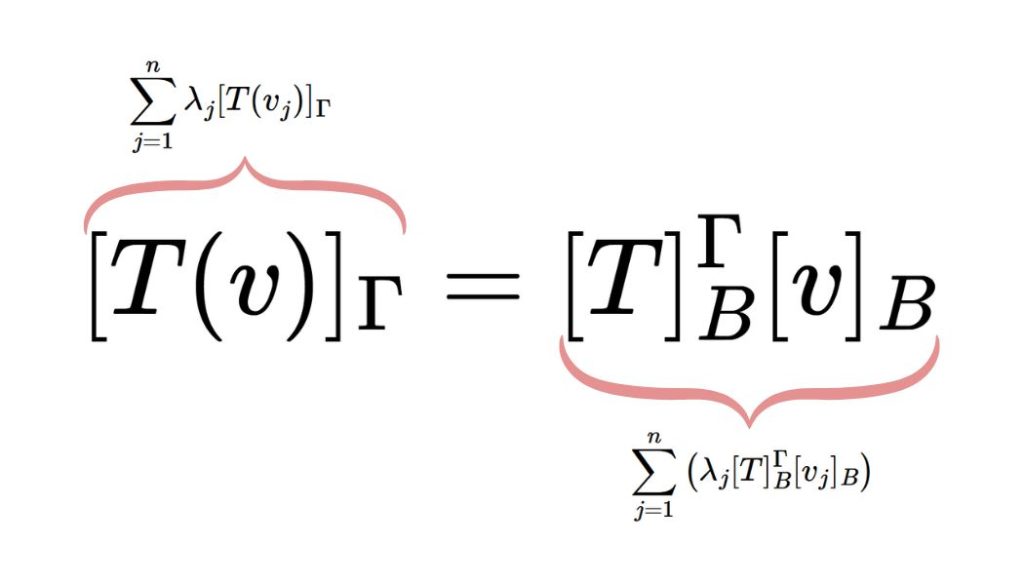

Nos concentraremos en una igualdad que nos permite encontrar el transformado de un vector, o de modo más preciso: su codificación en términos de alguna base, a partir del producto de la matriz asociada a la transformación y el vector de coordenadas de dicho vector.

Nuestra principal motivación es que es más fácil manejar los vectores de coordenadas que los vectores mismos y las matrices en vez de las transformaciones lineales.

Resulta importante recordar que las matrices pasaron de ser tan solo un ejemplo de espacio vectorial a la forma en que se manejan las transformaciones en lugar de la regla de correspondencia usualmente ocupada en funciones.

Las propiedades lineales de las matrices cobran protagonismo en la demostración de la siguiente proposición por lo que se sugiere tenerlas presentes y revisarlas si es que se considera necesario . Es importante dedicarle a este resultado el suficiente tiempo y atención pues nos será de mucha utilidad tanto en la teoría como en los ejercicios posteriores.

Proposición (3.3.1.): Sean $V$ y $W$ $K$ – espacios vectoriales de dimensión finita con bases ordenadas $B$ y $\Gamma$ y $T\in \mathcal{L}(V,W)$.

Entonces para todo $v\in V$ se cumple que $[ T(v) ]_{\Gamma} = [ T ]_{B}^{\Gamma} [ v ]_{B}$.

Demostración: Sea $v\in V$.

Notemos primero que el resultado se cumple cuando $v$ es uno de los vectores de la base $B$. Digamos que $\B = (v_1,v_2,…,v_n)$ con $v_1,v_2,…,v_n\in V$.

Af. 1. Para toda $j\in\{1,2,…,n\}$ se cumple que $[T]_B^{\Gamma} [v_j ]_{B} =[T(v_j) ]_{\Gamma}$

Justificación. Sea $j\in \{ 1,2,…,n\}$.

Como $v_j= 0v_1+…+1v_j+…+0v_n$:

$[ T ]_{B}^{\Gamma} [ v_j ]_{B}$ $=[T ]_{B}^{\Gamma} \begin{pmatrix} 0 \\ \vdots \\ 1 \\ \vdots \\ 0 \end{pmatrix}$ $= col_j [T ]_{B}^{\Gamma}$ $=[ T(v_j) ]_{\Gamma}.$

Ahora bien, sea $v\in V$. Sabemos que existen $\lambda_1,\lambda_2,…,\lambda_n\in K$ tales que $v=\sum_{j=1}^{n} \lambda_j v_j $. Recordemos que, de acuerdo a la observación de la entrada 3.1, el vector de coordenadas abre sumas y saca escalares. Así,

$\begin{align*}

[ T(v) ]_{\Gamma}&=\left[ T \left( \sum_{j=1}^{n} \lambda_j v_j \right) \right]_{\Gamma} \tag{$v=\sum_{j=1}^{n} \lambda_j v_j $}\\

&=\left[ \sum_{j=1}^{n} \lambda_j T(v_j) \right]_{\Gamma} \tag{$T\in\mathcal{L}(V,W)$}\\

&=\sum_{j=1}^{n} \lambda_j [ T(v_j) ]_{\Gamma}\tag{Obs. entrada 3.1}\\

&=\sum_{j=1}^{n} \left( \lambda_j [ T ]_{B}^{\Gamma}[v_j ]_{B} \right)\tag{Af. 1}\\

&=[ T ]_{B}^{\Gamma} \left( \sum_{j=1}^{n} \left( \lambda_j[ v_j ]_{B} \right) \right) \tag{prop. matriz}\\

&=[ T]_{B}^{\Gamma} \left[ \sum_{j=1}^{n}\lambda_j v_j \right]_{B} \tag{Obs. entrada 3.1}\\

&=[ T ]_{B}^{\Gamma} [ v ]_{B}\tag{$v=\sum_{j=1}^{n} \lambda_j v_j $}\\

\therefore [T(v) ]_{\Gamma}=[ T ]_{B}^{\Gamma}[v ]_{B}.

\end{align*}$

Ejemplos

- Sean $B = ((1,2),(1,1))$ y $\Gamma = ((3,1),(-1,2))$ bases ordenadas de $\mathbb{R}^2$.

Sea $T\in\mathcal{L}(\mathbb{R}^2,\mathbb{R}^2)$ tal que $[ T ]_{B}^{\Gamma}=\begin{pmatrix} 4 & 2 \\ -1 & 2 \end{pmatrix}$.

Entonces: $[T(x,y) ]_{\Gamma} = \begin{pmatrix} 2y \\ 5x-3y \end{pmatrix}.$

Sea $(x,y)\in\mathbb{R^2}$:

$(x,y)= \lambda (1,2) + \mu (1,1)=(\lambda + \mu , 2\lambda + \mu)$ para algunos $\lambda, \mu \in \mathbb{R}$.

Así:

$\lambda + \mu = x$ $…(1)$

$2\lambda + \mu = y$ $…(2)$

Restando$(1)$ a $(2)$ tenemos que $\lambda = y-x$ $…(3)$.

De sustituir $(3)$ en $(1)$ y despejar $\mu$ obtenemos que $\mu =2x-y$.

Por lo tanto, $[(x,y) ]_{B}= \begin{pmatrix} y-x \\ 2x-y \end{pmatrix}$.

Por la proposición 3.3.1, $[T(x,y) ]_{\Gamma} = [T ]_{B}^{\Gamma}$$[ (x,y) ]_{B}=$$\begin{pmatrix} 4 & 2 \\ -1 & 2 \end{pmatrix} \begin{pmatrix} y-x \\ 2x-y \end{pmatrix} = \begin{pmatrix} 2y \\ 5x-3y \end{pmatrix}$.

Además, de lo anterior concluimos que $T(x,y)=2y(3,1)+(5x-3y)(-1,2)$$=(6y,2y)+(-5x+3y,10x-6y)$$=(-5x+9y,10x-4y)$.

Tarea Moral

- Sean $K=\mathbb{R}$, $T:\mathcal{M}_{2\times 2}(\mathbb{R})\longrightarrow\mathcal{M}_{2\times 2}(\mathbb{R})$ con $T(A)=A^t$ y $B=\Gamma = (E_{11},E_{12},E_{21},E_{22})$ la base canónica. Considera $v= \begin{pmatrix} -7 & \frac{1}{2} \\ \pi & 0 \end{pmatrix}$. Calcula $[ T ]_{B}^{\Gamma}$ y úsala para encontrar $[ T(v) ]_{\Gamma}$.

- Sean $K=\mathbb{R}$, $V=\{ a+bx+cx^2|a,b,c \in \mathbb{R} \}$, $T: V \longrightarrow V$ con $T(f(x))=3(f'(x))(2-x)+4f(x)$, $B=(1,x,x^2)$ la base canónica y $\Gamma = (1+2x+3x^2,-1+4x+2x^2,-2+x+x^2)$.

Considera $v=-5+11x-2x^2$. Calcula $[ T ]_{B}^{\Gamma}$ y úsala para encontrar $[T(v) ]_{\Gamma}$.

Más adelante…

Ahora que hemos entendido cómo es la matriz asociada a una transformación lineal recordemos que las transformaciones lineales se pueden multiplicar por escalares y se pueden sumar entre sí. Es natural entonces preguntarse: ¿cómo se relaciona la matriz asociada a una transformación con la matriz asociada al producto de dicha transformación con algún escalar?, ¿cómo se relacionan las matrices asociadas a dos transformaciones lineales con la matriz asociada a la suma de dichas transformaciones?

Pequeño adelanto: resultará igual realizar la operación de la(s) transformación(es) y después fijarse en la matriz asociada, que tomar la(s) matriz(ces) asociada(s) a la(s) transformación(es) y posteriormente realizar las operaciones correspondientes en las matrices.

Entradas relacionadas

- Ir a Álgebra Lineal I

- Entrada anterior del curso: 3.2. MATRIZ DE UNA TRANSFORMACIÓN LINEAL: definición y ejemplos

- Siguiente entrada del curso: 3.4. MATRIZ DE UNA COMBINACIÓN LINEAL DE TRANSFORMACIONES: ejemplos y propiedades