Introducción

Anteriormente definimos los espacios $L^p$ para $p\in [1,\infty)$, definimos su norma y estudiamos algunas de sus propiedades analíticas más importantes. En esta entrada estudiaremos el concepto de supremo esencial y el espacio $L^{\infty}$. Bajo ciertas condiciones, este último espacio se puede pensar como «un caso límite» de los espacios $L^p$, y como veremos, comparten varias de sus propiedades. También le daremos sentido a nuestra convención de que el dual de Hölder de 1 sea $\infty$.

Durante toda la entrada $(X,\mathcal{M},\mu)$ denotará un espacio de medida arbitrario salvo que se especifique lo contrario.

Definición. Sea $f$ una función $\mathcal{M}$-medible, posiblemente definida en $\mu$-c.t.p. de $X$. Decimos que $f$ es esencialmente acotada si existe $M\in \mathbb{R}$ con $0\leq M<\infty$ tal que $$|f(x)|\leq M.$$ Para $\mu$-c.t.p. de $X$. O equivalentemente $$\mu(\{ x \ | \ \ M<|\ f(x)|\})=0.$$

Al igual que hicimos con los espacios $L^p$, identificaremos a las funciones que son iguales en $\mu$-c.t.p. de $X$, es decir, a lo largo de esta entrada, cuando hablemos de alguna función $f$, nos referiremos implícitamente a la clase de equivalencia de funciones $\mathcal{M}$-medibles e iguales en $\mu$-c.t.p. a $f$.

Definición. El espacio $L^{\infty}(X,\mathcal{M},\mu)$ es la colección de (clases de equivalencia) de funciones $\mathcal{M}$-medibles y esencialmente acotadas en $X$, equipado con la norma:

$$\left\lVert f \right\lVert_{\infty}=\inf \{M\in \mathbb{R} \ \ | \ \ |f(x)|\leq M \text{ en } \mu-c.t.p. \}.$$ Al número $\left\lVert f \right\lVert_{\infty}$ le llamaremos el supremo esencial de $f$.

Cuando el espacio sobre el que estemos trabajando sea claro, denotaremos a $L^{\infty}(X,\mathcal{M},\mu)$ como $L^{\infty}(X)$ o simplemente como $L^{\infty}$.

No es trivial que $\left\lVert \cdot \right\lVert_{\infty}$ es una norma sobre $L^{\infty}$. Antes de probarlo, veamos una propiedad útil de $\left\lVert \cdot \right\lVert_{\infty}$:

Proposición. Si $f\in L^{\infty}$ $\implies$ $|f(x)|\leq \left\lVert f \right\lVert_{\infty}$ en $\mu$-c.t.p. $x\in X$.

Demostración. Por definición de ínfimo, podemos encontrar una sucesión $\{M_k \}_{k=1}^{\infty}$ tal que $$M_k\longrightarrow \left\lVert f \right\lVert_{\infty}.$$ Y $$|f(x)|\leq M_k.$$ Para cada $x\in X\setminus N_k$ con $\mu(N_k)=0$.

Ahora, definiendo $$N=\bigcup_{k=1}^{\infty} N_k$$ Se sigue que $\mu(N)=0$. Además, para todo $x\in X\setminus N$ tenemos que $$|f(x)|\leq M_k \ \ \ \forall k\in \mathbb{N}$$ $$\implies |f(x)|\leq \left\lVert f \right\lVert_{\infty}.$$

$\square$

Teorema. $(L^{\infty}(X,\mathcal{M},\mu),\left\lVert \cdot \right\lVert_{\infty})$ es un espacio normado.

Demostración. Es inmediato de la definición que $\left\lVert f \right\lVert_{\infty}\geq 0$. Notemos también que $\left\lVert f \right\lVert_{\infty}=0$ $\iff$ $|f(x)|\leq 0$ en c.t.p. $x\in X$ $\iff$ $f=0$ (como clase de equivalencia).

Dadas $f,g\in L^{\infty}$, por la proposición anterior: $$|f(x)|\leq \left\lVert f \right\lVert_{\infty}; \ \ \ \ \ |g(x)|\leq \left\lVert g \right\lVert_{\infty}$$ En $\mu$-c.t.p. $x\in X$. Por la desigualdad del triángulo se sigue entonces: $$|f(x)+g(x)|\leq |f(x)|+|g(x)|\leq \left\lVert f \right\lVert_{\infty}+\left\lVert g \right\lVert_{\infty}.$$ En $\mu$-c.t.p. $x\in X$ $$\implies \left\lVert f+g\right\lVert_{\infty}\leq \left\lVert f \right\lVert_{\infty}+\left\lVert g \right\lVert_{\infty}.$$

$\square$

Como habíamos adelantado, el espacio $L^{\infty}$ comparte varias propiedades con los espacios $L^p$ para $p\in [1,\infty)$. Veamos algunas de ellas.

Teorema (desigualdad de Hölder). Sean $p,q\in [1,\infty]$ conjugados de Hölder (es decir, tales que $\frac{1}{p}+\frac{1}{q}=1$ si $p,q>1$ o bien $p=1,q=\infty$ o bien $p=\infty, q=1$). Si $f\in L^p(X,\mathcal{M},\mu)$ y $g\in L^q(X,\mathcal{M},\mu)$, entonces $fg\in L^1$ y además: $$\int_X |fg| \ \mathrm{d}\mu\leq \left\lVert f \right\lVert_{p}\left\lVert f \right\lVert_{q}$$

Demostración. El caso $p,q\in [1,\infty)$ ya lo habíamos probado. Basta suponer que $f\in L^1$ y $g\in L^{\infty}$, de modo que $|g|\leq \left\lVert g \right\lVert_{\infty}$ en c.t.p. $\implies$ $|fg|\leq |f|\left\lVert g \right\lVert_{\infty}$ en c.t.p. Luego: $$\int |fg| \ \mathrm{d}\mu\leq \left(\int|f| \ \mathrm{d}\mu \right)\left\lVert g \right\lVert_{\infty}=\left\lVert f \right\lVert_{1}\left\lVert g \right\lVert_{\infty}.$$

$\square$

Proposición. $(L^{\infty}(X,\mathcal{M},\mu),\left\lVert \cdot \right\lVert_{\infty})$ es un espacio de Banach.

Demostración. Sea $\{ f_k \}_{k=1}^{\infty}$ una sucesión de Cauchy en $L^{\infty}$. Redefiniendo por $0$ a las funciones $f_k$ en un conjunto de medida nula apropiado (¿Cuál?), podemos asumir sin pérdida de generalidad que:

- $\forall k\in \mathbb{N}$ y $\forall x\in X$ $$|f_k(x)|\leq \left\lVert f_k \right\lVert_{\infty}.$$

- $\forall k,j\in \mathbb{N}$ y $\forall x\in X$ $$|f_k(x)-f_j(x)|\leq \left\lVert f_k-f_j \right\lVert_{\infty}.$$

De esta manera, para cada $x\in X$ $$|f_k(x)-f_j(x)|\leq \left\lVert f_k-f_j \right\lVert_{\infty}.$$ En particular, la sucesión $\{ f_k(x)\}_{k=1}^{\infty}$ es de Cauchy (en $\mathbb{R}$) por lo que converge a un límite $f(x)$.

La función $f(x)$ está definida en cada punto y es medible al ser límite de funciones medibles. Veamos que de hecho $f_k\longrightarrow f$ en $L^{\infty}$.

Como la sucesión $f_k$ es de Cauchy, en particular es acotada, por lo que $\exists M>0$ tal que $$ \left\lVert f_k \right\lVert_{\infty}\leq M.$$ Para todo $k$. En particular $|f_k(x)|\leq \left\lVert f_k \right\lVert_{\infty}\leq M$ para todo $k\in \mathbb{N}$ y para todo $x\in X$. $$\implies |f(x)|= \lim_{k\to \infty} |f_k(x)|\leq M.$$ Para cada $x\in X$. Concluimos que $f$ es (esencialmente) acotada: $f\in L^{\infty}$ con $\left\lVert f \right\lVert_{\infty}\leq M$.

Dado $\varepsilon>0$, podemos encontrar un entero $N$ tal que $\forall k,j>N$: $$\left\lVert f_k-f_j \right\lVert_{\infty}<\varepsilon$$ $$\implies |f_k(x)-f_j(x)|\leq \left\lVert f_k-f_j \right\lVert_{\infty}<\varepsilon, \ \ \ \ \forall x\in X.$$ Fijando $k>N$ y haciendo tender $j\to \infty$ se sigue: $$|f_k(x)-f(x)|\leq \varepsilon, \ \ \ \ \forall x\in X$$ $$\implies \left\lVert f_k-f \right\lVert_{\infty}\leq \varepsilon.$$ Como lo anterior se satisface para cualquier $\varepsilon>0$, concluimos que $f_k\longrightarrow f$ en $L^{\infty}$.

$\square$

El teorema a continuación es otra de las razones para justificar la notación $\left\lVert \cdot \right\lVert_{\infty}$. Por conveniencia, dado $p\in[1,\infty]$ y $f$ una función $\mathcal{M}$-medible, definamos: \begin{equation*}

\left\lVert f \right\lVert_{p}=

\begin{cases}

\left\lVert f \right\lVert_{p} & \text{si } f\in L^p \\

\infty & \text{si } f \notin L^p

\end{cases}

\end{equation*}

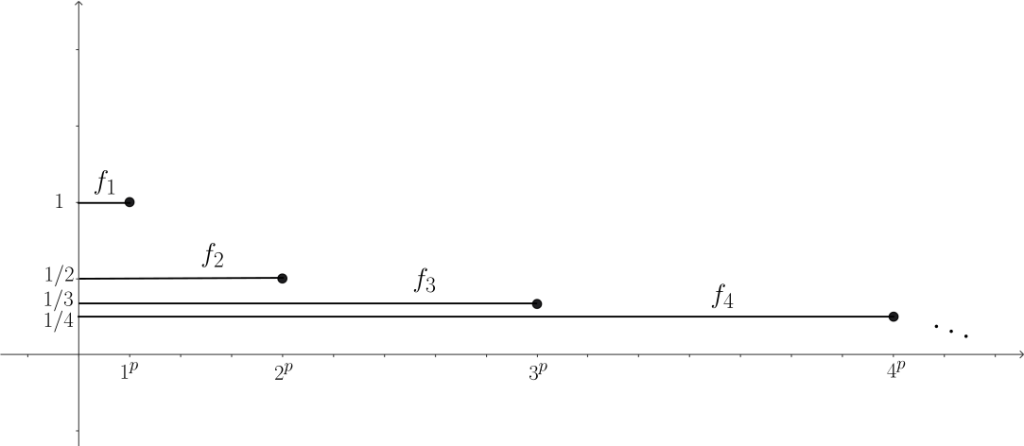

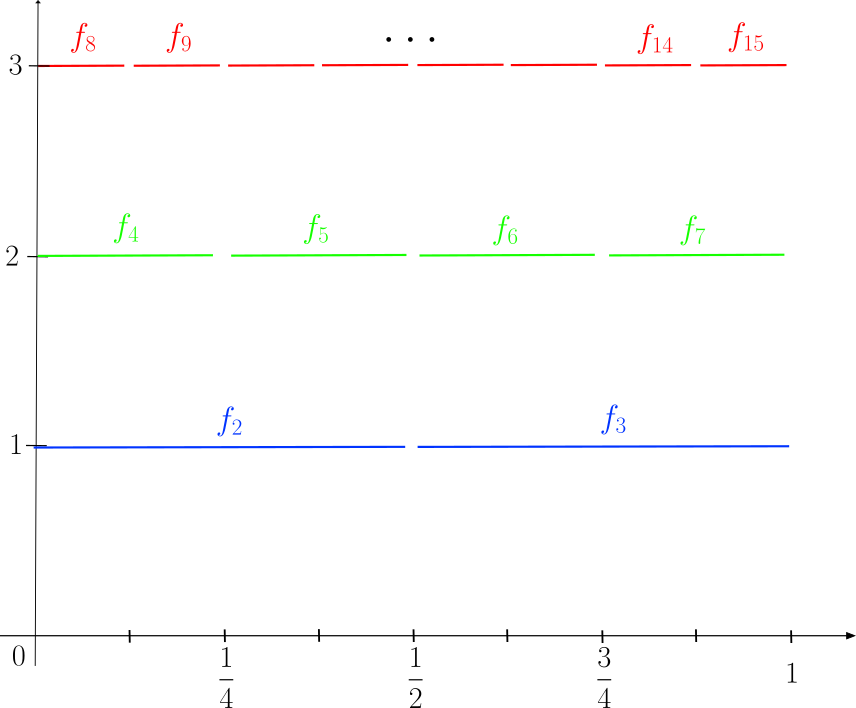

Teorema. Sea $f\in L^r(X,\mathcal{M},\mu)$ para algún $r<\infty$. Entonces $$\lim_{p\to \infty}\left\lVert f \right\lVert_{p}=\left\lVert f \right\lVert_{\infty}.$$

Nota. Aquí hay dos afirmaciones: que el límite existe y que es igual a $\left\lVert f \right\lVert_{\infty}$.

Demostración. Primero tomemos $t$ tal que $$0\leq t< \left\lVert f \right\lVert_{\infty}.$$ Por definición de la norma $\left\lVert \cdot \right\lVert_{\infty}$, el conjunto $$A=\{ x\in X \ | \ |f(x)|\geq t \}.$$ Tiene medida positiva $$\mu(A)>0.$$ Ahora: \begin{align*}

\left\lVert f \right\lVert_{p} &= \left( \int_X |f|^p \ \mathrm{d}\mu \right)^{\frac{1}{p}} \\

&\geq \left(\int_A |f|^p \ \mathrm{d}\mu \right)^{\frac{1}{p}} \\

&\geq \left(\int_A t^p \ \mathrm{d}\mu \right)^{\frac{1}{p}} \\

&= (t^p\mu(A))^{\frac{1}{p}} \\

&= t(\mu(A))^{\frac{1}{p}}.

\end{align*} Tenemos dos casos:

- Si $0<\mu(A)<\infty$ $\implies$ $\mu(A)^{\frac{1}{p}}\longrightarrow 1$ cuando $p\longrightarrow \infty$.

- Si $\mu(A)=\infty$ $\implies$ $\mu(A)^{\frac{1}{p}}=\infty.$

Sin embargo, en ambos casos $$\liminf_{p\to \infty} \left\lVert f \right\lVert_{p} \geq t.$$

Como $0\leq t< \left\lVert f \right\lVert_{\infty}$ era arbitrario, podemos concluir que $$\liminf_{p\to \infty} \left\lVert f \right\lVert_{p}\geq \left\lVert f \right\lVert_{\infty}.$$

Para la desigualdad opuesta, necesitaremos la hipótesis de que $f\in L^r$. Si $f=0$ (en c.t.p.) la desigualdad se cumple trivialmente. Supongamos entonces que $f\neq 0$ (en c.t.p.).

Notemos que $$\left\lVert f \right\lVert_{p}^p=\int_X|f|^p \ \mathrm{d}\mu=\int_X |f|^r|f|^{p-r} \ \mathrm{d}\mu\leq \left\lVert f \right\lVert_{\infty}^{p-r}\int_X|f|^r \ \mathrm{d}\mu=\left\lVert f \right\lVert_{\infty}^{p-r}\left\lVert f \right\lVert_{r}^{r}.$$ $$ \implies \left\lVert f \right\lVert_{p}\leq \left\lVert f \right\lVert_{r}^{\frac{r}{p}}\left\lVert f \right\lVert_{\infty}^{\frac{p-r}{p}}=\left\lVert f \right\lVert_{r}^{\frac{r}{p}}\left\lVert f \right\lVert_{\infty}^{1-\frac{r}{p}}.$$ Como $\left\lVert f \right\lVert_{r}<\infty$, entonces $\left\lVert f \right\lVert_{r}^{\frac{r}{p}}<\infty$. Además $ \left\lVert f \right\lVert_{r}^{\frac{r}{p}}\longrightarrow 1$ cuando $p\longrightarrow \infty$. Así pues, tomando $\limsup$ en el estimado de arriba: \begin{align*}

\limsup_{p\to \infty}\left\lVert f \right\lVert_{p} &\leq \limsup_{p\to \infty} \left\lVert f \right\lVert_{r}^\frac{r}{p}\left\lVert f \right\lVert_{\infty}^{1-\frac{r}{p}} \\

&\leq \left( \limsup_{p\to \infty} \left\lVert f \right\lVert_{r}^\frac{r}{p} \right)\left( \limsup_{p\to \infty} \left\lVert f \right\lVert_{\infty}^{1-\frac{r}{p}} \right) \\

&= (1)\cdot (\left\lVert f \right\lVert_{\infty}) \\

&= \left\lVert f \right\lVert_{\infty}

\end{align*} Juntando los dos estimados establecidos hasta ahora tenemos que: $$\limsup_{p\to \infty} \left\lVert f \right\lVert_{p}\leq \left\lVert f \right\lVert_{\infty}\leq \liminf_{p\to \infty} \left\lVert f \right\lVert_{p}.$$ Es decir, $$\lim_{p\to \infty} \left\lVert f \right\lVert_{p}=\left\lVert f \right\lVert_{\infty}.$$

$\square$

Más adelante…

Estudiaremos de varias formas la relación que existe entre $L^p$ y $L^q$ cuando $p\neq q$.

Tarea moral…

- Sea $f(x)=\frac{1}{\sqrt{x}}$ para cada $x\in (0,1)$. Demuestra que $f\in L^1(0,1)$ pero $f\notin L^{\infty}(0,1)$.

- Sea $f(x)=c$ para cada $x\in \mathbb{R}^n$ una función constante con $0<|c|<\infty$. Demuestra que $f\in L^{\infty}(\mathbb{R}^n)$ pero $f\notin L^{p}(\mathbb{R}^n)$ para ningún $p\in [1,\infty)$.

- Sea $f:\mathbb{R}^n \to [-\infty, \infty]$ una función medible.

- Demuestra que si $f\in L^p (\mathbb{R}^n)$ con $1\leq p <\infty$, entonces para cualquier $\varepsilon>0$, existe $R>0$ suficientemente grande tal que $$\int_{\mathbb{R}^n \setminus B_R(0)}|f|^p \ \mathrm{d}\lambda<\varepsilon.$$ Donde $B_R( 0)$ denota la bola de radio $R$ con centro en el orígen.

- Demuestra que lo anterior no necesariamente es cierto si $f\in L^{\infty}(\mathbb{R}^n)$. (Es decir, las funciones en $L^p(\mathbb{R}^n)$ ($1\leq p <\infty$) «concentran su masa cerca del orígen» mientras que las funciones en $L^{\infty}$ no necesariamente lo hacen).

- Sean $f_k:\mathbb{R}^n \to \mathbb{R}$ funciones continuas. Demuestra que $f_k \longrightarrow f$ uniformemente si y sólo si $f_k \longrightarrow f$ en $L^{\infty}(\mathbb{R}^n)$.