Introducción

El concepto de «casi donde sea» (o «en casi todo punto») refiere que dos objetos matemáticos (por ejemplo funciones) pueden considerarse equivalentes si coinciden excepto en un conjunto de medida cero. En términos de integración, esto significa que cualquier propiedad definida mediante integrales permanece invariante aunque las funciones difieran en conjuntos «irrelevantes». Este concepto simplifica problemas al ignorar comportamientos excepcionales sin importancia global.

Algunos Lemas

La siguiente serie de Lemas refuerzan la idea de que, a ojos de la integral, dos objetos son «iguales» si coinciden salvo en conjuntos de medida cero.

Lema. Sea $f:\mathbb{R}^n\to[-\infty,\infty]$ una función medible. Si $g:\mathbb{R}^n\to [-\infty,\infty]$ es una función tal que $Z=\{ x \ | \ f(x)\neq g(x) \}$ es un conjunto nulo, entonces $g$ es medible.

Demostración. Para cualquier $t\in \mathbb [-\infty,\infty]$, podemos escribir:

$$g^{-1}([-\infty,t])=(f^{-1}([-\infty,t])\setminus B)\cup A.$$

Donde $$A=\{ x \ | \ g(x)\in [-\infty,t]; \ g(x)\neq f(x) \}$$ Y $$B=\{ x \ | \ f(x)\in [-\infty,t]; \ g(x)\neq f(x) \}.$$

Claramente $A,B\subseteq Z$. Luego $\lambda(A)=\lambda(B)=\lambda(Z)=0$ $\implies$ $A$ y $B$ son medibles (cualquier conjunto nulo es medible). Como $f^{-1}([-\infty,t])$, $A$ y $B$ son medibles, se sigue que $g^{-1}([-\infty,t])$ es un conjunto medible.

$\square$

Lema. Si $f:\mathbb{R}^n \to [0,\infty]$ es una función no negativa tal que $f(x)=0$ salvo un conjunto de medida cero, entonces $$\int f \ \mathrm{d}\lambda = 0.$$

Demostración. Por el lema anterior, $f$ es medible (es 0 ). Por no negatividad, $\int f \ \mathrm{d}\lambda\geq 0$.

Si $\int f \ \mathrm{d}\lambda>0$, por definición de la integral, existiría una función simple $s\in S$ tal que $s\leq f$ y $$0<\int s \ \mathrm{d}\lambda\leq \int f \ \mathrm{d}\lambda.$$ Al ser simple, podemos escribir $s=\sum_{k=1}^{m}\alpha_k\chi_{A_k}$, con $\alpha_1,\dots,\alpha_m>0$ y $A_1,\dots,A_m$ ajenos. Como $\int s \ \mathrm{d}\lambda=\sum_{k=1}^{m}\alpha_k\lambda(A_k)>0$, necesariamente existiría algún $A_r$ con $\lambda(A_r)>0$. Sin embargo, esto implica que $f\geq \alpha_r>0$ sobre $A_r$, lo que contradice que $f=0$ salvo un conjunto nulo.

Por tanto, la única posibilidad es $\int f \ \mathrm{d}\lambda=0$.

$\square$

De hecho, podemos relajar la condición $f\geq 0$ en el Lema anterior:

Corolario. Si $f:\mathbb{R}^n \to [-\infty,\infty]$ es una función tal que $f(x)=0$ salvo un conjunto de medida cero, entonces $f\in L^1(\mathbb{R}^n)$ y $$\int f \ \mathrm{d}\lambda = 0.$$

Demostración. $f$ es medible por el primer Lema. Aplicando el lema anterior a $f_+$ y $f_-$ por separado, se sigue que $\int f \ \mathrm{d}\lambda=\int f_+ \ \mathrm{d}\lambda-\int f_- \ \mathrm{d}\lambda=0-0=0.$

$\square$

Proposición (Insensibilidad de la integral).

- Sea $f:\mathbb{R}^n\to [0,\infty]$ una función medible no negativa. Si $g:\mathbb{R}^n\to [-\infty,\infty]$ es tal que el conjunto $Z=\{ x \ | \ f(x)\neq g(x) \}$ es nulo, entonces $g$ es medible y $$\int g \ \mathrm{d}\lambda=\int f \ \mathrm{d}\lambda.$$

- Sea $f:\mathbb{R}^n\to [-\infty,\infty]$ una función en $L^1(\mathbb{R}^n)$. Si $g:\mathbb{R}^n\to [-\infty,\infty]$ es tal que el conjunto $Z=\{ x \ | \ f(x)\neq g(x) \}$ es nulo, entonces $g\in L^1(\mathbb{R}^n)$ y $$\int g \ \mathrm{d}\lambda=\int f \ \mathrm{d}\lambda.$$

Demostración. Los lemas anteriores aseguran que $g$ es medible en ambos casos.

Para la primera parte, supongamos primero que $g$ es no negativa. Podemos escribir $f=f\cdot\chi_{Z^c}+f\cdot\chi_Z$ y $g=f\cdot\chi_{Z^c}+g\cdot\chi_Z$. En ambos casos, la función de la derecha es 0 salvo quizá un conjunto nulo ($Z$). Entonces:

\begin{align*}

\int f \ \mathrm{d}\lambda &= \int f\cdot\chi_{Z^c} \ \mathrm{d}\lambda+\int f\cdot\chi_Z \ \mathrm{d}\lambda \\

&= \int f\cdot\chi_{Z^c} \ \mathrm{d}\lambda+0 \\

&= \int g\cdot\chi_{Z^c} \ \mathrm{d}\lambda+0 \\

&= \int g\cdot\chi_{Z^c} \ \mathrm{d}\lambda + \int g\cdot\chi_{Z} \ \mathrm{d}\lambda \\

&= \int g \ \mathrm{d}\lambda

\end{align*}

Para el caso general, podemos escribir $g=g_+-g_-$, donde $g_+=f$ y $g_-=0$ salvo en conjuntos de medida cero. Usando el caso anterior y los lemas:

$$\int g \ \mathrm{d}\lambda=\int g_+ \ \mathrm{d}\lambda-\int g_- \ \mathrm{d}\lambda=\int f \ \mathrm{d}\lambda-0=\int f \ \mathrm{d}\lambda.$$

Para la segunda parte, notemos que $g-f=0$ salvo un conjunto de medida cero. Así $(g-f)\in L^1(\mathbb{R}^n)$ con $$\int (g-f) \ \mathrm{d}\lambda=0.$$

Luego, por linealidad, $g=(g-f)+f\in L^1(\mathbb{R}^n)$ y $$\int g \ \mathrm{d}\lambda=\int (g-f) \ \mathrm{d}\lambda+\int f \ \mathrm{d}\lambda=\int f \ \mathrm{d}\lambda.$$

$\square$

El concepto de casi donde sea

Definición. Decimos que una propiedad $\mathcal{P}$ en $\mathbb{R}^n$ se satisface «casi donde sea» ó «para casi todo $x$» ó «para casi todo punto«, si el conjunto $$A=\{ x\in \mathbb{R}^n \ | \ \mathcal{P}(x) \text{ NO se satisface } \}.$$

Es nulo.

Generalmente abreviaremos la expresión «en casi todo punto» y sus equivalentes como c.t.p. En la literatura inglesa se suele denotar como a.e. (por almost everywhere).

Ejemplo. Casi todos los números reales son irracionales. El conjunto de racionales $\mathbb{Q}$ es de medida cero al ser numerable.

$\triangle$

Ejemplo. Podemos reescribir la proposición de insensibilidad de la siguiente forma: Si $f\in L^1$ y $f=g$ en c.t.p, entonces $g\in L^1$ y $$\int f \ \mathrm{d}\lambda=\int g \ \mathrm{d}\lambda.$$ Esto sugiere que, a ojos de la integral, dos funciones iguales en c.t.p. son «indistinguibles».

$\triangle$

Funciones definidas en casi todo punto

Otra situación que ocurre con frecuencia es que sólo podamos asegurar que una función esté definida en c.t.p. (el último teorema de esta sección es un ejemplo de esto). Sin embargo, como sugieren los teoremas anteriores, esto es suficiente para poder hablar de su integral. Procedamos de manera precisa:

Definición. Sea $f:X\subseteq \mathbb{R}^n \to [-\infty,\infty]$ una función definida en casi todo punto (c.t.p.) de $\mathbb{R}^n$ (i.e. $\lambda(\mathbb{R}^n \setminus N)=0$). Decimos que $f$ es medible si existe una extensión medible de $f$, es decir, $g:\mathbb{R}^n\to[-\infty, \infty]$ tal que para todo $x\in X$: $$f(x)=g(x).$$ Definimos la integral de $f$ como $$\int f \ \mathrm{d}\lambda=\int g \ \mathrm{d}\lambda.$$ (Siempre que ésta tenga sentido).

Observación. Hay que notar que si $f$ admite una extensión medible, entonces cualquier extensión de $f$ será medible (primer lema de la entrada). Además, la integral no depende de la extensión tomada (por insensibilidad). Por esta razón, típicamente tomamos la «extensión por cero», es decir, la extensión que vale cero en los puntos donde $f$ no está definida originalmente.

Por todo lo anterior, no hace daño extender nuestro concepto de función medible: cada que nos refiramos a una «función medible sobre $\mathbb{R}^n$», admitiremos la posibilidad de que sea una función definida en casi todo punto de $\mathbb{R}^n$. Es inmediato ver que las propiedades de las funciones medibles también se satisfacen para las funciones medibles definidas en casi todo punto.

Convergencia en casi todo punto

Definición. Sea $\{ f_k\}_{k=1}^{\infty}$ una sucesión de funciones definidas en casi todo punto de $\mathbb{R}^n$ (i.e. $\lambda(\mathbb{R}^n \setminus N)=0$). Decimos que $\{ f_k\}_{k=1}^{\infty}$ converge en casi todo punto a $f$, si existe un conjunto de medida cero $N$ tal que para todo $x\in \mathbb{R}^n\setminus N$ $$f_k(x) \longrightarrow f(x).$$

Observación. La convergencia puntual implica la convergencia en casi todo punto. El regreso no necesariamente es cierto (tarea moral).

Observación. El límite de funciones medibles (definidas en c.t.p.) es una función medible (definida en c.t.p.). Para ver esto, basta redefinir $f_1,f_2, \dots,f$ por $0$ sobre los puntos donde no están definidas o no hay convergencia puntual (que es un conjunto de medida cero) y observar que la nueva sucesión converge puntualmente a una función igual en casi todo punto a $f$ (que será medible al ser el límite de funciones medibles).

Observación. En general los límites en casi todo punto no son únicos. Por ejemplo, cualquier función que converge a $0$ en c.t.p. también converge a $\chi_{\mathbb{Q}}$ en c.t.p. pues $\chi_{\mathbb{Q}}=0$ en c.t.p. Lo que sí podemos asegurar es que los límites son únicos salvo conjuntos de medida cero (tarea moral).

Generalización de los Teoremas de convergencia

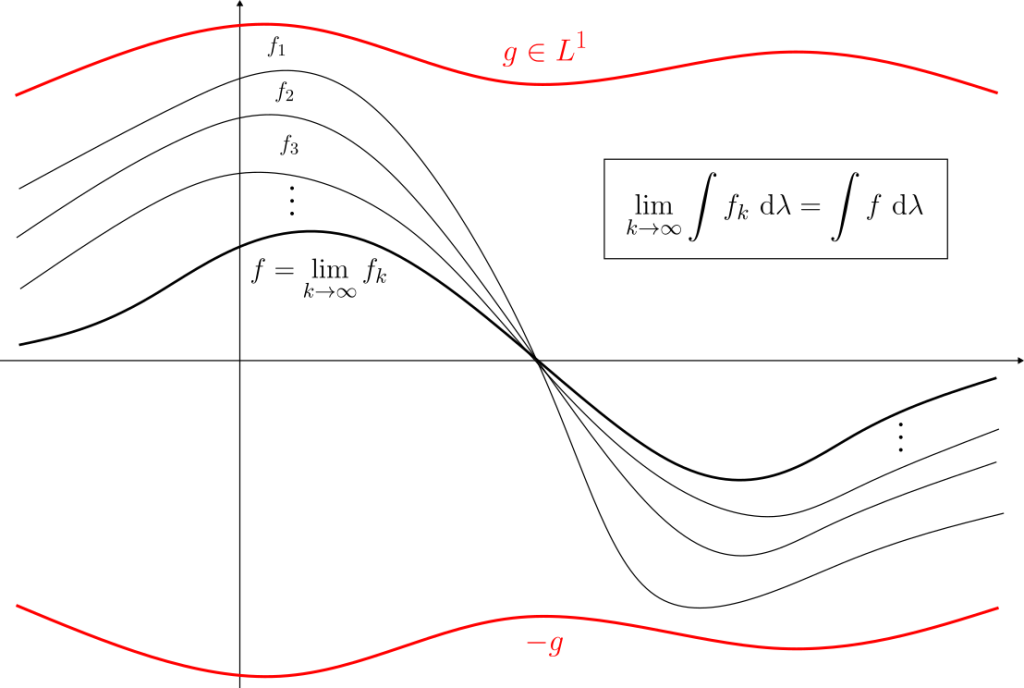

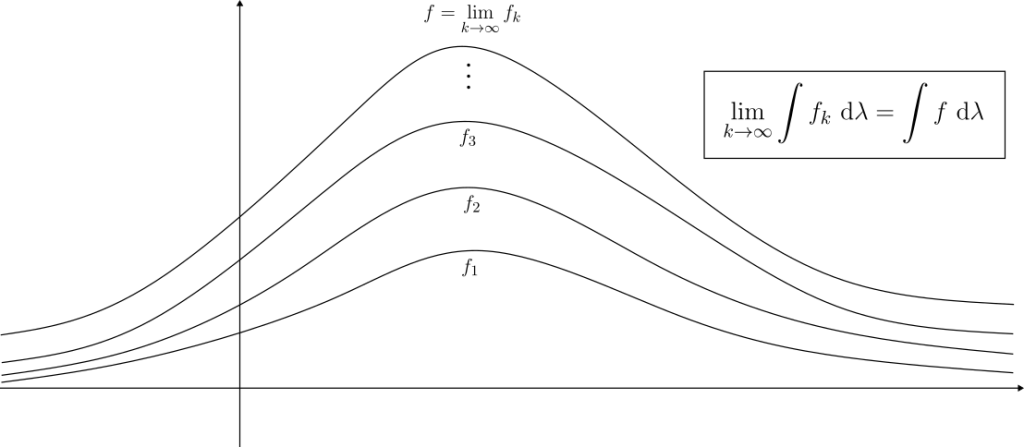

Podemos dar generalizaciones de los teoremas de convergencia en las que consideremos convergencia en casi todo punto. Por ejemplo, para el teorema de convergencia dominada tendríamos lo siguiente.

Proposición (Convergencia dominada versión c.t.p.) Sean $f_1,f_2,\dots$ funciones medibles definidas en c.t.p. de $\mathbb{R}^n$, tales que

$$\lim_{k\to \infty} f_k(x)$$

Existe para casi todo $x\in \mathbb{R}^n$. Supongamos además que existe una función $g\in L^1$ definida en c.t.p con $$|f_k(x)|\leq g(x)$$

Para casi todo $x\in \mathbb{R}^n$ y para todo $k\in \mathbb{N}$. Entonces $$\int \left( \lim_{k\to \infty} f_k \right) \ \mathrm{d}\lambda=\lim_{k\to \infty} \int f_k \ \mathrm{d}\lambda.$$

Demostración. Sea $Z$ el conjunto de $x$ tales que: O bien $f_k(x)$ no está definida para algún $k$; o bien $\lim f_k(x)$ no existe; o bien $|f_k|(x)>g(x)$ para algún $k$. Como podemos expresar a $Z$ como una unión numerable de conjuntos nulos, el propio $Z$ debe ser nulo.

Podemos redefinir las $f_k$ y $g$ de tal manera que valgan 0 sobre $Z$. Esto no afecta las propiedades en c.t.p. ni los valores de ninguna integral, pero nos deja con las hipótesis clásicas del teorema de la convergencia dominada. El resultado se sigue de aplicar el teorema de la convergencia dominada usual sobre estas nuevas funciones y luego apelar nuevamente a la insensibilidad de la integral.

$\square$

Podemos dar generalizaciones similares para los teoremas de convergencia monótona y el Lema de Fatou. Las demostraciones son similares. A partir de ahora no haremos distinción entre las versiones usuales y en c.t.p. de estos teoremas.

Intercambio de Sumas con Integrales

El siguiente resultado es relevante. Como adelantamos, es un ejemplo en el que sólo podemos asegurar que una función esté definida en c.t.p.

Teorema. Sean $f_1,f_2,\dots$ funciones en $L^1(\mathbb{R}^n)$, tales que $$\sum_{k=1}^{\infty}\int |f_k| \ \mathrm{d}\lambda<\infty.$$ Entonces $$\sum_{k=1}^{\infty} f_k(x)$$ Existe para casi todo $x\in \mathbb{R}^n$ y además $$\int \left( \sum_{k=1}^{\infty}f_k\right) \ \mathrm{d}\lambda=\sum_{k=1}^{\infty} \int f_k \ \mathrm{d}\lambda.$$

Demostración. Sea $g=\sum_{k=1}^{\infty}|f_k|$. Ésta es una función medible y no negativa. Como consecuencia del Teorema de la convergencia monótona tenemos:

$$\int g \ \mathrm{d}\lambda= \int \sum_{k=1}^{\infty}|f_k| \ \mathrm{d}\lambda=\sum_{k=1}^{\infty}\int |f_k| \ \mathrm{d}\lambda<\infty.$$ $$\implies g\in L^1.$$ Como $g$ es integrable, sabemos que $g<\infty$ en c.t.p. $\implies$ la serie $\sum_{k=1}^{\infty}f_k(x)$ converge absolutamente para casi todo $x\in \mathbb{R}^n$ (en particular converge para casi todo $x\in \mathbb{R}^n$). Además, es claro que para cada $N\in \mathbb{N}$: $|\sum_{k=1}^{N}f_k(x)|\leq \sum_{k=1}^{\infty}|f_k|(x)= g(x)$ para casi todo $x$. Aplicando el teorema de la convergencia dominada sobre la sucesión de sumas parciales $\sum_{k=1}^{N}f_k$ concluimos: $$\int \left( \sum_{k=1}^{\infty}f_k\right) \ \mathrm{d}\lambda=\sum_{k=1}^{\infty} \int f_k \ \mathrm{d}\lambda.$$

$\square$

Más adelante…

Definiremos la integral sobre subconjuntos de $\mathbb{R}^n$ y sus principales propiedades.

Tarea moral

- Demuestra que los límites en casi todo punto son únicos salvo conjuntos de medida cero, es decir, que si una sucesión $\{ f_k\}_{k=1}^{\infty}$ converge en c.t.p. a $f_1$ y a $f_2$, entonces $f_1=f_2$ en c.t.p.

- Sea $f_k=\chi_{[0,\frac{1}{k}]}$. ¿A que función converge puntualmente la sucesión $f_k$? ¿La sucesión converge en c.t.p. a $0$?

- Enuncia y demuestra una versión en casi todo punto del Teorema de la convergencia monótona.

- Enuncia y demuestra una versión en casi todo punto del Lema de Fatou.

- Sean $f,g:\mathbb{R}^n\to \mathbb{R}$ funciones continuas e iguales en casi todo punto. Prueba que de hecho $f=g$ sobre todo $\mathbb{R}^n$.