(Trabajo de titulación asesorado por la Dra. Diana Avella Alaminos)

INTRODUCCIÓN

Desde los primeros estudios de sistemas de ecuaciones, los matemáticos se enfrentaron a un problema práctico: ¿cómo deshacer una transformación lineal para recuperar el punto original?

La respuesta fue más allá de un simple “sí” o “no” a la invertibilidad: se trataba de diseñar procedimientos sistemáticos para calcular la inversa. Ahora exploraremos algunos de esos métodos, que siguen siendo herramientas fundamentales en matemáticas y ciencias aplicadas.

OPERADOR LINEAL Y VALOR PROPIO

Definición: Sea $V$ un $K$ – espacio vectorial. Le llamaremos a $T$$\,\in \mathcal{L}(V,V)$ un operador lineal en $V$.

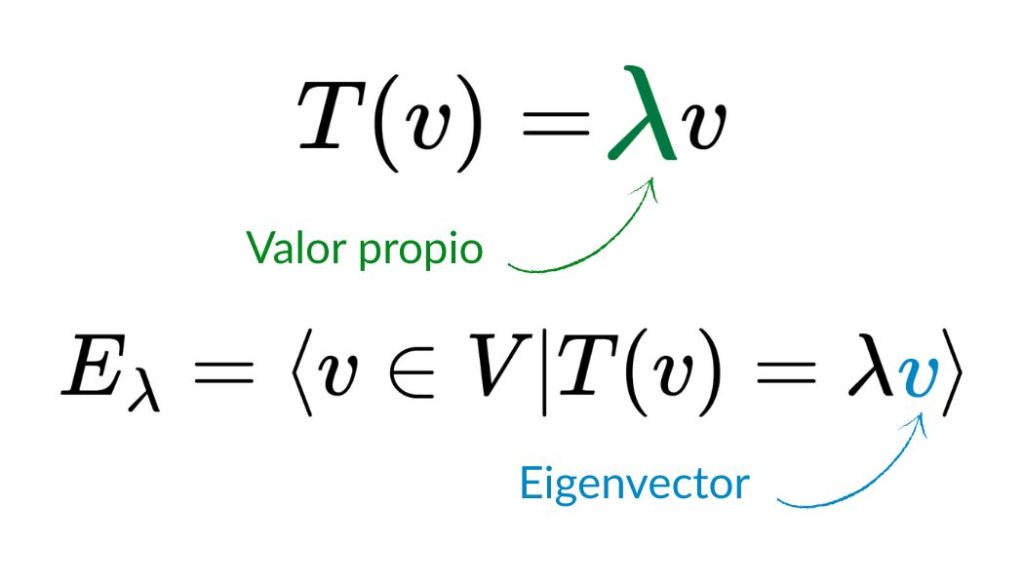

Dado $\lambda \in K$, decimos que $\lambda$ es un valor propio de $T$ si existe $v \in V \setminus \{ \theta_V \}$ tal que $T(v) = \lambda v.$

VECTOR PROPIO (EIGENVECTOR) Y ESPACIO DE VECTORES PROPIOS

Definición: Sean $V$ un $K$ – espacio vectorial, $T$ un operador lineal en $V$ y $\lambda \in K$ un valor propio de $T$. Decimos que $v$$\,\in V$ es un vector propio o eigenvector de $T$ asociado a $\lambda$ si $T(v) = \lambda v.$

Le llamamos el espacio de vectores propios asociado a $\lambda$ al conjunto $E_{\lambda} = \langle v \in V | T(v) = \lambda v \rangle .$

Observación: Si $v \in V$ es un vector propio de $T$ no nulo, entonces existe un único valor propio de $T$ al que está asociado.

Justificación. Sea $v \in V \setminus \{ \theta_V \}$ un vector propio de $T$ asociado al valor propio $\lambda \in K$. Supongamos que también está asociado al valor propio $\mu \in K$. Entonces, $T(v) = \lambda v = \mu v$, en consecuencia $(\lambda – \mu) v= \theta_V$, pero como $v \not = \theta_V$, entonces $\lambda -\mu =0$ y así $\lambda =\mu$.

Ejemplo

- Sea $T : \mathbb{R}^2 \longrightarrow \mathbb{R}^2$ donde $\forall (x,y) \in \mathbb{R}^2 ( T(x,y) = (y,x) )$

$1$ es un valor propio de $T$ y $(1,1)$ es un vector propio de $T , \lambda$ asociado a $1.$

$-1$ es un valor propio de $T$ y $(-1,1)$ es un vector propio de $T$ asociado a $-1.$

Justificación.

Tenemos que $T(1,1) = (1,1) = 1 (1,1)$

Por lo tanto $T(1,1) = 1(1,1)$ y se tiene que $1$ es un valor propio de $T$ y $(1,1) $ un vector propio de $T$ asociado a $1$. Además,

$E_1 = \langle (x,y) \in \mathbb{R}^2 | T(x,y) = 1(x,y) \rangle$ $= \langle (x,y) \in \mathbb{R}^2 | (y,x) = (x,y) \rangle$ $= \langle (x,x) \in \mathbb{R}^2 | x \in \mathbb{R} \rangle$.

Tenemos que $T(-1,1) = (1,-1) = -1 (-1,1)$

Por lo tanto $T(-1,1) = -1(-1,1)$ y se tiene que $-1$ es un valor propio de $T$ y $(-1,1) $ un vector propio de $T$ asociado a $-1$. Además,

$E_{-1} = \langle (x,y) \in \mathbb{R}^2 | T(x,y) = -1(x,y) \rangle$ $= \langle (x,y) \in \mathbb{R}^2 | (y,x) = (-x,-y) \rangle$ $= \langle (x,-x) \in \mathbb{R}^2 | x \in \mathbb{R} \rangle$.

Teorema (5.5.1.): Sean $V$ un $K$ – espacio vectorial y $T$ un operador lineal en $V$.

Si $\lambda_1 , … , \lambda_m \in K$ son valores propios de $T$ distintos y $v_1 , … , v_m$ son vectores propios no nulos de $T$ asociados a $\lambda_1 , … , \lambda_m$ respectivamente, entonces la lista $v_1 , … , v_m$ es linealmente independiente.

Demostración: Sean $V$ un $K$ – espacio vectorial y $T$ un operador lineal en $V$.

Si $\lambda_1 , … , \lambda_m \in K$ son valores propios de $T$ distintos y $v_1 , … , v_m$ son vectores propios no nulos de $T$ asociados a $\lambda_1 , … , \lambda_m$. Supongamos por reducción al absurdo que la lista $v_1 , … , V_m$ es linealmente dependiente.

Sea $k \in \{ 1 , … , m \}$ el menor entero tal que $v_k \in \langle v_1 , … , v_{k-1} \rangle .$

Así, $v_k = \mu_1 v_1 + … + \mu_{k-1} v_{k-1}$ para algunos $\mu_1 , … , \mu_{k-1} \in K.$

Multiplicando por $\lambda_k$ tenemos:

$\lambda_k v_k = \mu_1 \lambda_k v_1 + … + \mu_{k-1} \lambda_{k} v_{k-1}.$

Por otro lado, evaluando $T$ en $v_k$:

$\lambda_k v_k = T(v_k)$ $= T (\mu_1 v_1 + … + \mu_{k-1} v_{k-1})$ $= \mu_1 \lambda_1 v_1 + … + \mu_{k-1} \lambda_{k-1} v_{k-1}.$

Restando ambas expresiones obtenemos:

$\theta_V = \mu_1 (\lambda_1 – \lambda_k) v_1 + … + \mu_{k-1} (\lambda_{k-1} – \lambda_k) v_{k-1}.$

Por la elección de $k$, la lista $v_1 , … , v_{k-1}$ es l.i., entonces $\mu_i (\lambda_1 – \lambda_k) = 0$ para toda $i \in \{ 1 , … , k-1 \}.$

Por hipótesis, $\lambda_1 , … , \lambda_m$ son distintos, entonces $\lambda_i – \lambda_k \not= 0$ para toda $i \in \{ 1, … , k-1 \}$. Por lo tanto, los valores que son cero son los $\mu_i$ para toda $i \in \{ 1, … , k-1 \}$.Así, $v_k = \mu_1 v_1 + … + \mu_{k-1} v_{k-1} = \theta_V$, pero esto es una contradicción ya que por hipótesis $v_1 , … , v_m$ son vectores no nulos.

Por lo tanto, la lista $v_1 , … , v_m$ es linealmente independiente.

Ejemplo

- Sea $T : \mathbb{R}^2 \longrightarrow \mathbb{R}^2$ donde $\forall (x,y) \in \mathbb{R}^2 ( T(x,y) = (y,x) )$

$\beta=( (1,1) , (-1,1) )$ es una base de $\mathbb{R}^2$ y $[T ]_{\beta}^{\beta}$ es una matriz diagonal.

Justificación. Notemos que $T$ es el operador lineal del ejemplo anterior.

Ya vimos que $(1,1)$ y $(-1,1)$ son vectores propios de $T$ asociados a $1$ y $-1$ respectivamente.

Por el teorema (5.5.1.), podemos concluir que $\{ (1,1) , (-1,1) \}$ es un conjunto linealmente independiente de cardinalidad $2$ en el espacio $\mathbb{R}^2$, que es de dimensión $2$. Por lo tanto, es una base de $\mathbb{R}^2.$

Así, definiendo $\beta = ( (1,1) , (-1,1) )$, tenemos que $[T ]_{\beta}^{\beta} = \left(\begin{array}{rr} 1 & 0 \\ 0 & -1 \end{array}\right) .$

Teorema (5.5.2.): Sea $V$ un $K$ – espacio vectorial de dimensión finita y $T \in \mathcal{L}(V,V)$. Si $\beta = (v_1 , … , v_n)$ es una base de $V$ formada por vectores propios de $T$, entonces $[ T ]_{\beta}^{\beta}$ es una matriz diagonal.

Demostración: Sea $V$ un $K$ – espacio vectorial de dimensión finita, $T \in \mathcal{L}(V,V)$ y $\beta = (v_1 , … , v_n)$ es una base de $V$ formada por vectores propios de $T$.

Como $v_1 , … , v_n$ son vectores propios de $T$, existen $\lambda_1 , … , \lambda_n \in K$ tales que $T (v_i) = \lambda_i v_i$ para cada $i \in \{ 1 , … , n \}.$ De este modo, para cada $i \in \{ 1, … , n \}$ tenemos que $T (v_i) = 0 v_1 + … \lambda_i v_i + … + 0 v_n$, entonces para cada $i \in \{ 1, … , n \}$:

$[ T (v_i) ]_{\beta} = \left(\begin{array}{c} 0 \\ \vdots \\ \lambda_i \\ \vdots \\ 0 \end{array}\right).$

Por lo tanto, cada $i$-ésima columna de $[ T ]_{\beta}^{\beta}$ es cero en todas sus entradas excepto en la $i$-ésima, cuyo valor es $\lambda_i$:

$[ T ]_{\beta}^{\beta} = \left(\begin{array}{rrrrr} \lambda_1 & 0 & \dotsb & 0 & 0 \\ 0 & \lambda_2 & \dotsb & 0 & 0 \\ \vdots & \vdots & \ddots & \vdots & \vdots \\ 0 & 0 & \dotsb & \lambda_{n-1} & 0 \\ 0 & 0 & \dotsb & 0 & \lambda_n \end{array}\right) $

Observación: $\lambda$ es un valor propio de $T$ si y solo si $T – \lambda id_V$ no es invertible.

Justificación: $\lambda$ es un valor propio de $T$

$\iff \exists v \in V \setminus \{ \theta_V \}$ tal que $T (v) = \lambda v$

$\iff \exists v \in V \setminus \{ \theta_V \}$ tal que $(T – \lambda id_V) (v) = \theta_V$

$\iff T – \lambda id_V$ no es inyectiva

$\iff T – \lambda id_V$ no es invertible.

Tarea Moral

- Demuestra o da un contraejemplo:

Sean $V$ un $K$ – espacio vectorial de dimensión finita y $T \in \mathcal{L} (V,V)$.

Existe siempre una base formada por vectores propios. - Sea $T : \mathbb{R}^2 \longrightarrow \mathbb{R}^2$ donde $\forall (x,y) \in \mathbb{R}^2 ( T (x,y) = (2x , 3y) ).$

¿Qué valores propios están asociados a $(1,0)$ y $(0,1)$ respectivamente?

Describe geométricamente los espacios de los eigenvectores $(1,0)$ y $(0,1).$ - Demuestra que si todos los vectores no nulos de $\mathbb{C}^n$ son vectores propios de un operador lineal $T : \mathbb{C}^n \longrightarrow \mathbb{C}^n$, entonces $T = \lambda Id$ para algún $\lambda \in K.$

Más adelante…

Abriremos la puerta a un nuevo terreno: los valores propios y el polinomio característico. Estos conceptos nos permiten descubrir direcciones esenciales dentro de un espacio vectorial, donde la acción de una transformación se reduce a un estiramiento o compresión. Al mismo tiempo, nos encontraremos con una clase especial de matrices – las simétricas – cuyas propiedades hacen que sus valores propios sean particularmente interesantes y manejables.

Entradas relacionadas

- Ir a Álgebra Lineal I

- Entrada anterior del curso: 5.4. MATRICES INVERTIBLES: equivalencias y producto

- Siguiente entrada del curso: 5.6. POLINOMIO CARACTERÍSTICO Y MATRIZ SIMÉTRICA: definiciones y propiedades de valores propios